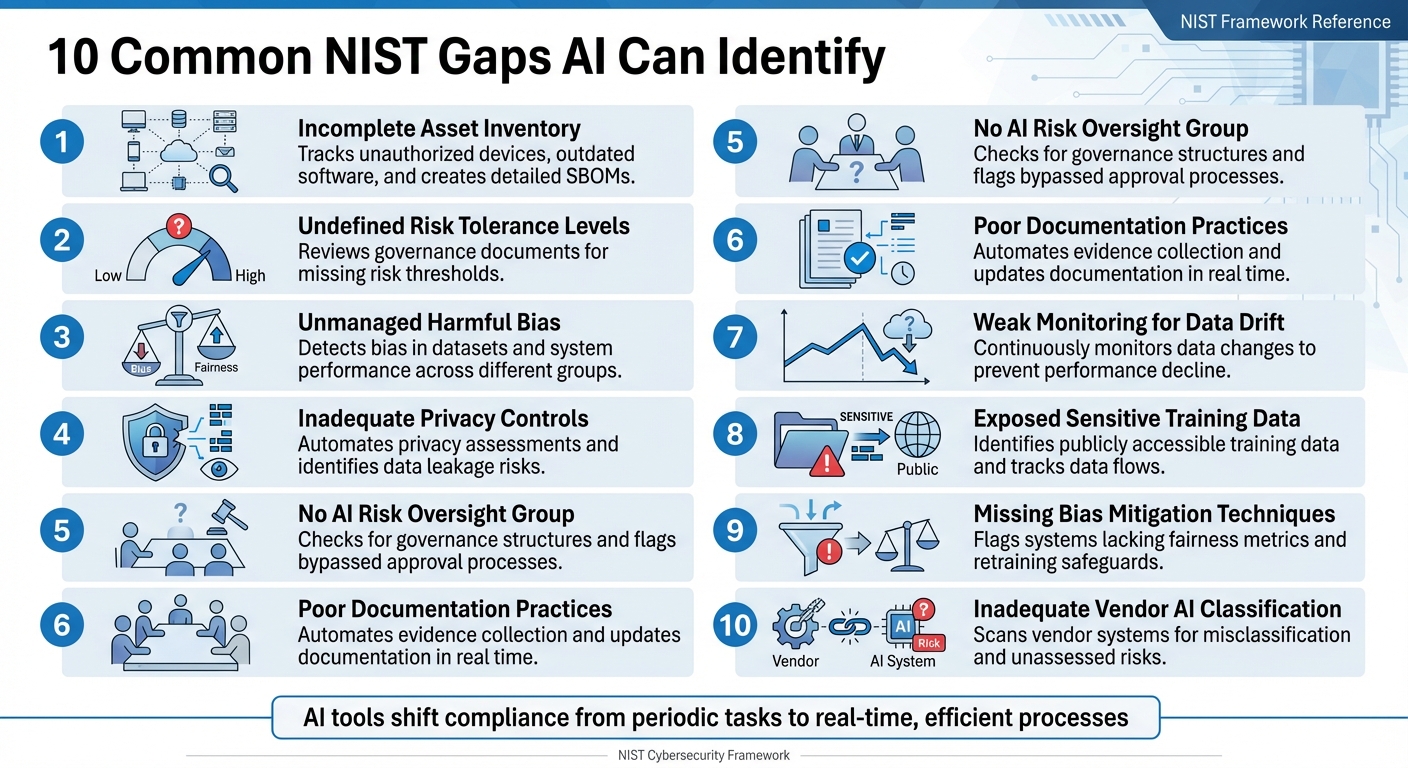

10 häufige NIST-Lücken, die KI identifizieren kann

KI automatisiert die NIST-Lückenanalyse – Erkennung von Asset-, Bias-, Datenschutz-, Datenverschiebungs- und Anbieterrisiken sowie Generierung auditbereiter Nachweise.

Organisationen haben oft Schwierigkeiten, die vollständige Compliance mit dem NIST Cybersecurity Framework (CSF), insbesondere der aktuellen Version CSF 2.0, zu erreichen. Manuelle Audits sind langsam und fehleranfällig, was zu Lücken in Bereichen wie Asset-Tracking, Risikomanagement und Datenschutzkontrollen führt. KI-gestützte Tools verändern dieses Spiel, indem sie Compliance-Prüfungen automatisieren, kontinuierliches Monitoring ermöglichen und Lücken in Echtzeit identifizieren. Hier sind 10 häufige NIST-Compliance-Lücken, die KI adressieren kann:

- Unvollständiges Asset-Inventar: KI erkennt unautorisierte Geräte, veraltete Software und erstellt detaillierte Software-Bills of Materials (SBOMs).

- Nicht definierte Risikotoleranzniveaus: KI überprüft Governance-Dokumente auf fehlende Risikoschwellen.

- Ungemanagter Bias: KI erkennt Bias in Datensätzen und Systemleistungen über verschiedene Gruppen hinweg.

- Unzureichende Datenschutzkontrollen: KI automatisiert Datenschutzbewertungen und identifiziert Risiken wie Datenlecks.

- Keine KI-Risikoaufsichtsgruppe: KI überprüft Governance-Strukturen und markiert umgangene Genehmigungsprozesse.

- Schlechte Dokumentationspraktiken: KI automatisiert die Sammlung von Nachweisen und aktualisiert Dokumentationen in Echtzeit.

- Schwaches Monitoring für Datenverschiebungen: KI-Tools überwachen kontinuierlich Datenänderungen, um Leistungsabfälle zu verhindern.

- Exponierte sensible Trainingsdaten: KI identifiziert Risiken wie öffentlich zugängliche Trainingsdaten und verfolgt Datenflüsse.

- Fehlende Bias-Minderungstechniken: KI markiert Systeme ohne Fairness-Metriken und Nachschulungssicherungen.

- Unzureichende Anbieter-KI-Klassifizierung: KI durchsucht Anbietersysteme nach Fehlklassifizierungen und unbewerteten Risiken.

KI-Tools wie ISMS Copilot vereinfachen die Compliance, indem sie die Lückenanalyse automatisieren, Kontrollen mit NIST-Standards abstimmen und auditbereite Dokumentationen generieren. Dies wandelt Compliance von einer periodischen Aufgabe in einen effizienten, Echtzeit-Prozess um.

10 häufige NIST-Compliance-Lücken, die KI identifizieren und adressieren kann

GRC – Lückenanalyse 101 mit NIST RMF und CIS Controls-Compliance

1. Unvollständiges Asset-Inventar

Ein gründliches Asset-Inventar ist entscheidend, um die Anforderungen der NIST-Compliance zu erfüllen. Dennoch fällt es vielen Organisationen schwer, alle Geräte, Anwendungen und Softwarekomponenten zu verfolgen, die sie nutzen. Wenn Assets nicht erfasst werden, entstehen Schwachstellen, die Angreifer ausnutzen können.

Ein NIST 800-53 Copilot kann helfen, indem er den tatsächlichen Zustand Ihres Netzwerks mit dem gewünschten Zustand vergleicht. Kontinuierliches Scannen hebt Abweichungen von Ihrer genehmigten Asset-Liste hervor und erleichtert so die Identifizierung von Problemen wie unautorisierten Geräten oder veralteter Software, die kritische Sicherheitsupdates fehlen. Dieser fortlaufende Prozess stärkt nicht nur das Risikomanagement, sondern liefert auch wertvolle Einblicke in die Sicherheit Ihres Netzwerks.

"Der Fokus der SWAM-Fähigkeit liegt auf der Verwaltung von Risiken, die durch nicht verwaltete oder unautorisierte Software im Netzwerk entstehen. Nicht verwaltete oder unautorisierte Software ist ein Ziel, das Angreifer als Plattform nutzen können, um Komponenten im Netzwerk anzugreifen." – NIST IR 8011 Vol. 3

Neben dem Scannen bieten CDM-Dashboards Echtzeit-Transparenz über Ihr Asset-Inventar und ersetzen veraltete, statische Audits durch kontinuierliches Monitoring. KI-Systeme können zudem automatisch eine detaillierte Software Bill of Materials (SBOM) für jede Softwareversion erstellen, die alle Komponenten und Abhängigkeiten – ob direkt oder indirekt – katalogisiert. Diese Funktionalität gewinnt zunehmend an Bedeutung, da fast 220.000 US-Organisationen die CMMC-Standards einhalten müssen, wobei 80.000 von ihnen den Level 2-Kontrollen unterliegen, die sich an NIST SP 800-171 orientieren.

Um Ihr Asset-Inventar zu verbessern, sollten Sie die Verwendung von Software Identification (SWID)-Tags in Betracht ziehen, um die automatische Erkennung von Software in Ihrem Netzwerk zu ermöglichen. Sie können auch automatisiertes Whitelisting implementieren, um sicherzustellen, dass nur autorisierte Software ausgeführt werden darf. Für KI-Systeme ist es entscheidend, nicht nur die Hardware, sondern auch die von ihnen genutzten Drittanbieter-Integrationen zu inventarisieren, da diese externen Komponenten zusätzliche Risiken einführen können.

2. Nicht definierte Risikotoleranzniveaus

Viele Organisationen erkennen die mit KI verbundenen Risiken, scheitern jedoch daran, klare Schwellenwerte für das zu definieren, was akzeptabel ist. Ohne diese definierten Grenzen fällt es Teams oft schwer zu bestimmen, wann ein Projekt fortgesetzt oder gestoppt werden sollte. Hier kommen KI-Tools ins Spiel. Mithilfe von Natural Language Processing können cross-framework ISMS-Assistenten Richtlinien, Risikomanagementstrategien und Governance-Rahmenwerke überprüfen, um zu bestätigen, ob spezifische Kriterien – wie quantitative Grenzen oder qualitative Schwellenwerte – für verschiedene KI-Anwendungen festgelegt wurden. Systeme, die sensible Daten wie personenbezogene Informationen (PII) verarbeiten, erfordern beispielsweise strengere Schwellenwerte, um Sicherheit und Compliance zu gewährleisten. Wenn diese Schutzmaßnahmen fehlen, sind umgehende Korrekturmaßnahmen erforderlich, wie von NIST betont.

"Soweit Herausforderungen bei der Spezifizierung von KI-Risikotoleranzen ungelöst bleiben, kann es Kontexte geben, in denen ein Risikomanagementrahmenwerk nicht ohne Weiteres anwendbar ist, um negative KI-Risiken zu mildern." – NIST AI RMF 1.0

NIST definiert Risikotoleranz als "die Bereitschaft der Organisation oder des KI-Akteurs, das Risiko einzugehen, um ihre Ziele zu erreichen". KI-Tools spielen eine entscheidende Rolle, indem sie Governance-Dokumente scannen, um nach klar dokumentierten Kriterien für die Risikoakzeptanz zu suchen – sei es in Form numerischer Grenzen oder breiterer qualitativer Schwellenwerte. Der NIST AI Risk Management Framework, eingeführt am 26. Januar 2023, schreibt jedoch keine spezifischen Toleranzniveaus vor. Stattdessen hebt es die Bedeutung der Identifizierung von Lücken hervor – wie fehlende Dokumentation über Restrisiken oder vage Risikomanagementstrategien –, die Organisationen gefährden könnten.

NIST gibt in solchen Szenarien eine klare Anweisung:

"In Fällen, in denen ein KI-System inakzeptable negative Risikoniveaus aufweist ... sollte die Entwicklung und Bereitstellung in sicherer Weise eingestellt werden, bis die Risiken ausreichend gemildert werden können." – NIST AI RMF 1.0

3. Ungemanagter schädlicher Bias

Bias in KI-Systemen entsteht durch das Zusammenspiel von Code, Trainingsdaten und dem weiteren sozialen Kontext. Ohne angemessene Compliance-Richtlinien können diese Systeme bestehende Ungleichheiten verschärfen oder sogar neue Diskriminierungsmuster schaffen. Dies hat reale Konsequenzen in Bereichen wie Gesundheitswesen, Personalwesen und Finanzen. Das Problem wird durch die Komplexität von KI-Systemen verschärft, die oft unzählige Entscheidungspunkte umfassen, was es nahezu unmöglich macht, Bias manuell zu identifizieren und zu adressieren. Organisationen greifen häufig auf einen KI-Compliance-Assistenten zurück, um diese komplexen, mehrstufigen Workflows zu verwalten.

"Ohne angemessene Kontrollen können KI-Systeme ungerechte oder unerwünschte Ergebnisse für Einzelpersonen und Gemeinschaften verstärken, aufrechterhalten oder verschärfen." – NIST AI RMF 1.0

KI-Tools begegnen schädlichem Bias durch Prozesse wie Testen, Evaluierung, Verifizierung und Validierung (TEVV), wie in der MEASURE-Funktion des NIST AI RMF beschrieben. Diese Prozesse bewerten, ob Trainingsdatensätze ihrem Zweck entsprechen und aktuelle gesellschaftliche Bedingungen widerspiegeln. Automatisiertes Monitoring spielt hier eine Schlüsselrolle, indem es „Datenverschiebungen“ identifiziert, die sich auf die Systemleistung auswirken und neue Verzerrungen einführen können, die während der ersten Tests nicht vorhanden waren.

Dieser Erkennungsprozess geht über reine Zahlen hinaus. KI-Tools bewerten, wie Systeme über verschiedene Untergruppen hinweg performen und erkennen, dass auch Personen, die das System nicht direkt nutzen, betroffen sein können. Dieser Ansatz, oft soziotechnische Evaluation genannt, berücksichtigt nicht nur das technische Design, sondern auch, wie es mit gesellschaftlichen Normen und menschlichem Verhalten interagiert, um Ungleichheiten zu erzeugen. Um Objektivität zu gewährleisten, empfiehlt NIST eine klare Trennung der Verantwortlichkeiten – Teams, die KI-Modelle erstellen, sollten von denen getrennt sein, die sie verifizieren und validieren. Diese Struktur ermöglicht neutralere Bewertungen und kontinuierliches Monitoring auf Bias über alle Nutzergruppen hinweg.

Eine weitere Schlüsselstrategie zur Verwaltung von Bias ist die verbesserte Datennachverfolgung. Organisationen, die KI-native Sichtbarkeitstools einsetzen, berichten beispielsweise von einer beeindruckenden Steigerung von 1.660 % ihrer Fähigkeit, Datenverarbeitungsaktivitäten innerhalb von nur drei Wochen nach der Implementierung zu überwachen. Diese Tools kartieren „Datenreisen“, indem sie nachverfolgen, wie Daten von ihrer Quelle durch KI-Modelle fließen. Dadurch können potenzielle Verstöße in Echtzeit vorhergesagt und verhindert werden. Dies ist entscheidend, da KI Daten in Geschwindigkeiten verarbeitet, die manuelle Teams nicht bewältigen können. Die Nachverfolgung dieser Datenflüsse ist essenziell, um Verschiebungen zu erkennen, die zu neuen oder sich verschärfenden Verzerrungen führen könnten, bevor sie Schaden anrichten.

4. Unzureichende Datenschutzkontrollen

Das schnelle Tempo und die Skalierbarkeit von KI-Systemen machen Datenschutzlücken zu einem erheblichen Problem, insbesondere da manuelle Überwachung kaum mithalten kann. Ohne angemessene Datenschutzsicherungen riskieren Organisationen, personenbezogene Informationen (PII) durch Trainingsdatenlecks, unautorisierten Zugriff oder unbeabsichtigte Offenlegungen in Modellausgaben preiszugeben. Die Abhängigkeit von APIs für die Datenerfassung und Inferenz erhöht die Angriffsfläche zusätzlich, was robuste Datenschutzkontrollen zu einer Notwendigkeit macht.

Um diese Herausforderungen zu bewältigen, automatisieren KI-Tools, einschließlich spezialisierter Compliance-Assistenten, Datenschutzkontrollbewertungen mithilfe maschinenlesbarer Formate wie OSCAL. Diese Tools bewerten Kontrollen, die in Rahmenwerken wie NIST SP 800-53 beschrieben sind, und nutzen Formate wie JSON, XML und YAML. Am 27. August 2025 veröffentlichte NIST die Version 5.2.0 von SP 800-53, die Datenschutzkontrollen vollständig in den umfassenderen Sicherheitskontrollkatalog integrierte und damit den früheren separaten Ansatz ablöste.

"Die Berücksichtigung von Funktionalität und Gewährleistung trägt dazu bei, sicherzustellen, dass Informationstechnologieprodukte und die Systeme, die auf diesen Produkten basieren, ausreichend vertrauenswürdig sind." – Joint Task Force, NIST SP 800-53 Rev. 5

Automatisierte Tools konzentrieren sich auf die PII Processing and Transparency (PT)-Kontrollfamilie, um unautorisierte PII-Nutzung, Offenlegungen oder Risiken der De-Anonymisierung zu identifizieren. Sie decken zudem Shadow APIs und Shadow AI auf, die manuelle Audits oft übersehen. Durch die Implementierung von „Policy-as-Code“ können Organisationen die komplexen Anforderungen von NIST SP 800-53 in Echtzeit-Betriebsregeln umwandeln. Dieser Prozess wird vereinfacht, wenn Organisationen ihre KI-Compliance-Assistenten auf hochpräzise Modelle trainieren, die für GRC entwickelt wurden. Diese Regeln redigieren sensible Daten automatisch aus KI-Prompts und -Ausgaben, bevor sie vom Modell verarbeitet werden.

Zusätzlich unterstützt die NIST-Software Dioptra Red-Teaming-Übungen und hilft Organisationen dabei, Datenschutz- und Sicherheitskontrollen unter adversativen Bedingungen zu testen. Diese Simulationen können Leistungsverluste messen und spezifische Schwachstellen identifizieren. Dies ist besonders wichtig, da das NIST AI RMF Generative AI Profile 12 einzigartige oder erhöhte Risiken im Zusammenhang mit KI auflistet, darunter Datenschutzbedenken wie Lecks und unautorisierte De-Anonymisierung. Am 14. April 2025 betonte NIST diese Probleme erneut durch die Veröffentlichung des Entwurfs des Privacy Framework 1.1, das sich speziell mit KI-bezogenen Datenschutzrisiken wie Inferenzangriffen und Bias-Verstärkung befasst.

5. Keine KI-Risikoaufsichtsgruppe

Eine große Herausforderung im KI-Risikomanagement ist das Fehlen einer dedizierten Aufsichtsgruppe. Ohne ein solches Komitee fallen Governance und Verantwortung oft durch die Ritzen, was zu fragmentierten und prioritätsmäßig niedrigeren Bemühungen führt. Moderne Tools, die Natural Language Processing (NLP) nutzen, können dieses Problem adressieren, indem sie Organisationsrichtlinien, Satzungen und Sitzungsprotokolle analysieren. Diese Tools können bestätigen, ob eine formelle KI-Risikoaufsichtsgruppe existiert und sicherstellen, dass sie mit der „Govern“-Funktion des NIST AI RMF – insbesondere Govern 1.2 – übereinstimmt, die die Notwendigkeit klarer Governance- und Verantwortungsstrukturen betont.

KI-gestützte Systeme untersuchen zudem Organigramme und Identitätsmanagementsysteme, um formelle Aufsichtsfunktionen im KI-Risikomanagement zu identifizieren. Governance-Plattformen bieten eine weitere Schutzschicht, indem sie Projekte markieren, die formelle Genehmigungsprozesse umgehen. Dies stellt ein kontinuierliches Monitoring sicher, einen kritischen Bestandteil der Einhaltung des NIST RMF. Die „Govern“-Funktion fungiert als Grundlage und beeinflusst alle anderen RMF-Funktionen wie Map, Measure und Manage. Dieser vernetzte Ansatz stärkt das gesamte Rahmenwerk.

"Ohne definierte Verantwortlichkeiten können KI-Risikomanagementbemühungen fragmentiert oder herabgestuft werden, was die Organisation gefährdet." – Kezia Farnham, Senior Manager, Diligent

Die Dringlichkeit einer angemessenen Aufsicht wird durch das schnelle Wachstum von KI-Investitionen und -Regulierung unterstrichen. Im Jahr 2024 überstieg die private KI-Investition in den USA 100 Milliarden US-Dollar, während Erwähnungen von KI in globaler Gesetzgebung seit 2023 um 21,3 % in 75 Ländern stiegen – ein beeindruckender Anstieg um das Neunfache seit 2016. Ohne formelle Aufsichtsmechanismen riskieren Organisationen, gegen aufkommende Regulierungen wie den EU AI Act und die US-Executive Order 14110 zu verstoßen, die die Bedeutung menschlicher Aufsicht und auditierbarem Risikomanagement betonen.

Um diese Lücke zu schließen, sollten Organisationen ein funktionsübergreifendes KI-Risikokomitee bilden, das wichtige Führungskräfte wie den General Counsel, den Chief Information Security Officer (CISO), den Chief Risk Officer und KI/ML-Verantwortliche umfasst. Die Zuweisung der Verantwortung für das AI RMF an eine einzelne Führungskraft – oft den Leiter Risiko oder Recht – kann die zentrale Verantwortung weiter stärken. Zusätzlich kann die Einführung eines zweckgebundenen KI-Compliance-Assistenten diesen Prozess vereinfachen, indem er die Zuordnung von Rollen und Verantwortlichkeiten automatisiert und veraltete manuelle Tabellenkalkulationen durch kontinuierliche Monitoringsysteme ersetzt.

6. Schlechte Dokumentationspraktiken

Aufbauend auf früheren Problemen mit Asset-Tracking und Aufsicht untergräbt schlechte Dokumentation Compliance-Bemühungen zusätzlich. Dokumentationslücken sind sowohl weit verbreitet als auch kostspielig im Hinblick auf die NIST-Compliance. Beeindruckende 86 % der Organisationen haben keine Transparenz über ihre KI-Datenflüsse, was zu erheblichen Dokumentations- und Auditlücken führt, die während regulatorischer Prüfungen Probleme bereiten können. Wenn Auditoren beispielsweise Protokolle von KI-Interaktionen mit personenbezogenen Daten anfordern, können viele Organisationen diese nicht vorlegen. Diese Versäumnis verstößt gegen wichtige Regulierungen wie GDPR Artikel 30, CCPA Abschnitt 1798.130 und HIPAA § 164.312.

KI-gestützte Compliance-Plattformen bieten eine praktische Lösung, indem sie veraltete manuelle Tabellenkalkulationen durch Echtzeit-Dashboards ersetzen. Diese Dashboards markieren automatisch fehlende Nachweise und Dokumentationsprobleme. Sie nutzen zudem kontinuierliches Kontrollmonitoring, um „Verschiebungen“ zu erkennen – Fälle, in denen aktuelle Dokumentation oder Richtlinien nicht mehr dem tatsächlichen Zustand von Systemen oder der Infrastruktur entsprechen. Automatisierte Tools erfassen Echtzeit-Konfigurationen und Protokolle und erstellen umfassende Audit-Trails.

"Jede Änderung, Bereitstellung und jeden Vorfall als Dokumentationsereignis zu behandeln, stellt eine stetige Anhäufung von Nachweisen sicher, die weit zuverlässiger ist als ein überstürzter Nachbereitungsaufwand nach einem Vorfall." – Abnormal AI

Das Prinzip von „Dokumentation während des Prozesses“ stärkt die Compliance, indem es Nachweise in Echtzeit erfasst. Durch die Integration mit Tools wie versionskontrollierten Wikis und Ticketing-Systemen stellt KI sicher, dass Genehmigungen und Screenshots an Pull Requests angehängt werden. Dies ist besonders kritisch, da nur 17 % der Organisationen automatisierte KI-Sicherheitskontrollen implementiert haben, die die für regulatorische Audits erforderlichen Protokolle bereitstellen können.

Organisationen, die automatisierte Compliance-Plattformen nutzen, sehen erhebliche Vorteile, darunter die Reduzierung von Review-Zyklen von Wochen auf nur wenige Stunden und die deutliche Senkung der Compliance-Arbeitslast. Diese Tools kartieren zudem das „Current Profile“ einer Organisation gegen ein NIST „Target Profile“ und zeigen Lücken in Schutzmaßnahmen und Dokumentation auf. Durch die Automatisierung des Prozesses „Identifizieren–Bewerten–Kategorisieren“ helfen sie sicherzustellen, dass Asset-Inventare und Risikoklassifizierungen aktuell bleiben. Dieser kontinuierliche Ansatz für Dokumentation spielt eine Schlüsselrolle bei der Aufrechterhaltung der NIST-Compliance.

sbb-itb-4566332

7. Schwaches Monitoring für Datenverschiebungen

Datenverschiebung tritt auf, wenn sich die Daten, auf denen ein KI-System trainiert wurde, im Laufe der Zeit ändern, was zu einem Leistungs- und Zuverlässigkeitsabfall führt. Da über 75 % der Organisationen KI in mindestens einer Geschäftsbereichsfunktion einsetzen, schafft das Versäumnis, diese Verschiebungen zu überwachen, ein ernsthaftes Compliance-Risiko – eines, das KI-gestützte Tools gut adressieren können. Die Bewältigung dieses Problems erfordert fortschrittlichere Monitoring-Lösungen, wie nachfolgend beschrieben.

In der Praxis fungiert KI oft als „Black Box“, was es schwieriger macht, zu erkennen, wann etwas schiefgeht. 45 % der Organisationen nennen Bedenken hinsichtlich der Datenqualität oder Verzerrungen als ein großes Hindernis für die KI-Adoption. Dennoch fehlt vielen immer noch die Tools für kontinuierliches Monitoring, was sie anfällig für Datenverschiebungen macht. Im Gegensatz zu manuellen Prüfungen ermöglicht kontinuierliches Monitoring Echtzeitanalysen und erkennt Probleme, bevor sie eskalieren.

"KI-Systeme ... können auf Daten trainiert werden, die sich im Laufe der Zeit ändern können, manchmal erheblich und unerwartet, was die Funktionalität und Vertrauenswürdigkeit der Systeme auf eine Weise beeinträchtigt, die schwer zu verstehen ist."

Um Datenverschiebungen zu adressieren, können fortschrittliche AI-SPM-Tools automatisch eingesetzte KI-Modelle erkennen, „Shadow AI“ identifizieren und sowohl Trainings- als auch Inferenzdatensätze kartieren, einschließlich Dokumentenspeicher und Vektordatenbanken. Diese Tools markieren zudem Fehlkonfigurationen wie öffentlich zugängliche Trainingsdaten, die Sicherheitsrisiken darstellen könnten.

Beispielsweise arbeitete Net Solutions kürzlich mit einem nordamerikanischen Reinigungsunternehmen zusammen, um KI-Governance für einen Verkaufschatbot zu implementieren. Durch den Einsatz von Echtzeit-Monitoring-Tools wie AWS CloudWatch und DataDog, kombiniert mit automatisierten Pipelines, die in Zoho Desk-Alerts integriert sind, gelang es dem Unternehmen, innerhalb von nur sechs Wochen von einem Proof of Concept zu einer konformen, skalierbaren KI-Lösung überzugehen.

Der Technologe Akash Lomas von Net Solutions betont die Bedeutung des Monitorings:

"Die Messung wird besonders in Umgebungen kritisch, in denen KI direkt Kundenerfahrungen prägt ... ohne kontinuierliche Aufsicht können diese Systeme abweichen – irrelevante, verzerrte oder irreführende Inhalte ausgeben."

Das Ignorieren von Datenverschiebungen kann schwerwiegende Konsequenzen haben: reduzierte Systemleistung, regulatorische Strafen und Vertrauensverlust. Hinzu kommen Cyberangriffe, die Unternehmen durchschnittlich 4,45 Millionen US-Dollar pro Jahr kosten.

8. Exponierte sensible Trainingsdaten

Das Risiko, sensible Trainingsdaten preiszugeben, ist eine ernsthafte Sorge, insbesondere im Hinblick auf Compliance-Verstöße. Laut NIST führt generative KI 12 verschiedene Risiken ein, wobei Datenschutzprobleme – wie Lecks und unautorisierte Offenlegung personenbezogener Informationen – im Mittelpunkt stehen. Viele Organisationen haben Schwierigkeiten, den Überblick zu behalten, wo sich ihre KI-Trainingsdaten befinden und wie sicher sie sind.

Um dies zu bewältigen, sind AI-Security Posture Management (AI-SPM)-Tools unverzichtbar geworden. Diese Tools können automatisch eingesetzte KI-Modelle identifizieren und die Datensätze lokalisieren, die für das Training über Cloud-Plattformen hinweg genutzt werden, einschließlich Dokumentenspeicher und Vektordatenbanken. Sie markieren zudem Schwachstellen wie öffentlich zugängliche Trainingsdaten oder offene Anwendungsendpunkte. Mahesh Nawale, Product Marketing Manager bei Zscaler, betont die Bedeutung dieser Tools:

„Zscaler AI-SPM lokalisiert automatisch Datensätze, die für KI-Training und Inferenz in Ihrer Cloud-Umgebung genutzt werden – einschließlich Daten, Dokumentenspeicher und Vektordatenbanken. Es markiert Fehlkonfigurationen wie öffentlich zugängliche Trainingsdaten und gibt Ihrem Sicherheitsteam die Einblicke, die benötigt werden, um zu untersuchen, zu beheben und Compliance nachzuweisen.“

KI-Tools gehen über die bloße Identifizierung von Fehlkonfigurationen hinaus. Sie überwachen zudem das Modellverhalten, um potenzielle Bedrohungen zu erkennen. Beispielsweise können sie Probleme wie Datenspeicherung, Modellumkehrung oder verdächtige Aktivitäten wie große Datendownloads oder unautorisierte Änderungen erkennen, die auf Datenexfiltration hindeuten könnten. Automatisierte Scanning-Funktionen stärken die Sicherheit zusätzlich, indem sie sensible Informationen – wie biometrische Daten, Gesundheits- oder Standortdaten – identifizieren, die nicht ordnungsgemäß anonymisiert wurden.

NIST hat zudem „Dioptra“ entwickelt, eine Softwarelösung, die Organisationen dabei unterstützt, KI-Modelle gegen Cyberangriffe zu testen. Sie misst, wie Angriffe die Modellleistung beeinflussen, und identifiziert Szenarien, in denen Trainingsdaten gefährdet sein könnten.

Katerina Megas, Program Manager bei NIST, hebt die wachsende Herausforderung hervor:

„KI schafft neue Wiederidentifizierungsrisiken, nicht nur aufgrund ihrer analytischen Kraft über disparate Datensätze hinweg, sondern auch aufgrund potenzieller Datenlecks aus dem Modelltraining.“

Angesichts der enormen Datensätze, die für das Training großer Sprachmodelle genutzt werden, ist kontinuierliches automatisiertes Testen keine Option mehr – es ist eine Notwendigkeit, um sensible Informationen zu schützen.

9. Fehlende Bias-Minderungstechniken

Wenn KI-Systeme keine angemessenen Methoden zur Adressierung von Bias aufweisen, riskieren sie, unfaire Ergebnisse zu verstärken und erhebliche Compliance-Probleme zu schaffen. Laut NIST ist die Verwaltung schädlichen Bias eine der sieben kritischen Eigenschaften eines vertrauenswürdigen KI-Systems. Traditionelle Risikomanagementrahmenwerke reichen nicht aus, um KI-Bias zu handhaben, was spezialisierte Minderungsstrategien unerlässlich macht. Während frühere Abschnitte die Erkennung von Bias abdeckten, erfordert die effektive Bewältigung klare Kontrollen und fortlaufende Nachschulungsbemühungen. Die bloße Identifizierung von Bias reicht nicht aus – langfristige Strategien sind erforderlich, um ihn zu bekämpfen.

KI-Tools spielen eine Schlüsselrolle bei der Aufdeckung von Lücken in Bias-Kontrollen. Sie markieren Probleme wie fehlende Fairness-Metriken (z. B. unterschiedliche Auswirkungsverhältnisse oder Unterschiede in der Falsch-Positiv-Rate), Systeme ohne adversarisches Testen oder KI-Red-Teaming sowie Modelle ohne geplante Nachschulung, die sie anfällig für Datenverschiebungen machen.

„Ohne angemessene Kontrollen können KI-Systeme ungerechte oder unerwünschte Ergebnisse für Einzelpersonen und Gemeinschaften verstärken, aufrechterhalten oder verschärfen.“ – NIST AI RMF 1.0

Um diese Herausforderungen zu adressieren, führen KI-Governance-Plattformen automatisierte Scans durch, um Compliance-Lücken basierend auf den Richtlinien des NIST AI RMF zu identifizieren. Sie stellen sicher, dass Organisationen notwendige Schutzmaßnahmen implementiert haben, wie Inhaltsfilter, Bias-Korrekturprotokolle und andere Schutzvorkehrungen, die durch Standards wie NIST AI 600-1 vorgeschrieben sind. Diese Plattformen verfolgen zudem die Datenherkunft, um zu bestätigen, dass Trainingsdatensätze keine Probleme aufweisen, die zu verzerrten Ergebnissen führen könnten. Zusätzlich identifizieren AI-Security Posture Management (AI-SPM)-Tools alle eingesetzten KI-Modelle, einschließlich „Shadow AI“-Systeme, die möglicherweise Fairness-Tests umgangen haben.

Da KI-Systeme Milliarden von Entscheidungen treffen, können unentdeckte Verzerrungen das öffentliche Vertrauen untergraben, gegen Bürgerrechte verstoßen und regulatorische Strafen nach sich ziehen. Bemerkenswerterweise gab es einen globalen Anstieg von 21,3 % bei Erwähnungen von KI-Gesetzgebung seit 2023. Diese Risiken unterstreichen die dringende Notwendigkeit eines kontinuierlichen, automatisierten Monitorings, um Fairness und Rechenschaftspflicht sicherzustellen.

10. Unzureichende Anbieter-KI-Klassifizierung

Wenn Organisationen Drittanbieter-KI-Systeme nicht ordnungsgemäß kategorisieren, setzen sie sich Compliance-Risiken aus, die sie möglicherweise nicht einmal erkennen. Das Problem? Anbieterrisikometriken stimmen oft nicht mit den internen Risikorahmenwerken eines Unternehmens überein. Wenn Anbieter falsch klassifiziert werden, ist es unmöglich, die richtigen Kontrollen anzuwenden oder zu bestimmen, ob ihre „niedriges Risiko“-Einstufung tatsächlich zum Risikotoleranzniveau Ihrer Organisation passt. Diese Diskrepanz unterstreicht die Notwendigkeit automatisierter Tools, die Anbieterklassifizierungen in Echtzeit überprüfen können.

KI-gestützte Tools greifen hier ein und automatisieren den Prozess der Identifizierung von Klassifizierungslücken. Durch das Scannen von Anbieterverträgen und technischen Spezifikationen identifizieren diese Tools falsch klassifizierte Systeme und markieren unbewertete Drittanbieter-KI-Komponenten, wie in den NIST AI RMF-Funktionen Govern 6.1 und Map 4.1 beschrieben. Sie erkennen zudem Systeme, die keine Transparenz über kritische Elemente wie vortrainierte Modelle, Datenpipelines oder Entwicklungsprozesse bieten.

„Risiken können sowohl aus Drittanbieter-Daten, -Software oder -Hardware selbst als auch aus deren Nutzung entstehen.“ – NIST AI RMF 1.0

Das NIST Cybersecurity Framework Profile for AI, entwickelt mit Input von über 6.500 Beitragenden, betont die Bedeutung der Lieferketten-Transparenz. KI-gestützte Tools helfen dabei, indem sie Echtzeit-Inventare von Drittanbietersystemen pflegen, die KI-Lieferkette kartieren und unklassifizierte oder unbewertete Komponenten aufdecken. Diese Tools decken Schwachstellen auf, die sich in Software, Hardware oder Datenquellen verbergen und möglicherweise erst während der Bereitstellung sichtbar werden. Mit automatisierter Anbieterklassifizierung können Organisationen einen umfassenden Überblick über ihre KI-Risikolandschaft erhalten, im Einklang mit den Richtlinien von NIST.

Ein weiterer Vorteil der Automatisierung ist ihre Fähigkeit, Anbieterbewertungen basierend auf Datensensibilität zu priorisieren. Beispielsweise werden Systeme, die personenbezogene Informationen verarbeiten oder direkt mit Nutzern interagieren, für eine genauere Prüfung markiert. Dieser Ansatz erkennt an, dass ein System, das in einem Kontext als risikoarm eingestuft wird – wie die Verarbeitung physikalischer Sensordaten –, in einem anderen Kontext, wie der Verwaltung geschützter Gesundheitsinformationen, ein hohes Risiko darstellen kann. Ohne dieses automatisierte Monitoring riskieren Unternehmen, Ressourcen in risikoarme Systeme zu investieren, während hochriskante KI-Tools unterbewertet bleiben.

Wie ISMS Copilot diese Lücken identifiziert

Wie KI die Multi-Framework-Compliance verbessert

KI vereinheitlicht die Abbildung von Kontrollen, automatisiert die Beweissammlung und bietet Echtzeit-Überwachung, um die Vorbereitungszeit für Audits zu verkürzen und Compliance-Fehler zu reduzieren.

Wie Echtzeit-Benachrichtigungen das Risiko von ISO-27001-Nichtkonformität reduzieren

Echtzeit-Benachrichtigungen erkennen Bedrohungen schnell, senken Kosten durch Verstöße und Audit-Fehlschläge und halten ISO-27001-Protokolle manipulationssicher für eine kontinuierliche Compliance.

KI-Genauigkeit in der Sicherheit: Spezialisierte vs. generische Modelle

Spezialisierte KI übertrifft generische Modelle in der Sicherheits-Compliance – höhere Genauigkeit, weniger Halluzinationen und prüfungsbereite Dokumentation für ISO 27001 und GRC.