title: 10 Brechas Comunes del NIST que la IA Puede Identificar slug: nist-gaps-ai-identification subtitle: La IA automatiza el análisis de brechas del NIST: identifica activos, sesgos, privacidad, deriva de datos y riesgos de proveedores, generando evidencia lista para auditoría. date: 2025-12-25 author: ISMS Copilot Team category: Guides featuredImage: /images/blog/nist-gaps-ai-identification.jpeg featuredImageOriginal: "/images/blog/694caed7b630159ea1be2e7b_694c870912e0ddc125fc35b3-1766632278932.jpeg" metaTitle: "10 Brechas del NIST que la IA Detecta Automáticamente | ISMS Copilot" metaDescription: "Descubre cómo la IA identifica automáticamente brechas de cumplimiento en el Marco de Ciberseguridad del NIST (CSF 2.0), incluyendo gestión de activos, sesgos, privacidad y riesgos de proveedores."

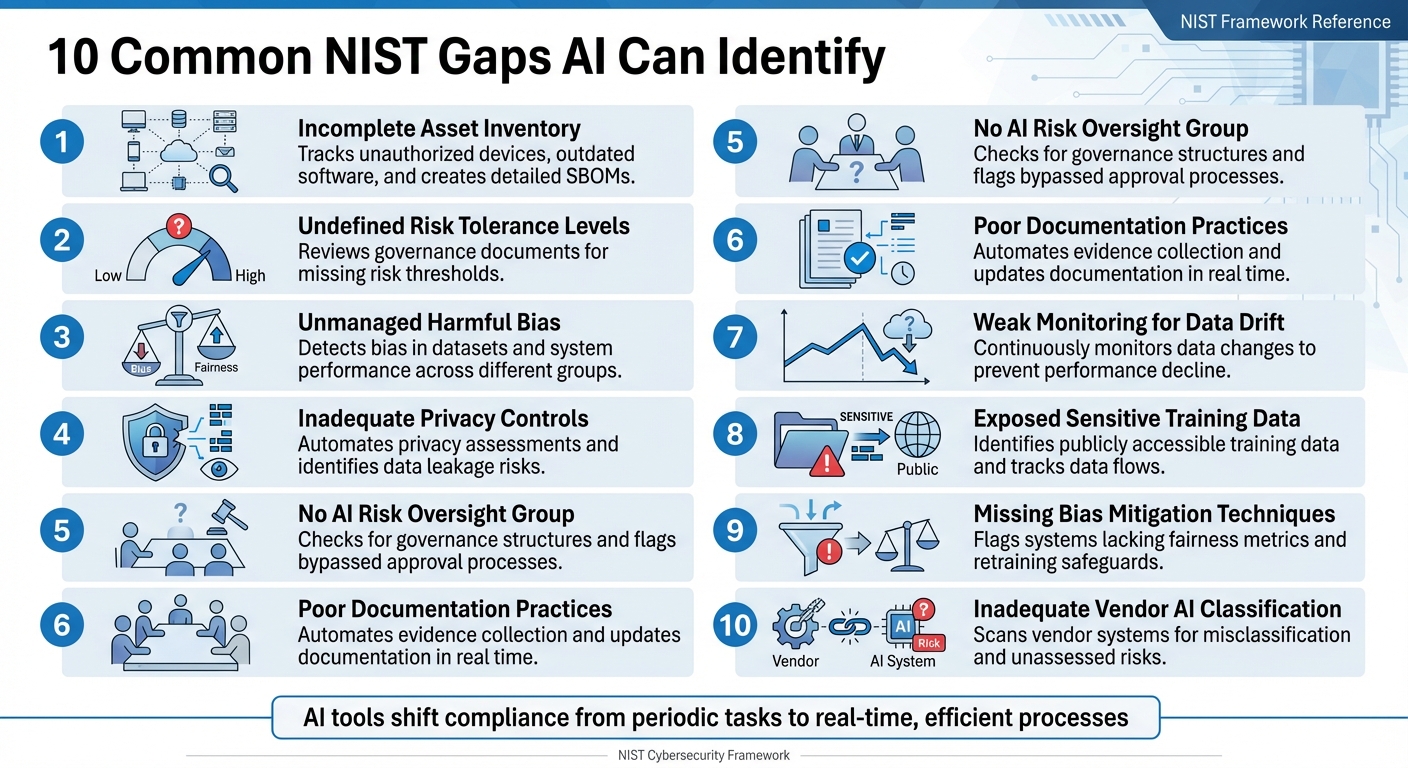

Las organizaciones suelen enfrentar dificultades para lograr el cumplimiento total del Marco de Ciberseguridad del NIST (CSF), especialmente con su versión más reciente, CSF 2.0. Las auditorías manuales son lentas y propensas a errores, dejando brechas en áreas como el seguimiento de activos, la gestión de riesgos y los controles de privacidad. Las herramientas impulsadas por IA cambian las reglas del juego al automatizar las verificaciones de cumplimiento, proporcionar monitoreo continuo e identificar brechas en tiempo real. Estas son 10 brechas comunes de cumplimiento del NIST que la IA puede abordar:

- Inventario de activos incompleto: La IA rastrea dispositivos no autorizados, software desactualizado y crea listas de materiales de software detalladas (SBOM).

- Niveles de tolerancia al riesgo no definidos: La IA revisa documentos de gobernanza en busca de umbrales de riesgo faltantes.

- Sesgo no gestionado: La IA detecta sesgos en conjuntos de datos y el rendimiento del sistema en diferentes grupos.

- Controles de privacidad inadecuados: La IA automatiza las evaluaciones de privacidad e identifica riesgos como fugas de datos.

- Falta de un grupo de supervisión de riesgos de IA: La IA verifica estructuras de gobernanza y señala procesos de aprobación eludidos.

- Prácticas deficientes de documentación: La IA automatiza la recolección de evidencia y actualiza la documentación en tiempo real.

- Monitoreo débil para la deriva de datos: Las herramientas de IA monitorean continuamente los cambios en los datos para evitar la disminución del rendimiento.

- Datos de entrenamiento sensibles expuestos: La IA identifica riesgos como datos de entrenamiento accesibles públicamente y rastrea flujos de datos.

- Falta de técnicas de mitigación de sesgos: La IA señala sistemas que carecen de métricas de equidad y salvaguardas de reentrenamiento.

- Clasificación inadecuada de IA de proveedores: La IA escanea sistemas de proveedores en busca de mala clasificación y riesgos no evaluados.

Herramientas de IA como ISMS Copilot simplifican el cumplimiento al automatizar el análisis de brechas, alinear controles con los estándares del NIST y generar documentación lista para auditoría. Esto transforma el cumplimiento de una tarea periódica a un proceso eficiente en tiempo real.

10 Brechas Comunes del NIST que la IA Puede Identificar y Abordar

Análisis de GRC - Brechas 101 usando cumplimiento con NIST RMF y Controles CIS

1. Inventario de activos incompleto

Tener un inventario de activos exhaustivo es crucial para cumplir con los requisitos de cumplimiento del NIST. Sin embargo, muchas organizaciones luchan por mantener un registro de cada dispositivo, aplicación y componente de software que utilizan. Cuando los activos no se rastrean, crean vulnerabilidades que los atacantes pueden explotar.

Un NIST 800-53 Copilot puede ayudar al comparar el estado real de tu red con el estado deseado. El escaneo continuo destaca cualquier desviación de tu lista de activos aprobada, facilitando la identificación de problemas como dispositivos no autorizados o software desactualizado que carecen de parches de seguridad críticos. Este proceso continuo no solo fortalece la gestión de riesgos, sino que también proporciona información valiosa sobre la seguridad de tu red.

"El enfoque de la capacidad SWAM es gestionar el riesgo creado por software no gestionado o no autorizado en una red. El software no gestionado o no autorizado es un objetivo que los atacantes pueden utilizar como plataforma desde la cual atacar componentes en la red". – NIST IR 8011 Vol. 3

Más allá del escaneo, los paneles de CDM ofrecen visibilidad en tiempo real de tu inventario de activos, alejándose de auditorías estáticas y obsoletas hacia un monitoreo continuo. Los sistemas de IA también pueden crear automáticamente una lista detallada de materiales de software (SBOM) para cada compilación de software, catalogando cada componente y dependencia, ya sea directa o indirecta. Esta funcionalidad es cada vez más importante ya que casi 220,000 organizaciones estadounidenses deben cumplir con los estándares CMMC, de las cuales 80,000 están sujetas a controles de Nivel 2 que se alinean con NIST SP 800-171.

Para mejorar tu inventario de activos, considera usar etiquetas SWID (Software Identification) para automatizar el descubrimiento de software en tu red. También puedes implementar listas blancas automatizadas para garantizar que solo el software autorizado pueda ejecutarse. Para los sistemas de IA, es esencial inventariar no solo el hardware, sino también las integraciones de terceros de las que dependen, ya que estos componentes externos pueden introducir riesgos adicionales.

2. Niveles de tolerancia al riesgo no definidos

Muchas organizaciones reconocen los riesgos asociados con la IA, pero a menudo no establecen umbrales claros sobre lo que es aceptable. Sin estos límites definidos, los equipos pueden encontrar dificultades para determinar cuándo avanzar o pausar un proyecto. Aquí es donde entran en juego las herramientas de IA. Utilizando procesamiento de lenguaje natural, los asistentes de ISMS de múltiples marcos pueden revisar políticas, estrategias de gestión de riesgos y marcos de gobernanza para confirmar si se han establecido criterios específicos, como límites cuantitativos o límites cualitativos, para diferentes aplicaciones de IA. Por ejemplo, los sistemas que manejan datos sensibles, como información de identificación personal (PII), requieren umbrales más estrictos para garantizar la seguridad y el cumplimiento. Cuando faltan estas salvaguardas, se vuelve necesaria una acción correctiva inmediata, como enfatiza el NIST.

"En la medida en que los desafíos para especificar tolerancias de riesgo de IA sigan sin resolverse, puede haber contextos en los que un marco de gestión de riesgos no sea fácilmente aplicable para mitigar riesgos negativos de IA". - NIST AI RMF 1.0

El NIST define la tolerancia al riesgo como "la disposición de la organización o del actor de IA para asumir el riesgo para lograr sus objetivos". Las herramientas de IA desempeñan un papel crucial al escanear documentos de gobernanza para verificar si existen criterios de aceptación de riesgos claramente documentados, ya sean límites numéricos o límites cualitativos más amplios. Sin embargo, el Marco de Gestión de Riesgos de IA del NIST, introducido el 26 de enero de 2023, no exige niveles específicos de tolerancia. En su lugar, destaca la importancia de identificar brechas, como la falta de documentación sobre riesgos residuales o estrategias de gestión de riesgos vagas, que podrían dejar a las organizaciones expuestas.

El NIST ofrece una directiva clara para estos escenarios:

"En casos en los que un sistema de IA presenta niveles inaceptables de riesgo negativo... el desarrollo y despliegue deben detenerse de manera segura hasta que los riesgos puedan gestionarse adecuadamente". - NIST AI RMF 1.0

3. Sesgo dañino no gestionado

El sesgo en los sistemas de IA surge de la interacción del código, los datos de entrenamiento y el contexto social más amplio. Sin políticas adecuadas de cumplimiento, estos sistemas pueden agravar injusticias existentes o incluso crear nuevos patrones de discriminación. Esto tiene consecuencias en el mundo real en áreas como la atención médica, la contratación y las finanzas. El problema se agrava por la complejidad de los sistemas de IA, que a menudo involucran innumerables puntos de decisión, lo que hace casi imposible identificar y abordar los sesgos manualmente. Las organizaciones suelen recurrir a un asistente de cumplimiento de IA para gestionar estos flujos de trabajo complejos y multietapa.

"Sin controles adecuados, los sistemas de IA pueden amplificar, perpetuar o exacerbar resultados inequitativos o indeseables para individuos y comunidades". - NIST AI RMF 1.0

Las herramientas de IA abordan el sesgo dañino a través de procesos como Pruebas, Evaluación, Verificación y Validación (TEVV), como se describe en la función MEDIR del Marco de Gestión de Riesgos de IA del NIST. Estos procesos evalúan si los conjuntos de datos de entrenamiento se alinean con su propósito previsto y reflejan las condiciones sociales actuales. El monitoreo automatizado desempeña un papel clave aquí, identificando la "deriva de datos", que se refiere a cambios en los datos de entrada que pueden afectar el rendimiento del sistema e introducir nuevos sesgos que pueden no haber estado presentes durante las pruebas iniciales.

Este proceso de detección va más allá de analizar números. Las herramientas de IA evalúan cómo los sistemas se desempeñan en varios subgrupos, reconociendo que incluso las personas que no usan directamente el sistema pueden verse afectadas. Este enfoque, a menudo llamado evaluación socio-técnica, considera no solo el diseño técnico, sino también cómo interactúa con las normas sociales y el comportamiento humano para producir inequidades. Para garantizar la objetividad, el NIST aboga por una clara división de responsabilidades: los equipos que construyen los modelos de IA deben estar separados de quienes los verifican y validan. Esta configuración permite evaluaciones más imparciales y un monitoreo continuo del sesgo en todos los grupos de usuarios.

Otra estrategia clave para gestionar el sesgo es el seguimiento mejorado de datos. Por ejemplo, las organizaciones que utilizan herramientas de visibilidad nativas de IA reportaron un aumento del 1,660% en su capacidad para monitorear actividades de procesamiento de datos en solo tres semanas después de su implementación. Estas herramientas mapean "viajes de datos", rastreando cómo fluye la información desde su origen a través de los modelos de IA. Al hacerlo, pueden predecir y prevenir violaciones potenciales en tiempo real. Esto es crucial ya que los sistemas de IA procesan datos a velocidades muy superiores a las que los equipos manuales pueden manejar. Rastrear estos flujos de datos es esencial para detectar cambios que podrían llevar a nuevos sesgos o empeorar los existentes antes de que causen daño.

4. Controles de privacidad inadecuados

El ritmo y la escala de los sistemas de IA hacen que las brechas de privacidad sean una preocupación significativa, especialmente porque la supervisión manual lucha por mantenerse al día. Sin salvaguardas adecuadas de privacidad, las organizaciones corren el riesgo de exponer información de identificación personal (PII) a través de fugas en datos de entrenamiento, accesos no autorizados o divulgaciones no intencionales en las salidas del modelo. La dependencia de APIs para la ingestión de datos y la inferencia aumenta aún más la superficie de ataque, lo que hace que los controles robustos de privacidad sean una necesidad.

Para abordar estos desafíos, las herramientas de IA, incluyendo asistentes de cumplimiento especializados, ahora automatizan las evaluaciones de controles de privacidad utilizando formatos legibles por máquina como OSCAL. Estas herramientas evalúan continuamente los controles descritos en marcos como NIST SP 800-53, utilizando formatos como JSON, XML e YAML. Cabe destacar que, el 27 de agosto de 2025, el NIST lanzó la versión 5.2.0 de SP 800-53, que integró completamente los controles de privacidad en el catálogo de controles de seguridad más amplio, alejándose del enfoque anterior de un catálogo independiente.

"Abordar la funcionalidad y la garantía ayuda a garantizar que los productos de tecnología de la información y los sistemas que dependen de esos productos sean lo suficientemente confiables". - Fuerza de Tarea Conjunta, NIST SP 800-53 Rev. 5

Las herramientas automatizadas se centran en la familia de controles de Procesamiento y Transparencia de PII (PT) para identificar el uso no autorizado de PII, riesgos de divulgación o desanonimización. También descubren APIs y IA en la sombra que las auditorías manuales suelen pasar por alto. Al implementar "Política como Código", las organizaciones pueden convertir los requisitos complejos de NIST SP 800-53 en reglas operativas en tiempo real. Este proceso se simplifica cuando las organizaciones entrenan a sus asistentes de cumplimiento de IA en modelos de alta precisión diseñados para GRC. Estas reglas redactan automáticamente datos sensibles de los prompts y salidas de IA antes de que sean procesados por el modelo.

Además, el software Dioptra del NIST respalda ejercicios de red teaming, ayudando a las organizaciones a probar controles de privacidad y seguridad bajo condiciones adversarias. Estas simulaciones pueden medir las pérdidas de rendimiento e identificar vulnerabilidades específicas. Esto es especialmente importante dado que el Perfil de IA Generativa del Marco de Gestión de Riesgos de IA del NIST describe 12 riesgos únicos o elevados asociados con la IA, incluyendo preocupaciones de privacidad de datos como fugas y desanonimización no autorizada. El 14 de abril de 2025, el NIST enfatizó aún más estos problemas al publicar el borrador del Marco de Privacidad 1.1, que aborda específicamente los riesgos de privacidad relacionados con la IA, como los ataques de inferencia y la amplificación del sesgo.

5. Falta de un grupo de supervisión de riesgos de IA

Un desafío importante en la gestión de riesgos de IA es la ausencia de un grupo de supervisión dedicado. Sin dicho comité, la gobernanza y la rendición de cuentas a menudo se descuidan, lo que lleva a esfuerzos fragmentados y de baja prioridad. Hoy en día, herramientas avanzadas que aprovechan el Procesamiento de Lenguaje Natural (NLP) pueden ayudar a abordar esta brecha al analizar políticas organizacionales, estatutos y actas de reuniones. Estas herramientas pueden confirmar si existe un grupo formal de supervisión de riesgos de IA y garantizar la alineación con la función "Gobernar" del Marco de Gestión de Riesgos de IA del NIST, específicamente Gobernar 1.2, que enfatiza la necesidad de estructuras claras de gobernanza y rendición de cuentas.

Los sistemas impulsados por IA también examinan organigramas y sistemas de gestión de identidades para identificar roles formales de supervisión dentro de la gestión de riesgos de IA. Las plataformas de gobernanza añaden otra capa de protección al señalar proyectos que eluden los procesos formales de aprobación. Esto garantiza una supervisión continua, un componente crítico para adherirse al Marco de Gestión de Riesgos del NIST. La función "Gobernar" actúa como una base, influyendo en todas las demás funciones del RMF, como Mapear, Medir y Gestionar. Este enfoque interconectado fortalece el marco general.

"Sin una rendición de cuentas definida, los esfuerzos de gestión de riesgos de IA pueden volverse fragmentados o desatendidos, dejando a la organización expuesta". - Kezia Farnham, Gerente Senior, Diligent

La urgencia de una supervisión adecuada está subrayada por el rápido crecimiento en la inversión y regulación de IA. En 2024, la inversión del sector privado estadounidense en IA superó los 100 mil millones de dólares, mientras que las menciones de IA en la legislación global aumentaron un 21.3% en 75 países desde 2023, un aumento asombroso de nueve veces desde 2016. Sin mecanismos formales de supervisión, las organizaciones corren el riesgo de incumplir regulaciones emergentes, como el Reglamento de IA de la UE y la Orden Ejecutiva 14110 de EE.UU., que enfatizan la importancia de la supervisión humana y la gestión de riesgos auditable.

Para cerrar esta brecha, las organizaciones deben formar un comité de riesgos de IA multifuncional que incluya líderes clave como el Asesor Jurídico General, el Director de Seguridad de la Información (CISO), el Director de Riesgos y líderes de IA/ML. Asignar la responsabilidad del Marco de Gestión de Riesgos de IA a un ejecutivo único, a menudo el Jefe de Riesgos o Legal, puede centralizar aún más la rendición de cuentas. Además, adoptar un asistente de cumplimiento de IA diseñado específicamente puede agilizar este proceso, automatizando el mapeo de roles y responsabilidades y reemplazando hojas de cálculo manuales obsoletas con sistemas de monitoreo continuo.

6. Prácticas deficientes de documentación

Basándose en problemas anteriores con el seguimiento de activos y la supervisión, la documentación deficiente socava aún más los esfuerzos de cumplimiento. Las brechas en la documentación son generalizadas y costosas cuando se trata de cumplimiento del NIST. Un 86% de las organizaciones carecen de visibilidad sobre sus flujos de datos de IA, lo que lleva a brechas significativas de documentación y auditoría que pueden causar problemas durante las revisiones regulatorias. Por ejemplo, cuando los auditores solicitan registros de interacciones de IA que involucran datos personales, muchas organizaciones no pueden proporcionarlos. Esta falla viola regulaciones clave como el RGPD Artículo 30, la CCPA Sección 1798.130 y la HIPAA § 164.312.

Plataformas de cumplimiento impulsadas por IA ofrecen una solución práctica al reemplazar hojas de cálculo manuales obsoletas con paneles en tiempo real. Estos paneles señalan automáticamente la evidencia faltante y los problemas de documentación. También utilizan monitoreo continuo de controles para detectar "derivas", es decir, instancias en las que la documentación o políticas actuales ya no coinciden con el estado real de los sistemas o la infraestructura. Las herramientas automatizadas capturan configuraciones y registros en tiempo real, creando registros de auditoría completos.

"Tratar cada cambio, implementación e incidente como un evento de documentación garantiza una acumulación constante de evidencia que es mucho más confiable que un esfuerzo posterior al incidente apresurado". - Abnormal AI

El principio de "documentar sobre la marcha" fortalece el cumplimiento al capturar evidencia en tiempo real. Al integrarse con herramientas como wikis controlados por versiones y sistemas de tickets, la IA garantiza que las aprobaciones y capturas de pantalla se adjunten a las solicitudes de extracción. Esto es especialmente crítico dado que solo el 17% de las organizaciones han implementado controles de seguridad automatizados de IA capaces de proporcionar los registros requeridos para auditorías regulatorias.

Las organizaciones que aprovechan las plataformas de cumplimiento automatizadas ven beneficios importantes, incluyendo la reducción de los ciclos de revisión de semanas a solo horas y la disminución significativa de la carga de trabajo de cumplimiento. Estas herramientas también mapean el "Perfil Actual" de una organización frente a un "Perfil Objetivo" del NIST, identificando brechas en salvaguardas y documentación. Al automatizar el proceso "Identificar-Evaluar-Categorizar", ayudan a garantizar que los inventarios de activos y las clasificaciones de riesgos se mantengan actualizados. Este enfoque continuo de documentación desempeña un papel clave en el mantenimiento del cumplimiento del NIST.

sbb-itb-4566332

7. Monitoreo débil para la deriva de datos

La deriva de datos ocurre cuando los datos con los que un sistema de IA fue entrenado cambian con el tiempo, lo que lleva a una disminución en el rendimiento y la confiabilidad. Con más del 75% de las organizaciones utilizando IA en al menos una función empresarial, no monitorear estos cambios crea un serio riesgo de cumplimiento, uno que las herramientas impulsadas por IA están bien equipadas para abordar. Abordar este problema requiere soluciones de monitoreo más avanzadas, como se describe a continuación.

En la práctica, la IA a menudo funciona como una "caja negra", lo que dificulta detectar cuándo algo sale mal. El 45% de las organizaciones citan preocupaciones sobre la precisión de los datos o el sesgo como un obstáculo importante para adoptar la IA. Sin embargo, muchas aún carecen de herramientas para el monitoreo continuo, dejándolas vulnerables a la deriva de datos. A diferencia de las verificaciones manuales, el monitoreo continuo permite análisis en tiempo real, detectando problemas antes de que escalen.

"Los sistemas de IA... pueden estar entrenados con datos que pueden cambiar con el tiempo, a veces de manera significativa e inesperada, afectando la funcionalidad y confiabilidad del sistema de maneras difíciles de entender".

Para abordar la deriva de datos, herramientas avanzadas de Gestión de Postura de Seguridad de IA (AI-SPM) pueden detectar automáticamente modelos de IA desplegados, identificar "IA en la sombra" y mapear conjuntos de datos tanto de entrenamiento como de inferencia, incluyendo almacenes de documentos y bases de datos vectoriales. Estas herramientas también señalan configuraciones incorrectas, como datos de entrenamiento accesibles públicamente, que podrían representar riesgos de seguridad.

Por ejemplo, Net Solutions trabajó recientemente con una empresa de limpieza comercial de América del Norte para implementar gobernanza de IA para un asistente de chat de ventas. Al utilizar herramientas de monitoreo en tiempo real como AWS CloudWatch y DataDog, junto con tuberías automatizadas integradas con alertas de Zoho Desk, la empresa pasó de una prueba de concepto a una solución de IA escalable y conforme en solo seis semanas.

El tecnólogo Akash Lomas de Net Solutions enfatiza la importancia del monitoreo:

"La medición se vuelve especialmente crítica en entornos donde la IA moldea directamente las experiencias del cliente... sin supervisión continua, estos sistemas pueden desviarse, sirviendo contenido irrelevante, sesgado o engañoso".

Ignorar la deriva de datos puede tener consecuencias graves: reducción del rendimiento del sistema, multas regulatorias y pérdida de confianza. Además, los ciberataques cuestan a las empresas un promedio de 4.45 millones de dólares anuales.

8. Datos de entrenamiento sensibles expuestos

El riesgo de exponer datos de entrenamiento sensibles es una preocupación seria, especialmente en lo que respecta a violaciones de cumplimiento. Según el NIST, la IA Generativa introduce 12 riesgos distintos, siendo los problemas de privacidad de datos, como fugas y divulgaciones no autorizadas de información personal, un enfoque principal. Muchas organizaciones enfrentan desafíos para mantener un registro de dónde residen sus datos de entrenamiento de IA y garantizar su seguridad.

Para abordar esto, las herramientas de Gestión de Postura de Seguridad de IA (AI-SPM) se han vuelto esenciales. Estas herramientas pueden identificar automáticamente modelos de IA desplegados y localizar los conjuntos de datos utilizados para el entrenamiento en plataformas en la nube, incluyendo almacenamiento de documentos y bases de datos vectoriales. También señalan vulnerabilidades, como datos de entrenamiento accesibles públicamente o puntos finales de aplicaciones abiertos. Mahesh Nawale, Gerente de Marketing de Producto en Zscaler, enfatiza la importancia de estas herramientas:

"Zscaler AI-SPM localiza automáticamente los conjuntos de datos utilizados en el entrenamiento e inferencia de IA en tu entorno en la nube, incluyendo datos, almacenes de documentos y bases de datos vectoriales. Señala configuraciones incorrectas como datos de entrenamiento accesibles públicamente, dando a tus equipos de seguridad la información necesaria para investigar, remediar y demostrar el cumplimiento".

Las herramientas de IA van más allá de simplemente identificar configuraciones incorrectas. También monitorean el comportamiento del modelo para detectar amenazas potenciales. Por ejemplo, pueden detectar problemas como la memorización de datos, la inversión de modelos o actividades sospechosas como grandes descargas de datos o cambios no autorizados, que podrían indicar exfiltración de datos. Las capacidades de escaneo automatizado fortalecen aún más la seguridad al identificar información sensible, como datos biométricos, de salud o de ubicación, que no han sido debidamente anonimizados.

El NIST también ha desarrollado "Dioptra", una solución de software que ayuda a las organizaciones a probar modelos de IA contra ciberataques. Mide cómo los ataques impactan el rendimiento del modelo e identifica escenarios en los que los datos de entrenamiento podrían estar en riesgo.

Katerina Megas, Gerente de Programa en el NIST, destaca el creciente desafío:

"La IA crea nuevos riesgos de reidentificación, no solo por su poder analítico en conjuntos de datos dispares, sino también por posibles fugas de datos del entrenamiento del modelo".

Con los enormes conjuntos de datos utilizados en el entrenamiento de modelos de lenguaje grandes, las pruebas automatizadas continuas ya no son opcionales, son una necesidad para proteger la información sensible.

9. Falta de técnicas de mitigación de sesgos

Cuando los sistemas de IA carecen de métodos adecuados para abordar el sesgo, corren el riesgo de amplificar resultados injustos y crear problemas significativos de cumplimiento. Según el NIST, gestionar el sesgo dañino es una de las siete características críticas de un sistema de IA confiable. Los marcos tradicionales de gestión de riesgos no logran abordar el sesgo de la IA, lo que hace que las estrategias especializadas de mitigación sean esenciales. Si bien las secciones anteriores cubrieron la detección de sesgos, abordarlo de manera efectiva requiere controles claros y esfuerzos continuos de reentrenamiento. Identificar el sesgo no es suficiente: se necesitan estrategias a largo plazo para contrarrestarlo.

Las herramientas de IA desempeñan un papel clave en la identificación de brechas en los controles de sesgo. Señalan problemas como la falta de métricas de equidad (por ejemplo, ratios de impacto dispar o diferencias en las tasas de falsos positivos), sistemas que carecen de pruebas adversarias o red teaming de IA, y modelos sin reentrenamiento programado, lo que los deja vulnerables a la deriva de datos.

"Sin controles adecuados, los sistemas de IA pueden amplificar, perpetuar o exacerbar resultados inequitativos o indeseables para individuos y comunidades". – NIST AI RMF 1.0

Para abordar estos desafíos, las plataformas de gobernanza de IA realizan escaneos automatizados para descubrir brechas de cumplimiento basadas en las pautas del Marco de Gestión de Riesgos de IA del NIST. Garantizan que las organizaciones hayan implementado las salvaguardas necesarias, como filtros de contenido, protocolos de corrección de sesgos y otras medidas de protección exigidas por estándares como NIST AI 600-1. Estas plataformas también rastrean el linaje de los datos para confirmar que los conjuntos de datos de entrenamiento están libres de problemas que podrían llevar a resultados sesgados. Además, las herramientas de Gestión de Postura de Seguridad de IA (AI-SPM) identifican todos los modelos de IA desplegados, incluyendo sistemas de "IA en la sombra" que pueden haber eludido las pruebas de equidad por completo.

Con los sistemas de IA tomando miles de millones de decisiones, los sesgos no detectados pueden erosionar la confianza pública, infringir libertades civiles y desencadenar sanciones regulatorias. Cabe destacar que ha habido un aumento global del 21.3% en las menciones de legislación sobre IA desde 2023. Estos riesgos destacan la necesidad urgente de una supervisión continua y automatizada para garantizar la equidad y la rendición de cuentas.

10. Clasificación inadecuada de IA de proveedores

Cuando las organizaciones no clasifican adecuadamente los sistemas de IA de terceros, se exponen a riesgos de cumplimiento que podrían no detectar. El problema es que las métricas de riesgo de los proveedores a menudo no se alinean con los marcos de riesgo internos de una empresa. Si los proveedores están mal clasificados, es imposible aplicar los controles correctos o determinar si su etiqueta de "bajo riesgo" realmente se ajusta a la tolerancia al riesgo de tu organización. Esta discrepancia destaca la necesidad de herramientas automatizadas que puedan verificar las clasificaciones de los proveedores en tiempo real.

Las herramientas impulsadas por IA intervienen aquí, automatizando el proceso de identificación de brechas en la clasificación. Al escanear contratos y especificaciones técnicas de los proveedores, estas herramientas identifican sistemas mal clasificados y señalan componentes de IA de terceros no evaluados, como se describe en las funciones Gobernar 6.1 y Mapear 4.1 del Marco de Gestión de Riesgos de IA del NIST. También detectan sistemas que carecen de transparencia sobre elementos críticos como modelos preentrenados, tuberías de datos o procesos de desarrollo.

"El riesgo puede surgir tanto del software, hardware o datos de terceros en sí como de cómo se utilizan". – NIST AI RMF 1.0

El Perfil del Marco de Ciberseguridad del NIST para IA, desarrollado con aportes de más de 6,500 contribuyentes, enfatiza la importancia de la visibilidad en la cadena de suministro. Las herramientas impulsadas por IA ayudan al mantener inventarios en tiempo real de sistemas de terceros, mapeando la cadena de suministro de IA para descubrir componentes no clasificados o no evaluados. Estas herramientas exponen vulnerabilidades ocultas en el software, hardware o fuentes de datos que podrían volverse evidentes solo durante el despliegue. Con la clasificación automatizada de proveedores, las organizaciones pueden obtener una visión integral de su panorama de riesgos de IA, alineada con las pautas del NIST.

Otro beneficio de la automatización es su capacidad para priorizar las evaluaciones de proveedores en función de la sensibilidad de los datos. Por ejemplo, los sistemas que manejan información de identificación personal o interactúan directamente con los usuarios se marcan para un escrutinio más cercano. Este enfoque reconoce que un sistema considerado de bajo riesgo en un contexto, como procesar datos de sensores físicos, podría representar un alto riesgo en otro, como gestionar información de salud protegida. Sin esta supervisión automatizada, las empresas corren el riesgo de desperdiciar recursos en sistemas de bajo riesgo mientras dejan herramientas de IA de alto riesgo sin monitorear.

Cómo ISMS Copilot Identifica Estas Brechas

ISMS Copilot adopta un enfoque específico para cada marco para identificar brechas en el cumplimiento de NIST 800-53. En lugar de buscar respuestas en internet, utiliza Generación Aumentada por Recuperación (RAG) para extraer información específica de un conjunto de datos cuidadosamente seleccionado. Este conjunto de datos incluye más de 20 marcos como NIST 800-53, ISO 27001, SOC 2 y RGPD, proporcionando orientación precisa y accionable para abordar las brechas de cumplimiento. La herramienta simplifica el análisis de brechas al mapear controles en múltiples estándares, creando documentación lista para auditores y desglosando informes extensos. Con ISMS Copilot One, los usuarios pueden subir documentos de cumplimiento, incluso aquellos que superan las 20 páginas, para un análisis automatizado. Actualmente, más de 1,000 organizaciones confían en esta herramienta para sus necesidades de cumplimiento de seguridad de la información. Aquí tienes una comparación rápida de las características especializadas de ISMS Copilot frente a herramientas de IA de propósito general:

| Característica | ISMS Copilot | IA de Propósito General |

|---|---|---|

| **Con |

Artículos relacionados

El programa de afiliados de ISMS Copilot — gana un 20 % recurrente

Un programa de afiliación enfocado en cumplimiento para consultores, CISOs fraccionales y creadores que recomiendan ISMS Copilot

Cómo el ISMS impulsa el éxito en la certificación ISO 27001