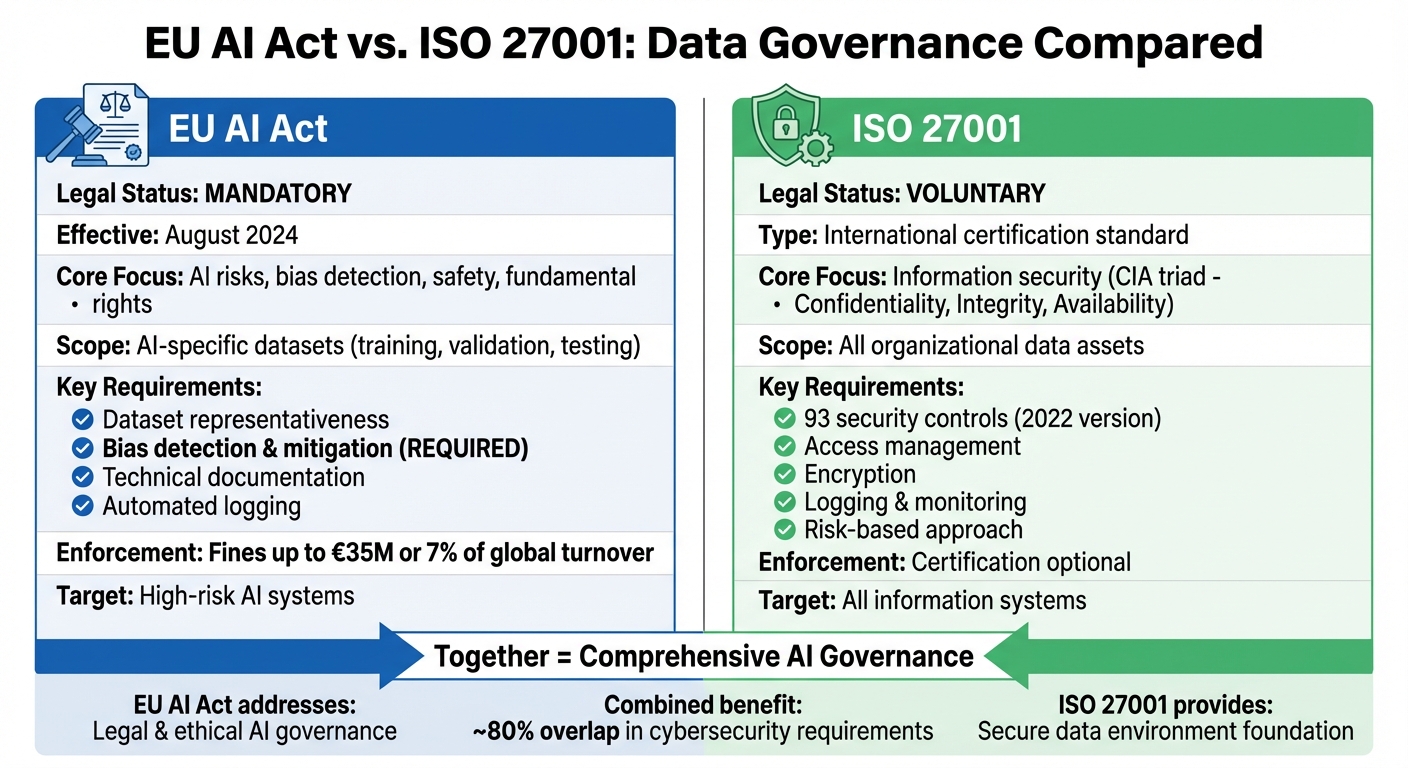

EU AI Act vs. ISO 27001: Vergelijking van datagovernance

Combineer de regels van de EU AI Act over bias, transparantie en datakwaliteit met ISO 27001’s ISMS om geïntegreerde, controleerbare AI-datagovernance op te bouwen.

De EU AI Act en ISO 27001 benaderen datagovernance verschillend, maar kunnen samenwerken om AI-systemen effectief te beheren.

- EU AI Act: Een verplichte regelgeving (van kracht sinds augustus 2024) die zich richt op risico’s van AI-systemen, biasdetectie en datakwaliteit. Verplichtingen zoals representativiteit van datasets en biasmitigatie worden afgedwongen, met name voor hoogrisico AI-systemen.

- ISO 27001: Een vrijwillige internationale standaard die databeveiliging waarborgt via een Informatiebeveiligingsmanagementsysteem (ISMS). Het benadrukt vertrouwelijkheid, integriteit en beschikbaarheid van alle gegevens, niet alleen AI-specifieke data.

Belangrijkste verschil: De EU AI Act richt zich op wettelijke en ethische AI-governance, terwijl ISO 27001 zich richt op het beveiligen van datomgevingen. Samen bieden ze een gestructureerde aanpak voor compliance en beveiliging van AI-systemen.

Snelle vergelijking:

| Kenmerk | EU AI Act | ISO 27001 |

|---|---|---|

| Juridische status | Verplicht | Vrijwillig |

| Focus | AI-risico’s, bias, veiligheid | Databeveiliging (CIA) |

| Scope | AI-specifieke datasets | Alle organisatiedata |

| Biasmitigatie | Verplicht | Niet behandeld |

| Handhaving | Boetes tot €35M of 7% | Certificering optioneel |

EU AI Act vs ISO 27001: Belangrijkste verschillen in datagovernance

De EU AI Act uitgelegd: Navigeren door compliance in 2025 - Data Leaders Unscripted

EU AI Act: Datagovernance voor hoogrisico AI-systemen

De EU AI Act neemt een op maat gemaakte aanpak voor het reguleren van AI-systemen, met strengere regels voor hoogrisico-toepassingen. Artikel 10, dat vanaf 2 augustus 2026 handhaafbaar wordt, beschrijft specifieke verplichtingen voor deze systemen, en niet-naleving gaat gepaard met sancties.

Eisen voor hoogrisico AI-systemen

Volgens Artikel 10 moeten datasets die worden gebruikt voor training, validatie en testen aan strenge normen voldoen. Ze moeten relevant, representatief, zo foutloos mogelijk en compleet zijn voor het beoogde doel. Deze datasets moeten de populaties en omgevingen waar het AI-systeem zal functioneren nauwkeurig weerspiegelen, zodat alle toepasselijke contexten worden meegenomen.

Het aanpakken van bias is een cruciale vereiste. Aanbieders moeten datasets evalueren op biases die de gezondheid, veiligheid of fundamentele rechten kunnen aantasten. Er moeten maatregelen zijn om deze biases te detecteren, voorkomen en te mitigeren. Dit is vooral belangrijk in gevallen waarin AI-outputs toekomstige inputs kunnen beïnvloeden, waardoor feedbacklussen kunnen ontstaan die discriminerende patronen versterken. Om risico’s te minimaliseren, moeten organisaties maatregelen zoals pseudonimisering toepassen en ervoor zorgen dat data wordt verwijderd na correcties.

Documentatie is een ander belangrijk aandachtspunt. Aanbieders moeten de levenscyclus van hun data nauwkeurig bijhouden, van ontwerpbeslissingen en databronnen tot processen zoals labeling, opschoning en verrijking. Ze moeten datagaten identificeren, aannames documenteren en de geschiktheid van de dataset voor het beoogde gebruik bevestigen. Voor systemen die geen modeltraining omvatten, gelden deze normen alleen voor testdatasets.

Governancekaders en handhaving

Om compliance met deze datagovernance-regels te waarborgen, stelt de EU AI Act formele handhavingsmechanismen in. In tegenstelling tot vrijwillige richtlijnen legt de wet bindende verplichtingen op aan elke organisatie die hoogrisico AI-systemen op de EU-markt introduceert. Toezicht wordt zowel op Unieniveau geregeld – door entiteiten zoals het AI-Office en het Europees Comité voor Kunstmatige Intelligentie – als op nationaal niveau, via aangewezen nationale bevoegde autoriteiten. Deze autoriteiten hebben de bevoegdheid om technische documentatie op te vragen, systemen te evalueren en corrigerende maatregelen af te dwingen bij niet-naleving.

Organisaties moeten gestructureerde governancekaders implementeren die alle fasen van hun datapijplijnen bestrijken. Dit omvat gestandaardiseerde protocollen voor datavoorbereiding, regelmatige biasaudits en post-market monitoringplannen om de systeemprestaties na implementatie te beoordelen. Bepaalde praktijken, zoals niet-gerichte scraping van gezichtsbeelden van het internet om gezichtsherkenningsdatabases op te bouwen, zijn expliciet verboden onder de wet. Met handhavingsdeadlines in zicht kan het behandelen van Artikel 10 als een simpele checklist tot ernstige gevolgen leiden.

ISO 27001: Datagovernance en beveiligingscontroles

ISO 27001 speelt een sleutelrol naast de EU AI Act door zich te richten op databescherming. De basis ligt in de CIA-drie-eenheid: vertrouwelijkheid (zorgen dat alleen geautoriseerde gebruikers toegang hebben tot data), integriteit (het waarborgen van de nauwkeurigheid en volledigheid van data) en beschikbaarheid (data beschikbaar stellen wanneer nodig). Dit technologie-neutrale kader is universeel toepasbaar, of je nu klantgegevens, financiële data of datasets voor AI-training beveiligt. Door zich te richten op robuuste databeveiligingspraktijken, biedt ISO 27001 een solide basis voor het beheren van AI-specifieke datastromen.

Kernvereisten voor datagovernance

De update van 2022 van ISO 27001 organiseert haar 93 beveiligingscontroles in vier hoofdcategorieën: Organisatorisch, Menselijk, Fysiek en Technologisch. Deze controles bestrijken kritieke gebieden zoals toegang, encryptie, monitoring en risico’s van derden. Enkele belangrijke hoogtepunten zijn:

- Toegangsbeheer (Annex A.9): Zorgt ervoor dat alleen geautoriseerde personen data kunnen bekijken, wijzigen of verwijderen.

- Cryptografie (Annex A.10): Beschermt gevoelige data door middel van encryptie, zowel in rust als tijdens transmissie.

- Logging en monitoring (Annex A.12): Volgt toegang en acties met behulp van audittrails.

- Leveranciersbeveiliging (Annex A.15): Mitigeert risico’s die verband houden met derde partijen die data verwerken.

In tegenstelling tot de EU AI Act, die specifieke regels voorschrijft voor hoogrisico AI-systemen, benadrukt ISO 27001 een risicogebaseerde aanpak. Organisaties identificeren potentiële bedreigingen voor hun data en passen op maat gemaakte controles toe. Een Gartner-onderzoek uit 2024 toonde aan dat bedrijven die automatische complianceplatforms gebruikten hun audits met 39% verkortten. Deze verschuiving naar "levende compliance", zoals Mark Sharron van ISMS.online het beschrijft, richt zich op realtime bewijsverzameling in plaats van statische documentatie. Deze controles verbeteren niet alleen de databeveiliging, maar stroomlijnen ook de integratie ervan in AI-systemen.

Toepasbaarheid op AI-datapijplijnen

Het kader van ISO 27001 is van nature geschikt voor AI-systemen. Haar assetmanagementcontroles (Annex A.8) vereisen dat organisaties hun informatieactiva inventariseren, classificeren op gevoeligheid en juiste verwerkingsprocedures definiëren. In AI-omgevingen omvat dit het catalogiseren van trainingsdatasets, validatiesets en modelgewichten naast traditionele gegevens. Specifieke datavoorbereidingstaken – zoals opschoning, labeling en verrijking – vallen onder "Verwerking van activa" (A.8.2.3). Veilige datatransfers tussen omgevingen worden geleid door controles zoals "Fysieke mediatransfer" (A.8.3.3) en Communicatiebeveiligingsmaatregelen. Ondertussen zorgen Operationele beveiliging (Annex A.12) en Systeemontwikkeling (Annex A.14) controles voor veilige dataverwerking, effectief wijzigingsbeheer en de algehele integriteit van AI-pijplijnen.

Zoals Pansy van Sprinto uitlegt:

"ISO 27001 beschermt het systeem, en ISO 42001 bestuurt de beslissingen".

Dit onderscheid is cruciaal. Terwijl ISO 27001 zich richt op het beveiligen van de datapijplijn, behandelen kaders zoals de EU AI Act bredere zorgen, zoals eerlijkheid en uitlegbaarheid in AI-outputs. Samen vormen ze een complementaire aanpak voor het effectief beheren van AI-systemen.

sbb-itb-4566332

Vergelijking van de EU AI Act en ISO 27001: Datagovernance

In deze sectie duiken we in hoe de EU AI Act en ISO 27001 datagovernance benaderen over de hele levenscyclus van AI, met nadruk op hun verschillen en overlap.

Vergelijking van kenmerken

De EU AI Act en ISO 27001 volgen verschillende paden als het gaat om datagovernance. De EU AI Act is een verplichte regelgeving, waarbij niet-naleving van verboden praktijken kan leiden tot boetes tot wel €35.000.000 of 7% van de wereldwijde jaaromzet. ISO 27001 daarentegen is een vrijwillige certificeringsstandaard die organisaties aannemen om hun toewijding aan beveiliging te tonen.

De EU AI Act prioriteert veiligheid, fundamentele rechten en biaspreventie, met name voor hoogrisico AI-systemen. ISO 27001 richt zich echter op het beschermen van alle informatieactiva via de CIA-drie-eenheid: vertrouwelijkheid, integriteit en beschikbaarheid. Terwijl de EU AI Act het belang benadrukt van foutloze en representatieve trainingsdatasets, is ISO 27001 meer bezorgd over het beveiligen van de algehele datomgeving.

| Kenmerk | EU AI Act (Hoogrisico AI) | ISO 27001 |

|---|---|---|

| Juridische status | Verplicht | Vrijwillig |

| Kernfocus | Veiligheid, fundamentele rechten, bias | Informatiebeveiliging (CIA) |

| Datadekking | Trainings-, validatie- en testsets | Alle informatieactiva |

| Biasvereiste | Verplichte detectie en mitigatie | Niet expliciet behandeld |

| Beveiligingscontroles | Robuustheid van AI en cyberbeveiliging | 93 controles (versie 2022) |

| Documentatie | Technische documentatie & conformiteitsbeoordeling | ISMS-handboek, Verklaring van toepasbaarheid |

De volgende stap is om te zien hoe deze kaders zich verhouden tot de fasen van de AI-datalevenscyclus.

AI-datalevenscyclusfasen

Wanneer ze worden afgebeeld op de AI-datalevenscyclus, worden de verschillen tussen de EU AI Act en ISO 27001 nog duidelijker. Artikel 10 van de EU AI Act vereist bijvoorbeeld duidelijke transparantie over de herkomst en het doel van data tijdens het sourcen. ISO 27001 raakt dit aan via assetinventory en leverancierscontroles. ISO 27001 behandelt echter geen biasmitigatie, waardoor organisaties aparte workflows moeten creëren voor AI-governance.

| Levenscyclusfase | Verplichtingen EU AI Act (Art. 10) | ISO 27001-controles (Annex A) |

|---|---|---|

| Sourcing | Herkomst van data, oorspronkelijke verzameldoel | Assetinventory, Leveranciersrelaties |

| Labeling/Voorbereiding | Annotatie, labeling, opschoning, aggregatie | Informatieclassificatie, Datamasquerading |

| Training/Validatie | Beoordeling van representativiteit, identificatie van datagaten | Veilige ontwikkelomgeving, Wijzigingsbeheer |

| Biasmitigatie | Detectie en correctie van verboden discriminatie | Niet van toepassing (vereist aparte AI-governance) |

| Retentie | Verwijdering van speciale data na biascorrectie | Retentie en vernietiging van informatieactiva |

Overlap en verschillen

Hoewel beide kaders enige gemeenschappelijke grond hebben, dienen ze verschillende doelen. Beide vereisen bijvoorbeeld logging en toegangscontroles, maar hun doelen verschillen. De EU AI Act schrijft "automatisch gegenereerde logs" voor om AI-beslissingen terug te traceren naar hun databronnen (Artikel 12), terwijl ISO 27001 logging gebruikt voor beveiligingsmonitoring en incidentrespons. Organisaties met goed geïmplementeerde ISMS-implementaties voldoen mogelijk al aan tot 80% van de cyberbeveiligingsvereisten van de EU AI Act, wat een voorsprong biedt.

Het belangrijkste onderscheid ligt in datakwaliteit versus databeveiliging. De EU AI Act staat het verwerken van gevoelige persoonsgegevens toe – zoals ras, religie en gezondheid – voor biasdetectie. ISO 27001 past daarentegen meer algemene controles toe om gevoelige data te beschermen. Zoals Gnanendra Reddy, een ISO/IEC 27001 Lead Auditor, treffend uitlegt:

"De EU AI Act is het reglementboek en ISO/IEC 42001 is het besturingssysteem dat compliance herhaalbaar en controleerbaar maakt".

Een geïntegreerd datagovernancemodel opbouwen

De EU AI Act beschrijft het "wat", terwijl ISO 27001 het "hoe" biedt door een solide operationeel kader te vestigen. Samen creëren ze een naadloze basis voor het in kaart brengen van vereisten en het vereenvoudigen van implementatie.

EU AI Act-vereisten koppelen aan ISO 27001-controles

Om een duidelijk en traceerbaar proces te vestigen, kunnen organisaties de vereisten van de EU AI Act koppelen aan ISO 27001-controles. Artikel 10’s mandaat om de herkomst en het verzameldoel van data te documenteren (Artikel 10[2b]) sluit bijvoorbeeld aan bij de Assetmanagementcontroles (A.8) in ISO 27001, die al benadrukken dat informatieactiva geïnventariseerd moeten worden. Evenzo sluiten de vereisten voor datavoorbereiding, labeling en opschoning aan bij Operationele beveiliging (A.12), waardoor dataverwerking en -transformatie goed gereguleerd zijn.

| EU AI Act-vereiste (Art. 10) | Relevante ISO 27001-controledomein | Operationele actie |

|---|---|---|

| Dataverzameling & herkomst (2b) | Assetmanagement (A.8) | Catalogiseer databronnen en documenteer hun doel. |

| Datavoorbereiding/Labeling (2c) | Operationele beveiliging (A.12) | Gebruik gecontroleerde methoden voor annotatie en opschoning. |

| Biasdetectie & -mitigatie (2f, 2g) | Risicobeoordeling (A.12.6 / A.14.2) | Voer technische tests uit en documenteer mitigerende stappen. |

| Technische documentatie (Art. 11) | Documentatie (A.5 / A.18) | Onderhoud versiegecontroleerde modelkaarten en ontwerpdocumenten. |

| Logging & registratie (Art. 12) | Logging en monitoring (A.12.4) | Definieer risicogebaseerde logretentiebeleid en toegangscontroles. |

Door een vereisten-naar-testmatrix te creëren die artikelen uit de EU AI Act koppelt aan controles en bijbehorende tests, wordt compliance een gestructureerd en traceerbaar proces. Bijvoorbeeld, loggingvereisten omvatten doorgaans retentieperiodes van 180 tot 365 dagen, wat beide kaders met elkaar in lijn brengt.

Zodra deze koppelingen zijn vastgesteld, verschuift de focus naar het integreren van deze controles in dagelijkse workflows.

Implementatie van AI-datagovernance

Het combineren van deze kaders transformeert compliance van een checklist naar een samenhangend, operationeel systeem. Door te bouwen op je bestaande ISMS-kader en gebruik te maken van de PDCA-cyclus (Plan-Do-Check-Act), kun je AI-specifieke controles integreren zonder opnieuw te beginnen. Dit kan onder meer inhouden:

- Het uitbreiden van leveranciersmanagementprocessen om leveranciers van AI-trainingsdata te dekken.

- Het implementeren van continue monitoring om modeldrift te detecteren.

- Het plannen van regelmatige reviews om bias te identificeren en aan te pakken.

Het "Drie lijnen van verdediging"-model werkt goed voor AI-governance. In deze opzet beheren operationele teams risico’s tijdens de ontwikkeling (1e lijn), risico- en juridische teams bieden toezicht (2e lijn), en interne audit zorgt voor onafhankelijke controles (3e lijn). Een gecentraliseerde modelinventaris wordt essentieel voor het bijhouden van metadata, zoals datatypes, algoritmes en implementatiecontexten. Dit is vooral cruciaal, aangezien een studie uit 2024 van 624 AI-gebruikscases toonde dat 30% van de modellen door derden was ontwikkeld, waarbij sommige organisaties niet in staat waren om de gebruikte algoritmes te identificeren.

Een andere belangrijke stap is het onderhouden van een uniform conformiteitsdossier. Dit dossier koppelt elke AI-systeemvereiste aan de bijbehorende beleidsdocumenten, tests en monitoringresultaten, zodat compliance-documentatie gecentraliseerd en gemakkelijk toegankelijk is voor regelgevende controles.

Gebruik van ISMS Copilot voor geïntegreerde compliance

ISMS Copilot vereenvoudigt het integratieproces door te fungeren als een AI-gestuurde assistent die juridische vereisten koppelt aan ISO-controles. Het koppelt automatisch vereisten voor datagovernance uit Artikel 10 van de EU AI Act aan ISO 27001-controles, waardoor handmatige kruisverwijzingen overbodig worden. Het platform helpt ook bij het opstellen van kritieke documenten – zoals beleidsdocumenten voor datalevenscycli, risicoregisters en conformiteitsdossiers – terwijl elke verplichting wordt gekoppeld aan bijbehorend bewijs.

Door bewijsregistratie te automatiseren en gebruik te maken van de PDCA-cyclus, zet ISMS Copilot audits om in eenvoudige ophaaltaken. Het integreert ook AI-datagovernance in herhaalbare bedrijfsprocessen. Organisaties kunnen de tool gebruiken om hun rollen onder de EU AI Act te definiëren (bijv. als aanbieder, gebruiker of beide), gescopeerde logging te implementeren en documentatie voor biasdetectie te automatiseren om te voldoen aan Artikel 10, waarbij speciale categorieën persoonsgegevens op juiste wijze worden verwerkt en verwijderd.

Met ondersteuning voor meer dan 20 kaders, waaronder ISO 27001, ISO 42001 en de EU AI Act, stelt ISMS Copilot organisaties in staat om een unified compliance-model te beheren in plaats van gefragmenteerde systemen te hanteren. Dit is vooral belangrijk, aangezien 96% van de ondernemingen al AI gebruikt, maar slechts 5% formele AI-governancekaders heeft geïmplementeerd.

Conclusie

De EU AI Act en ISO 27001 zijn geen rivalen – ze werken samen. De AI Act beschrijft wat organisaties moeten doen om ervoor te zorgen dat AI-systemen veilig, transparant en respectvol zijn ten opzichte van fundamentele rechten. Ondertussen biedt ISO 27001 een gestructureerd Informatiebeveiligingsmanagementsysteem (ISMS) om die vereisten effectief te operationaliseren.

De groeiende adoptie van deze kaders onderstreept de urgentie van geïntegreerde governance. Door de sterke punten van beide te combineren, kunnen organisaties traditionele informatiebeveiligingsrisico’s – zoals datalekken en ongeautoriseerde toegang – aanpakken naast AI-specifieke problemen zoals modelbias en transparantie in besluitvorming.

Integratie is niet alleen een kwestie van het afvinken van compliance-checklists; het is een strategische zet. Het in kaart brengen van de vereisten van de EU AI Act naar ISO 27001-controles en het integreren ervan in bestaande PDCA-cycli creëert een unified systeem. Deze aanpak vereenvoudigt niet alleen audits, maar positioneert bedrijven ook om toekomstige regelgeving het hoofd te bieden, aangezien wereldwijde standaardisatie-inspanningen de EU-vereisten steeds meer afstemmen op ISO/IEC-kaders.

Belangrijkste inzichten

Een unified compliance-strategie biedt tastbare voordelen. Zo kun je aan de slag:

Maak gebruik van je bestaande ISMS. Breid je ISO 27001-controles uit om AI-specifieke uitdagingen zoals biasdetectie en datakwaliteit aan te pakken. Met een geschatte overlap van 80% tussen ISO 27001 en andere kaders zoals SOC 2, vullen deze systemen elkaar van nature aan.

Centraliseer je AI-inventaris. Onderhoud gedetailleerde documentatie voor elk AI-systeem, inclusief datatypes, algoritmes, implementatiecontexten en of je fungeert als aanbieder of gebruiker.

Automatiseer kaderkoppeling. Tools zoals ISMS Copilot kunnen compliance stroomlijnen door vereisten uit Artikel 10 van de EU AI Act automatisch te koppelen aan ISO 27001-controles. Deze tools stellen ook conformiteitsdossiers op en volgen bewijs over meerdere kaders, wat tijd bespaart en fouten vermindert naarmate de verplichtingen van de AI Act van kracht worden.

Werk met verouderde governance-methoden. Papieren beleidsdocumenten zonder doorlopende reviews of metrics falen vaak bij audits. Integreer AI-governance in dagelijkse operaties door middel van continue monitoring, regelmatige biasreviews en gescopeerde logging (doorgaans 180 tot 365 dagen) die aansluiten bij beide kaders.

Organisaties die slagen onder de EU AI Act zullen verder gaan dan basiscompliance. Ze integreren wettelijke vereisten met operationele best practices, waarbij ze ISO 27001 gebruiken als de basis voor schaalbare, controleerbare AI-governance. Met de juiste tools en mindset verandert compliance van een regelgevende hindernis in een concurrentievoordeel.

FAQs

Hoe werken de EU AI Act en ISO 27001 samen om AI-systemen effectief te beheren?

De EU AI Act stelt een wettelijk kader voor AI vast, met nadruk op risicoklassificaties op basis van risico, transparantie, verantwoordelijkheid en datagovernance-vereisten (zoals uiteengezet in Artikel 10). Deze maatregelen moeten ervoor zorgen dat AI-systemen controleerbaar en betrouwbaar blijven. Ondertussen biedt ISO 27001 een gestructureerde aanpak via een Informatiebeveiligingsmanagementsysteem (ISMS) om de vertrouwelijkheid, integriteit en beschikbaarheid van data te waarborgen via risicobeoordelingen, controles en doorlopende verbeteringen.

Door een ISMS te integreren dat is afgestemd op ISO 27001, kunnen organisaties sleutelprocessen – zoals risicobeheer en toegangscontroles – direct koppelen aan de vereisten van de EU AI Act. Deze koppeling helpt om te voldoen aan de verwachtingen van de wet met betrekking tot dataverwerking, monitoring en registratie. Kortom, de AI Act specificeert wat er moet worden bereikt, terwijl ISO 27001 een gids biedt voor hoe dit te realiseren. Tools zoals ISMS Copilot kunnen dit proces vereenvoudigen door ISO 27001-controles te koppelen aan specifieke AI Act-clausules, beleidsdocumenten, sjablonen en auditevidence te bieden om efficiënt aan beide normen te voldoen.

Wat is het verschil tussen verplichte en vrijwillige compliance in datagovernance?

Verplichte compliance, zoals de EU AI Act, verplicht organisaties om zich te houden aan strikte, wettelijk bindende regels rond datagovernance. Dit betekent dat ze risicobeheerprocedures moeten opzetten, datakwaliteit moeten waarborgen en grondige documentatie moeten bijhouden. Het niet naleven van deze vereisten kan leiden tot zware boetes of zelfs het verlies van toegang tot bepaalde markten.

Daarentegen biedt vrijwillige compliance – zoals ISO 27001 – een andere aanpak. Hoewel het niet wettelijk verplicht is, houdt het in dat organisaties best practices aannemen via een Informatiebeveiligingsmanagementsysteem (ISMS). Organisaties kiezen vaak voor deze route om hun reputatie te versterken, beveiligingsmaatregelen te versterken en certificeringen te behalen. Er zijn echter geen wettelijke gevolgen voor het overslaan ervan.

De belangrijkste verschillen komen neer op wettelijke handhaving versus optionele deelname, regelgevende sancties versus reputatievoordelen, en strikte mandaten versus aanpasbare, op maat gemaakte kaders.

Hoe kunnen organisaties AI-specifieke vereisten integreren in hun ISO 27001-kaders?

Om AI-specifieke behoeften te integreren in een ISO 27001-kader, begin je met het uitbreiden van je risicobeoordelingsproces om AI-gerelateerde uitdagingen zoals modeldrift, databias en ongeautoriseerde toegang tot modellen op te nemen. Koppel deze risico’s aan van toepassing zijnde ISO 27001-controles, zoals wijzigingsbeheer, beheer van bevoorrechte toegang en leveranciersrelaties. Deze aanpak zorgt ervoor dat AI-risico’s worden aangepakt binnen de bestaande structuur van je Informatiebeveiligingsmanagementsysteem (ISMS).

Daarnaast kun je je beleidsdocumenten afstemmen op de EU AI Act, met de nadruk op de datagovernance-vereisten ervan. Integreer praktijken zoals datakwaliteitscontroles, herkomstregistratie en retentiebeperkingen in je ISMS-procedures. Deze updates kunnen worden geformaliseerd als "AI-datagovernance"-beleid, ter aanvulling op je huidige controles voor dataclassificatie en -verwerking.

Voor een meer gestructureerde strategie kun je overwegen om ISO/IEC 42001 (de AI-managementsysteemstandaard) bovenop ISO 27001 te leggen. Dit creëert een samenhangend kader voor het beheren van zowel AI als informatiebeveiliging. Tools zoals ISMS Copilot kunnen dit proces vereenvoudigen door risicokoppeling te automatiseren, sjablonen te bieden en documentatie te stroomlijnen, waardoor je effectiever kunt voldoen aan zowel AI- als informatiebeveiligingsnormen.

Gerelateerde blogposts

Gerelateerde artikelen

Hoe AI Multi-Framework Compliance Verbetert

AI verenigt control mapping, automatiseert bewijsverzameling en biedt realtime monitoring om voorbereidingstijd voor audits te verkorten en compliancefouten te verminderen.

Hoe realtime-alerts ISO 27001-nalevingsrisico's verminderen

Realtime-alerts detecteren bedreigingen snel, verminderen inbreukkosten en auditfalen, en houden ISO 27001-logs bestand tegen manipulatie voor continue naleving.

AI-nauwkeurigheid in Beveiliging: Gespecialiseerd vs. Generiek

Gespecialiseerde AI overtreft generieke modellen voor beveiligingscompliance—hogere nauwkeurigheid, minder hallucinaties en auditklaar documentatie voor ISO 27001 en GRC.