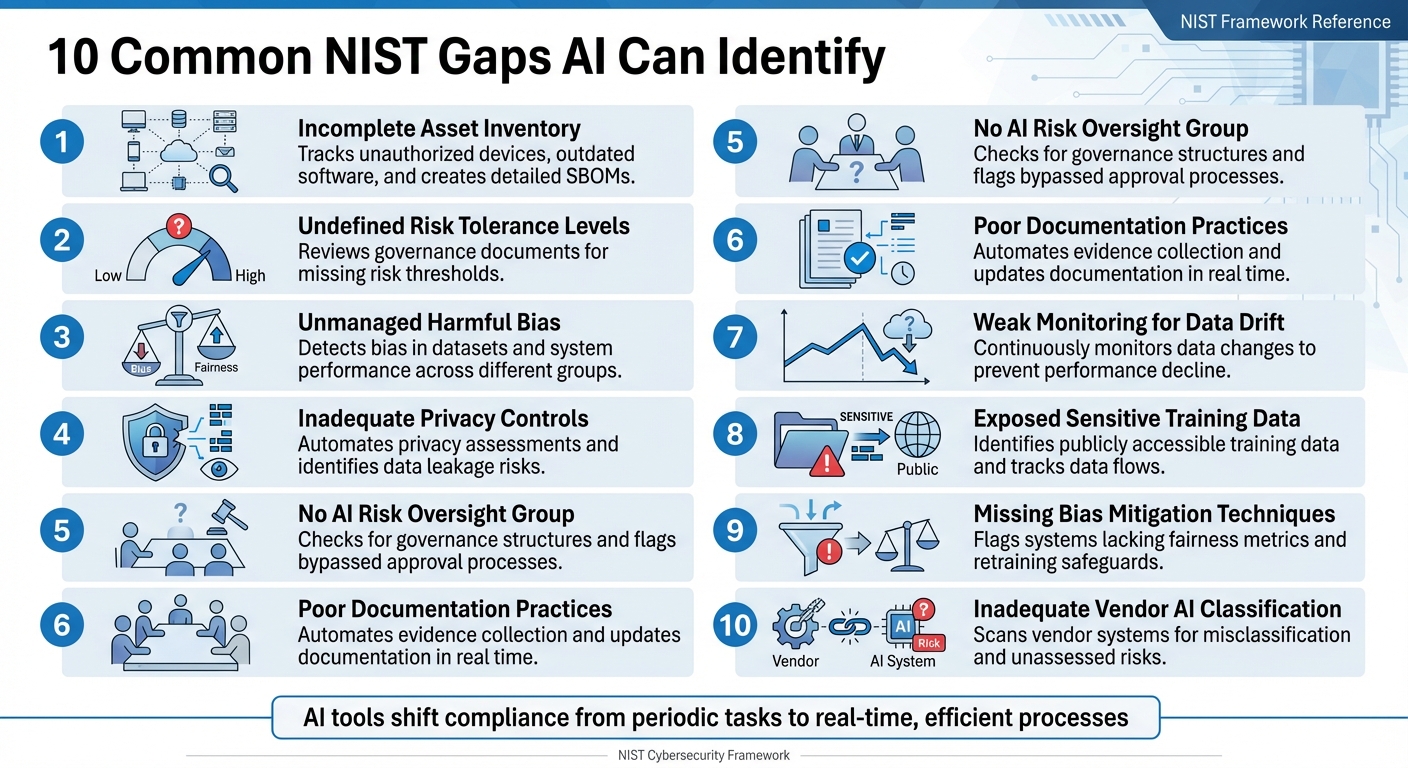

10 écarts courants du NIST que l'IA peut identifier

L'IA automatise l'analyse des écarts NIST - détection des risques liés aux actifs, biais, confidentialité, dérive des données et fournisseurs, génération de preuves prêtes pour l'audit.

Les organisations peinent souvent à atteindre une conformité totale avec le NIST Cybersecurity Framework (CSF), en particulier avec sa dernière version, CSF 2.0. Les audits manuels sont lents et sujets aux erreurs, laissant des lacunes dans des domaines comme le suivi des actifs, la gestion des risques et les contrôles de confidentialité. Les outils pilotés par l'IA révolutionnent la donne en automatisant les vérifications de conformité, en assurant une surveillance continue et en identifiant les écarts en temps réel. Voici 10 écarts courants de conformité NIST que l'IA peut résoudre :

- Inventaire incomplet des actifs : L'IA suit les appareils non autorisés, les logiciels obsolètes et crée des listes détaillées des composants logiciels (SBOM).

- Niveaux de tolérance au risque non définis : L'IA examine les documents de gouvernance pour détecter les seuils de risque manquants.

- Biais non maîtrisé : L'IA détecte les biais dans les ensembles de données et les performances des systèmes entre différents groupes.

- Contrôles de confidentialité inadéquats : L'IA automatise les évaluations de confidentialité et identifie les risques comme les fuites de données.

- Absence de groupe de supervision des risques liés à l'IA : L'IA vérifie les structures de gouvernance et signale les processus d'approbation contournés.

- Pratiques de documentation médiocres : L'IA automatise la collecte de preuves et met à jour la documentation en temps réel.

- Surveillance insuffisante de la dérive des données : Les outils d'IA surveillent en continu les changements de données pour éviter une baisse de performance.

- Données d'entraînement sensibles exposées : L'IA identifie les risques comme les ensembles de données d'entraînement accessibles publiquement et suit les flux de données.

- Techniques d'atténuation des biais manquantes : L'IA signale les systèmes dépourvus de métriques d'équité et de sauvegardes de recyclage.

- Classification inadéquate des fournisseurs d'IA : L'IA analyse les systèmes des fournisseurs pour détecter les mauvaises classifications et les risques non évalués.

Les outils d'IA comme ISMS Copilot simplifient la conformité en automatisant l'analyse des écarts, en alignant les contrôles sur les normes NIST et en générant une documentation prête pour l'audit. Cela transforme la conformité d'une tâche périodique en un processus efficace et en temps réel.

10 écarts courants de conformité NIST que l'IA peut identifier et résoudre

Analyse des écarts GRC 101 avec la conformité NIST RMF et CIS Controls

1. Inventaire incomplet des actifs

Avoir un inventaire complet des actifs est crucial pour répondre aux exigences de conformité NIST. Pourtant, de nombreuses organisations peinent à suivre chaque appareil, application et composant logiciel qu'elles utilisent. Lorsque des actifs ne sont pas suivis, ils créent des vulnérabilités que les attaquants peuvent exploiter.

Un NIST 800-53 Copilot peut aider en comparant l'état réel de votre réseau à son état souhaité. Le balayage continu met en évidence les écarts par rapport à votre liste d'actifs approuvée, facilitant ainsi la détection de problèmes tels que les appareils non autorisés ou les logiciels obsolètes qui manquent de correctifs de sécurité critiques. Ce processus continu renforce non seulement la gestion des risques, mais fournit également des informations précieuses sur la sécurité de votre réseau.

"L'objectif de la capacité SWAM est de gérer les risques créés par les logiciels non gérés ou non autorisés sur un réseau. Les logiciels non gérés ou non autorisés constituent une cible que les attaquants peuvent utiliser comme plateforme pour attaquer les composants du réseau." – NIST IR 8011 Vol. 3

Au-delà du balayage, les tableaux de bord CDM offrent une visibilité en temps réel sur votre inventaire d'actifs, passant des audits statiques et obsolètes à une surveillance continue. Les systèmes d'IA peuvent également créer automatiquement une liste détaillée des composants logiciels (SBOM) pour chaque build logiciel, répertoriant chaque composant et dépendance - qu'ils soient directs ou indirects. Cette fonctionnalité est de plus en plus importante puisque près de 220 000 organisations américaines doivent se conformer aux normes CMMC, dont 80 000 sont soumises aux contrôles de niveau 2 qui s'alignent sur NIST SP 800-171.

Pour améliorer votre inventaire d'actifs, envisagez d'utiliser des balises d'identification logicielle (SWID) pour automatiser la découverte des logiciels sur votre réseau. Vous pouvez également mettre en œuvre une liste blanche automatisée pour garantir que seul les logiciels autorisés sont exécutés. Pour les systèmes d'IA, il est essentiel d'inventorier non seulement le matériel, mais aussi les intégrations tierces dont ils dépendent, car ces composants externes peuvent introduire des risques supplémentaires.

2. Niveaux de tolérance au risque non définis

De nombreuses organisations reconnaissent les risques associés à l'IA, mais échouent souvent à établir des seuils clairs pour ce qui est acceptable. Sans ces limites définies, les équipes peuvent avoir du mal à déterminer quand avancer ou mettre en pause un projet. C'est là que les outils d'IA entrent en jeu. Grâce au traitement du langage naturel, les assistants ISMS multi-cadres peuvent examiner les politiques, les stratégies de gestion des risques et les cadres de gouvernance pour confirmer si des critères spécifiques - comme des limites quantitatives ou des limites qualitatives - ont été définis pour différentes applications d'IA. Par exemple, les systèmes qui traitent des données sensibles, telles que les informations personnelles identifiables (PII), nécessitent des seuils plus stricts pour garantir la sécurité et la conformité. Lorsque ces sauvegardes sont manquantes, une action corrective immédiate devient nécessaire, comme le souligne le NIST.

"Dans la mesure où les défis liés à la spécification des tolérances aux risques de l'IA restent non résolus, il peut exister des contextes où un cadre de gestion des risques n'est pas encore facilement applicable pour atténuer les risques négatifs de l'IA." - NIST AI RMF 1.0

Le NIST définit la tolérance au risque comme "la volonté de l'organisation ou de l'acteur de l'IA à supporter le risque pour atteindre ses objectifs". Les outils d'IA jouent un rôle crucial en analysant les documents de gouvernance pour vérifier l'existence de critères d'acceptation des risques clairement documentés, qu'ils impliquent des limites numériques ou des limites qualitatives plus larges. Cependant, le NIST AI Risk Management Framework, publié le 26 janvier 2023, n'impose pas de niveaux de tolérance spécifiques. Il met plutôt l'accent sur l'importance d'identifier les lacunes - comme une documentation manquante sur les risques résiduels ou des stratégies de gestion des risques vagues - qui pourraient exposer les organisations.

Le NIST fournit une directive claire pour de tels scénarios :

"Dans les cas où un système d'IA présente des niveaux de risque négatifs inacceptables... le développement et le déploiement doivent cesser de manière sûre jusqu'à ce que les risques puissent être suffisamment gérés." - NIST AI RMF 1.0

3. Biais nuisible non maîtrisé

Les biais dans les systèmes d'IA découlent de l'interaction entre le code, les données d'entraînement et le contexte social plus large. Sans politiques de conformité appropriées, ces systèmes peuvent involontairement aggraver les inégalités existantes ou même créer de nouveaux schémas de discrimination. Cela a des conséquences réelles dans des domaines comme la santé, l'embauche et la finance. Le problème est aggravé par la complexité des systèmes d'IA, qui impliquent souvent d'innombrables points de décision, rendant presque impossible l'identification et la résolution manuelles des biais. Les organisations se tournent souvent vers un assistant de conformité IA pour gérer ces flux de travail complexes et multi-étapes.

"Sans contrôles appropriés, les systèmes d'IA peuvent amplifier, perpétuer ou aggraver des résultats inéquitables ou indésirables pour les individus et les communautés." - NIST AI RMF 1.0

Les outils d'IA traitent les biais nuisibles grâce à des processus tels que le Test, l'Évaluation, la Vérification et la Validation (TEVV), comme décrit dans la fonction MESURER du NIST AI RMF. Ces processus évaluent si les ensembles de données d'entraînement correspondent à leur objectif prévu et reflètent les conditions sociétales actuelles. La surveillance automatisée joue un rôle clé ici, identifiant la "dérive des données", qui fait référence aux changements dans les données d'entrée pouvant impacter les performances du système et introduire de nouveaux biais qui n'étaient pas présents lors des tests initiaux.

Ce processus de détection va au-delà du simple traitement de chiffres. Les outils d'IA évaluent les performances des systèmes entre différents sous-groupes, reconnaissant que même les personnes qui n'utilisent pas directement le système peuvent être affectées. Cette approche, souvent appelée évaluation socio-technique, prend en compte non seulement la conception technique, mais aussi la manière dont elle interagit avec les normes sociétales et les comportements humains pour produire des inégalités. Pour garantir l'objectivité, le NIST préconise une séparation claire des responsabilités : les équipes qui construisent les modèles d'IA doivent être distinctes de celles qui les vérifient et les valident. Cette configuration permet des évaluations plus impartiales et une surveillance continue des biais entre tous les groupes d'utilisateurs.

Une autre stratégie clé pour gérer les biais consiste à améliorer le suivi des données. Par exemple, les organisations utilisant des outils de visibilité native IA ont signalé une augmentation stupéfiante de 1 660 % de leur capacité à surveiller les activités de traitement des données en seulement trois semaines après leur mise en œuvre. Ces outils cartographient les "parcours de données", traçant comment les données circulent de leur source à travers les modèles d'IA. En procédant ainsi, ils peuvent prédire et prévenir les violations potentielles en temps réel. Cela est crucial puisque les systèmes d'IA traitent les données à des vitesses bien supérieures à ce que les équipes manuelles peuvent gérer. Le suivi de ces flux de données est essentiel pour détecter les changements qui pourraient conduire à de nouveaux biais ou aggraver ceux existants avant qu'ils ne causent des dommages.

4. Contrôles de confidentialité inadéquats

Le rythme et l'ampleur rapides des systèmes d'IA rendent les lacunes en matière de confidentialité une préoccupation majeure, d'autant plus que la surveillance manuelle peine à suivre. Sans sauvegardes de confidentialité appropriées, les organisations risquent d'exposer des informations personnelles identifiables (PII) via des fuites de données d'entraînement, des accès non autorisés ou des divulgations involontaires dans les sorties des modèles. La dépendance aux API pour l'ingestion et l'inférence des données augmente encore la surface d'attaque, rendant les contrôles de confidentialité robustes une nécessité.

Pour relever ces défis, les outils d'IA, y compris les assistants de conformité spécialisés, automatisent désormais les évaluations des contrôles de confidentialité en utilisant des formats lisibles par machine comme OSCAL. Ces outils évaluent en continu les contrôles décrits dans des cadres tels que NIST SP 800-53, en utilisant des formats comme JSON, XML et YAML. Notamment, le 27 août 2025, le NIST a publié la version 5.2.0 de SP 800-53, qui a pleinement intégré les contrôles de confidentialité dans le catalogue de contrôles de sécurité plus large, s'éloignant de l'approche autonome antérieure.

"La prise en compte de la fonctionnalité et de l'assurance permet de garantir que les produits technologiques de l'information et les systèmes qui en dépendent sont suffisamment fiables." - Joint Task Force, NIST SP 800-53 Rév. 5

Les outils automatisés se concentrent sur la famille de contrôles de traitement et de transparence des PII (PT) pour identifier les risques d'utilisation non autorisée des PII, de divulgations ou de désanonymisation. Ils révèlent également les API fantômes et l'IA fantôme que les audits manuels overloquent souvent. En mettant en œuvre le "Politique en tant que Code", les organisations peuvent convertir les exigences complexes de NIST SP 800-53 en règles opérationnelles en temps réel. Ce processus est simplifié lorsque les organisations entraînent leurs assistants de conformité IA sur des modèles haute précision conçus pour la GRC. Ces règles redigent automatiquement les données sensibles des invites et des sorties d'IA avant qu'elles ne soient traitées par le modèle.

De plus, le logiciel Dioptra du NIST prend en charge les exercices de red teaming, aidant les organisations à tester les contrôles de confidentialité et de sécurité dans des conditions adversariales. Ces simulations peuvent mesurer les pertes de performance et identifier des vulnérabilités spécifiques. Cela est particulièrement important étant donné que le Profil IA Générative du NIST AI RMF décrit 12 risques uniques ou accrus associés à l'IA, y compris les préoccupations de confidentialité des données comme les fuites et la désanonymisation non autorisée. Le 14 avril 2025, le NIST a de plus souligné ces problèmes en publiant le projet du Cadre de Confidentialité 1.1, qui aborde spécifiquement les risques de confidentialité liés à l'IA tels que les attaques par inférence et l'amplification des biais.

5. Absence de groupe de supervision des risques liés à l'IA

Un défi majeur dans la gestion des risques liés à l'IA est l'absence d'un groupe de supervision dédié. Sans un tel comité, la gouvernance et la responsabilité disparaissent souvent, entraînant des efforts fragmentés et de moindre priorité. Aujourd'hui, des outils avancés exploitant le traitement du langage naturel (NLP) peuvent aider à combler cette lacune en analysant les politiques organisationnelles, les chartes et les comptes-rendus de réunion. Ces outils peuvent confirmer l'existence d'un groupe formel de supervision des risques liés à l'IA et garantir l'alignement avec la fonction "Gouverner" du NIST AI RMF - spécifiquement Gouverner 1.2, qui souligne la nécessité de structures de gouvernance et de responsabilité claires.

Les systèmes pilotés par l'IA examinent également les organigrammes et les systèmes de gestion des identités pour identifier les rôles formels de supervision dans la gestion des risques liés à l'IA. Les plateformes de gouvernance ajoutent une autre couche de protection en signalant les projets qui contournent les processus d'approbation formels. Cela garantit une supervision continue, un composant critique pour se conformer au NIST RMF. La fonction "Gouverner" agit comme une base, influençant toutes les autres fonctions du RMF telles que Cartographier, Mesurer et Gérer. Cette approche interconnectée renforce le cadre global.

"Sans responsabilité définie, les efforts de gestion des risques liés à l'IA peuvent devenir fragmentés ou délaissés, laissant l'organisation exposée." - Kezia Farnham, Responsable Senior, Diligent

L'urgence d'une supervision appropriée est soulignée par la croissance rapide des investissements et de la réglementation en matière d'IA. En 2024, les investissements privés américains dans l'IA ont dépassé 100 milliards de dollars, tandis que les mentions de l'IA dans la législation mondiale ont augmenté de 21,3 % dans 75 pays depuis 2023 - une augmentation stupéfiante de neuf fois depuis 2016. Sans mécanismes formels de supervision, les organisations risquent de ne pas se conformer aux réglementations émergentes, telles que le Règlement IA de l'UE et le Décret Exécutif 14110 des États-Unis, qui soulignent l'importance de la supervision humaine et de la gestion des risques auditable.

Pour combler cette lacune, les organisations devraient former un comité transversal de gestion des risques liés à l'IA incluant des dirigeants clés tels que le Conseiller Juridique, le Responsable de la Sécurité de l'Information (CISO), le Responsable des Risques et les responsables IA/ML. Désigner un responsable pour le NIST AI RMF à un seul cadre - souvent le Responsable des Risques ou Juridique - peut centraliser davantage la responsabilité. De plus, l'adoption d'un assistant de conformité IA spécialement conçu peut rationaliser ce processus, automatisant la cartographie des rôles et responsabilités et remplaçant les feuilles de calcul manuelles obsolètes par des systèmes de surveillance continue.

6. Pratiques de documentation médiocres

S'appuyant sur les problèmes antérieurs de suivi des actifs et de supervision, une mauvaise documentation mine davantage les efforts de conformité. Les lacunes en matière de documentation sont à la fois répandues et coûteuses lorsqu'il s'agit de la conformité NIST. Un 86 % des organisations manquent de visibilité sur leurs flux de données d'IA, entraînant des lacunes significatives en matière de documentation et d'audit qui peuvent poser problème lors des revues réglementaires. Par exemple, lorsque les auditeurs demandent des journaux des interactions d'IA impliquant des données personnelles, de nombreuses organisations sont incapables de les fournir. Cette défaillance viole des réglementations clés telles que l'article 30 du RGPD, la section 1798.130 du CCPA et le § 164.312 de la HIPAA.

Les plateformes de conformité pilotées par l'IA offrent une solution pratique en remplaçant les feuilles de calcul manuelles obsolètes par des tableaux de bord en temps réel. Ces tableaux de bord signalent automatiquement les preuves manquantes et les problèmes de documentation. Ils utilisent également la surveillance continue des contrôles pour détecter la "dérive" - des cas où la documentation ou les politiques actuelles ne correspondent plus à l'état réel des systèmes ou de l'infrastructure. Les outils automatisés capturent les configurations et les journaux en temps réel, créant des pistes d'audit complètes.

"Traiter chaque changement, déploiement et incident comme un événement de documentation garantit une accumulation constante de preuves bien plus fiable qu'un effort post-incident précipité." - Abnormal AI

Le principe de "documenter au fur et à mesure" renforce la conformité en capturant les preuves en temps réel. En s'intégrant à des outils comme les wikis contrôlés par version et les systèmes de tickets, l'IA garantit que les approbations et les captures d'écran sont attachées aux demandes de tirage. Cela est particulièrement critique étant donné que seulement 17 % des organisations ont mis en œuvre des contrôles de sécurité automatisés pour l'IA capables de fournir les journaux requis pour les audits réglementaires.

Les organisations utilisant des plateformes de conformité automatisées voient des avantages majeurs, notamment la réduction des cycles de révision de plusieurs semaines à quelques heures seulement et une charge de travail de conformité significativement réduite. Ces outils cartographient également le "profil actuel" d'une organisation par rapport à un "profil cible" NIST, identifiant les lacunes dans les sauvegardes et la documentation. En automatisant le processus "Identifier-Évaluer-Catégoriser", ils aident à garantir que les inventaires d'actifs et les classifications des risques restent à jour. Cette approche continue de la documentation joue un rôle clé dans le maintien de la conformité NIST.

sbb-itb-4566332

7. Surveillance insuffisante de la dérive des données

La dérive des données se produit lorsque les données sur lesquelles un système d'IA a été entraîné changent au fil du temps, entraînant une baisse des performances et de la fiabilité. Avec plus de 75 % des organisations utilisant désormais l'IA dans au moins une fonction commerciale, ne pas surveiller ces changements crée un risque de conformité sérieux - un risque que les outils pilotés par l'IA sont bien équipés pour résoudre. Pour aborder ce problème, des solutions de surveillance plus avancées sont nécessaires, comme décrit ci-dessous.

En pratique, l'IA fonctionne souvent comme une "boîte noire", rendant plus difficile la détection des problèmes. 45 % des organisations citent les préoccupations concernant l'exactitude des données ou les biais comme un obstacle majeur à l'adoption de l'IA. Pourtant, beaucoup manquent encore d'outils pour une surveillance continue, les laissant vulnérables à la dérive des données. Contrairement aux vérifications manuelles, la surveillance continue permet une analyse en temps réel, détectant les problèmes avant qu'ils ne s'aggravent.

"Les systèmes d'IA... peuvent être entraînés sur des données qui peuvent changer au fil du temps, parfois de manière significative et inattendue, affectant la fonctionnalité et la fiabilité des systèmes d'une manière difficile à comprendre."

Pour aborder la dérive des données, des outils avancés d'IA-SPM peuvent automatiquement détecter les modèles d'IA déployés, identifier l'"IA fantôme" et cartographier à la fois les ensembles de données d'entraînement et d'inférence, y compris les magasins de documents et les bases de données vectorielles. Ces outils signalent également les mauvaises configurations, telles que les données d'entraînement accessibles publiquement, qui pourraient poser des risques de sécurité.

Par exemple, Net Solutions a récemment travaillé avec une entreprise nord-américaine de nettoyage commercial pour mettre en œuvre une gouvernance de l'IA pour un assistant de chat commercial. En utilisant des outils de surveillance en temps réel comme AWS CloudWatch et DataDog, ainsi que des pipelines automatisés intégrés aux alertes Zoho Desk, l'entreprise est passée d'une preuve de concept à une solution d'IA conforme et évolutive en seulement six semaines.

Le technologue Akash Lomas de Net Solutions souligne l'importance de la surveillance :

"La mesure devient particulièrement critique dans les environnements où l'IA façonne directement les expériences clients... sans surveillance continue, ces systèmes peuvent dériver - servant un contenu non pertinent, biaisé ou trompeur."

Ignorer la dérive des données peut entraîner des conséquences majeures : réduction des performances du système, amendes réglementaires et perte de confiance. En plus de cela, les cyberattaques coûtent aux entreprises en moyenne 4,45 millions de dollars par an.

8. Données d'entraînement sensibles exposées

Le risque d'exposition des données d'entraînement sensibles est une préoccupation sérieuse, en particulier en ce qui concerne les violations de conformité. Selon le NIST, l'IA générative introduit 12 risques distincts, les problèmes de confidentialité des données - comme les fuites et les divulgations non autorisées d'informations personnelles - étant une préoccupation majeure. De nombreuses organisations ont du mal à suivre où résident leurs données d'entraînement d'IA et à garantir leur sécurité.

Pour y remédier, les outils de Gestion de la Posture de Sécurité de l'IA (AI-SPM) sont devenus essentiels. Ces outils peuvent identifier automatiquement les modèles d'IA déployés et localiser les ensembles de données utilisés pour l'entraînement sur les plateformes cloud, y compris le stockage de documents et les bases de données vectorielles. Ils signalent également les vulnérabilités, telles que les données d'entraînement accessibles publiquement ou les points de terminaison d'application ouverts. Mahesh Nawale, Responsable Marketing Produit chez Zscaler, souligne l'importance de ces outils :

"Zscaler AI-SPM localise automatiquement les ensembles de données utilisés dans l'entraînement et l'inférence de l'IA dans votre environnement cloud - y compris les données, les magasins de documents et les bases de données vectorielles. Il signale les mauvaises configurations comme les données d'entraînement accessibles publiquement, donnant à vos équipes de sécurité les informations nécessaires pour enquêter, remédier et prouver la conformité."

Les outils d'IA vont au-delà de la simple identification des mauvaises configurations. Ils surveillent également le comportement des modèles pour détecter les menaces potentielles. Par exemple, ils peuvent détecter des problèmes comme la mémorisation des données, l'inversion de modèle ou des activités suspectes telles que des téléchargements massifs de données ou des modifications non autorisées, qui pourraient signaler une exfiltration de données. Les capacités de balayage automatisé renforcent davantage la sécurité en identifiant les informations sensibles - comme les données biométriques, de santé ou de localisation - qui n'ont pas été correctement anonymisées.

Le NIST a également développé "Dioptra", une solution logicielle qui aide les organisations à tester les modèles d'IA contre les cyberattaques. Elle mesure l'impact des attaques sur les performances des modèles et identifie les scénarios où les données d'entraînement pourraient être en danger.

Katerina Megas, Responsable de Programme au NIST, souligne le défi croissant :

"L'IA crée de nouveaux risques de ré-identification, non seulement en raison de son pouvoir analytique sur des ensembles de données disparates, mais aussi en raison d'éventuelles fuites de données provenant de l'entraînement des modèles."

Avec les ensembles de données énormes utilisés dans l'entraînement des grands modèles de langage, les tests automatisés continus ne sont plus une option - c'est une nécessité pour protéger les informations sensibles.

9. Techniques d'atténuation des biais manquantes

Lorsque les systèmes d'IA manquent de méthodes appropriées pour traiter les biais, ils risquent d'amplifier les résultats injustes et de créer des problèmes de conformité significatifs. Selon le NIST, la gestion des biais nuisibles est l'une des sept caractéristiques critiques d'un système d'IA digne de confiance. Les cadres traditionnels de gestion des risques sont insuffisants pour gérer les biais de l'IA, rendant les stratégies d'atténuation spécialisées essentielles. Bien que les sections précédentes aient couvert la détection des biais, y remédier efficacement nécessite des contrôles clairs et des efforts de recyclage continus. Identifier les biais ne suffit pas - des stratégies à long terme sont nécessaires pour les contrer.

Les outils d'IA jouent un rôle clé dans la détection des lacunes dans les contrôles des biais. Ils signalent des problèmes tels que l'absence de métriques d'équité (par exemple, les ratios d'impact disparate ou les différences de taux de faux positifs), les systèmes dépourvus de tests adversariaux ou de red teaming de l'IA, et les modèles sans recyclage programmé, ce qui les rend vulnérables à la dérive des données.

"Sans contrôles appropriés, les systèmes d'IA peuvent amplifier, perpétuer ou aggraver des résultats inéquitables ou indésirables pour les individus et les communautés." – NIST AI RMF 1.0

Pour relever ces défis, les plateformes de gouvernance de l'IA effectuent des analyses automatisées pour découvrir les lacunes de conformité basées sur les directives du NIST AI RMF. Elles garantissent que les organisations ont mis en œuvre les sauvegardes nécessaires, telles que les filtres de contenu, les protocoles de correction des biais et autres garde-fous exigés par des normes comme NIST AI 600-1. Ces plateformes tracent également la lignée des données pour confirmer que les ensembles de données d'entraînement sont exempts de problèmes pouvant conduire à des résultats biaisés. De plus, les outils de Gestion de la Posture de Sécurité de l'IA (AI-SPM) identifient tous les modèles d'IA déployés, y compris les systèmes d'"IA fantôme" qui ont peut-être contourné les tests d'équité.

Avec les systèmes d'IA prenant des milliards de décisions, les biais non détectés peuvent éroder la confiance du public, enfreindre les libertés civiles et entraîner des pénalités réglementaires. Notamment, il y a eu une augmentation de 21,3 % des mentions de la législation sur l'IA dans le monde depuis 2023. Ces risques soulignent le besoin urgent d'une surveillance automatisée et continue pour garantir l'équité et la responsabilité.

10. Classification inadéquate des fournisseurs d'IA

Lorsque les organisations ne classent pas correctement les systèmes tiers d'IA, elles s'exposent à des risques de conformité qu'elles ne voient même pas venir. Le problème ? Les métriques de risque des fournisseurs ne correspondent souvent pas aux cadres de risque internes d'une entreprise. Si les fournisseurs sont mal classés, il est impossible d'appliquer les bons contrôles ou de déterminer si leur étiquette "à faible risque" correspond réellement à la tolérance au risque de votre organisation. Cette inadéquation souligne la nécessité d'outils automatisés capables de vérifier les classifications des fournisseurs en temps réel.

Les outils pilotés par l'IA interviennent ici, automatisant le processus d'identification des écarts de classification. En analysant les contrats des fournisseurs et les spécifications techniques, ces outils repèrent les systèmes mal classés et signalent les composants tiers d'IA non évalués, comme décrit dans les fonctions Gouverner 6.1 et Cartographier 4.1 du NIST AI RMF. Ils détectent également les systèmes qui manquent de transparence sur des éléments critiques comme les modèles pré-entraînés, les pipelines de données ou les processus de développement.

"Le risque peut émerger à la fois des données, des logiciels ou du matériel tiers eux-mêmes et de la manière dont ils sont utilisés." – NIST AI RMF 1.0

Le Profil du Cadre de Cybersécurité NIST pour l'IA, développé avec l'apport de plus de 6 500 contributeurs, souligne l'importance de la visibilité de la chaîne d'approvisionnement. Les outils pilotés par l'IA aident en maintenant des inventaires en temps réel des systèmes tiers, cartographiant la chaîne d'approvisionnement de l'IA pour découvrir des composants non classés ou non évalués. Ces outils exposent les vulnérabilités cachées dans les logiciels, le matériel ou les sources de données qui pourraient ne devenir apparentes qu'au moment du déploiement. Avec la classification automatisée des fournisseurs, les organisations peuvent obtenir une vue complète de leur paysage de risque lié à l'IA, conformément aux directives du NIST.

Un autre avantage de l'automatisation est sa capacité à prioriser les évaluations des fournisseurs en fonction de la sensibilité des données. Par exemple, les systèmes qui traitent des informations personnelles identifiables ou interagissent directement avec les utilisateurs sont signalés pour une analyse plus approfondie. Cette approche reconnaît qu'un système considéré comme à faible risque dans un contexte - comme le traitement de données de capteurs physiques - pourrait poser un risque élevé dans un autre, comme la gestion d'informations de santé protégées. Sans cette surveillance automatisée, les entreprises risquent de gaspiller des ressources sur des systèmes à faible risque tout en laissant des outils d'IA à enjeux élevés sous-surveillés.

Comment ISMS Copilot identifie ces écarts

ISMS Copilot adopte une approche spécifique au cadre pour identifier les écarts de conformité NIST 800-53. Au lieu de parcourir Internet pour trouver des réponses, il utilise la Génération Augmentée par Récupération (RAG) pour extraire des informations ciblées d'un ensemble de données soigneusement sélectionné. Cet ensemble de données comprend plus de 20 cadres comme NIST 800-53, ISO 27001, SOC 2 et le RGPD, fournissant des conseils précis et exploitables pour résoudre

Articles connexes

Comment l'IA améliore la conformité multi-cadres

L'IA unifie la cartographie des contrôles, automatise la collecte des preuves et fournit une surveillance en temps réel pour réduire le temps de préparation des audits et les erreurs de conformité.

Comment les alertes en temps réel réduisent les risques de non-conformité ISO 27001

Les alertes en temps réel détectent les menaces rapidement, réduisent les coûts des violations et les échecs d'audit, et maintiennent les journaux ISO 27001 inviolables pour une conformité continue.

Précision de l'IA en cybersécurité : Modèles spécialisés vs. génériques

L'IA spécialisée surpasse les modèles génériques pour la conformité en cybersécurité — une précision accrue, moins d'hallucinations et une documentation prête pour les audits ISO 27001 et GRC.