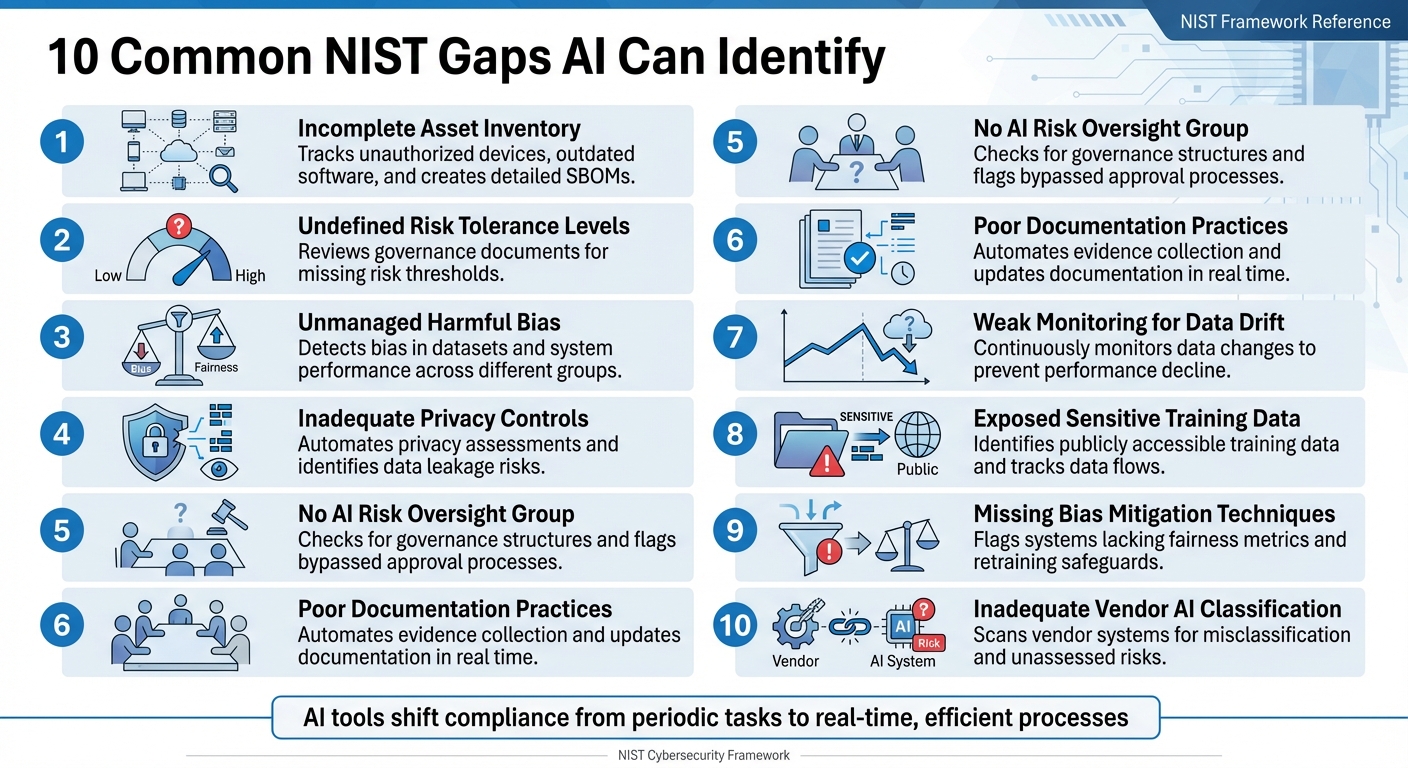

10 Gap NIST comuni che l'AI può identificare

L'AI automatizza l'analisi dei gap NIST - identificando rischi relativi ad asset, bias, privacy, data drift e vendor, generando evidenze pronte per l'audit.

Le organizzazioni spesso faticano a raggiungere la piena conformità al NIST Cybersecurity Framework (CSF), soprattutto con la sua versione più recente, CSF 2.0. Gli audit manuali sono lenti e soggetti a errori, lasciando gap in aree come il tracciamento degli asset, la gestione dei rischi e i controlli sulla privacy. Gli strumenti basati su AI cambiano le regole del gioco automatizzando i controlli di conformità, fornendo un monitoraggio continuo e identificando i gap in tempo reale. Ecco 10 gap di conformità NIST comuni che l'AI può affrontare:

- Inventario degli asset incompleto: l'AI traccia i dispositivi non autorizzati, il software obsoleto e crea dettagliati Software Bill of Materials (SBOM).

- Livelli di tolleranza del rischio indefiniti: l'AI esamina i documenti di governance per identificare le soglie di rischio mancanti.

- Bias non gestito: l'AI rileva il bias nei dataset e nelle prestazioni del sistema tra diversi gruppi.

- Controlli sulla privacy inadeguati: l'AI automatizza le valutazioni della privacy e identifica rischi come la perdita di dati.

- Nessun gruppo di supervisione del rischio AI: l'AI verifica l'esistenza di strutture di governance e segnala i processi di approvazione bypassati.

- Pratiche di documentazione scadenti: l'AI automatizza la raccolta di evidenze e aggiorna la documentazione in tempo reale.

- Monitoraggio debole per il data drift: gli strumenti AI monitorano continuamente i cambiamenti dei dati per prevenire il declino delle prestazioni.

- Dati di addestramento sensibili esposti: l'AI identifica rischi come i dati di addestramento pubblicamente accessibili e traccia i flussi di dati.

- Tecniche di mitigazione del bias mancanti: l'AI segnala i sistemi che mancano di metriche di fairness e salvaguardie di ricorso.

- Classificazione insufficiente dei vendor AI: l'AI scansiona i sistemi dei vendor per identificare errate classificazioni e rischi non valutati.

Strumenti come ISMS Copilot semplificano la conformità automatizzando l'analisi dei gap, allineando i controlli agli standard NIST e generando documentazione pronta per l'audit. Questo trasforma la conformità da un compito periodico a un processo efficientemente continuo e in tempo reale.

10 Gap di conformità NIST comuni che l'AI può identificare e affrontare

GRC - Analisi dei gap 101 utilizzando NIST RMF e conformità ai CIS Controls

1. Inventario degli asset incompleto

Avere un inventario degli asset accurato è essenziale per soddisfare i requisiti di conformità NIST. Tuttavia, molte organizzazioni faticano a tracciare ogni dispositivo, applicazione e componente software che utilizzano. Quando gli asset non vengono tracciati, creano vulnerabilità che gli attaccanti possono sfruttare.

Un NIST 800-53 Copilot può aiutare confrontando lo stato attuale della rete con lo stato desiderato. La scansione continua evidenzia eventuali deviazioni dall'elenco di asset approvati, rendendo più facile individuare problemi come dispositivi non autorizzati o software obsoleto che mancano di patch di sicurezza critiche. Questo processo continuo non solo rafforza la gestione dei rischi ma fornisce anche preziose intuizioni sulla sicurezza della rete.

"L'obiettivo della capacità SWAM è gestire il rischio creato da software non gestito o non autorizzato su una rete. Il software non gestito o non autorizzato è un bersaglio che gli attaccanti possono utilizzare come piattaforma da cui attaccare i componenti sulla rete." – NIST IR 8011 Vol. 3

Oltre alla scansione, i dashboard CDM offrono visibilità in tempo reale nell'inventario degli asset, allontanandosi dagli audit statici e obsoleti verso un monitoraggio continuo. I sistemi AI possono anche creare automaticamente un dettagliato Software Bill of Materials (SBOM) per ogni build software, catalogando ogni componente e dipendenza - siano essi diretti o indiretti. Questa funzionalità è sempre più importante poiché quasi 220.000 organizzazioni statunitensi devono conformarsi agli standard CMMC, con 80.000 di esse soggette ai controlli di Livello 2 che si allineano con NIST SP 800-171.

Per migliorare l'inventario degli asset, considera di utilizzare tag Software Identification (SWID) per automatizzare la scoperta del software sulla tua rete. Puoi anche implementare whitelist automatici per garantire che solo il software autorizzato sia autorizzato a funzionare. Per i sistemi AI, è essenziale inventariare non solo l'hardware ma anche le integrazioni di terze parti su cui si affidano, poiché questi componenti esterni possono introdurre rischi aggiuntivi.

2. Livelli di tolleranza del rischio indefiniti

Molte organizzazioni riconoscono i rischi associati all'AI ma spesso non riescono a stabilire soglie chiare per ciò che è accettabile. Senza questi confini definiti, i team possono trovare difficile determinare quando procedere o mettere in pausa un progetto. È qui che gli strumenti AI tornano utili. Utilizzando l'elaborazione del linguaggio naturale, gli assistenti ISMS cross-framework possono esaminare le politiche, le strategie di gestione dei rischi e i framework di governance per confermare se criteri specifici - come limiti quantitativi o confini qualitativi - sono stati fissati per diverse applicazioni AI. Ad esempio, i sistemi che gestiscono dati sensibili, come informazioni identificabili personalmente (PII), richiedono soglie più rigorose per garantire la sicurezza e la conformità. Quando queste salvaguardie sono assenti, è necessaria un'azione correttiva immediata, come sottolineato da NIST.

"Nella misura in cui le sfide per specificare la tolleranza ai rischi dell'AI rimangono irrisolte, potrebbero esserci contesti in cui un framework di gestione dei rischi non è ancora facilmente applicabile per mitigare i rischi negativi dell'AI." - NIST AI RMF 1.0

NIST definisce la tolleranza al rischio come "la disponibilità dell'organizzazione o dell'attore AI ad assumersi il rischio per raggiungere i suoi obiettivi". Gli strumenti AI svolgono un ruolo cruciale nella scansione dei documenti di governance per verificare la presenza di criteri di accettazione del rischio chiaramente documentati, che comportino limiti numerici o confini qualitativi più ampi. Tuttavia, il NIST AI Risk Management Framework, introdotto il 26 gennaio 2023, non prescrive livelli di tolleranza specifici. Al contrario, evidenzia l'importanza di identificare i gap - come la documentazione mancante sui rischi residui o le strategie di gestione dei rischi vaghe - che potrebbero lasciare le organizzazioni esposte.

NIST offre una chiara direttiva per tali scenari:

"Nei casi in cui un sistema AI presenta livelli di rischio negativo inaccettabili... lo sviluppo e la distribuzione dovrebbero cessare in modo sicuro finché i rischi non possono essere sufficientemente gestiti." - NIST AI RMF 1.0

3. Bias dannoso non gestito

Il bias nei sistemi AI deriva dall'interazione tra il codice, i dati di addestramento e il contesto sociale più ampio. Senza adeguate politiche di conformità, questi sistemi possono involontariamente peggiorare le disuguaglianze esistenti o addirittura creare nuovi modelli di discriminazione. Questo ha conseguenze nel mondo reale in aree come la sanità, l'assunzione e la finanza. Il problema è aggravato dalla complessità dei sistemi AI, che spesso comportano innumerevoli punti decisionali, rendendo praticamente impossibile identificare e affrontare i bias manualmente. Le organizzazioni spesso si rivolgono a un assistente di conformità AI per gestire questi complessi flussi di lavoro multi-step.

"Senza controlli appropriati, i sistemi AI possono amplificare, perpetuare o esacerbare risultati iniqui o indesiderabili per individui e comunità." - NIST AI RMF 1.0

Gli strumenti AI affrontano il bias dannoso attraverso processi come Test, Evaluation, Verification, and Validation (TEVV), come delineato nella funzione MEASURE del NIST AI RMF. Questi processi valutano se i dataset di addestramento si allineano con il loro scopo previsto e riflettono le condizioni sociali attuali. Il monitoraggio automatizzato gioca un ruolo chiave qui, identificando il "data drift", che si riferisce ai cambiamenti nei dati di input che possono influire sulle prestazioni del sistema e introdurre nuovi bias che potrebbero non essere stati presenti durante i test iniziali.

Questo processo di rilevamento va oltre il puro calcolo dei numeri. Gli strumenti AI valutano il modo in cui i sistemi funzionano tra vari sottogruppi, riconoscendo che anche le persone che non utilizzano direttamente il sistema possono essere colpite. Questo approccio, spesso chiamato valutazione socio-tecnica, considera non solo la progettazione tecnica ma anche il modo in cui interagisce con le norme sociali e il comportamento umano per produrre iniquità. Per garantire l'obiettività, NIST sostiene una chiara divisione delle responsabilità - i team che costruiscono modelli AI dovrebbero essere separati da coloro che li verificano e convalidano. Questo setup consente valutazioni più imparziali e monitoraggio continuo del bias tra tutti i gruppi di utenti.

Un'altra strategia chiave per gestire il bias è il tracciamento avanzato dei dati. Ad esempio, le organizzazioni che utilizzano strumenti di visibilità nativi dell'AI hanno segnalato un sorprendente aumento del 1.660% nella loro capacità di monitorare le attività di elaborazione dei dati in soli tre settimane dall'implementazione. Questi strumenti mappano "Data Journeys", tracciando come i dati fluiscono dalla loro origine attraverso i modelli AI. Facendo ciò, possono prevedere e prevenire potenziali violazioni in tempo reale. Questo è critico poiché l'AI elabora i dati a velocità ben oltre ciò che i team manuali possono gestire. Tracciare questi flussi di dati è essenziale per cogliere i cambiamenti che potrebbero portare a bias nuovi o peggiorati prima che causino danni.

4. Controlli sulla privacy inadeguati

Il ritmo rapido e la scala dei sistemi AI rendono i gap di privacy una preoccupazione significativa, soprattutto perché la supervisione manuale fatica a stare al passo. Senza adeguate salvaguardie sulla privacy, le organizzazioni rischiano di esporre informazioni personalmente identificabili (PII) attraverso perdite di dati di addestramento, accesso non autorizzato o divulgazioni involontarie negli output del modello. L'affidamento alle API per l'ingestione dei dati e l'inferenza aumenta ulteriormente la superficie di attacco, rendendo i controlli di privacy robusti una necessità.

Per affrontare queste sfide, gli strumenti AI, inclusi gli assistenti di conformità specializzati, automatizzano ora le valutazioni dei controlli sulla privacy utilizzando formati leggibili da macchina come OSCAL. Questi strumenti valutano continuamente i controlli delineati in framework come NIST SP 800-53, utilizzando formati come JSON, XML e YAML. Notevolmente, il 27 agosto 2025, NIST ha rilasciato la versione 5.2.0 di SP 800-53, che ha integrato pienamente i controlli sulla privacy nel catalogo di controlli di sicurezza più ampio, allontanandosi dall'approccio standalone precedente.

"Affrontare la funzionalità e l'assicurazione aiuta a garantire che i prodotti della tecnologia dell'informazione e i sistemi che si affidano a questi prodotti siano sufficientemente affidabili." - Joint Task Force, NIST SP 800-53 Rev. 5

Gli strumenti automatizzati si concentrano sulla famiglia di controlli PII Processing and Transparency (PT) per identificare l'uso non autorizzato di PII, le divulgazioni o i rischi di de-anonimizzazione. Scopre anche shadow API e shadow AI che gli audit manuali spesso non rilevano. Implementando "Policy-as-Code", le organizzazioni possono convertire i requisiti complessi di NIST SP 800-53 in regole operative in tempo reale. Questo processo è semplificato quando le organizzazioni addestrano i loro assistenti di conformità AI con modelli ad alta precisione progettati per GRC. Queste regole automaticamente redatte sensibile dai prompt e dagli output dell'AI prima che vengano elaborati dal modello.

Inoltre, il software Dioptra di NIST supporta esercizi di red teaming, aiutando le organizzazioni a testare i controlli sulla privacy e sulla sicurezza in condizioni avversariali. Queste simulazioni possono misurare le perdite di prestazioni e identificare vulnerabilità specifiche. Questo è particolarmente importante dato che il Profilo Generative AI del NIST AI RMF delinea 12 rischi unici o amplificati associati all'AI, incluse le preoccupazioni sulla privacy dei dati come la perdita e la de-anonimizzazione non autorizzata. Il 14 aprile 2025, NIST ha ulteriormente sottolineato questi problemi rilasciando il Privacy Framework 1.1 in bozza, che affronta specificamente i rischi di privacy relativi all'AI come gli attacchi di inferenza e l'amplificazione del bias.

5. Nessun gruppo di supervisione del rischio AI

Una delle principali sfide nella gestione del rischio AI è l'assenza di un gruppo di supervisione dedicato. Senza una tale commissione, la governance e l'accountability spesso cadono tra le crepe, portando a sforzi frammentati e a bassa priorità. Oggi, gli strumenti avanzati che sfruttano l'elaborazione del linguaggio naturale (NLP) possono aiutare a colmare questo gap analizzando le politiche organizzative, i charter e i verbali delle riunioni. Questi strumenti possono confermare se un gruppo formale di supervisione del rischio AI esiste e assicurare l'allineamento con la funzione "Govern" del NIST AI RMF - in particolare Govern 1.2, che enfatizza la necessità di strutture di governance e accountability chiare.

I sistemi basati su AI esaminano anche gli organigrammi e i sistemi di gestione dell'identità per identificare i ruoli formali di supervisione nella gestione del rischio AI. Le piattaforme di governance aggiungono un ulteriore livello di protezione segnalando i progetti che bypassano i processi di approvazione formali. Questo assicura una supervisione continua, un componente critico dell'aderenza al NIST RMF. La funzione "Govern" funge da fondazione, influenzando tutte le altre funzioni RMF come Map, Measure e Manage. Questo approccio interconnesso rafforza il framework complessivo.

"Senza accountability definita, gli sforzi di gestione del rischio AI possono diventare frammentati o deprioritizzati, lasciando l'organizzazione esposta." - Kezia Farnham, Senior Manager, Diligent

L'urgenza di una supervisione appropriata è sottolineata dalla crescita rapida dell'investimento in AI e dalla regolamentazione. Nel 2024, l'investimento del settore privato statunitense in AI ha superato i 100 miliardi di dollari, mentre le menzioni di AI nella legislazione globale sono aumentate del 21,3% in 75 paesi dal 2023 - un aumento straordinario di nove volte dal 2016. Senza meccanismi di supervisione formali, le organizzazioni rischiano di perdere la conformità alle normative emergenti, come l'EU AI Act e l'Executive Order 14110 statunitense, che sottolineano l'importanza della supervisione umana e della gestione dei rischi controllabile.

Per colmare questo gap, le organizzazioni dovrebbero formare una commissione intersettoriale per il rischio AI che includa leader chiave come il General Counsel, il Chief Information Security Officer (CISO), il Chief Risk Officer e i responsabili di AI/ML. Assegnare la responsabilità del NIST AI RMF a un singolo dirigente - spesso il Head of Risk o Legal - può ulteriormente centralizzare l'accountability. Inoltre, adottare un assistente di conformità AI costruito appositamente può semplificare questo processo, automatizzando la mappatura dei ruoli e delle responsabilità e sostituendo i vecchi fogli di calcolo manuali con i sistemi di monitoraggio continuo.

6. Pratiche di documentazione scadenti

Sulla base dei problemi precedenti con il tracciamento degli asset e la supervisione, le pratiche di documentazione scadenti minano ulteriormente gli sforzi di conformità. I gap di documentazione sono sia diffusi che costosi quando si tratta di conformità NIST. Un sorprendente 86% delle organizzazioni manca di visibilità nei loro flussi di dati AI, portando a significativi gap di documentazione e audit che possono causare problemi durante le revisioni normative. Ad esempio, quando gli auditor richiedono log delle interazioni AI che coinvolgono dati personali, molte organizzazioni non sono in grado di fornirli. Questo fallimento viola le normative chiave come l'Articolo 30 del GDPR, la Sezione 1798.130 del CCPA e l'HIPAA § 164.312.

Le piattaforme di conformità basate su AI offrono una soluzione pratica sostituendo i vecchi fogli di calcolo manuali con dashboard in tempo reale. Questi dashboard segnalano automaticamente le prove mancanti e i problemi di documentazione. Usano anche il monitoraggio continuo dei controlli per rilevare il "drift" - istanze in cui la documentazione o le politiche attuali non corrispondono più allo stato effettivo dei sistemi o dell'infrastruttura. Gli strumenti automatizzati catturano configurazioni e log in tempo reale, creando audit trail completi.

"Trattare ogni modifica, distribuzione e incidente come un evento di documentazione assicura un accumulo costante di prove che è molto più affidabile di uno sforzo frettoloso post-incidente." - Abnormal AI

Il principio del "documenta mentre procedi" rafforza la conformità catturando le prove in tempo reale. Integrando con strumenti come wiki con versione controllata e sistemi di ticketing, l'AI assicura che le approvazioni e gli screenshot siano allegati alle pull request. Questo è particolarmente critico dato che solo il 17% delle organizzazioni ha implementato controlli di sicurezza AI automatizzati capaci di fornire i log richiesti per gli audit normativi.

Le organizzazioni che sfruttano le piattaforme di conformità automatizzate vedono benefici significativi, incluso ridurre i cicli di revisione da settimane a poche ore e ridurre significativamente i carichi di lavoro di conformità. Questi strumenti mappano anche il "Profilo attuale" di un'organizzazione contro un "Profilo target" NIST, individuando i gap nelle salvaguardie e nella documentazione. Automatizzando il processo "Identify–Assess–Categorize", aiutano a garantire che gli inventari degli asset e le classificazioni di rischio rimangono aggiornati. Questo approccio continuo alla documentazione gioca un ruolo chiave nel mantenimento della conformità NIST.

sbb-itb-4566332

7. Monitoraggio debole per il data drift

Il data drift si verifica quando i dati su cui un sistema AI è stato addestrato cambiano nel tempo, portando a un declino delle prestazioni e dell'affidabilità. Con oltre il 75% delle organizzazioni che ora utilizza AI in almeno una funzione aziendale, non riuscire a monitorare questi cambiamenti crea un serio rischio di conformità - uno che gli strumenti basati su AI sono ben attrezzati per affrontare. Affrontare questo problema richiede soluzioni di monitoraggio più avanzate, come delineato di seguito.

In pratica, l'AI spesso funziona come una "scatola nera", rendendo più difficile rilevare quando qualcosa va male. Il 45% delle organizzazioni cita le preoccupazioni sulla precisione dei dati o il bias come un ostacolo maggiore all'adozione dell'AI. Eppure, molti ancora mancano degli strumenti per il monitoraggio continuo, lasciandoli vulnerabili al data drift. A differenza dei controlli manuali, il monitoraggio continuo abilita l'analisi in tempo reale, catturando i problemi prima che si escalino.

"I sistemi AI... possono essere addestrati su dati che possono cambiare nel tempo, a volte significativamente e inaspettatamente, influenzando la funzionalità del sistema e l'affidabilità in modi che sono difficili da comprendere".

Per affrontare il data drift, gli strumenti avanzati di AI-SPM possono rilevare automaticamente i modelli AI distribuiti, identificare "Shadow AI" e mappare sia i dataset di addestramento che di inferenza, inclusi i negozi di documenti e i database vettoriali. Questi strumenti inoltre segnalano le errate configurazioni, come i dati di addestramento pubblicamente accessibili, che potrebbero costituire rischi di sicurezza.

Ad esempio, Net Solutions ha recentemente lavorato con un'azienda di pulizia commerciale nordamericana per implementare la governance dell'AI per un assistente di chat di vendita. Utilizzando strumenti di monitoraggio in tempo reale come AWS CloudWatch e DataDog, insieme a pipeline automatiche integrate con gli avvisi Zoho Desk, l'azienda è passata da un proof-of-concept a una soluzione AI conforme e scalabile in soli sei settimane.

Il tecnolago Akash Lomas di Net Solutions sottolinea l'importanza del monitoraggio:

"La misurazione diventa particolarmente critica negli ambienti in cui l'AI forma direttamente le esperienze dei clienti... senza una supervisione continua, questi sistemi possono andare alla deriva - fornendo contenuti irrilevanti, distorti o fuorvianti".

Ignorare il data drift può portare a conseguenze importanti: prestazioni del sistema ridotte, multa normative e perdita di fiducia. In più, i cyberattacchi costano alle aziende una media di 4,45 milioni di dollari all'anno.

8. Dati di addestramento sensibili esposti

Il rischio di esporre dati di addestramento sensibili è una preoccupazione seria, soprattutto quando si tratta di violazioni di conformità. Secondo NIST, l'AI generativa introduce 12 rischi distinti, con i problemi di privacy dei dati - come la perdita e la divulgazione non autorizzata di informazioni personali - essere una preoccupazione principale. Molte organizzazioni affrontano difficoltà nel tracciare dove risiedono i loro dati di addestramento AI e nel garantire la loro sicurezza.

Per affrontare ciò, gli strumenti AI-Security Posture Management (AI-SPM) sono diventati essenziali. Questi strumenti possono identificare automaticamente i modelli AI distribuiti e localizzare i dataset utilizzati per l'addestramento su piattaforme cloud, inclusi lo storage di documenti e i database vettoriali. Inoltre segnalano vulnerabilità, come i dati di addestramento pubblicamente accessibili o gli endpoint aperti delle applicazioni. Mahesh Nawale, Product Marketing Manager presso Zscaler, enfatizza l'importanza di questi strumenti:

"Zscaler AI-SPM localizza automaticamente i dataset utilizzati nell'addestramento e nell'inferenza dell'AI nel tuo ambiente cloud - inclusi i dati, i negozi di documenti e i database vettoriali. Segnala errate configurazioni come i dati di addestramento pubblicamente accessibili, fornendo ai tuoi team di sicurezza l'intuizione necessaria per investigare, rimediare e provare la conformità".

Gli strumenti AI vanno oltre solo l'identificazione delle errate configurazioni. Monitorano anche il comportamento del modello per catturare minacce potenziali. Ad esempio, possono rilevare problemi come la memorizzazione dei dati, l'inversione del modello o attività sospette come i download di dati di grandi dimensioni o i cambiamenti non autorizzati, che potrebbero segnalare l'esfiltrabilità dei dati. Le capacità di scansione automatizzate ulteriormente rafforzano la sicurezza identificando le informazioni sensibili - come i dati biometrici, sanitari o di localizzazione - che non sono stati adeguatamente anonimizzati.

NIST ha anche sviluppato "Dioptra", una soluzione software che aiuta le organizzazioni a testare i modelli AI contro i cyberattacchi. Misura come gli attacchi impattano le prestazioni del modello e identifica gli scenari in cui i dati di addestramento potrebbero essere a rischio.

Katerina Megas, Program Manager presso NIST, sottolinea la sfida crescente:

"L'AI crea nuovi rischi di re-identificazione, non solo per la sua potenza analitica tra dataset disparati, ma anche per la potenziale perdita di dati dall'addestramento del modello".

Con gli enormi dataset utilizzati nell'addestramento dei Large Language Model, il test automatizzato continuo non è più opzionale - è una necessità per proteggere le informazioni sensibili.

9. Tecniche di mitigazione del bias mancanti

Quando i sistemi AI mancano di metodi appropriati per affrontare il bias, rischiano di amplificare risultati ingiusti e creare significativi problemi di conformità. Secondo NIST, gestire il bias dannoso è uno dei sette tratti critici di un sistema AI affidabile. I framework tradizionali di gestione dei rischi si dimostrano insufficienti nel gestire il bias dell'AI, rendendo le strategie di mitigazione specializzate essenziali. Mentre le sezioni precedenti coprivano il rilevamento del bias, affrontarlo efficacemente richiede controlli chiari e sforzi di ricorso continuato. Semplicemente identificare il bias non è sufficiente - sono necessarie strategie a lungo termine per contrastarlo.

Gli strumenti AI svolgono un ruolo chiave nell'individuazione dei gap nei controlli del bias. Segnalano problemi come le metriche di fairness mancanti (ad es. i rapporti di impatto disparato o le differenze nel tasso di falsi positivi), i sistemi che mancano di test avversariali o red teaming dell'AI, e i modelli senza ricorso programmato, che li lasciano vulnerabili al data drift.

"Senza controlli appropriati, i sistemi AI possono amplificare, perpetuare o esacerbare risultati iniqui o indesiderabili per individui e comunità." – NIST AI RMF 1.0

Per affrontare queste sfide, le piattaforme di governance dell'AI conducono scansioni automatizzate per scoprire i gap di conformità basati sulle linee guida del NIST AI RMF. Assicurano che le organizzazioni abbiano implementato le salvaguardie necessarie, come i filtri di contenuto, i protocolli di correzione del bias e altre barriere imposte da standard come NIST AI 600-1. Queste piattaforme anche tracciano la lineage dei dati per confermare che i dataset di addestramento sono liberi da problemi che potrebbero portare a risultati distorti. Inoltre, gli strumenti AI-Security Posture Management (AI-SPM) identificano tutti i modelli AI distribuiti, inclusi i sistemi "shadow AI" che potrebbero aver bypassato il testing di fairness del tutto.

Con i sistemi AI che effettuano miliardi di decisioni, i bias non rilevati possono erodere la fiducia pubblica, violare le libertà civili e innescare sanzioni normative. Notevolmente, c'è stato un aumento globale del 21,3% nelle menzioni della legislazione AI dal 2023. Questi rischi sottolineano l'urgente necessità di una supervisione continua e automatizzata per garantire la correttezza e l'accountability.

10. Classificazione insufficiente dei vendor AI

Quando le organizzazioni non classificano adeguatamente i sistemi AI di terze parti, si lasciano aperte ai rischi di conformità che potrebbero non nemmeno vedere arrivare. Il problema? Le metriche di rischio dei vendor spesso non si allineano con i framework di rischio interni di un'azienda. Se i vendor sono erratamente classificati, è impossibile applicare i controlli corretti o determinare se la loro etichetta "basso rischio" si adatta effettivamente alla tolleranza del rischio della tua organizzazione. Questo disallineamento evidenzia la necessità di strumenti automatizzati che possono verificare le classificazioni dei vendor in tempo reale.

Gli strumenti basati su AI intervengono qui, automatizzando il processo di identificazione dei gap di classificazione. Scansionando i contratti con i vendor e le specifiche tecniche, questi strumenti identificano i sistemi erratamente classificati e segnalano i componenti AI di terze parti non valutati, come delineato nelle funzioni del NIST AI RMF Govern 6.1 e Map 4.1. Inoltre catturano i sistemi che mancano di trasparenza su elementi critici come i modelli pre-addestrati, le pipeline di dati o i processi di sviluppo.

"Il rischio può emergere sia dai dati, dal software o dall'hardware di terze parti stessi che da come vengono utilizzati." – NIST AI RMF 1.0

Il NIST Cybersecurity Framework Profile per l'AI, sviluppato con input da oltre 6.500 contributori, sottolinea l'importanza della visibilità della catena di approvvigionamento. Gli strumenti basati su AI aiutano mantenendo inventari in tempo reale dei sistemi di terze parti, mappando la catena di approvvigionamento dell'AI per scoprire componenti non classificati o non controllati. Questi strumenti espongono le vulnerabilità nascoste nel software, nell'hardware o nelle fonti di dati che potrebbero diventare evidenti solo durante la distribuzione. Con la classificazione automatizzata dei vendor, le organizzazioni possono ottenere una visione completa del loro panorama di rischio AI, in linea con le linee guida di NIST.

Un altro beneficio dell'automazione è la sua capacità di assegnare priorità alle valutazioni dei vendor sulla base della sensibilità dei dati. Ad esempio, i sistemi che gestiscono informazioni personalmente identificabili o interagiscono direttamente con gli utenti vengono segnalati per un esame più ravvicinato. Questo approccio riconosce che un sistema ritenuto basso-rischio in un contesto - come l'elaborazione dei dati dei sensori fisici - potrebbe costituire un rischio elevato in un altro, come la gestione delle informazioni sanitarie protette. Senza questa supervisione automatizzata, le aziende rischiano di sprecare risorse su sistemi a basso rischio mentre lasciano gli strumenti AI ad alta posta sotto-monitorati.

Come ISMS Copilot identifica questi gap

ISMS Copilot adotta un approccio specifico al framework per individuare i gap nella conformità NIST 800-53. Invece di scansionare Internet per risposte, utilizza Retrieval-Augmented Generation (RAG) per estrarre informazioni mirate da un dataset accuratamente curato. Questo dataset include 20+ framework come NIST 800-53, ISO 27001, SOC 2, e GDPR, fornendo orientamento preciso e pratico per affrontare i gap di conformità.

Lo strumento semplifica l'analisi dei gap mappando i controlli tra multiple standard, creando documentazione pronta per l'auditor e scomponendo i rapporti lunghi. Con ISMS Copilot One, gli utenti possono caricare i documenti di conformità - anche quelli che superano le 20 pagine - per l'analisi automatizzata. Attualmente, 1.000+ organizzazioni si affidano a questo strumento per le loro esigenze di conformità della sicurezza dell'informazione. Ecco un rapido confronto delle funzionalità specializzate di ISMS Copilot rispetto agli strumenti AI generici:

| Caratteristica | ISMS Copilot | AI generico |

|---|---|---|

| Dataset | Focalizzato sulla conformità della sicurezza dell'informazione | Base di conoscenza ampia e generale |

| Accuratezza | Fornisce orientamento specifico al framework | Spesso vago o eccessivamente generico |

| Prontezza all'audit | Crea documentazione pronta per l'auditor | Non personalizzato per gli audit formali |

| Privacy dei dati | Conforme a SOC 2 Type II; nessun dato utente per l'addestramento | Può utilizzare gli input utente per l'addestramento |

| Analisi dei documenti | Gestisce l'analisi dettagliata dei gap per rapporti grandi | Limitato all'elaborazione testo di base |

Per salvaguardare le informazioni dei client, ISMS Copilot fornisce Workspace dedicati che mantengono i progetti isolati e sicuri. Tutti i dati sono archiviati negli archivi dati conforme a SOC 2 Type II con crittografia end-to-end, garantendo che i documenti caricati o le conversazioni non vengono mai utilizzati per addestrare i suoi modelli AI.

Per le organizzazioni che affrontano analisi dei gap NIST 800-53, ISMS Copilot offre passaggi chiari e praticabili per implementare i controlli e soddisfare i requisiti FISMA. Puoi esplorare il livello gratuito su chat.ismscopilot.com, con piani a pagamento a partire da $20/mese.

Conclusione

L'AI ha trasformato la conformità NIST da un processo periodico e reattivo a un sistema proattivo e in tempo reale. Analizzando interi dataset, l'AI può identificare problemi potenziali prima che si trasformino in problemi più grandi. Con l'automazione basata su AI, le organizzazioni possono rimanere pronte per gli audit automatizzando la raccolta di evidenze mentre si adattano ai requisiti di conformità in evoluzione.

Strumenti come policy-as-code e continuous assurance rendono possibile automatizzare i controlli NIST, affrontando i problemi nelle fasi iniziali del processo di sviluppo. Gli strumenti basati su AI possono rapidamente individuare le anomalie in vari ambienti, garantendo una supervisione centralizzata su multiple framework di conformità. Queste capacità sono al centro delle soluzioni offerte da ISMS Copilot.

ISMS Copilot fornisce conformità continua attraverso il suo approccio RAG (Red-Amber-Green), sfruttando un dataset curato che si estende su framework come NIST 800-53, ISO 27001, SOC 2 e oltre. Le sue caratteristiche includono l'analisi automatizzata dei gap, il mapping cross-framework e la documentazione pronta per l'audit, garantendo che le organizzazioni rimangono allineate agli standard NIST in evoluzione.

In cima a questi benefici, ISMS Copilot supporta multiple framework, un bisogno critico per i programmi di sicurezza complessi di oggi. Le organizzazioni possono esplorare questi strumenti di conformità basati su AI gratuitamente visitando chat.ismscopilot.com.

FAQ

Come l'AI semplifica la gestione dell'inventario degli asset per la conformità NIST?

Mantenere un inventario preciso e aggiornato degli asset è un componente critico del NIST Cybersecurity Framework (ad es. ID.AM-1) e dei controlli NIST 800-53. L'AI semplifica questo compito automatizzando la scoperta, la classificazione e il tracciamento sia degli asset hardware che software. Invece di affidarsi a metodi manuali tradizionali, spesso soggetti a errori, l'AI sfrutta tecniche avanzate come l'apprendimento automatico per analizzare il traffico di rete, l'attività dell'endpoint e i log del cloud. Questo approccio assicura che gli asset non identificati o non autorizzati vengano rilevati, le discrepanze vengono evidenziate e l'inventario rimane continuamente aggiornato.

Gli strumenti basati su AI come ISMS Copilot elevano questo processo integrando perfettamente con scanner, CMDB e cloud API. Possono auto-popolare tabelle di inventario conformi a NIST e generare la documentazione essenziale, inclusi rapporti sugli asset e log delle modifiche. Con la sua interfaccia in linguaggio naturale, ISMS Copilot facilita per gli utenti fare domande come "Quali dispositivi mancano di aggiornamenti del firmware?" e ricevere intuizioni immediate e praticabili. Questo non solo riduce il carico di lavoro manuale ma migliora anche l'accuratezza, mantenendo l'inventario degli asset perfettamente sincronizzato con gli standard NIST.

Come l'AI aiuta a identificare e ridurre il bias nei sistemi AI?

L'AI gioca un ruolo importante nello individuare e correggere il bias all'interno dei sistemi di intelligenza artificiale. Il NIST AI Risk Management Framework sottolinea la fairness come uno dei principi chiave dell'AI affidabile, insieme alla sicurezza, alla trasparenza e alla privacy. Utilizzando gli strumenti AI, le organizzazioni possono setacciare grandi dataset, previsioni e metadati per scoprire modelli di trattamento diseguale - come i tassi di errore più elevati che colpiscono sproporzionatamente determinati gruppi demografici. Questi strumenti applicano anche metriche di fairness statistica e offrono intuizioni praticabili per affrontare i problemi identificati.

Gli assistenti basati su AI, come ISMS Copilot, vanno oltre monitorando attivamente i sistemi AI per la conformità ai controlli NIST. Possono individuare la documentazione mancante, segnalare le fonti di dati non testate o identificare i gap nei processi di testing del bias. Offrendo modelli personalizzati e orientamenti passo-passo, questi strumenti trasformano la conformità da una lista di controllo statica a un flusso di lavoro interattivo. Questo facilita per le organizzazioni affrontare il bias, garantendo che i loro sistemi AI non sono solo conformi ma anche più equi e affidabili.

Come l'AI può aiutare ad automatizzare le valutazioni dei controlli sulla privacy secondo gli standard NIST?

L'AI semplifica le valutazioni dei controlli sulla privacy analizzando il NIST Privacy Framework e i controlli sulla privacy correlati di SP 800-53. Allinea quindi questi controlli ai flussi di dati della tua organizzazione, ai sistemi e alle politiche. Scansionando file di configurazione, log delle API e documentazione, costruisce una mappa in tempo reale collegando i controlli agli asset, individuando automaticamente i problemi come la crittografia mancante o i controlli di accesso obsoleti.

ISMS Copilot, spesso riferito come "il ChatGPT di ISO 27001", porta questa funzionalità agli standard NIST. Ad esempio, puoi chiedergli di valutare un controllo specifico, come il Controllo sulla Privacy NIST 800-53 AU-3. In risposta, genera liste di controllo personalizzate, passaggi per raccogliere evidenze e piani di remediation. Questo elimina il lavoro manuale noioso, offrendo intuizioni istantanee, precise e praticabili per semplificare gli sforzi di conformità.

Post del blog correlati

Articoli correlati

Come l'IA Migliora la Conformità Multi-Framework

L'IA unifica la mappatura dei controlli, automatizza la raccolta delle prove e fornisce il monitoraggio in tempo reale per ridurre i tempi di preparazione dell'audit e gli errori di conformità.

Come gli Avvisi in Tempo Reale Riducono i Rischi di Non Conformità ISO 27001

Gli avvisi in tempo reale rilevano le minacce rapidamente, riducono i costi delle violazioni e i fallimenti degli audit, e mantengono i log ISO 27001 protetti da manomissioni per la conformità continua.

Precisione dell'IA nella sicurezza: Specializzata vs Generica

L'IA specializzata batte i modelli generici per la conformità della sicurezza—maggiore precisione, meno allucinazioni e documentazione pronta per l'audit per ISO 27001 e GRC.