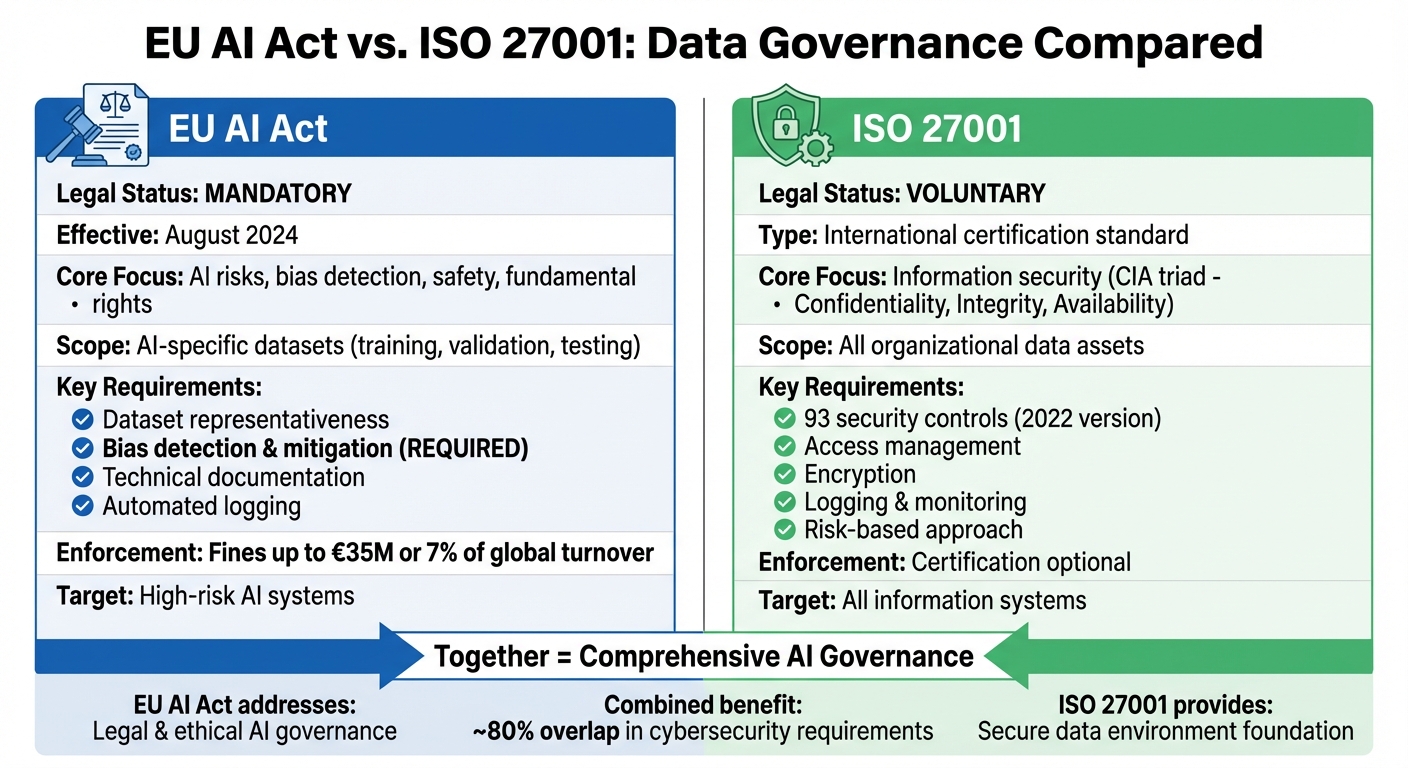

Ustawa UE o AI a ISO 27001: Porównanie zarządzania danymi

Połącz wymogi Ustawy UE o AI dotyczące stronniczości, przejrzystości i jakości danych z ISMS ISO 27001, aby zbudować zintegrowany i poddający się audytowi system zarządzania danymi AI.

Ustawa UE o AI i ISO 27001 podejmują zarządzanie danymi w różny sposób, ale mogą współpracować w celu efektywnego zarządzania systemami AI.

- Ustawa UE o AI: Obowiązkowe rozporządzenie (obowiązujące od sierpnia 2024 r.) skupiające się na ryzykach systemów AI, wykrywaniu stronniczości i jakości danych. Obowiązki takie jak reprezentatywność zbiorów danych i łagodzenie stronniczości są wymuszane, szczególnie dla systemów AI wysokiego ryzyka.

- ISO 27001: Dobrowolny międzynarodowy standard zapewniający bezpieczeństwo danych poprzez System Zarządzania Bezpieczeństwem Informacji (ISMS). Podkreśla poufność, integralność i dostępność wszystkich zasobów danych, a nie tylko danych specyficznych dla AI.

Kluczowa różnica:

Ustawa UE o AI zajmuje się zarządzaniem AI z perspektywy prawnej i etycznej, podczas gdy ISO 27001 skupia się na zabezpieczeniu środowisk danych. Razem zapewniają ustrukturyzowane podejście do zgodności i bezpieczeństwa systemów AI.

Szybkie porównanie:

| Funkcja | Ustawa UE o AI | ISO 27001 |

|---|---|---|

| Status prawny | Obowiązkowy | Dobrowolny |

| Fokus | Ryzyko AI, stronniczość, bezpieczeństwo | Bezpieczeństwo danych (CIA) |

| Zakres | Zbiory danych specyficzne dla AI | Wszystkie dane organizacji |

| Łagodzenie stronniczości | Wymagane | Nie jest rozwiązane |

| Egzekwowanie | Grzywny do €35M lub 7% | Certyfikacja fakultatywna |

Ustawa UE o AI a ISO 27001: Kluczowe różnice w zarządzaniu danymi

Ustawa UE o AI wyjaśniona: Nawigacja po zgodności w 2025 - Data Leaders Unscripted

Ustawa UE o AI: Zarządzanie danymi dla systemów AI wysokiego ryzyka

Ustawa UE o AI przyjmuje dostosowany podход do regulacji systemów AI, z surowszymi zasadami dla aplikacji wysokiego ryzyka. Artykuł 10, który staje się obowiązkowy 2 sierpnia 2026 r., określa szczegółowe obowiązki dla tych systemów, a niezastosowanie się wiąże się z karami.

Wymogi dla systemów AI wysokiego ryzyka

Zgodnie z Artykułem 10, zbiory danych używane do szkolenia, walidacji i testowania muszą spełniać surowe standardy. Muszą być istotne, reprezentatywne, wolne od błędów w jak największym stopniu i kompletne dla zamierzonego celu. Te zbiory danych powinny dokładnie odzwierciedlać populacje i ustawienia, w których będzie działać system AI, zapewniając uwzględnienie wszystkich odpowiednich kontekstów.

Rozwiązanie problemu stronniczości jest krytycznym wymogiem. Dostawcy są oczekiwani, aby ocenić zbiory danych pod kątem stronniczości, które mogą zagrozić zdrowiu, bezpieczeństwu lub prawom podstawowym. Muszą być na miejscu środki mające na celu wykrycie, zapobieganie i łagodzenie tej stronniczości. Jest to szczególnie ważne w przypadkach, gdy wyniki AI mogą wpływać na przyszłe dane wejściowe, potencjalnie tworząc pętle sprzężenia zwrotnego, które wzmacniają dyskryminacyjne wzorce. Aby zminimalizować ryzyka, organizacje muszą przyjąć zabezpieczenia, takie jak pseudonimizacja, i zapewnić usunięcie danych po dokonaniu poprawek.

Dokumentacja to kolejne ognisko skupienia. Dostawcy muszą sumiennie śledzić cykl życia swoich danych, obejmujący wszystko od decyzji projektowych i źródeł danych do procesów takich jak etykietowanie, czyszczenie i wzbogacanie. Są zobowiązani do zidentyfikowania luk w danych, udokumentowania założeń i potwierdzenia przydatności zbioru danych do jego zamierzonego użytku. W przypadku systemów, które nie wiążą się szkoleniem modelu, standardy te dotyczą wyłącznie zbiorów danych testowych.

Ramy zarządzania i egzekwowanie

Aby zapewnić zgodność z tymi wymogami zarządzania danymi, Ustawa UE o AI ustanawia formalne mechanizmy egzekwowania. W przeciwieństwie do dobrowolnych wytycznych, Ustawa nakłada wiążące obowiązki na każdą organizację wprowadzającą systemy AI wysokiego ryzyka na rynek UE. Nadzór jest sprawowany na poziomie Unii - przez jednostki takie jak Biuro AI i Europejska Rada do spraw AI - oraz na poziomie krajowym, poprzez wyznaczone Krajowe Właściwe Władze. Te władze mają prawo żądać dokumentacji technicznej, oceniać systemy i egzekwować środki naprawcze w przypadku niezastosowania się.

Organizacje są zobowiązane do wdrożenia ustrukturyzowanych ram zarządzania obejmujących wszystkie etapy swoich potoków danych. Obejmuje to znormalizowane protokoły przygotowania danych, regularne audyty stronniczości i plany monitorowania po wprowadzeniu na rynek, aby ocenić wydajność systemu po wdrożeniu. Niektóre praktyki, takie jak niecelowe skrobanie zdjęć twarzy z internetu w celu budowania baz danych rozpoznawania twarzy, są wyraźnie zabronione na mocy Ustawy. Biorąc pod uwagę zbliżające się terminy egzekwowania, traktowanie Artykułu 10 jako prostej listy kontrolnej może prowadzić do poważnych konsekwencji.

ISO 27001: Zarządzanie danymi i kontrole bezpieczeństwa

ISO 27001 odgrywa kluczową rolę obok Ustawy UE o AI, skupiając się na ochronie danych. Jej podstawą jest triada CIA: poufność (zapewnienie, że tylko autoryzowani użytkownicy mogą uzyskiwać dostęp do danych), integralność (utrzymanie dokładności i kompletności danych) i dostępność (udostępnianie danych w razie potrzeby). Ta neutralna technologicznie rama ma zastosowanie uniwersalnie, niezależnie od tego, czy zabezpieczasz rekordy klientów, dane finansowe czy zbiory danych do szkolenia AI. Skupiając się na solidnych praktykach bezpieczeństwa danych, ISO 27001 zapewnia solidne podstawy do zarządzania przepływami pracy danych specyficznych dla AI.

Podstawowe wymogi zarządzania danymi

Aktualizacja ISO 27001 z 2022 r. organizuje swoje 93 kontrole bezpieczeństwa w cztery główne kategorie: Organizacyjne, Osobowe, Fizyczne i Technologiczne. Te kontrole obejmują krytyczne obszary, takie jak dostęp, szyfrowanie, monitorowanie i ryzyka związane z trzecimi stronami. Kilka kluczowych wyróżników to:

- Zarządzanie dostępem (Załącznik A.9): Zapewnia, że dostęp do wyświetlania, modyfikowania lub usuwania danych mogą mieć tylko autoryzowane osoby.

- Kryptografia (Załącznik A.10): Chroni poufne dane poprzez szyfrowanie, zarówno w spoczynku, jak i podczas przesyłania.

- Rejestrowanie i monitorowanie (Załącznik A.12): Śledzi dostęp i działania za pomocą dzienników audytu.

- Bezpieczeństwo dostawcy (Załącznik A.15): Łagodzi ryzyka związane z dostawcami trzecich stron obsługującymi dane.

W przeciwieństwie do Ustawy UE o AI, która przepisuje określone zasady dla systemów AI wysokiego ryzyka, ISO 27001 podkreśla podejście oparte na ryzyku. Organizacje identyfikują potencjalne zagrożenia dla swoich danych i stosują dostosowane kontrole. Badanie Gartnera z 2024 r. wykazało, że firmy korzystające ze zautomatyzowanych platform compliance zmniejszyły swoje cykle audytu o 39%. To przesunięcie w kierunku "bieżącej zgodności", jak opisuje to Mark Sharron z ISMS.online, skupia się na zbieraniu dowodów w czasie rzeczywistym, a nie na dokumentacji statycznej. Te kontrole nie tylko zwiększają bezpieczeństwo danych, ale także upraszczają ich integrację w systemach AI.

Zastosowanie do potoków danych AI

Rama ISO 27001 jest naturalnie przystosowana do systemów AI. Jej kontrole zarządzania zasobami (Załącznik A.8) wymagają, aby organizacje wymieniały swoje zasoby informacyjne, klasyfikowały je według czułości i definiowały odpowiednie procedury postępowania. W środowiskach AI obejmuje to katalogowanie zbiorów danych szkoleniowych, zbiorów walidacyjnych i wag modelowych obok tradycyjnych zasobów danych.

Określone zadania przygotowania danych - takie jak czyszczenie, etykietowanie i wzbogacanie - wpadają pod "Obsługę zasobów" (A.8.2.3). Bezpieczne transfery zbiorów danych między środowiskami są kierowane przez kontrole, takie jak "Transfer mediów fizycznych" (A.8.3.3) i miary bezpieczeństwa komunikacji. Tymczasem kontrole bezpieczeństwa operacyjnego (Załącznik A.12) i rozwoju systemu (Załącznik A.14) zapewniają bezpieczne przetwarzanie danych, efektywne zarządzanie zmianami i ogólną integralność potoków AI.

Jak wyjaśnia Pansy z Sprinto:

"ISO 27001 chroni system, a ISO 42001 kieruje decyzjami".

To rozróżnienie jest kluczowe. Podczas gdy ISO 27001 skupia się na zabezpieczeniu potoku danych, ramy takie jak Ustawa UE o AI zajmują się szerszymi kwestiami, takimi jak uczciwość i wyjaśnialność wyników AI. Razem tworzą komplementarne podejście do efektywnego zarządzania systemami AI.

sbb-itb-4566332

Porównanie Ustawy UE o AI i ISO 27001: Zarządzanie danymi

Ta sekcja zagłębia się w to, jak Ustawa UE o AI i ISO 27001 podchodzą do zarządzania danymi w cyklu życia AI, podkreślając ich rozróżnienia i pokrywające się obszary.

Porównanie funkcji

Ustawa UE o AI i ISO 27001 wybierają różne ścieżki, jeśli chodzi o zarządzanie danymi. Ustawa UE o AI to obowiązkowe rozporządzenie, gdzie niezastosowanie się do zakazanych praktyk może prowadzić do grzywien tak wysokich jak €35 000 000 lub 7% światowego rocznego obrotu. Z drugiej strony, ISO 27001 to dobrowolny standard certyfikacyjny, który organizacje przyjmują, aby wykazać zaangażowanie w bezpieczeństwo.

Ustawa UE o AI priorytetowo traktuje bezpieczeństwo, prawa podstawowe i zapobieganie stronniczości, szczególnie dla systemów AI wysokiego ryzyka. ISO 27001 natomiast skupia się na zabezpieczeniu wszystkich zasobów informacyjnych poprzez triadę CIA - poufność, integralność i dostępność. Podczas gdy Ustawa UE o AI podkreśla znaczenie wolnych od błędów i reprezentatywnych zbiorów danych szkoleniowych, ISO 27001 jest bardziej zainteresowany zabezpieczeniem ogólnego środowiska danych.

| Funkcja | Ustawa UE o AI (AI wysokiego ryzyka) | ISO 27001 |

|---|---|---|

| Status prawny | Obowiązkowy | Dobrowolny |

| Główny fokus | Bezpieczeństwo, prawa podstawowe, stronniczość | Bezpieczeństwo informacji (CIA) |

| Pokrycie danych | Zbiory szkoleniowe, walidacyjne, testowe | Wszystkie zasoby informacyjne |

| Wymóg stronniczości | Obowiązkowe wykrycie i łagodzenie | Nie jest wyraźnie rozwiązane |

| Kontrole bezpieczeństwa | Niezawodność AI i cyberbezpieczeństwo | 93 kontrole (wersja 2022) |

| Dokumentacja | Dokumentacja techniczna i ocena zgodności | Podręcznik ISMS, Deklaracja zastosowania |

Następnym krokiem jest zobaczenie, jak te ramy są wyrównane z etapami cyklu życia danych AI.

Etapy cyklu życia danych AI

Po zmapowaniu do cyklu życia danych AI różnice między Ustawą UE o AI i ISO 27001 stają się jeszcze bardziej widoczne. Na przykład, Artykuł 10 Ustawy UE o AI wymaga jasnej przejrzystości dotyczącej pochodzenia danych i celu podczas pozyskiwania. ISO 27001 dotyka tego poprzez inwentaryzację zasobów i kontrole dostawcy. Jednak ISO 27001 nie zajmuje się łagodzeniem stronniczości, pozostawiając organizacjom stworzenie oddzielnych przepływów pracy dla zarządzania AI.

| Etap cyklu życia | Obowiązki Ustawy UE o AI (Art. 10) | Kontrole ISO 27001 (Załącznik A) |

|---|---|---|

| Pozyskiwanie | Pochodzenie danych, pierwotny cel gromadzenia | Inwentaryzacja zasobów, Relacje z dostawcami |

| Etykietowanie/przygotowanie | Adnotacja, etykietowanie, czyszczenie, agregacja | Klasyfikacja informacji, Maskowanie danych |

| Szkolenie/walidacja | Ocena reprezentatywności, identyfikacja luk w danych | Bezpieczne środowisko rozwojowe, Zarządzanie zmianami |

| Łagodzenie stronniczości | Wykrycie i korekta zakazanej dyskryminacji | Nie dotyczy (wymaga oddzielnego zarządzania AI) |

| Przechowywanie | Usunięcie danych specjalnych po korekcie stronniczości | Przechowywanie i utylizacja zasobów informacyjnych |

Pokrywanie się i różnice

Choć oba ramy mają wspólne elementy, służą różnym celom. Na przykład, zarówno rejestrowanie, jak i kontrole dostępu są wymagane, ale ich cele się różnią. Ustawa UE o AI nakazuje "automatycznie generowane dzienniki" w celu śledzenia decyzji AI z powrotem do ich źródeł danych (Artykuł 12), podczas gdy ISO 27001 wykorzystuje rejestrowanie do monitorowania bezpieczeństwa i reagowania na incydenty. Organizacje z dobrze ugruntowanymi wdrożeniami ISMS mogą już spełniać do 80% wymogów cyberbezpieczeństwa Ustawy UE o AI, co daje im przewagę.

Główne rozróżnienie leży w jakości danych versus bezpieczeństwo danych. Ustawa UE o AI pozwala na przetwarzanie wrażliwych danych osobistych - takich jak rasa, religia i zdrowie - w celu wykrycia stronniczości. W przeciwieństwie do tego, ISO 27001 stosuje bardziej ogólne kontrole do ochrony wrażliwych danych. Jak trafnie wyjaśnia Gnanendra Reddy, audytor wiodący ISO/IEC 27001:

"Ustawa UE o AI to zestaw zasad, a ISO/IEC 42001 to system operacyjny, który sprawia, że zgodność jest powtarzalna i poddająca się audytowi".

Budowanie zintegrowanego modelu zarządzania danymi

Ustawa UE o AI określa "co", podczas gdy ISO 27001 zapewnia "jak", ustanawiając solidne ramy operacyjne. Razem tworzą bezproblemowe podstawy do mapowania wymogów i uproszczenia wdrażania.

Mapowanie wymogów Ustawy UE o AI do kontroli ISO 27001

Aby ustanowić jasny i śledzalny proces, organizacje mogą wyrównać wymogi Ustawy UE o AI z kontrolami ISO 27001. Na przykład, mandat Artykułu 10 do dokumentu pochodzenia danych i celu gromadzenia (Artykuł 10[2b]) łączy się z kontrolami Zarządzania zasobami (A.8) w ISO 27001, które już podkreślają inwentaryzowanie zasobów informacyjnych. Podobnie, wymogi przygotowania danych, etykietowania i czyszczenia są wyrównane z bezpieczeństwem operacyjnym (A.12), zapewniając, że przetwarzanie i transformacja danych są dobrze uregulowane.

| Wymóg Ustawy UE o AI (Art. 10) | Odpowiednia domena kontroli ISO 27001 | Działanie operacyjne |

|---|---|---|

| Gromadzenie i pochodzenie danych (2b) | Zarządzanie zasobami (A.8) | Kataloguj źródła danych i dokumentuj ich cel. |

| Przygotowanie/etykietowanie danych (2c) | Bezpieczeństwo operacyjne (A.12) | Stosuj kontrolowane metody adnotacji i czyszczenia. |

| Wykrycie i łagodzenie stronniczości (2f, 2g) | Ocena ryzyka (A.12.6 / A.14.2) | Przeprowadź testy techniczne i dokumentuj kroki łagodzenia. |

| Dokumentacja techniczna (Art. 11) | Dokumentacja (A.5 / A.18) | Utrzymuj wersjonowane karty modelu i rekordy projektów. |

| Rejestrowanie i prowadzenie dokumentacji (Art. 12) | Rejestrowanie i monitorowanie (A.12.4) | Zdefiniuj oparte na ryzyku polityki przechowywania dzienników i kontroli dostępu. |

Tworząc macierz wymóg-do-testu, która łączy artykuły Ustawy UE o AI z kontrolami ISO i powiązanymi testami, zgodność staje się procesem ustrukturyzowanym i możliwym do śledzenia. Na przykład wymogi rejestrowania zazwyczaj obejmują okresy przechowywania od 180 do 365 dni, wyrównując obie ramy.

Po ustaleniu tych wyrównań fokus przesuwa się na osadzenie tych kontroli w codziennych przepływach pracy.

Wdrażanie zarządzania danymi AI

Połączenie tych ram przekształca zgodność z listy kontrolnej w spójny, operacyjny system. Budując na istniejącej ramie ISMS i wykorzystując cykl PDCA (Plan-Do-Check-Act), możesz zintegrować kontrole specyficzne dla AI bez rozpoczynania od zera. Może to obejmować:

- Rozszerzenie procesów zarządzania dostawcami, aby objąć dostawcy danych szkoleniowych AI.

- Wdrożenie ciągłego monitorowania w celu wykrycia dryfu modelu.

- Planowanie regularnych przeglądów w celu zidentyfikowania i rozwiązania stronniczości.

Model "Trzech linii obrony" sprawdza się dobrze w zarządzaniu AI. W tej konfiguracji zespoły operacyjne zarządzają ryzykami podczas tworzenia (linia 1.), zespoły ryzyka i prawne zapewniają nadzór (linia 2.), a audyt wewnętrzny zapewnia niezależne kontrole (linia 3.). Centralna inwentaryzacja modelu staje się niezbędna do śledzenia metadanych, takich jak typy danych, algorytmy i konteksty wdrożenia. Jest to szczególnie ważne, ponieważ badanie z 2024 r. obejmujące 624 przypadki użycia AI wykazało, że 30% modeli zostało opracowanych przez osoby trzecie, przy czym niektóre organizacje nie mogą zidentyfikować używanych algorytmów.

Utrzymywanie zunifikowanego pliku zgodności jest kolejnym kluczowym krokiem. Ten plik mapuje każdy wymóg systemu AI do odpowiednich polityk, testów i wyników monitorowania, zapewniając, że dokumentacja zgodności jest scentralizowana i łatwo dostępna do przeglądów regulacyjnych.

Użycie ISMS Copilot do zintegrowanej zgodności

ISMS Copilot upraszcza proces integracji, działając jako asystent zasiedzony sztuczną inteligencję, który łączy wymogi prawne z kontrolami ISO. Automatycznie mapuje wymogi zarządzania danymi Artykułu 10 Ustawy UE o AI do kontroli ISO 27001, eliminując potrzebę ręcznego odsyłacza. Platforma pomaga również opracować krytyczne dokumenty - takie jak polityki cyklu życia danych, rejestry ryzyka i pliki zgodności - jednocześnie łącząc każdy obowiązek z odpowiadającymi dowodem.

Automatyzując śledzenie dowodów i wykorzystując cykl PDCA, ISMS Copilot zmienia audyty w prostych zadaniach pobierania danych. Osadza również zarządzanie danymi AI w powtarzalnych operacjach biznesowych. Organizacje mogą użyć narzędzia do zdefiniowania swoich ról w ramach Ustawy UE o AI (np. jako dostawcy, wdrażający lub oba), wdrożenia ograniczonego rejestrowania i automatyzacji dokumentacji wykrywania stronniczości w celu zgodności z Artykułem 10, zapewniając specjalne kategorie danych osobistych są przetwarzane i usuwane odpowiednio.

Dzięki wsparciu dla ponad 20 ram, w tym ISO 27001, ISO 42001 i Ustawy UE o AI, ISMS Copilot umożliwia organizacjom zarządzanie zunifikowanym modelem zgodności zamiast żonglowania rozmienionymi systemami. Jest to szczególnie ważne ze względu na fakt, że chociaż 96% przedsiębiorstw już używa AI, tylko 5% ma formalnych ram zarządzania AI.

Podsumowanie

Ustawa UE o AI i ISO 27001 nie są rywalami - współpracują ze sobą. Ustawa o AI określa, co muszą robić organizacje, aby zapewnić, że systemy AI są bezpieczne, przejrzyste i szanują prawa podstawowe. Tymczasem ISO 27001 zapewnia ustrukturyzowany System Zarządzania Bezpieczeństwem Informacji (ISMS), aby pomóc w operacionalizacji tych wymogów w skuteczny sposób.

Rosnące przyjęcie tych ram podkreśla pilność zintegrowanego zarządzania. Łącząc siły obydwu, organizacje mogą radzić sobie z tradycyjnymi ryzykami bezpieczeństwa informacji - takimi jak naruszenia danych i nieautoryzowany dostęp - wraz z kwestiami specyficznymi dla AI, takimi jak stronniczość modelu i przejrzystość podejmowania decyzji.

Integracja to nie tylko zaznaczanie pól do zgodności; to ruch strategiczny. Mapowanie wymogów Ustawy UE o AI do kontroli ISO 27001 i osadzenie ich w istniejących cyklach Plan-Do-Check-Act tworzy zunifikowany system. To podejście nie tylko upraszcza audyty, ale również pozycjonuje biznes do spełnienia przyszłych regulacji, ponieważ globalne wysiłki standaryzacyjne coraz bardziej wyrównują wymogi UE z ramami ISO/IEC.

Główne wnioski

Zunifikowana strategia zgodności oferuje namacalne korzyści. Oto jak zacząć:

Wykorzystaj swój istniejący ISMS.

Rozszerz swoje kontrole ISO 27001, aby zająć się wyzwaniami specyficznymi dla AI, takimi jak wykrycie stronniczości i jakość zbiorów danych. Z szacunkowym 80% pokrywaniem się między ISO 27001 a innymi ramami, takimi jak SOC 2, te systemy naturalnie się uzupełniają.

Scentralizuj swoją inwentaryzację AI.

Utrzymuj szczegółową dokumentację dla każdego systemu AI, w tym typy danych, algorytmy, konteksty wdrożenia i czy działasz jako dostawca czy wdrażający.

Automatyzuj wyrównanie ram.

Narzędzia, takie jak ISMS Copilot, mogą usprawnić zgodność poprzez automatyczne mapowanie wymogów Artykułu 10 Ustawy UE o AI do kontroli ISO 27001. Te narzędzia również opracowują pliki zgodności i śledzą dowody w wielu ramach, oszczędzając czas i zmniejszając błędy, gdy obowiązki Ustawy o AI wchodzą w życie.

Porzuć przestarzałe metody zarządzania.

Polityki na papierze bez bieżących przeglądów lub wskaźników często nie przechodzą audytów. Zamiast tego osadź zarządzanie AI w codziennych operacjach poprzez ciągłe monitorowanie, regularne przeglądy stronniczości i ograniczone rejestrowanie (zwykle 180 do 365 dni), które wyrównuje się z obydwiema ramami.

Organizacje, które osiągają sukces w ramach Ustawy UE o AI, wyjdą poza podstawową zgodność. Zintegrują wymogi prawne z najlepszymi praktykami operacyjnymi, wykorzystując ISO 27001 jako podstawę dla skalowalnego, poddającego się audytowi zarządzania AI. Dzięki odpowiednim narzędziom i mentalności, zgodność zmienia się z przeszkody regulacyjnej w przewagę konkurencyjną.

Często zadawane pytania

Jak Ustawa UE o AI i ISO 27001 współpracują ze sobą w celu efektywnego zarządzania systemami AI?

Ustawa UE o AI ustanawia ramy prawne dla AI, podkreślając klasyfikacje oparte na ryzyku, przejrzystość, odpowiedzialność i wymogi zarządzania danymi (takie jak określone w Artykule 10). Miary te mają na celu zapewnienie, że systemy AI pozostają łatwe do audytu i wiarygodne. Tymczasem ISO 27001 zapewnia ustrukturyzowane podejście poprzez System Zarządzania Bezpieczeństwem Informacji (ISMS) do zabezpieczenia poufności, integralności i dostępności danych poprzez oceny ryzyka, kontrole i ciągłe doskonalenia.

Poprzez integrację ISMS wyrównanego z ISO 27001, organizacje mogą mapować kluczowe procesy - takie jak zarządzanie ryzykiem i kontrole dostępu - bezpośrednio do wymogów Ustawy UE o AI. To wyrównanie pomaga spełnić oczekiwania Ustawy dotyczące obsługi danych, monitorowania i prowadzenia dokumentacji. Zasadniczo Ustawa o AI określa co musi być osiągnięte, podczas gdy ISO 27001 oferuje przewodnik na temat jak to osiągnąć. Narzędzia, takie jak ISMS Copilot, mogą usprawnić ten proces poprzez łączenie kontroli ISO 27001 z konkretnymi klauzulami Ustawy o AI, dostarczając polityki, szablony i dowody audytu w celu efektywnego rozwiązania obu standardów.

Jaka jest różnica między obowiązkową a dobrowolną zgodności w zarządzaniu danymi?

Zgodność obowiązkowa, taka jak Ustawa UE o AI, zobowiązuje organizacje do przestrzegania ścisłych, prawnie wiążących zasad dotyczących zarządzania danymi. Oznacza to, że muszą ustanowić procedury zarządzania ryzykiem, zapewnić jakość danych i prowadzić dokładne rejestrów. Niewywiązanie się z tych wymogów może prowadzić do wysokich grzywien lub nawet utraty dostępu do niektórych rynków.

Z drugiej strony, zgodność dobrowolna - taka jak ISO 27001 - oferuje inne podejście. Choć nie jest prawnie wymagana, polega na przyjęciu najlepszych praktyk poprzez System Zarządzania Bezpieczeństwem Informacji (ISMS). Organizacje często wybierają tę drogę, aby zwiększyć swoją reputację, wzmocnić środki bezpieczeństwa i osiągnąć certyfikacje. Jednak nie ma konsekwencji prawnych za jej pominięcie.

Główne rozróżnienia sprowadzają się do egzekwowania prawnego versus opcjonalnego uczestnictwa, kar regulacyjnych versus przewag reputacyjnych i ścisłych mandatów versus elastycznych, dostosowanych ram.

Jak organizacje mogą włączyć wymogi specyficzne dla AI do swoich ram ISO 27001?

Aby włączyć wymogi specyficzne dla AI do ramy ISO 27001, zacznij od poszerzenia procesu oceny ryzyka, aby uwzględnić wyzwania związane z AI, takie jak dryf modelu, stronniczość danych i nieautoryzowany dostęp do modelu. Powiąż te ryzyka z odpowiednimi kontrolami ISO 27001, takimi jak zarządzanie zmianami, zarządzanie dostępem uprzywilejowanym i relacje z dostawcami. To podejście zapewnia, że ryzyka związane z AI są rozwiązywane w istniejącej strukturze Systemu Zarządzania Bezpieczeństwem Informacji (ISMS).

Ponadto wyrównaj swoje polityki z Ustawą UE o AI, skupiając się na jej wymogach zarządzania danymi. Zintegruj praktyki, takie jak kontrole jakości danych, śledzenie pochodzenia i limity przechowywania do procedur ISMS. Te aktualizacje mogą być sformalizowane jako polityki "Zarządzania danymi AI", uzupełniające twoje obecne kontrole klasyfikacji i obsługi danych.

Dla bardziej zorganizowanej strategii możesz rozważyć warstwowanie ISO/IEC 42001 (standard systemu zarządzania AI) na szczycie ISO 27001. To tworzy spójną ramę do zarządzania zarówno AI, jak i bezpieczeństwem informacji. Narzędzia, takie jak ISMS Copilot, mogą ułatwić ten proces poprzez automatyzację mapowania ryzyka, dostarczanie szablonów i usprawniane dokumentacji, umożliwiając ci spełnianie zarówno standardów AI, jak i bezpieczeństwa informacji bardziej efektywnie.

Powiązane wpisy na blogu

Powiązane artykuły

Jak sztuczna inteligencja wspomaga zgodność z wieloma standardami

Sztuczna inteligencja ujednolica mapowanie kontroli, automatyzuje zbieranie dowodów i zapewnia monitorowanie w czasie rzeczywistym, aby skrócić czas przygotowania do audytu i zmniejszyć błędy compliance.

Jak alerty w czasie rzeczywistym zmniejszają ryzyko niezgodności ISO 27001

Alerty w czasie rzeczywistym wykrywają zagrożenia szybko, zmniejszają koszty naruszeń i awarii audytu, oraz utrzymują logi ISO 27001 odporne na manipulacje w celu ciągłej zgodności.

Dokładność AI w bezpieczeństwie: Specjalizowane vs Ogólne

Specjalizowane AI pokonuje modele ogólne w zgodności bezpieczeństwa—wyższa dokładność, mniej halucynacji i dokumentacja gotowa do audytu dla ISO 27001 i GRC.