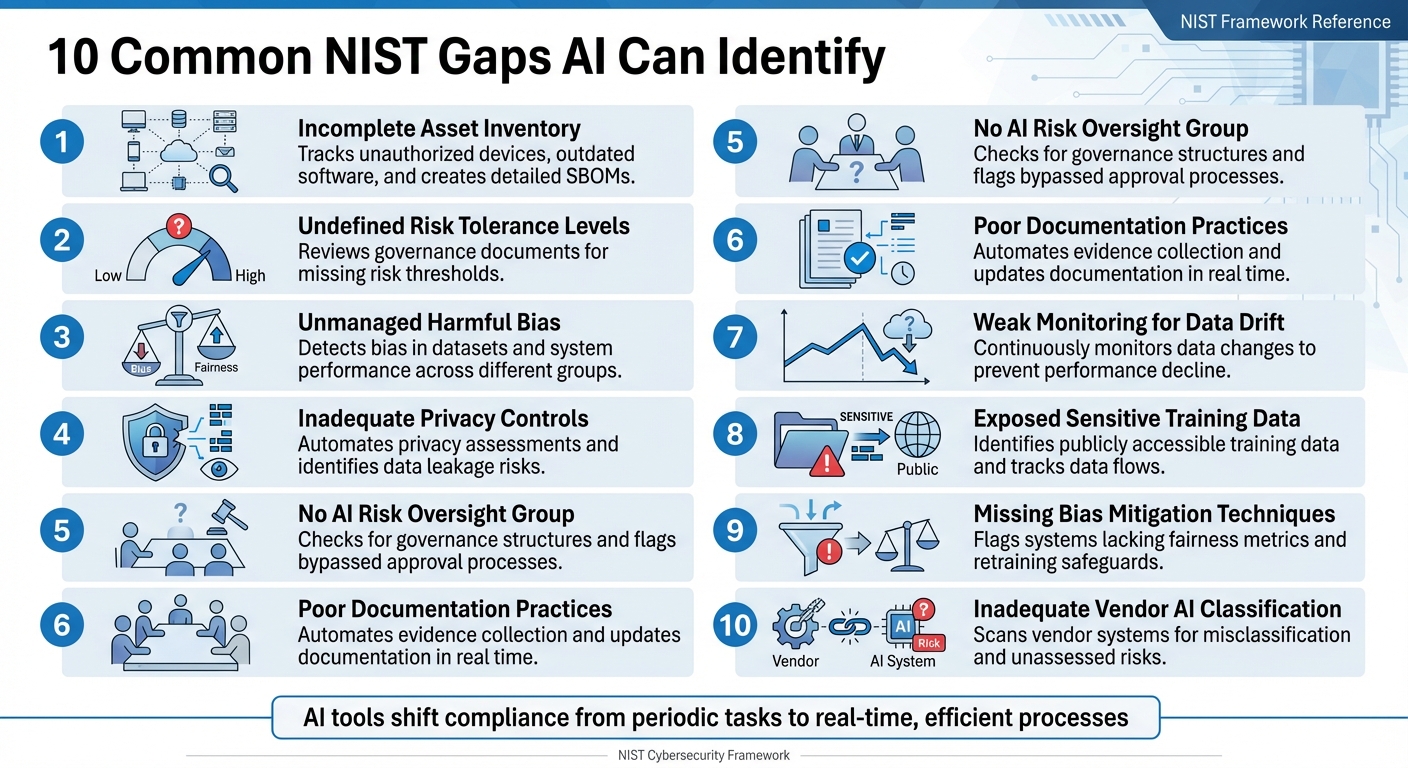

10 typowych luk NIST, które może zidentyfikować sztuczna inteligencja

Sztuczna inteligencja automatyzuje analizę luk NIST - identyfikując zasoby, stronniczość, prywatność, dryft danych i ryzyka związane z dostawcami, generując gotowe do audytu dowody.

Organizacje często borykają się z osiągnięciem pełnej zgodności z NIST Cybersecurity Framework (CSF), szczególnie z jego najnowszą wersją CSF 2.0. Audyty manualne są powolne i podatne na błędy, zostawiając luki w obszarach takich jak śledzenie zasobów, zarządzanie ryzykiem i kontrole prywatności. Narzędzia oparte na sztucznej inteligencji zmieniają grę poprzez automatyzację kontroli zgodności, zapewnienie ciągłego monitorowania i identyfikację luk w czasie rzeczywistym. Oto 10 typowych luk zgodności NIST, które może rozwiązać sztuczna inteligencja:

- Niekompletny inwentarz zasobów: Sztuczna inteligencja śledzi nieautoryzowane urządzenia, przestarzałe oprogramowanie i tworzy szczegółowe Materiały Rachunkowości Oprogramowania (SBOM).

- Niezdefiniowane poziomy tolerancji ryzyka: Sztuczna inteligencja przegląda dokumenty zarządzające w poszukiwaniu brakujących progów ryzyka.

- Niekontrolowana stronniczość: Sztuczna inteligencja wykrywa stronniczość w zbiorach danych i wydajności systemu w różnych grupach.

- Nieadekwatne kontrole prywatności: Sztuczna inteligencja automatyzuje oceny prywatności i identyfikuje ryzyka, takie jak przeciek danych.

- Brak grupy nadzoru nad ryzykiem AI: Sztuczna inteligencja sprawdza struktury zarządzania i oznacza obejście procesów zatwierdzania.

- Słabe praktyki dokumentacji: Sztuczna inteligencja automatyzuje gromadzenie dowodów i aktualizuje dokumentację w czasie rzeczywistym.

- Słabe monitorowanie dryftu danych: Narzędzia sztucznej inteligencji ciągle monitorują zmiany danych, aby zapobiec spadkowi wydajności.

- Ujawnione wrażliwe dane treningowe: Sztuczna inteligencja identyfikuje ryzyka, takie jak publicznie dostępne dane treningowe i śledzi przepływy danych.

- Brakujące techniki łagodzenia stronniczości: Sztuczna inteligencja oznacza systemy pozbawione metryk uczciwości i zabezpieczeń przebycia.

- Nieadekwatna klasyfikacja AI dostawców: Sztuczna inteligencja skanuje systemy dostawców w poszukiwaniu błędnej klasyfikacji i niezaktualizowanych ryzyk.

Narzędzia AI, takie jak ISMS Copilot, usprawniają zgodność poprzez automatyzację analizy luk, wyrównanie kontroli ze standardami NIST i generowanie dokumentacji gotowej do audytu. To zmienia zgodność z zadania okresowego na efektywny proces w czasie rzeczywistym.

10 typowych luk zgodności NIST, które może zidentyfikować i rozwiązać sztuczna inteligencja

GRC - Analiza luk 101 przy użyciu NIST RMF i zgodności CIS Controls

1. Niekompletny inwentarz zasobów

Posiadanie dokładnego inwentarza zasobów jest kluczowe dla spełnienia wymagań zgodności NIST. Tymczasem wiele organizacji boryka się ze śledzeniem każdego urządzenia, aplikacji i komponentu oprogramowania, którego używa. Gdy zasoby pozostają nieśledzone, tworzą luki, które atakujący mogą wykorzystać.

Copilot NIST 800-53 może pomóc poprzez porównanie rzeczywistego stanu sieci z pożądanym stanem. Ciągłe skanowanie podkreśla wszelkie odchylenia od zatwierdzonej listy zasobów, ułatwiając wykrycie problemów, takich jak nieautoryzowane urządzenia lub przestarzałe oprogramowanie pozbawione krytycznych poprawek bezpieczeństwa. Ten ciągły proces nie tylko wzmacnia zarządzanie ryzykiem, ale także dostarcza cennych informacji na temat bezpieczeństwa sieci.

"Fokus zdolności SWAM to zarządzanie ryzykiem stworzonym przez niezarządzane lub nieautoryzowane oprogramowanie w sieci. Niezarządzane lub nieautoryzowane oprogramowanie to cel, którego atakujący mogą użyć jako platformy do atakowania komponentów w sieci." – NIST IR 8011 Vol. 3

Poza skanowaniem, dashboardy CDM oferują widoczność w czasie rzeczywistym na temat inwentarza zasobów, odchodząc od przestarzałych, statycznych audytów na rzecz ciągłego monitorowania. Systemy AI mogą również automatycznie tworzyć szczegółowe Materiały Rachunkowości Oprogramowania (SBOM) dla każdego kompilowania oprogramowania, katalogując każdy komponent i zależność - zarówno bezpośrednią, jak i pośrednią. Ta funkcjonalność jest coraz ważniejsza, ponieważ prawie 220 000 organizacji w Stanach Zjednoczonych musi być zgodnych ze standardami CMMC, z czego 80 000 podlega kontroli poziomu 2, które są wyrównane do NIST SP 800-171.

Aby ulepszyć inwentarz zasobów, rozważ użycie tagów Software Identification (SWID) do automatyzacji odkrywania oprogramowania w sieci. Możesz również wdrożyć automatyczne whitelisting, aby upewnić się, że może działać tylko autoryzowane oprogramowanie. W przypadku systemów AI niezbędne jest inwentaryzowanie nie tylko sprzętu, ale także integracji innych firm, od których zależy, ponieważ te zewnętrzne komponenty mogą wprowadzić dodatkowe ryzyka.

2. Niezdefiniowane poziomy tolerancji ryzyka

Wiele organizacji dostrzega ryzyka związane ze sztuczną inteligencją, ale często nie ustanawia jasnych progów określających, co jest dopuszczalne. Bez tych określonych granic zespoły mogą mieć trudności w określeniu, czy należy przejść do przodu, czy wstrzymać projekt. Tu przychodzą z pomocą narzędzia AI. Używając przetwarzania języka naturalnego, asystenci ISMS między frameworkami mogą przejrzeć polityki, strategie zarządzania ryzykiem i struktury zarządzania w celu potwierdzenia, czy ustalono określone kryteria - takie jak limity ilościowe lub granice jakościowe - dla różnych aplikacji AI. Na przykład systemy obsługujące wrażliwe dane, takie jak informacje umożliwiające identyfikację osoby (PII), wymagają bardziej rygorystycznych progów w celu zapewnienia bezpieczeństwa i zgodności. Gdy te zabezpieczenia są brakujące, natychmiast wymagane jest działanie naprawcze, jak podkreśla NIST.

"W zakresie, w jakim wyzwania związane ze specyfikacją tolerancji ryzyka AI pozostają nierozwiązane, mogą istnieć konteksty, w których ramy zarządzania ryzykiem nie są jeszcze łatwo stosowalne do łagodzenia negatywnych ryzyk AI." - NIST AI RMF 1.0

NIST definiuje tolerancję ryzyka jako "gotowość organizacji lub aktora AI do ponoszenia ryzyka w celu osiągnięcia jej celów". Narzędzia AI odgrywają kluczową rolę w skanowaniu dokumentów zarządzających w celu sprawdzenia, czy wyraźnie udokumentowano kryteria akceptacji ryzyka, czy to z udziałem limitów numerycznych, czy szerszych granic jakościowych. Jednak struktura zarządzania ryzykiem AI NIST, wprowadzona 26 stycznia 2023 r., nie nakazuje określonych poziomów tolerancji. Zamiast tego podkreśla znaczenie identyfikacji luk - takich jak brakująca dokumentacja dotycząca pozostałego ryzyka lub niejasne strategie zarządzania ryzykiem - które mogą narazić organizacje.

NIST oferuje jasną dyrektywę dla takich scenariuszy:

"W przypadkach, gdy system AI prezentuje niedopuszczalne ujemne poziomy ryzyka... opracowanie i wdrożenie powinno być wstrzymane w bezpieczny sposób aż do momentu, gdy ryzyka będą mogły być wystarczająco zarządzane." - NIST AI RMF 1.0

3. Niekontrolowana szkodliwa stronniczość

Stronniczość w systemach AI wynika z interakcji kodu, danych treningowych i szerszego kontekstu społecznego. Bez odpowiednich polityk zgodności, systemy te mogą niezamierzone pogorszyć istniejące nierówności lub nawet stworzyć nowe wzorce dyskryminacji. Ma to rzeczywiste konsekwencje w obszarach takich jak opieka zdrowotna, zatrudnienie i finanse. Problem jest zaostrzony złożonością systemów AI, które często obejmują niezliczone punkty decyzyjne, co sprawia, że prawie niemożliwe jest ręczne zidentyfikowanie i wyeliminowanie stronniczości. Organizacje często zwracają się do asystenta zgodności AI w celu zarządzania tymi złożonymi wieloetapowymi przepływami pracy.

"Bez odpowiednich kontroli, systemy AI mogą wzmacniać, utrwalać lub zaostrzać nierówne lub niepożądane wyniki dla jednostek i społeczności." - NIST AI RMF 1.0

Narzędzia AI radzą sobie ze szkodliwą stronniczością poprzez procesy takie jak Test, Ocena, Weryfikacja i Walidacja (TEVV), jak opisano w funkcji MEASURE ramy NIST AI RMF. Te procesy oceniają, czy zbiory danych treningowych są zgodne z ich przeznaczeniem i odzwierciedlają bieżące warunki społeczne. Automatyczne monitorowanie odgrywa kluczową rolę tutaj, identyfikując "dryft danych", który odnosi się do zmian w danych wejściowych, które mogą wpłynąć na wydajność systemu i wprowadzić nowe stronniczości, które mogły nie być obecne podczas początkowego testowania.

Ten proces detekcji wykracza poza obliczanie liczb. Narzędzia AI oceniają, jak systemy działają w różnych podgrupach, uznając, że mogą być dotkniętymi osobami, które bezpośrednio nie korzystają z systemu. Takie podejście, często nazywane oceną socjotechniczną, uwzględnia nie tylko projekt techniczny, ale także to, jak wchodzi w interakcję z normami społecznymi i ludzkim zachowaniem, aby wytworzyć nierówności. Aby zapewnić obiektywność, NIST opowiada się za wyraźnym podziałem odpowiedzialności - zespoły budujące modele AI powinny być oddzielone od tych weryfikujących i walidujących je. Ta konfiguracja pozwala na bardziej bezstronne oceny i ciągłe monitorowanie stronniczości na wszystkich grupach użytkowników.

Inną kluczową strategią zarządzania stronniczością jest ulepszone śledzenie danych. Na przykład organizacje korzystające z narzędzi widoczności natywnej do AI odnotowały oszałamiający wzrost 1660% w ich zdolności do monitorowania działań przetwarzania danych w ciągu zaledwie trzech tygodni od wdrożenia. Te narzędzia mapują "Podróże Danych", śledząc, jak dane przepływają ze źródła przez modele AI. Dzięki temu mogą przewidzieć i zapobiec potencjalnym naruszeniom w czasie rzeczywistym. Jest to krytyczne, ponieważ AI przetwarza dane w prędkościach znacznie przekraczających to, co mogą obsługiwać zespoły manualne. Śledzenie tych przepływów danych jest niezbędne do wychwycenia zmian, które mogą prowadzić do nowych lub pogorszonych stronniczości, zanim spowodują szkody.

4. Nieadekwatne kontrole prywatności

Szybkie tempo i skala systemów AI czynią luki w prywatności istotnym problemem, szczególnie dlatego, że ręczny nadzór ma trudności z utrzymaniem tempa. Bez odpowiednich zabezpieczeń prywatności, organizacje ryzykują ujawnienie osobowych informacji umożliwiających identyfikację (PII) poprzez wycieki danych treningowych, nieautoryzowany dostęp lub niezamierzone ujawnienia w wynikach modelu. Poleganie na interfejsach API do pozyskiwania danych i wnioskowania dodatkowo zwiększa powierzchnię ataku, czyniąc solidne kontrole prywatności koniecznością.

Aby rozwiązać te wyzwania, narzędzia AI, w tym wyspecjalizowani asystenci zgodności, automatyzują oceny kontroli prywatności używając formatów czytelnych dla maszyn, takich jak OSCAL. Te narzędzia ciągle oceniają kontrole zawarte w ramach takich jak NIST SP 800-53, wykorzystując formaty takie jak JSON, XML i YAML. Warto zauważyć, że 27 sierpnia 2025 r. NIST wydało wersję 5.2.0 SP 800-53, która w pełni zintegrowała kontrole prywatności do szerszego katalogu kontroli bezpieczeństwa, odchodząc od wcześniejszego podejścia jako samodzielnego dokumentu.

"Rozwiązanie funkcjonalności i pewności pomaga zapewnić, że produkty technologiczne informacyjne i systemy polegające na tych produktach są wystarczająco godne zaufania." - Joint Task Force, NIST SP 800-53 Rev. 5

Narzędzia zautomatyzowane skupiają się na rodzinie kontroli PII Processing and Transparency (PT) w celu zidentyfikowania nieautoryzowanego użycia PII, ujawnień lub ryzyk de-anonimizacji. Ukazują również shadow API i shadow AI, które manualne audyty często pomijają. Poprzez wdrożenie "Policy-as-Code", organizacje mogą konwertować złożone wymagania NIST SP 800-53 na rzeczywiste reguły operacyjne w czasie rzeczywistym. Proces ten jest usprawniany, gdy organizacje trenują swoich asystentów zgodności AI na modelach o wysokiej dokładności przeznaczonych dla GRC. Te reguły automatycznie redagują wrażliwe dane z monitów i wyników AI, zanim zostaną przetworzone przez model.

Dodatkowo, oprogramowanie Dioptra NIST wspiera ćwiczenia red-teamingu, pomagając organizacjom testować kontrole prywatności i bezpieczeństwa w warunkach antagonistycznych. Te symulacje mogą mierzyć straty w wydajności i identyfikować określone luki w zabezpieczeniach. Jest to szczególnie ważne biorąc pod uwagę, że profil Generative AI z ramy NIST AI RMF zawiera 12 unikalnych lub podwyższonych ryzyk związanych z AI, w tym obawy dotyczące prywatności danych, takie jak wyciek i nieautoryzowana de-anonimizacja. 14 kwietnia 2025 r. NIST dodatkowo podkreślił te kwestie, wydając projekt Privacy Framework 1.1, który konkretnie odnosi się do ryzyk prywatności związanych z AI, takich jak ataki inferencyjne i wzmacnianie stronniczości.

5. Brak grupy nadzoru nad ryzykiem AI

Jednym z głównych wyzwań w zarządzaniu ryzykiem AI jest brak dedykowanej grupy nadzoru. Bez takiego komitetu, zarządzanie i odpowiedzialność często upadają na głowę, prowadząc do fragmentarycznych i niskopriorytętowych wysiłków. Dzisiaj zaawansowane narzędzia wykorzystujące przetwarzanie języka naturalnego (NLP) mogą pomóc rozwiązać tę lukę poprzez analizę polityk organizacyjnych, statutów i protokołów spotkań. Te narzędzia mogą potwierdzić, czy istnieje formalna grupa nadzoru nad ryzykiem AI i zapewnić wyrównanie z funkcją "Govern" ramy NIST AI RMF - szczególnie Govern 1.2, która podkreśla potrzebę wyraźnych struktur zarządzania i odpowiedzialności.

Systemy oparte na sztucznej inteligencji również badają schematy organizacyjne i systemy zarządzania tożsamością w celu zidentyfikowania formalnych ról nadzorczych w zarządzaniu ryzykiem AI. Platformy zarządzające dodają kolejną warstwę ochrony poprzez oznaczanie projektów, które omijają formalne procesy zatwierdzania. Zapewnia to ciągły nadzór, kluczowy element przestrzegania NIST RMF. Funkcja "Govern" stanowi fundament, wpływając na wszystkie inne funkcje RMF, takie jak Map, Measure i Manage. To połączone podejście wzmacnia całą ramę.

"Bez określonej odpowiedzialności, wysiłki w zakresie zarządzania ryzykiem AI mogą stać się fragmentaryczne lub otrzymać niższy priorytet, narażając organizację." - Kezia Farnham, Senior Manager, Diligent

Pilność prawidłowego nadzoru jest podkreślona szybkim wzrostem inwestycji w AI i regulacji. W 2024 r. inwestycje sektora prywatnego w USA w AI przekroczyły 100 miliardów dolarów, podczas gdy wzmianki o AI w globalnym ustawodawstwie wzrosły o 21,3% w 75 krajach od 2023 r. - oszałamiający wzrost dziewięciokrotny od 2016 r. Bez formalnych mechanizmów nadzoru, organizacje ryzykują upadek z zgodności z pojawiającymi się regulacjami, takimi jak prawo AI UE i amerykańskie Executive Order 14110, które podkreślają znaczenie nadzoru człowieka i audytowalnego zarządzania ryzykiem.

Aby przezwyciężyć tę lukę, organizacje powinny utworzyć wielofunkcyjny komitet ds. ryzyka AI, który obejmuje kluczowych liderów, takich jak General Counsel, Chief Information Security Officer (CISO), Chief Risk Officer i liderów AI/ML. Przypisanie odpowiedzialności za AI RMF jednemu kierownikowi - często kierownikowi ds. ryzyka lub pracodawcy - może dodatkowo scentralizować odpowiedzialność. Dodatkowo, wdrożenie specjalnie zaprojektowanego asystenta zgodności AI może uprościć ten proces, automatyzując mapowanie ról i obowiązków oraz zastępując przestarzałe ręczne arkusze kalkulacyjne ciągłymi systemami monitorowania.

6. Słabe praktyki dokumentacji

Opierając się na wcześniejszych problemach ze śledzeniem zasobów i nadzorem, słaba dokumentacja dodatkowo podważa wysiłki w zakresie zgodności. Luki w dokumentacji są zarówno rozpowszechnione, jak i kosztowne w przypadku zgodności NIST. Uderzające 86% organizacji brakuje widoczności w przepływach danych AI, prowadząc do znaczących luk w dokumentacji i audycie, które mogą stanowić kłopot podczas przeglądu regulacyjnego. Na przykład, gdy audytorzy żądają dzienników interakcji AI obejmujących dane osobowe, wiele organizacji nie jest w stanie ich dostarczyć. To nieprzestrzeganie narusza kluczowe przepisy, takie jak GDPR Artykuł 30, CCPA Sekcja 1798.130 i HIPAA § 164.312.

Platformy zgodności oparte na AI oferują praktyczne rozwiązanie, zastępując przestarzałe ręczne arkusze kalkulacyjne dashboardami w czasie rzeczywistym. Te dashboardy automatycznie oznaczają brakujące dowody i kwestie dokumentacji. Wykorzystują również ciągłe monitorowanie kontroli do wykrywania "dryfu" - przypadków, w których bieżąca dokumentacja lub polityka nie są już zgodne z rzeczywistym stanem systemów lub infrastruktury. Narzędzia zautomatyzowane przechwytują konfiguracje i dzienniki w czasie rzeczywistym, tworząc kompleksowe szlaki audytu.

"Traktowanie każdej zmiany, wdrożenia i incydentu jako zdarzenia dokumentacyjnego zapewnia stały wzrost dowodów, które są znacznie bardziej niezawodne niż pospieszone działania po zdarzeniu." - Abnormal AI

Zasada "dokumentuj w trakcie działania" wzmacnia zgodność poprzez przechwytywanie dowodów w czasie rzeczywistym. Poprzez integrację z narzędziami takimi jak wiki kontrolowane wersją i systemy ticketingu, AI zapewnia, że zatwierdzenia i zrzuty ekranu są dołączone do pull requestów. Jest to szczególnie krytyczne, biorąc pod uwagę, że tylko 17% organizacji wdrożyło zautomatyzowane kontrole bezpieczeństwa AI zdolne do dostarczenia dzienników wymaganych do audytów regulacyjnych.

Organizacje wykorzystujące zautomatyzowane platformy zgodności widzą główne korzyści, w tym zmniejszenie cykli przeglądu z tygodni do zaledwie godzin i znaczne zmniejszenie obciążenia согласности. Te narzędzia również mapują "Profil bieżący" organizacji względem profilu celu NIST, wskazując luki w zabezpieczeniach i dokumentacji. Poprzez automatyzację procesu "Identify–Assess–Categorize", pomagają zapewnić, że inwentarze zasobów i klasyfikacje ryzyka pozostają aktualne. To ciągłe podejście do dokumentacji odgrywa kluczową rolę w utrzymaniu zgodności NIST.

sbb-itb-4566332

7. Słabe monitorowanie dryftu danych

Dryft danych występuje, gdy dane, na których został wytrenowany system AI, zmieniają się w czasie, prowadząc do spadku wydajności i niezawodności. Przy ponad 75% organizacji na co najmniej jedną funkcję biznesową używającą AI, nieprzestrzeganie monitorowania tych zmian stanowi poważne zagrożenie dla zgodności - jedno, które narzędzia oparte na AI są dobrze przystosowane do rozwiązania. Radzenie sobie z tym problemem wymaga bardziej zaawansowanych rozwiązań do monitorowania, jak opisano poniżej.

W praktyce AI często funkcjonuje jako "czarna skrzynka", co utrudnia wykrycie, gdy coś pójdzie nie tak. 45% organizacji wymienia obawy dotyczące dokładności danych lub stronniczości jako główną przeszkodę do wdrożenia AI. Tymczasem wiele z nich nadal brakuje narzędzi do ciągłego monitorowania, pozostawiając je narażone na dryft danych. W przeciwieństwie do kontroli ręcznych, ciągłe monitorowanie umożliwia analizę w czasie rzeczywistym, wychwytując problemy zanim eskalują.

"Systemy AI... mogą być wytrenowane na danych, które mogą zmieniać się w czasie, czasami znacznie i nieoczekiwanie, wpływając na funkcjonalność systemu i zaufanie w sposób, który jest trudny do zrozumienia".

Aby rozwiązać dryft danych, zaawansowane narzędzia AI-SPM mogą automatycznie wykrywać wdrożone modele AI, identyfikować "Shadow AI" i mapować zarówno dane treningowe, jak i wnioskowania, w tym magazyny dokumentów i bazy danych wektorów. Te narzędzia również oznaczają błędy konfiguracji, takie jak publicznie dostępne dane treningowe, które mogą stanowić zagrożenie dla bezpieczeństwa.

Na przykład, Net Solutions niedawno pracowała z północnoamerykańską firmą zajmującą się czyszczeniem komercyjnym w celu wdrożenia zarządzania AI dla asystenta czatu sprzedażowego. Używając narzędzi monitorowania w czasie rzeczywistym, takich jak AWS CloudWatch i DataDog, oraz zautomatyzowanych potoków zintegrowanych z alertami Zoho Desk, firma przeszła z proof-of-concept do zgodnego, skalowalnego rozwiązania AI w zaledwie sześć tygodni.

Technolog Akash Lomas z Net Solutions podkreśla znaczenie monitorowania:

"Pomiar staje się szczególnie krytyczny w środowiskach, w których AI bezpośrednio kształtuje doświadczenia klientów... bez ciągłego nadzoru, te systemy mogą dryftować - serwując irrelevantne, stronnicze lub mylące treści".

Zignorowanie dryftu danych może prowadzić do poważnych konsekwencji: zmniejszoną wydajność systemu, mandaty regulacyjne i utratę zaufania. Na dodatek cyberatak kosztuje przedsiębiorstwa średnio 4,45 miliona dolarów rocznie.

8. Ujawnione wrażliwe dane treningowe

Ryzyko ujawnienia wrażliwych danych treningowych jest poważnym problemem, szczególnie jeśli chodzi o naruszenia zgodności. Zgodnie z NIST, Generative AI wprowadza 12 odrębnych ryzyk, z problemami prywatności danych - takimi jak wyciek i nieautoryzowane ujawnienie danych osobowych - będącymi głównym focusem. Wiele organizacji napotyka wyzwania w śledzeniu, gdzie przebywają dane treningowe AI i zapewnieniu ich bezpieczeństwa.

Aby to rozwiązać, narzędzia AI-Security Posture Management (AI-SPM) stały się niezbędne. Te narzędzia mogą automatycznie identyfikować wdrożone modele AI i lokalizować zbiory danych używane do treningu na platformach chmurowych, w tym magazyny dokumentów i bazy danych wektorów. Oznaczają również luki w zabezpieczeniach, takie jak publicznie dostępne dane treningowe lub otwarte punkty końcowe aplikacji. Mahesh Nawale, Kierownik Marketingu Produktu w Zscaler, podkreśla znaczenie tych narzędzi:

"Zscaler AI-SPM automatycznie lokalizuje zbiory danych używane w treningu i wnioskach AI w całym środowisku chmury - w tym dane, magazyny dokumentów i bazy danych wektorów. Oznacza błędy konfiguracji, takie jak publicznie dostępne dane treningowe, dając zespołom bezpieczeństwa wgląd potrzebny do zbadania, naprawy i udowodnienia zgodności".

Narzędzia AI idą poza zwykłe identyfikowanie błędów konfiguracji. Również monitorują zachowanie modelu, aby wychwycić potencjalne zagrożenia. Na przykład, mogą wykrywać problemy, takie jak memorizacja danych, inwersja modelu lub podejrzane działania, takie jak pobieranie dużych ilości danych lub nieautoryzowane zmiany, które mogą sygnalizować wycieki danych. Zautomatyzowane możliwości skanowania dodatkowo wzmacniają bezpieczeństwo poprzez identyfikowanie informacji wrażliwych - takich jak dane biometryczne, zdrowotne lub lokalizacyjne - które nie zostały prawidłowo zanonimizowane.

NIST również opracował "Dioptrę", rozwiązanie oprogramowania, które pomaga organizacjom testować modele AI przed cyberatakami. Mierzy to, jak ataki wpływają na wydajność modelu i identyfikują scenariusze, w których dane treningowe mogą być zagrożone.

Katerina Megas, Manager Programu w NIST, podkreśla rosnące wyzwanie:

"AI tworzy nowe ryzyka re-identyfikacji, nie tylko z powodu jego analitycznej mocy na wszystkie rozproszone zbiory danych, ale również z powodu potencjalnych wycieków danych z treningu modelu".

Przy ogromnych zbiorach danych używanych w trenowaniu Dużych Modeli Języka, ciągłe zautomatyzowane testowanie nie jest już opcjonalne - to konieczność ochrony wrażliwych informacji.

9. Brakujące techniki łagodzenia stronniczości

Gdy systemy AI brakuje odpowiednich metod radzenia sobie ze stronniczością, ryzykują wzmacnianie niesprawiedliwych wyników i tworzenie znaczących problemów z zgodością. Zgodnie z NIST, zarządzanie szkodliwą stronniczością jest jedną z siedmiu krytycznych cech godnego zaufania systemu AI. Tradycyjne ramy zarządzania ryzykiem są niewystarczające w radzeniu sobie ze stronniczością AI, czyniąc wyspecjalizowane strategie łagodzenia niezbędnymi. Podczas gdy wcześniejsze sekcje obejmowały wykrycie stronniczości, radzenie sobie z nią efektywnie wymaga wyraźnych kontroli i ciągłych wysiłków przebycia. Samo identyfikowanie stronniczości nie jest wystarczające - potrzebne są długoterminowe strategie do jej przeciwdziałania.

Narzędzia AI odgrywają kluczową rolę w wykrywaniu luk w kontrolach stronniczości. Oznaczają problemy, takie jak brakujące metryki uczciwości (np. wskaźniki nierównego wpływu lub różnice w stopach fałszywych pozytywów), systemy pozbawione testowania antagonistycznego lub red teamingu AI, oraz modele bez zaplanowanego przebycia, co pozostawia je wrażliwymi na dryft danych.

"Bez odpowiednich kontroli, systemy AI mogą wzmacniać, utrwalać lub zaostrzać nierówne lub niepożądane wyniki dla jednostek i społeczności." – NIST AI RMF 1.0

Aby rozwiązać te wyzwania, platformy zarządzania AI przeprowadzają zautomatyzowane skanowania w celu odkrycia luk w zgodności na podstawie wytycznych ramy NIST AI RMF. Zapewniają, że organizacje wdrożyły niezbędne zabezpieczenia, takie jak filtry zawartości, protokoły korekty stronniczości i inne zabezpieczenia wymagane przez standardy takie jak NIST AI 600-1. Te platformy również śledzą liniowość danych, aby potwierdzić, że zbiory danych treningowe są wolne od problemów, które mogłyby prowadzić do stronniczych wyników. Dodatkowo, narzędzia AI-Security Posture Management (AI-SPM) identyfikują wszystkie wdrożone modele AI, w tym systemy "shadow AI", które mogły pominąć testowanie uczciwości.

Z systemami AI podejmującymi miliardach decyzji, niewykryte stronniczości mogą erodować zaufanie publiczne, naruszać prawa obywatelskie i wyzwolić kary regulacyjne. Warto zauważyć, że od 2023 r. nastąpił wzrost o 21,3% globalnych wspominań ustawodawstwa AI. Te ryzyka podkreślają pilną potrzebę ciągłego, zautomatyzowanego nadzoru w celu zapewnienia uczciwości i odpowiedzialności.

10. Nieadekwatna klasyfikacja AI dostawców

Gdy organizacje nie klasyfikują prawidłowo systemów AI innych firm, pozostawiają się sobie otwarte ryzyka zgodności, których mogły nawet nie dostrzec. Problem? Metryki ryzyka dostawcy często nie pokrywają się z wewnętrznymi ramami ryzyka firmy. Jeśli dostawcy są błędnie klasyfikowani, jest niemożliwe zastosowanie odpowiednich kontroli lub określenie, czy ich etykieta "niskiego ryzyka" rzeczywiście pasuje do tolerancji ryzyka Twojej organizacji. Ta niezgodność podkreśla potrzebę narzędzi zautomatyzowanych, które mogą weryfikować klasyfikacje dostawców w czasie rzeczywistym.

Narzędzia oparte na AI tutaj wkraczają, automatyzując proces identyfikowania luk klasyfikacji. Poprzez skanowanie umów dostawcy i specyfikacji technicznych, te narzędzia identyfikują błędnie sklasyfikowane systemy i oznaczają niezaktualizowane komponenty AI osób trzecich, jak podkreślono w funkcjach ramy NIST AI RMF Govern 6.1 i Map 4.1. Łapią również systemy, których brakuje transparencji na temat elementów krytycznych, takich jak modele wstępnie wytrenowane, potoki danych lub procesy rozwojowe.

"Ryzyko może wynikać zarówno z samych danych, oprogramowania lub sprzętu osób trzecich, jak i sposobu ich użycia." – NIST AI RMF 1.0

Profil struktury bezpieczeństwa cybernetycznego NIST dla AI, opracowany przy wkładzie ponad 6500 współtwórców, podkreśla znaczenie widoczności łańcucha dostaw. Narzędzia oparte na AI pomagają poprzez utrzymywanie inwariantów systemów osób trzecich w czasie rzeczywistym, mapowanie łańcucha dostaw AI w celu odkrycia nieklasyfikowanych lub nieprzekontrolowanych komponentów. Te narzędzia ujawniają luki w zabezpieczeniach ukryte w oprogramowaniu, sprzęcie lub źródłach danych, które mogą stać się widoczne dopiero podczas wdrożenia. Dzięki zautomatyzowanej klasyfikacji dostawcy, organizacje mogą uzyskać kompleksowy przegląd swojego krajobrazu ryzyka AI, w zgodzie z wytycznymi NIST.

Kolejną zaletą automatyzacji jest jej zdolność do priorytetyzacji ocen dostawcy na podstawie czułości danych. Na przykład, systemy obsługujące informacje umożliwiające identyfikację osoby lub wchodzące w bezpośrednią interakcję z użytkownikami są oznaczane do bardziej szczegółowego badania. To podejście uznaje, że system uznany za niskie ryzyko w jednym kontekście - takim jak przetwarzanie danych czujników fizycznych - może stanowić wysokie ryzyko w innym, takim jak zarządzanie chronionymi informacjami zdrowia. Bez tego zautomatyzowanego nadzoru firmy ryzykują zmarnowanie zasobów na systemy niskiego ryzyka, jednocześnie pozostawiając narzędzia AI wysokiej stawki niedostatecznie monitorowane.

Jak ISMS Copilot identyfikuje te luki

ISMS Copilot przyjmuje podejście specyficzne dla ramach w celu wskazania luk w zgodności NIST 800-53. Zamiast szukać odpowiedzi w całym internecie, wykorzystuje Retrieval-Augmented Generation (RAG) do pobrania ukierunkowanych informacji z dokładnie wyselekcjonowanego zbioru danych. Ten zbiór danych zawiera 20+ ramach, takich jak NIST 800-53, ISO 27001, SOC 2 i GDPR, dostarczając precyzyjnego i wykonalnego wskazówki do rozwiązania luk zgodności.

Narzędzie upraszcza analizę luk poprzez mapowanie kontroli na wiele standardów, tworzenie dokumentacji gotowej do audytu i rozbijanie długich raportów. Dzięki ISMS Copilot One użytkownicy mogą przesyłać dokumenty zgodności - nawet te przekraczające 20 stron - do zautomatyzowanej analizy. Aktualnie 1000+ organizacji polega na tym narzędziu dla swoich potrzeb dotyczących zgodności bezpieczeństwa informacji. Oto szybkie porównanie wyspecjalizowanych funkcji ISMS Copilot w stosunku do narzędzi AI ogólnego przeznaczenia:

| Funkcja | ISMS Copilot | AI ogólnego przeznaczenia |

|---|---|---|

| Zbiór danych | Skoncentrowany na zgodności bezpieczeństwa informacji | Szeroka, ogólna baza wiedzy |

| Dokładność | Dostarcza wskazówek specyficznych dla ramy | Często niejasne lub zbyt ogólne |

| Gotowość do audytu | Tworzy dokumentację gotową do audytora | Nie dostosowane do formalnych audytów |

| Prywatność danych | SOC 2 Type II-compatible; brak treningu danych użytkownika | Może używać danych wejściowych użytkownika do trenowania |

| Analiza dokumentów | Obsługuje szczegółową analizę luk dla dużych raportów | Ograniczone do przetwarzania tekstu podstawowego |

Aby chronić informacje klientów, ISMS Copilot zapewnia dedykowane Obszary robocze, które utrzymują projekty izolowane i bezpieczne. Wszystkie dane są przechowywane w magazynach danych zgodnych z SOC 2 Type II z szyfrowaniem end-to-end, zapewniając, że przesłane dokumenty lub rozmowy nigdy nie są wykorzystywane do trenowania modeli AI.

Dla organizacji zajmujących się analizami luk NIST 800-53, ISMS Copilot oferuje jasne, wykonalne kroki do wdrożenia kontroli i spełnienia wymagań FISMA. Możesz eksplorować darmową warstwę na chat.ismscopilot.com, z planami płatnymi od 20 dolarów/miesiąc.

Wniosek

Sztuczna inteligencja zmieniła zgodność NIST z procesu okresowego i reaktywnego na proaktywny, system w czasie rzeczywistym. Poprzez analizę całych zbiorów danych, AI może zidentyfikować potencjalne problemy zanim staną się większymi problemami. Dzięki automatyzacji opartej na AI, organizacje mogą pozostać gotowe do audytu poprzez automatyzację gromadzenia dowodów, jednocześnie mając się z zmieniającymi się wymaganiami zgodności.

Narzędzia takie jak policy-as-code i ciągła pewność umożliwiają automatyzację kontroli NIST, zajmując się problemami na wczesnym etapie procesu rozwojowego. Narzędzia oparte na AI mogą szybko zaobserwować anomalie w różnych środowiskach, zapewniając scentralizowany nadzór na wiele struktur zgodności. Te możliwości stanowią sedno rozwiązań oferowanych przez ISMS Copilot.

ISMS Copilot zapewnia ciągłą zgodność poprzez podejście RAG (Red-Amber-Green), wykorzystując wyselekcjonowany zbiór danych, który obejmuje struktury takie jak NIST 800-53, ISO 27001, SOC 2 i inne. Jego funkcje obejmują zautomatyzowaną analizę luk, mapowanie między ramami i dokumentację gotową do audytu, zapewniając, że organizacje pozostają wyrównane z ewoluującymi standardami NIST.

Poza tymi korzyściami, ISMS Copilot wspiera wiele ram, krytyczną potrzebę dla dzisiejszych złożonych programów bezpieczeństwa. Organizacje mogą badać te narzędzia zgodności oparte na AI bezpłatnie, odwiedzając chat.ismscopilot.com.

Często zadawane pytania

W jaki sposób sztuczna inteligencja upraszcza zarządzanie inwariantem zasobów dla zgodności NIST?

Utrzymanie precyzyjnego i aktualnego inwentarza zasobów jest krytycznym elementem struktury bezpieczeństwa cybernetycznego NIST (np. ID.AM-1) i kontroli NIST 800-53. AI upraszcza to zadanie poprzez automatyzację odkrywania, klasyfikacji i śledzenia zasobów zarówno sprzętowych, jak i programowych. Zamiast polegania na tradycyjnych, często zawodnych metodach ręcznych, AI wykorzystuje zaawansowane techniki, takie jak uczenie maszynowe, do analizy ruchu sieciowego, aktywności punktów końcowych i dzienników chmury. Podejście to zapewnia, że zasoby niezidentyfikowane lub nieautoryzowane są wykrywane, rozbieżności są podkreślane, a inwentarz pozostaje stale aktualizowany.

Narzędzia oparte na AI, takie jak ISMS Copilot, podnoszą ten proces poprzez bezproblemową integrację ze skranami, CMDB i interfejsami API chmury. Mogą automatycznie wypełniać tabele inwentarza zgodne z NIST i generować niezbędną dokumentację, w tym raporty o zasobach i dzienniki zmian. Z interfejsem w języku naturalnym ISMS Copilot, użytkownicy mogą łatwo zadawać pytania, takie jak "Które urządzenia brakuje aktualizacji oprogramowania sprzętowego?" i natychmiast otrzymać wglądy, które można wykonać. To nie tylko zmniejsza obciążenie pracą ręczną, ale również poprawia dokładność, utrzymując inwentarz zasobów w doskonałej synchronizacji ze standardami NIST.

W jaki sposób sztuczna inteligencja pomaga zidentyfikować i zmniejszyć stronniczość w systemach AI?

Sztuczna inteligencja odgrywa ważną rolę w wykrywaniu i naprawianiu stronniczości w systemach sztucznej inteligencji. Struktura zarządzania ryzykiem AI NIST podkreśla uczciwość jako jedną z kluczowych zasad godnego zaufania AI, obok bezpieczeństwa, przejrzystości i prywatności. Korzystając z narzędzi AI, organizacje mogą przeszukiwać duże zbiory danych, przewidywania i metadane, aby odkryć wzorce nierownego traktowania - takie jak wyższe wskaźniki błędów, które nieproporcjonalnie wpływają na określone grupy demograficzne. Te narzędzia również stosują statystyczne metryki uczciwości i oferują wykonalne wglądy do rozwiązania zidentyfikowanych problemów.

Asystenci oparte na AI, tacy jak ISMS Copilot, idą dalej poprzez aktywne monitorowanie systemów AI pod kątem zgodności z kontrolami NIST. Mogą wskazać brakującą dokumentację, oznaczać przetestowane źródła danych lub identyfikować luki w procesach testowania stronniczości. Poprzez oferowanie dostosowanych szablonów i wskazówek krok po kroku, te narzędzia transformują zgodność ze statycznej listy kontrolnej w interaktywny przepływ pracy. To ułatwia organizacjom zajmowanie się stronniczością, zapewniając, że ich systemy AI nie tylko spełniają wymogi, ale są również bardziej sprawiedliwe i niezawodne.

W jaki sposób sztuczna inteligencja może pomóc zautomatyzować oceny kontroli prywatności zgodnie ze standardami NIST?

AI usuwa trudności z ocen kontroli prywatności poprzez analizę struktury prywatności NIST i kontroli prywatności związanych z SP 800-53. Następnie wyrównuje te kontrole z przepływami danych, systemami i politykami Twojej organizacji. Poprzez skanowanie plików konfiguracji, dzienników API i dokumentacji, buduje mapę w czasie rzeczywistym łączącą kontrole z zasobami, wskazując automatycznie problemy, takie jak brakujące szyfrowanie lub przestarzałe kontrole dostępu.

ISMS Copilot, często określany jako "ChatGPT dla ISO 27001", przynosi tę funkcjonalność do standardów NIST. Na przykład, możesz poprosić go o ocenę określonej kontroli, takiej jak kontrola prywatności NIST 800-53 AU-3. W odpowiedzi generuje dostosowane listy kontrolne, kroki do gromadzenia dowodów i plany naprawy. To eliminuje żmudną pracę ręczną, oferując natychmiastowe, precyzyjne i wykonalne wglądy do usprawnienia wysiłków zgodności.

Powiązane posty na blogu

Powiązane artykuły

Jak sztuczna inteligencja wspomaga zgodność z wieloma standardami

Sztuczna inteligencja ujednolica mapowanie kontroli, automatyzuje zbieranie dowodów i zapewnia monitorowanie w czasie rzeczywistym, aby skrócić czas przygotowania do audytu i zmniejszyć błędy compliance.

Jak alerty w czasie rzeczywistym zmniejszają ryzyko niezgodności ISO 27001

Alerty w czasie rzeczywistym wykrywają zagrożenia szybko, zmniejszają koszty naruszeń i awarii audytu, oraz utrzymują logi ISO 27001 odporne na manipulacje w celu ciągłej zgodności.

Dokładność AI w bezpieczeństwie: Specjalizowane vs Ogólne

Specjalizowane AI pokonuje modele ogólne w zgodności bezpieczeństwa—wyższa dokładność, mniej halucynacji i dokumentacja gotowa do audytu dla ISO 27001 i GRC.