EU AI Act: Requisiti di Trasparenza Spiegati

Panoramica della trasparenza dell'EU AI Act: regole di divulgazione per chatbot e contenuti AI, standard di documentazione, tempistiche e sanzioni.

EU AI Act: Requisiti di Trasparenza Spiegati

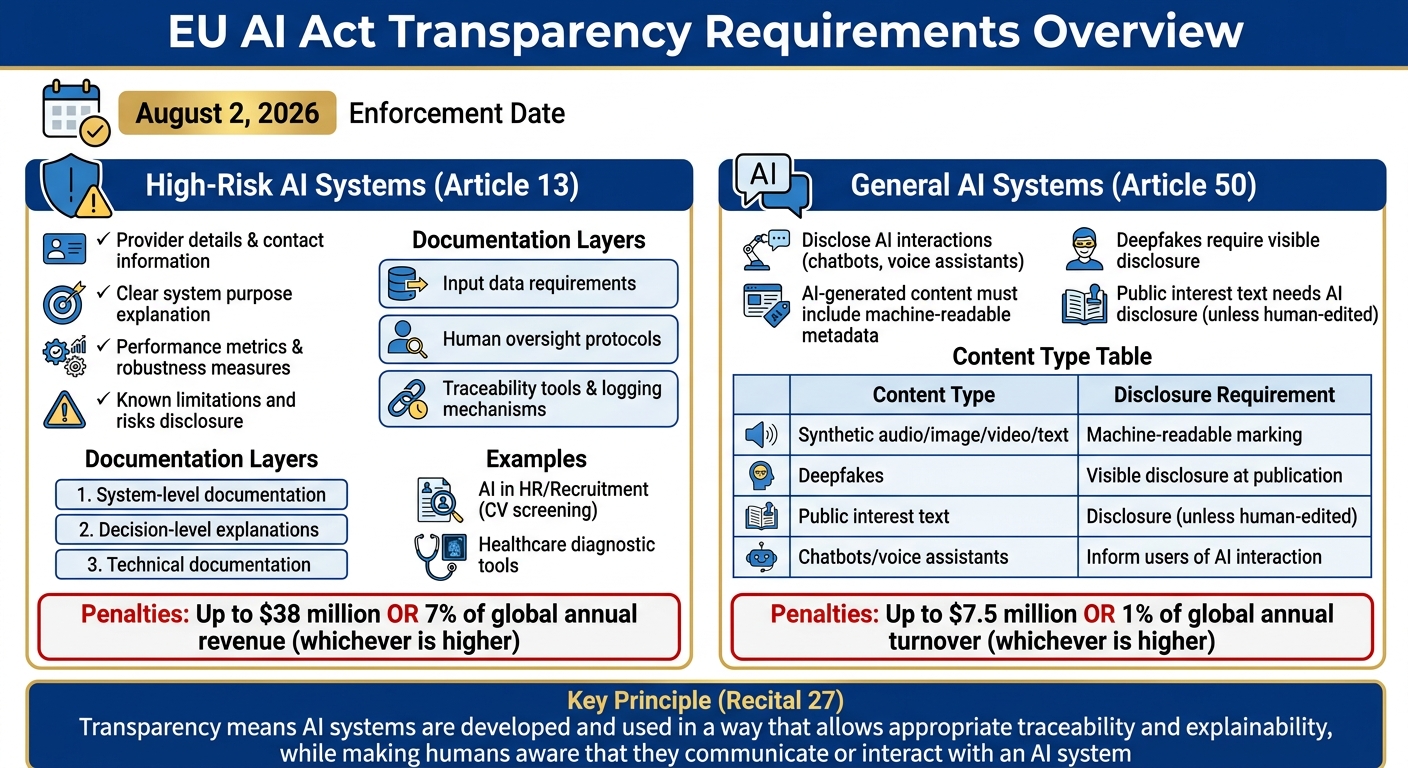

L'EU AI Act è il primo framework legale al mondo per la regolamentazione dell'intelligenza artificiale, con un forte focus sulla trasparenza. Introduce requisiti rigorosi per i sistemi di IA ad alto rischio, enfatizzando la tracciabilità, l'esplicabilità e la consapevolezza degli utenti. Ecco cosa devi sapere:

-

Regole Chiave di Trasparenza:

- I sistemi di IA ad alto rischio devono fornire documentazione chiara, incluso scopo del sistema, metriche di prestazione, limitazioni e dettagli operativi.

- Gli utenti devono essere informati quando interagiscono con sistemi di IA (ad es., chatbot, assistenti vocali).

- I contenuti generati da IA, come deepfake, devono includere una divulgazione visibile o metadati.

-

Sanzioni per Non-Conformità:

- Multe fino a $38 milioni o 7% del fatturato annuale globale per sistemi ad alto rischio.

- Per i sistemi di IA generici, le multe possono raggiungere $7,5 milioni o 1% del fatturato globale.

-

Tempistica:

- La maggior parte delle disposizioni entra in vigore il 2 agosto 2026.

-

Standard di Documentazione:

- I fornitori devono mantenere documentazione stratificata (ad es., info a livello di sistema, spiegazioni delle decisioni) e file tecnici dettagliati.

L'Act mira a ridurre i rischi come il bias di automazione e l'uso improprio, assicurando accountability per gli sviluppatori e i distributori di IA, spesso richiedendo un EU AI Act Copilot per navigare i requisiti complessi. La conformità non è opzionale - è necessaria per evitare sanzioni e costruire fiducia nei sistemi di IA.

::: @figure  {Requisiti di Trasparenza dell'EU AI Act: Panoramica della Conformità per Sistemi di IA ad Alto Rischio e Generici}

:::

{Requisiti di Trasparenza dell'EU AI Act: Panoramica della Conformità per Sistemi di IA ad Alto Rischio e Generici}

:::

Brando Benifei su Equilibrio tra Trasparenza, PI e Enforcement nell'EU AI Act | RegulatingAI Podcast

::: @iframe https://www.youtube.com/embed/f62JIPXT8Cs :::

Requisiti di Trasparenza per Sistemi di IA ad Alto Rischio (Articolo 13)

L'Articolo 13 dell'EU AI Act descrive specifici obblighi di trasparenza per i fornitori di sistemi di IA ad alto rischio. Questi requisiti mirano a garantire che tali sistemi siano progettati con sufficiente chiarezza affinché i distributori possano interpretare i loro output e utilizzarli responsabilmente. Sebbene ai fornitori non sia richiesto di divulgare il codice proprietario, devono condividere dettagli operativi chiave e spiegare le limitazioni del sistema.

Requisiti di Informazione degli Utenti

I sistemi di IA ad alto rischio devono essere accompagnati da istruzioni chiare, accessibili e facili da comprendere, disponibili in formato digitale. Queste istruzioni dovrebbero includere:

- Dettagli del fornitore: L'identità e le informazioni di contatto del fornitore.

- Scopo: Una spiegazione chiara dell'uso previsto del sistema.

- Dettagli di prestazione: Informazioni su metriche di prestazione, misure di robustezza e standard di cybersecurity testati.

- Limitazioni e rischi noti: Una discussione dei potenziali rischi, inclusi quelli relativi a salute, sicurezza o diritti fondamentali, così come rischi derivanti da usi impropri prevedibili.

- Specifiche operative: Dettagli sui requisiti dei dati di input, protocolli di supervisione umana, esigenze computazionali, durata della vita del sistema e pianificazioni di manutenzione.

- Strumenti di tracciabilità: Meccanismi per la registrazione, l'archiviazione e l'interpretazione dei dati del sistema per garantire accountability.

Oltre alle istruzioni per gli utenti, i fornitori devono seguire pratiche di documentazione rigorose per rispettare gli standard di trasparenza dell'EU AI Act.

Standard di Documentazione

L'EU AI Act non prescrive un singolo formato per la documentazione ma enfatizza un approccio stratificato per soddisfare le esigenze di vari stakeholder:

- Documentazione a livello di sistema: Copre il comportamento generale del sistema, lo scopo previsto e i modalità di guasto noti.

- Spiegazioni a livello di decisione: Si concentra sui fattori che influenzano i risultati individuali e i livelli di confidenza associati.

- Documentazione tecnica: Offre approfondimenti dettagliati sull'architettura del modello e sui processi di validazione.

L'obiettivo è fornire spiegazioni personalizzate alle esigenze di diversi utenti. Ad esempio, strumenti come SHAP o LIME possono offrire insight localizzati per modelli complessi. La profondità della spiegazione varierà a seconda dello stakeholder - quello che un professionista medico ha bisogno di sapere su uno strumento diagnostico potrebbe differire significativamente da quello che un consumatore ha bisogno di capire su un punteggio di credito.

Questo approccio di documentazione multi-strato è critico per garantire la trasparenza nelle applicazioni di IA ad alto rischio.

Esempi di Casi di Uso di IA ad Alto Rischio

Ecco come questi requisiti di trasparenza si applicano in scenari del mondo reale:

- IA in HR/Recruitment: I sistemi utilizzati per lo screening dei CV o il punteggio dei colloqui devono fornire documentazione che spieghi come vengono determinate le classifiche dei candidati, come il sistema si comporta tra diversi gruppi di candidati e le misure di salvaguardia in atto per prevenire il bias.

- Strumenti diagnostici sanitari: Gli ospedali che utilizzano l'IA per la diagnostica hanno bisogno di informazioni sulla precisione dello strumento tra diverse demografiche di pazienti, i tipi di imaging medico su cui è stato addestrato, situazioni che richiedono revisione umana e come interpretare i punteggi di confidenza.

Ad esempio, un ospedale che distribuisce uno strumento diagnostico di IA dovrebbe comprendere l'accuratezza del sistema tra vari gruppi di pazienti e ricevere guida su quando è necessario l'intervento umano. Allo stesso modo, un'organizzazione che utilizza l'IA per decisioni di assunzione deve essere in grado di valutare l'equità e l'efficacia del sistema tra profili di candidati diversi assicurando conformità agli standard antidiscriminazione.

Regole Generali di Trasparenza per Sistemi di IA (Articolo 50)

L'Articolo 50 delinea i requisiti di trasparenza che si applicano a una vasta gamma di sistemi di IA, andando oltre solo le applicazioni ad alto rischio. Queste regole coprono sistemi di IA che interagiscono con persone, generano contenuti o eseguono riconoscimento delle emozioni. A partire dal 2 agosto 2026, la non-conformità potrebbe portare a multa fino a $7,5 milioni o 1% del fatturato annuale globale, a seconda di quale sia superiore [8].

Il Considerando 27 dell'EU AI Act definisce la trasparenza come segue:

"Trasparenza significa che i sistemi di IA sono sviluppati e utilizzati in modo che consenta tracciabilità e esplicabilità appropriate, mentre si rende consapevoli gli umani del fatto che comunicano o interagiscono con un sistema di IA, così come si informa adeguatamente i distributori delle capacità e limitazioni di quel sistema di IA e le persone interessate sui loro diritti." [1]

Divulgazione di Interazioni con IA

Ogni volta che un sistema di IA interagisce direttamente con gli utenti - come chatbot, assistenti vocali o strumenti di servizio clienti - gli utenti devono essere informati che stanno interagendo con l'IA. Questa divulgazione dovrebbe avvenire entro la prima interazione e deve essere chiara e accessibile [4][10]. Esiste un'eccezione per i casi in cui è "ovvio dalle circostanze" che l'interazione coinvolge l'IA, ma questa è un'eccezione ristretta. Come consiglia Abhishek G Sharma, Founder & CEO di Move78 International Limited:

"L'eccezione [per l'IA ovvia] è ristretta... La mia raccomandazione: divulga comunque. Il costo di un piccolo avviso è zero. Il costo di sbagliare il giudizio 'ovvio' è fino a $7,5 milioni." [8]

Per le migliori pratiche, utilizza un approccio a due livelli: includi un indicatore visivo persistente (come un badge "Assistente IA") e fornisci un avviso esplicito durante la prima interazione. Evita di seppellire questa informazione nei Termini di Servizio - non soddisferà il requisito "chiaro e distinguibile" [9]. Inoltre, assicurati la conformità agli standard di accessibilità UE per rendere questa divulgazione universalmente comprensibile.

Divulgazione di Contenuti Generati da IA

Se il tuo sistema di IA genera audio, immagini, video o testo, deve includere metadati leggibili da macchina utilizzando standard come XMP, IPTC o sistemi di provenance crittografici come C2PA [8]. Per i deepfake, un'etichettatura chiara come artificialmente generata è obbligatoria al momento della pubblicazione [7].

Un esempio notevole del motivo per cui ciò è cruciale si è verificato a febbraio 2026, quando l'emittente pubblica tedesca ZDF "heute journal" ha trasmesso un video generato da IA che mostrava agenti ICE che trattenevano una donna e bambini. Il video è stato utilizzato per illustrare un rapporto sull'immigrazione negli USA, sottolineando l'importanza di standard di marcatura visiva chiari [12].

Per il testo relativo a temi di interesse pubblico, il coinvolgimento dell'IA deve essere divulgato a meno che il contenuto non abbia subito una revisione umana approfondita con procedure di supervisione editoriale documentate. Una revisione semplice o superficiale non si qualificherà per questa esenzione [12].

| Tipo di Contenuto IA | Chi è Responsabile | Cosa è Richiesto |

|---|---|---|

| Audio/immagine/video/testo sintetico | Fornitore | Marcatura leggibile da macchina (metadati/watermark) |

| Deepfake | Distributore | Divulgazione visibile al momento della pubblicazione |

| Testo di interesse pubblico | Distributore | Divulgazione della generazione da IA (a meno che non sia edito da umani) |

| Chatbot/assistenti vocali | Fornitore | Sistema progettato per informare gli utenti dell'interazione con l'IA |

Esistono alcune eccezioni. Ad esempio, l'IA che esegue funzioni di assistenza come il controllo ortografico non ha bisogno di etichettatura. Allo stesso modo, i lavori artistici o satirici possono avere più flessibilità, anche se la presenza di contenuti generati da IA dovrebbe comunque essere divulgata in modo che non interrompa l'esperienza dell'utente [7].

Per soddisfare i requisiti di trasparenza, adotta una strategia di marcatura multi-strato. Ciò potrebbe includere metadati firmati digitalmente, watermark invisibili e registri di sistema dettagliati [11][12]. Inoltre, assicurati che le tue pipeline di contenuti mantengono i metadati di provenance dell'IA invece di rimuoverli. Mantenere un registro di trasparenza per documentare come e quando vengono utilizzati i meccanismi di divulgazione può servire come salvaguardia critica se i regolatori indagano, un processo che può essere semplificato utilizzando un assistente di policy di conformità all'IA [8]. Queste misure collettivamente sostengono la trasparenza, assicurando che gli utenti rimangono informati sulle interazioni e output dell'IA.

Come Conformarsi ai Requisiti di Trasparenza

Soddisfare i requisiti di conformità dell'EU AI Act per la trasparenza comporta più che semplicemente spuntare caselle. Le organizzazioni hanno bisogno di valutare i loro sistemi, creare documentazione approfondita e mantenere prove che possono resistere all'esame normativo. Questi passaggi garantiscono accountability durante tutto il ciclo di vita del sistema di IA. Con l'applicazione dei requisiti di IA ad alto rischio a partire dal 2 agosto 2026 e sanzioni che raggiungono fino a $35 milioni o 7% del fatturato annuale globale per violazioni gravi [5], la conformità non è opzionale - è essenziale.

Esecuzione di Valutazioni di Trasparenza

Inizia identificando i tuoi stakeholder - incluso gli utenti finali, gli operatori di sistema, gli auditor e gli sviluppatori - e assicurati che i tuoi sistemi di IA forniscano il livello di trasparenza che ogni gruppo richiede [6]. Ad esempio, mentre un dottore che utilizza l'IA diagnostica potrebbe necessitare di spiegazioni tecniche dettagliate, un ufficiale bancario che rivede le domande di prestito potrebbe richiedere insight meno complessi. Per i modelli avanzati, considera l'uso di strumenti come SHAP o LIME per spiegare come vengono prese le decisioni specifiche piuttosto che solo presentare gli esiti [6].

Prima di distribuire sistemi di IA ad alto rischio, completa una Valutazione dell'Impatto sui Diritti Fondamentali (FRIA) [3]. Questo processo identifica i potenziali effetti sui diritti fondamentali e documenta i passaggi necessari per mitigare i rischi. Inoltre, mantieni log generati automaticamente per almeno sei mesi per garantire la tracciabilità [3].

Una volta che le tue valutazioni confermano che il tuo sistema soddisfa gli standard di trasparenza, sposta il focus sulla creazione e manutenzione di una documentazione agile.

Creazione e Aggiornamento della Documentazione

In base all'Articolo 11 e all'Allegato IV dell'EU AI Act, devi mantenere un File Tecnico che dimostri la conformità a tutti gli obblighi [13]. Non è un compito una tantum - la tua documentazione ha bisogno di evolversi insieme al tuo sistema. Adottare un processo di documentazione continuamente aggiornato assicura che i tuoi registri rimangono attuali mentre il tuo sistema di IA cambia.

Template come Model Cards o AI FactSheets possono aiutarti a creare una documentazione coerente e completa [6]. Questi dovrebbero includere dettagli come identità del fornitore, caratteristiche del sistema, limitazioni note, specifiche dei dati di input, misure di supervisione umana e requisiti di manutenzione [2].

Per mantenere la tua documentazione allineata agli aggiornamenti del sistema, implementa una pipeline automatizzata che aggiorna i record ad ogni riaddestramento del modello. Per i contenuti generati da IA, utilizza etichette leggibili da macchina seguendo standard come XMP, IPTC o C2PA. Inoltre, mantieni un "Evidence Vault" per archiviare audit trail immutabili [13].

Utilizzo di ISMS Copilot per la Conformità

Per semplificare gli sforzi di conformità, considera strumenti come ISMS Copilot. Questa piattaforma fornisce supporto alimentato da IA personalizzato per i requisiti di trasparenza. Copre l'EU AI Act e oltre 50 altri framework, rendendola particolarmente utile per le organizzazioni che si confrontano con molteplici esigenze di conformità.

Caricando la tua documentazione di IA (file PDF, DOCX o XLS fino a 5MB), ISMS Copilot può identificare lacune e creare piani di remediation prioritari per affrontare elementi mancanti nei tuoi registri di trasparenza [14]. Per risultati più mirati, includi riferimenti specifici nei tuoi prompt, come "Istruzioni dell'Articolo 13 per l'uso" o "Regole di trasparenza dell'Articolo 50".

Quando redigi testo di divulgazione per contenuti generati da IA o interazioni, ISMS Copilot può generare linguaggio allineato all'EU AI Act basato sul tuo caso d'uso. La piattaforma ti permette di personalizzare i prompt includendo dettagli come il livello di rischio del tuo sistema di IA, il modello di distribuzione e lo scopo, assicurando che la documentazione si adatti alle tue esigenze specifiche.

Inoltre, la funzione workspace di ISMS Copilot ti consente di gestire i progetti dell'EU AI Act separatamente da altri framework di conformità. Ciò è particolarmente utile per i consulenti che lavorano con più clienti. Il piano gratuito consente 10 upload di documenti al mese, mentre il piano Plus ($24/mese) aumenta questo limite [14].

Conclusione

La trasparenza è la pietra angolare della fiducia e dell'accountability nelle tecnologie di IA. Come spiega il Considerando 27 dell'Act:

"Trasparenza significa che i sistemi di IA sono sviluppati e utilizzati in modo che consenta tracciabilità e esplicabilità appropriate, mentre si rende consapevoli gli umani del fatto che comunicano o interagiscono con un sistema di IA" [1].

Questa idea centrale influenza tutto - sia che si tratti di documentare le limitazioni dei sistemi ad alto rischio o di garantire che i chatbot rivelino chiaramente la loro identità di IA.

Lungo questo articolo, abbiamo visto come i requisiti di trasparenza affrontano sfide critiche. Aiutano a contrastare il bias di automazione, forniscono agli utenti gli strumenti per comprendere le decisioni guidate dall'IA e assicurano che questi sistemi rimangono entro il loro ambito previsto [3].

Per le organizzazioni, la trasparenza non è solo una casella da spuntare - ha bisogno di essere intessuta in ogni strato dei loro sistemi di IA. Come dicono Sacha Wilson e Jacky Lai da Harbottle & Lewis:

"La traiettoria è inequivocabile: l'Act posiziona la trasparenza come principio fondamentale, che avrà impatto su scelte di design, interfacce utente e processi di governance" [3].

Incorporando la trasparenza nei loro processi - attraverso documentazione chiara, divulgazioni significative e una forte supervisione umana - le aziende possono allinearsi alle aspettative normative mantenendo la loro posizione nel mercato dell'UE.

Inoltre, la documentazione approfondita non solo protegge le organizzazioni dalle sanzioni; costruisce anche fiducia. Jasper Claes da Unorma sottolinea:

"Lo sforzo di conformità documentato è un fattore attenuante formale in base all'Act" [13].

Domande Frequenti

::: faq

Come faccio a sapere se il mio sistema di IA è "ad alto rischio" secondo l'EU AI Act?

Per capire se il tuo sistema di IA si qualifica come "ad alto rischio" secondo l'EU AI Act, esamina se funziona in settori come infrastrutture critiche, identificazione biometrica o educazione. Dovrai anche valutare il suo potenziale di causare danni significativi. I sistemi ad alto rischio sono delineati negli Allegati III e Articoli 9–15 dell'Act, con scadenze di conformità fissate per il 2 agosto 2026. :::

::: faq

Che cosa conta come divulgazione di IA conforme per chatbot e assistenti vocali?

Una divulgazione di IA conforme, come richiesto dall'EU AI Act, assicura che gli utenti siano chiaramente informati quando interagiscono con un sistema di IA. Questo include fornire dettagli diritti su cosa il sistema può e non può fare, in modo che gli utenti comprendano le sue capacità e limitazioni.

La trasparenza è anche fondamentale. La divulgazione dovrebbe spiegare come il sistema di IA prende decisioni, offrendo insight nei suoi processi. Inoltre, qualsiasi contenuto generato da IA deve essere chiaramente etichettato in un formato leggibile da macchina, rendendo più facile identificarlo e assicurando accountability. :::

::: faq

Devo etichettare il testo generato da IA se una persona lo ha modificato?

Anche se il contenuto generato da IA è successivamente modificato da un umano, deve comunque essere etichettato come generato da IA secondo l'EU AI Act. La legge prescrive che gli utenti siano informati ogni volta che il contenuto ha origine da IA o è modificato dall'IA. Questo requisito si applica indipendentemente da qualsiasi coinvolgimento umano nel raffinamento o alterazione del contenuto. L'obiettivo è mantenere la trasparenza, soprattutto per i sistemi di IA ad alto rischio. :::

Articoli correlati

Mappatura Incrociata di Framework: NIST, ISO 27001, SOC2

Utilizza NIST CSF per costruire controlli unificati che mappano ISO 27001 e SOC 2, riducendo lo sforzo di audit e i costi di conformità.

NIS2 e ISO 27001: Guida alla Visualizzazione delle Sovrapposizioni

Mostra come ISO 27001 copre il 70–80% di NIS2 e evidenzia i gap come la segnalazione rigorosa degli incidenti e la responsabilità del management.

Gestione multi-framework delle politiche: Pratiche chiave

Centralizza le politiche, mappa i controlli sovrapposti e utilizza l'IA per automatizzare la conformità multi-framework, riducendo audit e costi.