Generieke AI vs Domeinspecifieke AI voor Compliance

Vergelijk generieke vs domeinspecifieke AI voor compliance: nauwkeurigheid, gegevenssoevereiniteit, auditgereedheid en verminderd auditrisico.

Generieke AI vs Domeinspecifieke AI voor Compliance

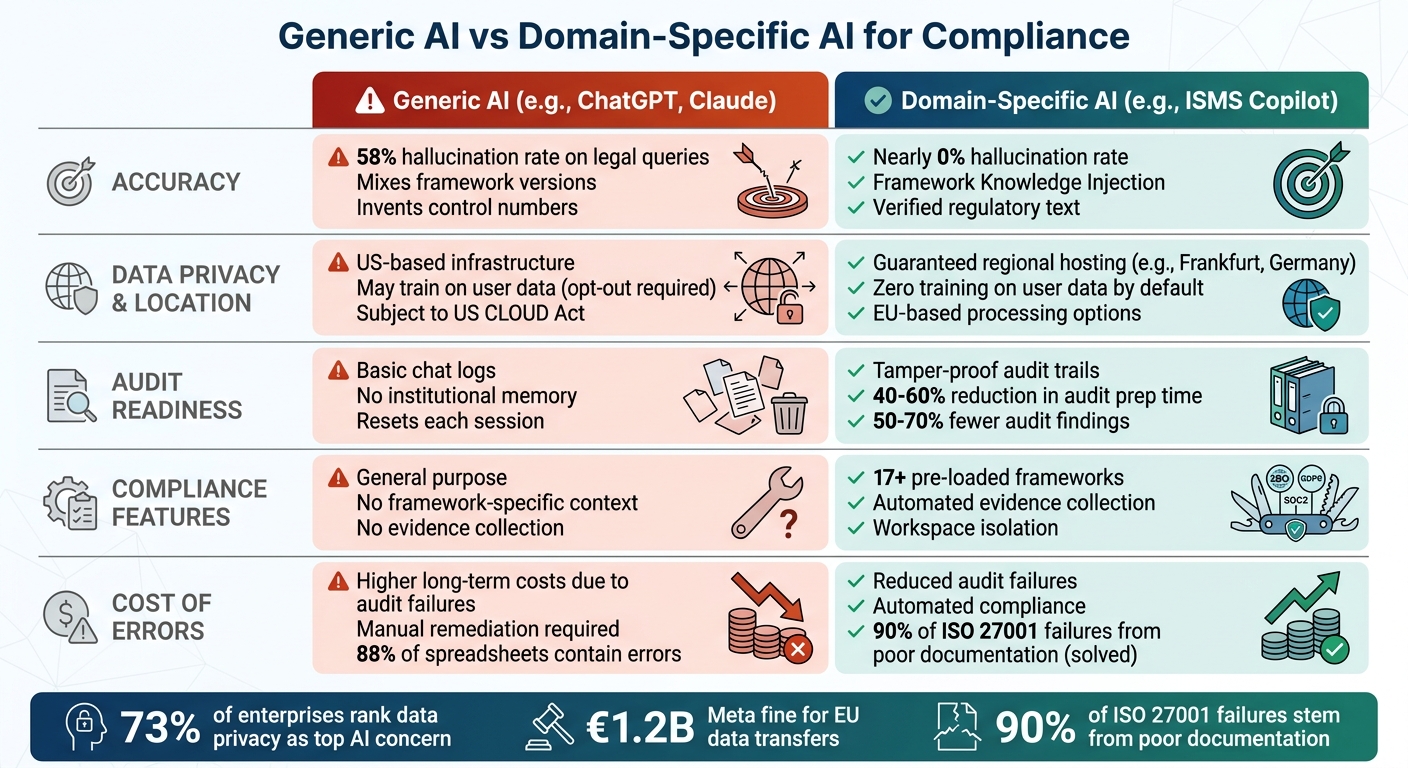

Bij compliance-taken kan de keuze voor het juiste AI-hulpmiddel het verschil maken tussen succes en falen. Moet je een generiek AI-hulpmiddel zoals ChatGPT gebruiken, of kiezen voor een domeinspecifiek AI-platform? Dit is de kern:

- Generieke AI-hulpmiddelen zijn veelzijdig, maar vaak niet nauwkeurig genoeg voor compliance. Ze vertrouwen op brede datasets, wat leidt tot onnauwkeurigheden (bijv. een hallucinatiepercentage van 58% bij juridische vragen). Daarnaast brengen ze risico's met zich mee, zoals inbreuken op gegevensprivacy door verwerking in de VS.

- Domeinspecifieke AI-hulpmiddelen, zoals ISMS Copilot, zijn speciaal ontworpen voor compliance-taken. Ze gebruiken geverifieerde regelgevende gegevens, zorgen voor gegevenssoevereiniteit (bijv. servers in de EU) en bieden functies zoals controlelogboeken en raamwerk-specifieke nauwkeurigheid.

Belangrijkste verschillen:

- Nauwkeurigheid: Domeinspecifieke AI minimaliseert fouten door antwoorden te baseren op geverifieerde standaarden, in tegenstelling tot generieke AI, die mogelijk gefingeerde of verouderde informatie genereert.

- Gegevensprivacy: Domeinspecifieke platforms geven prioriteit aan regionale gegevensopslag en soevereiniteit. Generieke AI verwerkt vaak gegevens in de VS, wat GDPR- en grensoverschrijdende compliance-risico's met zich meebrengt.

- Auditgereedheid: Domeinspecifieke hulpmiddelen bieden gestructureerde, vervalste documentatie en continue bewijsverzameling - iets wat generieke AI mist.

Snelle conclusie: Als compliance cruciaal is voor je organisatie, is domeinspecifieke AI de veiligere en betrouwbaardere keuze.

::: @figure  {Generieke AI vs Domeinspecifieke AI voor Compliance: Belangrijkste verschillen}

:::

{Generieke AI vs Domeinspecifieke AI voor Compliance: Belangrijkste verschillen}

:::

AI-beveiliging en risico: Zij-aan-zij vergelijking van AI-compliance- en risicoramwerken

::: @iframe https://www.youtube.com/embed/wkEEK8Wp2WM :::

Waarom generieke AI tekortschiet voor beveiligingscompliance

Generieke AI-hulpmiddelen, hoewel uitstekend voor algemene productiviteit, worstelen met de precisie en betrouwbaarheid die vereist zijn voor gereguleerde compliance-taken. Deze modellen genereren tekst door de meest waarschijnlijke volgende woorden te voorspellen in plaats van te putten uit geverifieerde feiten [8]. Dit kan leiden tot outputs die overtuigend klinken maar feitelijk onjuist zijn - een groot risico bij compliance, waar nauwkeurigheid niet onderhandelbaar is. Laten we de belangrijkste problemen bespreken.

Onnauwkeurige outputs en hallucinaties

Onderzoek toont aan dat maar liefst 46% van door AI gegenereerde tekst hallucinaties bevat. Bij tests met specifieke juridische vragen bleek GPT-4 in ten minste 58% van de gevallen hallucinaties te produceren [4][9]. Voor complianceprofessionals is dit niveau van onnauwkeurigheid onacceptabel. De gevolgen kunnen ernstig zijn:

- Een Amerikaanse advocaat werd bestraft na het indienen van fictieve rechtsgevallen die door ChatGPT waren gegenereerd.

- Air Canada moest een vervalste "rouwverloftarief"-beleid honoreren dat door zijn AI-chatbot was gecreëerd [4].

Generieke AI heeft ook moeite om verouderde en actuele regelgevende normen van elkaar te onderscheiden, wat gevaarlijke compliance-gaten creëert. Het kan bijvoorbeeld ISO 27001:2013 en ISO 27001:2022 door elkaar halen, controlecijfers verzinnen die niet bestaan, of ten onrechte beweren dat ISO 27001 een SOC 2-Type II-onderzoek verplicht.

J.P. Roe, een professionele schrijver, vat het goed samen:

"De AI begrijpt de context niet - helemaal niet... Ik zou het persoonlijk niet gebruiken voor iets dat juridisch belastend is, tenzij ik een compliance-expert achter me heb staan om de fouten te corrigeren" [10].

Onderzoek toont aan dat 90% van de ISO 27001-falen voortkomt uit slecht documentbeheer en het onvermogen om aan te tonen dat controles bestaan [4]. Generieke AI mist de mogelijkheid om de verifieerbare bewijzen te genereren die nodig zijn om aan deze normen te voldoen. En naast nauwkeurigheid brengen problemen rond gegevensprivacy de beperkingen ervan verder aan het licht.

Gegevensprivacy- en locatieproblemen

Generieke AI-hulpmiddelen vormen ook aanzienlijke risico's voor gegevensprivacy en grensoverschrijdende gegevensoverdrachten. Zelfs wanneer providers beweren gegevens binnen de EU of het VK op te slaan, vindt de inferentiestap (waar GPU's invoer verwerken) vaak plaats in de Verenigde Staten [6]. Dit creëert compliance-uitdagingen voor organisaties die gebonden zijn aan GDPR Hoofdstuk V en de Schrems II-uitspraak.

Geoff Davies van PivotalEdge legde uit:

"Residentie is het sterkst voor opgeslagen gegevens. Als je strikte VK-alleenverwerking voor alles nodig hebt, controleer dan hoe OpenAI omgaat met inferentie... want niet alle workflows kunnen VK-alleenverwerking garanderen" [6].

Dit is vooral zorgwekkend omdat Amerikaanse AI-providers onderworpen zijn aan Amerikaanse surveillancewetten, die in conflict kunnen komen met Europese gegevensbeschermingsnormen. De risico's zijn reëel: in april 2023 lekten Samsung-ingenieurs per ongeluk propriëtaire broncode en interne vergadernotulen in ChatGPT terwijl ze het gebruikten voor samenvattingen en debugging - drie afzonderlijke incidenten in slechts 20 dagen. Als reactie hierop voerde Samsung een bedrijfsbreed verbod in op generatieve AI voor intern gebruik [4].

Ontbrekende gespecialiseerde compliancekennis

Generieke AI-hulpmiddelen schieten ook tekort als het gaat om het begrijpen van specifieke compliance-ramwerken of de unieke controleomgeving, auditgeschiedenis of risicoprofiel van een organisatie. Hoewel deze hulpmiddelen beleidsdocumenten kunnen opstellen, kunnen ze niet de objectieve, tijdgestempelde, vervalste documentatie produceren die auditors vereisen. Zoals Humadroid het verwoordde:

"Auditors beoordelen niet of je controles goed klinken. Ze beoordelen of je controles gedurende de hele auditperiode aantoonbaar hebben gewerkt" [4].

Een ander veelvoorkomend probleem: generieke AI verwart vaak wettelijke vereisten met best practices. Het kan bijvoorbeeld ten onrechte beweren dat AES-256-encryptie een wettelijke verplichting is, terwijl regelgeving simpelweg "passende beveiligingsmaatregelen" vereist op basis van een risicobeoordeling. Deze overvoorschrijving kan leiden tot onnodige kosten en inspanningen.

Deze hiaten benadrukken de noodzaak van het beste AI-assistent voor ISO 27001 dat persistente, raamwerk-specifieke context biedt en zich kan aanpassen aan de nuances van compliancewerk - iets waar generieke AI niet voor is gebouwd.

Hoe domeinspecifieke AI voldoet aan compliancebehoeften

Domeinspecifieke AI vertrouwt op geverifieerde regelgevende gegevens in plaats van onvoorspelbare internetpatronen. Deze aanpak zorgt ervoor dat antwoorden zijn gebaseerd op gestructureerde, gecureerde kennis - essentieel wanneer precisie niet onderhandelbaar is. Dit is hoe het de belangrijkste compliance-uitdagingen aanpakt.

Voorgevulde regelgevende raamwerken

In tegenstelling tot generieke AI zijn domeinspecifieke hulpmiddelen uitgerust met voorgevulde regelgevende raamwerken om nauwkeurigheid te garanderen. ISMS Copilot gebruikt bijvoorbeeld een systeem genaamd "Dynamische raamwerkkennisinjectie", dat gokwerk elimineert. Vermeld een standaard zoals ISO 27001 of SOC 2, en het systeem identificeert deze onmiddellijk met patroonherkenning. Vervolgens laadt het de relevante controles, clausules en vereisten in zijn context voordat het een antwoord genereert. Dit proces, dat slechts 5–15 seconden duurt, vermindert fouten bij raamwerk-specifieke vragen aanzienlijk [11][12][14].

De informatie is afkomstig uit gecureerde databases die zijn geverifieerd door Governance, Risk, and Compliance (GRC)-ingenieurs tegen officiële normen [12][13]. Momenteel ondersteunt ISMS Copilot 17 raamwerken, waaronder ISO 27001:2022, ISO 42001:2023, SOC 2, HIPAA, GDPR, NIS 2, DORA en de EU AI Act. Elk antwoord bevat specifieke citaten naar deze raamwerken, waardoor de outputs vanaf het begin auditklaar zijn [11][12][13].

Volledige auditlogboeken en beslissingsregistratie

Generieke AI reset bij elk gesprek, maar domeinspecifieke platforms behouden institutionele kennis over tijd - iets wat auditors waarderen. Dit is vooral belangrijk gezien het feit dat 90% van de ISO 27001-falen voortkomt uit slecht documentbeheer in plaats van ontbrekende technische controles [4].

ISMS Copilot biedt functies zoals wijzigingsregistratie, gescheiden werkruimtes voor verschillende projecten of klanten, en PII-reductiemodus, die automatisch persoonlijke informatie zoals namen, e-mails en telefoonnummers verwijdert voordat gegevens worden verwerkt. Gebruikers kunnen ook gegevensretentieperioden configureren, variërend van slechts 1 dag tot wel 7 jaar, om te voldoen aan regelgevende of interne beleidslijnen [13].

Controle over gegevenslocatie en flexibele implementatie

Voor organisaties die gebonden zijn aan strikte gegevenssoevereiniteitsregels zorgt domeinspecifieke AI voor compliance door regionale hostinggaranties. ISMS Copilot slaat bijvoorbeeld alle gegevens op in Frankfurt, Duitsland, en biedt een geavanceerde gegevensbeschermingsmodus die queries uitsluitend via EU-gebaseerde AI-providers zoals Mistral AI routeert [13][14]. Dit zorgt voor naleving van GDPR en andere gegevensbeschermingswetten.

Alle backend-providers werken onder Zero Data Retention (ZDR)-overeenkomsten, wat betekent dat gebruikersprompts en outputs nooit langdurig worden opgeslagen of worden gebruikt voor modeltraining [13][14]. Voor organisaties met nog strengere vereisten staan sommige platforms implementatie toe op locatie, in private clouds of op edge-infrastructuur, zodat gegevens volledig onder controle van de organisatie blijven [15]. Dit niveau van gegevensbeheer helpt organisaties om te voldoen aan zelfs de meest rigoureuze compliance-normen.

Gegevensprivacy en lokalisatie: Het belangrijkste verschil

Bij compliance zijn de locatie waar gegevens worden opgeslagen en wie er toegang toe heeft kritieke kwesties. Generieke AI-hulpmiddelen zoals ChatGPT verwerken gegevens vaak via infrastructuur in de VS, wat problemen kan veroorzaken voor bedrijven die onderworpen zijn aan Europese, Chinese of branche-specifieke regelgeving. Domeinspecifieke AI is daarentegen ontworpen met gegevenslokalisatie als prioriteit.

Het onderscheid tussen gegevensprivacy en lokalisatie is een belangrijke factor die domeinspecifieke AI scheidt van generieke oplossingen. In feite rangschikt 73% van de ondernemingen gegevensprivacy en -beveiliging als hun grootste zorg bij AI, en 77% houdt nu rekening met de herkomst van een leverancier bij aankoopbeslissingen [17]. Deze zorgen zijn niet alleen theoretisch - regelgevers hebben actie ondernomen. Zo:

- Meta kreeg in 2023 een boete van €1,2 miljard voor het overbrengen van EU-gebruikersgegevens naar de Verenigde Staten.

- TikTok kreeg in 2025 een boete van €530 miljoen voor het verzenden van gegevens van EU-burgers naar servers in China.

- Uber betaalde in 2024 €290 miljoen voor het verplaatsen van chauffeursgegevens over landsgrenzen [17][19].

Deze gevallen onderstrepen het belang van hoe domeinspecifieke AI gegevensopslag, verwerkingscontroles en grensoverschrijdende risicobeheer opnieuw definieert.

Voldoen aan regionale gegevensopslagwetten

Domeinspecifieke AI-platforms gaan zorgvuldig om met zowel gegevensresidentie (waar servers fysiek staan) als gegevenssoevereiniteit (het wettelijke kader dat die gegevens reguleert). Simpelweg "EU-regio" selecteren bij een Amerikaanse cloudprovider garandeert niet noodzakelijkerwijs compliance. Zoals Jaipal Singh uitlegt:

"De juridische jurisdictie volgt het bedrijf, niet het datacenter" [17].

Neem de EU AI Act Copilot als voorbeeld. Het slaat gegevens op in Frankfurt, Duitsland, en bevat een geavanceerde gegevensbeschermingsmodus die queries uitsluitend via EU-gebaseerde providers routeert. Alle backend-providers werken onder Zero Data Retention (ZDR)-overeenkomsten, wat betekent dat prompts en outputs niet worden opgeslagen of gebruikt voor modeltraining [1]. Deze opzet sluit aan bij GDPR-vereisten en helpt organisaties om onzekerheden te navigeren, vooral na de ineenstorting van het EU-VS Data Privacy Framework (vaak "Schrems III" genoemd) eind 2025 [18].

De inzet is hoog. Onder de EU AI Act kunnen boetes oplopen tot 7% van de wereldwijde jaaromzet of €35 miljoen, en gecombineerde overtredingen van GDPR en de AI Act kunnen theoretisch 11% van de wereldwijde omzet bedragen [18]. Tegen 2026 hadden ten minste 34 landen wetgeving voor gegevenslokalisatie geïntroduceerd of versterkt die van invloed is op AI-verwerking [18].

Verminderen van grensoverschrijdende gegevensrisico's

Zelfs wanneer gegevens regionaal worden opgeslagen, kunnen grensoverschrijdende gegevensstromen extra compliance-risico's met zich meebrengen. Generieke AI-API's creëren vaak verborgen gegevensstromen via secundaire paden, zoals contentmoderatie, veiligheidscontroles of logging. Deze contactpunten kunnen onder verschillende juridische jurisdicties vallen. Bovendien behouden veel generieke providers zich het recht voor om API-inputs te gebruiken voor modeltraining, tenzij gebruikers expliciet afzien [18].

Domeinspecifieke AI minimaliseert deze risico's met een doordachte ontwerpbenadering. Sommige platforms gebruiken bijvoorbeeld een "Inzichten, geen gegevens"-benadering, waarbij gegevens lokaal worden voorgeprocesd om persoonlijke identificatoren te verwijderen of te pseudonimiseren. Alleen geanonimiseerde inzichten worden naar cloudgebaseerde modellen verzonden [18]. Andere bieden werkomgevingisolatie, zodat gegevens van verschillende klanten of projecten gescheiden blijven [1].

Deze doordachte aanpak bespaart ook tijd en geld. Het implementeren van AI-gestuurde gegevensresidentie kan slechts 2–3 weken duren, in plaats van 4–6 maanden met handmatige methoden. De kosten dalen aanzienlijk, van een geschatte $150.000–$250.000 naar $40.000–$80.000. Geautomatiseerde validatie zorgt voor 100% nauwkeurigheid, terwijl handmatige controles een foutpercentage van 15–20% hebben [16].

Duidelijke controle over gegevensverwerking en -opslag

Domeinspecifieke AI-platforms bieden transparantie en controle over elke stap van de gegevensverwerking. Terwijl generieke AI vaak als een "black box" werkt, onthullen domeinspecifieke oplossingen de hele verwerkingsketen. ISMS Copilot stelt organisaties bijvoorbeeld in staat om gegevensretentie-instellingen te configureren om te voldoen aan zowel regelgevende als interne beleidslijnen. Het bevat ook functies om gevoelige persoonlijke informatie automatisch te redacteren tijdens de verwerking. Sommige platforms bieden zelfs implementatieopties zoals op locatie, private cloud of edge-opstellingen om gegevens volledig onder controle van de organisatie te houden.

| Factor | Domeinspecifieke AI (bijv. ISMS Copilot) | Generieke AI (bijv. ChatGPT) |

|---|---|---|

| Gegevenslocatie | Gegarandeerd regionaal (bijv. Frankfurt, Duitsland) [1] | Typisch infrastructuur in de VS [1] |

| Modeltraining | Standaard geen training op gebruikersgegevens [1] | Kan inputs gebruiken voor training (opt-out vereist) [1] |

| Jurisdictie | Vaak niet-Amerikaans of soevereine cloudgebaseerd [17] | Onderworpen aan de Amerikaanse CLOUD Act [17] |

| Gegevensisolatie | Geïsoleerde werkomgevingen voor multi-clientgebruik [1] | Eenvoudige gespreksdraden; risico op gegevenscrossover [1] |

Zoals Prem AI het treffend verwoordt:

"Het tijdperk van 'move fast and figure out compliance later' is voorbij voor AI" [19].

Organisaties die prioriteit geven aan gegevenslocatie en compliance vanaf het begin - en niet als naslagwerk - zijn beter uitgerust om audits te doorstaan en boetes te vermijden. Deze sterke basis voor gegevensbeheer heeft direct invloed op de prestaties, wat het volgende onderdeel verkent aan de hand van nauwkeurigheidsmetrieken en auditgereedheid.

Prestatievergelijking: Generieke AI vs Domeinspecifieke AI

Bij compliance-taken zijn de prestatieverschillen tussen generieke AI en domeinspecifieke oplossingen moeilijk te negeren. Hoewel generieke AI-modellen zoals ChatGPT, Claude en Gemini uitstekend zijn voor algemene taken, vallen ze vaak kort bij taken die precisie, gedetailleerde auditlogboeken en robuuste documentatie vereisen. Domeinspecifieke platforms, zoals ISMS Copilot, zijn daarentegen specifiek ontworpen om deze uitdagingen aan te gaan.

Nauwkeurigheid bij het detecteren van compliance-gaten

Generieke AI-modellen baseren hun voorspellingen op brede datasets, wat vaak leidt tot nauwkeurigheidsproblemen bij compliance-werk. Een Stanford-studie uit 2024 toonde aan dat GPT-4 "hallucineerde" - of onjuiste informatie genereerde - 58% van de tijd bij het beantwoorden van verifieerbare juridische vragen [4]. Deze fouten omvatten:

- Het verzinnen van controlecijfers.

- Het door elkaar halen van raamwerkversies.

- Het verstrekken van te rigide of onjuiste mandaten.

Domeinspecifieke AI lost deze problemen op via een methode genaamd Raamwerkkennisinjectie, die ervoor zorgt dat antwoorden zijn gebaseerd op geverifieerde regelgevende teksten. ISMS Copilot v2.5 gebruikt deze aanpak bijvoorbeeld om het verzinnen van vereisten over meer dan 50 regelgevende raamwerken vrijwel te elimineren [1][2].

| Nauwkeurigheidsfactor | Domeinspecifieke AI (bijv. ISMS Copilot) | Generieke AI (bijv. ChatGPT, Claude) |

|---|---|---|

| Hallucinatiepercentage | Bijna geëlimineerd voor raamwerkvragen [1][2] | 58–88% bij domeinspecifieke vragen [4] |

| Raamwerkversie | Duidelijke onderscheidingen (bijv. ISO 27001:2013 vs. 2022) [1] | Haalt versies vaak door elkaar [4] |

| Controlenauwkeurigheid | Gebaseerd op geverifieerde regelgevende tekst [1][2] | Neiging tot verzinnen of verkeerd citeren van controles [4] |

| Institutionele kennis | Behoudt organisatiecontroleomgevingen over tijd [4] | Reset bij elke sessie, zonder persistentie [4] |

Deze discrepanties benadrukken het belang van nauwkeurigheid en goede documentatie, wat essentieel is voor compliance en auditgereedheid.

Auditregistraties en besluitdocumentatie

Voorbereiding op audits is een ander gebied waar domeinspecifieke AI uitblinkt. Zoals Humadroid het verwoordt:

"Auditors beoordelen niet of je controles goed klinken. Ze beoordelen of je controles gedurende de hele auditperiode aantoonbaar hebben gewerkt." [4]

Generieke AI genereert doorgaans basisgesprekslogboeken, die weinig waarde hebben als auditbewijs. Domeinspecifieke platforms bieden daarentegen vervalste auditlogboeken en geautomatiseerde bewijsverzameling via integraties met tools zoals AWS en GitHub. Dit versterkt niet alleen de auditgereedheid, maar vermindert ook aanzienlijk de voorbereidingstijd en het aantal auditbevindingen [3][4].

Dit is de impact in cijfers:

- Bedrijven die automatiseringsplatforms voor compliance gebruiken, melden een 40–60% vermindering in auditvoorbereidingstijd.

- Ze zien ook 50–70% minder auditbevindingen bij hun eerste externe audit [4].

Daarnaast leidt handmatig compliancebeheer vaak tot kostbare fouten, waarbij 88% van de spreadsheets fouten bevat en 90% van de ISO 27001-falen voortkomt uit slecht documentbeheer in plaats van ontbrekende technische controles [4].

Branchespecifieke toepassingen

De voordelen van domeinspecifieke AI reiken verder dan nauwkeurigheid en auditlogboeken, vooral in gereguleerde branches. Zo:

- ISO 27001: Gespecialiseerde platforms automatiseren mapping voor de controleset van 2022, terwijl generieke AI vaak verwijst naar verouderde controles uit 2013 of zelfs niet-bestaande controles [4].

- GDPR: Domeinspecifieke hulpmiddelen bieden gedetailleerde gatentests en EU-gegevensresidentie, terwijl generieke AI vertrouwt op infrastructuur in de VS en slechts oppervlakkig advies geeft [1][4].

- SOC 2: Platforms zoals ISMS Copilot maken continue bewijsverzameling mogelijk via API-integraties, wat aantoont dat controles gedurende de tijd werken - iets wat generieke AI niet kan

Gerelateerde artikelen

Hoe AI regelgevende wijzigingen bijhoudt

Legt uit hoe AI NLP, ML en realtime-alerts gebruikt om regelgevende updates te monitoren, impact op controles in kaart te brengen en de compliance- werkbelasting te verminderen.

EU AI Act: Eisen voor robuustheidstesten uitgelegd

Uitleg van de vereisten uit Artikel 15 voor robuustheidstesten van hoogrisico AI-systemen: tests, documentatie, monitoring en nalevingsdeadlines.

ISO 27001 Risicobeoordeling met AI: Checklist voor Startups

Gebruik AI om ISO 27001 risicobeoordelingen voor startups te versnellen—scope, inventarisatie van activa, scoring, control mapping en continue monitoring.