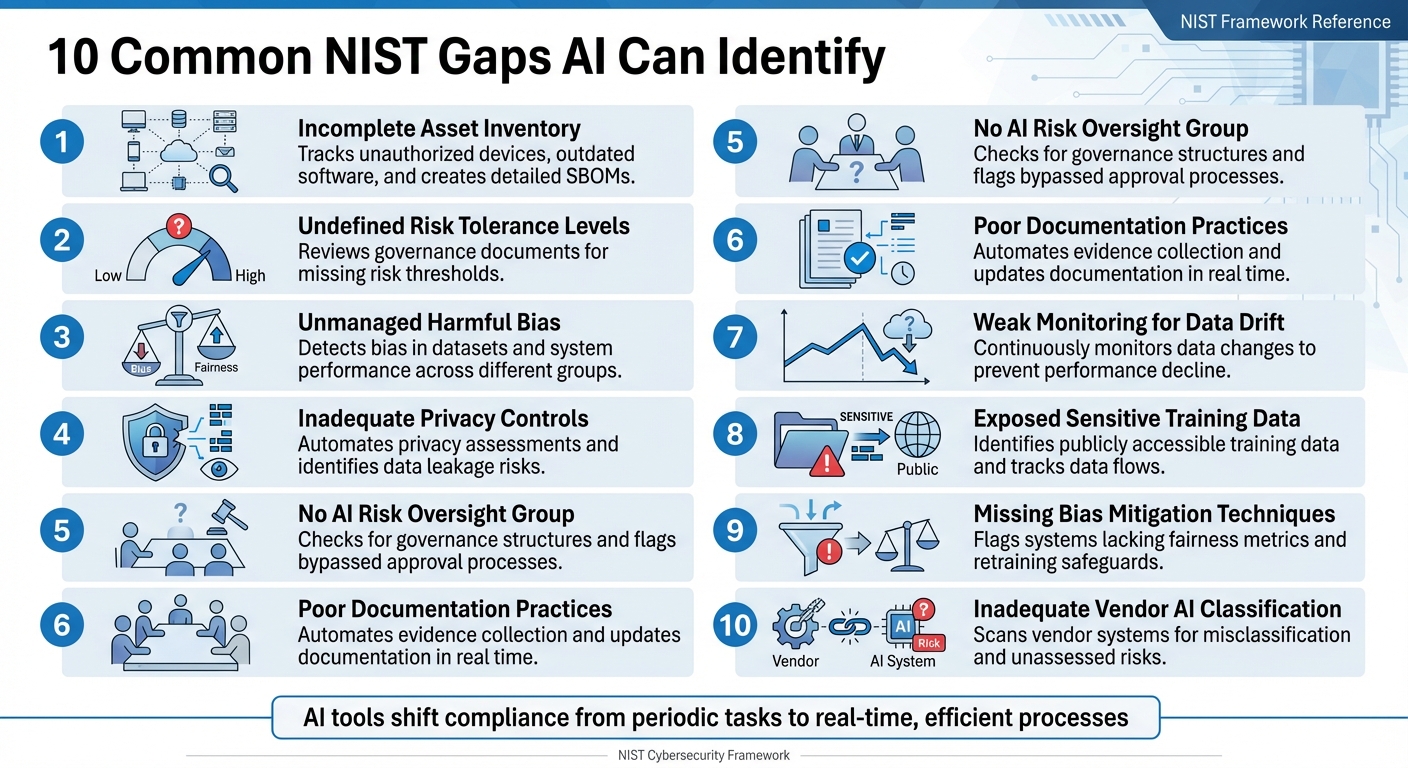

10 veelvoorkomende NIST-gaten die AI kan opsporen

AI automatiseert NIST-gatendetectie - vind risico's met betrekking tot activa, vooringenomenheid, privacy, datadrift en leveranciers, genereer auditklaar bewijs.

Organisaties worstelen vaak met het behalen van volledige naleving van het NIST Cybersecurity Framework (CSF), met name de recentste versie CSF 2.0. Handmatige audits zijn traag en foutgevoelig, waardoor gaten ontstaan op gebieden zoals activa-inventarisatie, risicobeheer en privacycontroles. AI-gestuurde tools veranderen het spel door nalevingscontroles te automatiseren, continue monitoring te bieden en gaten in realtime te identificeren. Hieronder staan 10 veelvoorkomende NIST-nalevingsgaten die AI kan aanpakken:

- Onvolledige activa-inventarisatie: AI spoort niet-toegestane apparaten, verouderde software op en maakt gedetailleerde Software Bills of Materials (SBOM's).

- Ondefinieerde risicotolerantieniveaus: AI controleert governance-documenten op ontbrekende risicodrempels.

- Onbeheerde vooringenomenheid: AI detecteert vooringenomenheid in datasets en systeemprestaties over verschillende groepen.

- Ontoereikende privacycontroles: AI automatiseert privacybeoordelingen en identificeert risico's zoals datalekken.

- Geen risico-overzichtsorgaan voor AI: AI controleert op governance-structuren en signaleert omzeilde goedkeuringsprocessen.

- Slechte documentatiepraktijken: AI automatiseert het verzamelen van bewijs en actualiseert documentatie in realtime.

- Zwakke monitoring van datadrift: AI-tools monitoren continu dataveranderingen om prestatieverlies te voorkomen.

- Blootgestelde gevoelige trainingsdata: AI identificeert risico's zoals openbaar toegankelijke trainingsdata en volgt datastromen.

- Ontbrekende technieken voor vooringenomenheidsmitigatie: AI signaleert systemen zonder eerlijkheidsmetrieken en hertrainingsbeveiligingen.

- Ontoereikende classificatie van leveranciers-AI: AI scant leverancierssystemen op verkeerde classificatie en niet-beoordeelde risico's.

AI-tools zoals ISMS Copilot stroomlijnen naleving door gatendetectie te automatiseren, controles af te stemmen op NIST-standaarden en auditklaar documentatie te genereren. Dit verandert naleving van een periodieke taak in een efficiënt, realtime proces.

10 veelvoorkomende NIST-nalevingsgaten die AI kan opsporen en oplossen

GRC - Gatendetectie 101 met behulp van NIST RMF en CIS Controls naleving

1. Onvolledige activa-inventarisatie

Een grondige activa-inventarisatie is cruciaal voor het voldoen aan NIST-nalevingsvereisten. Toch hebben veel organisaties moeite om alle apparaten, applicaties en softwarecomponenten bij te houden. Wanneer activa niet worden bijgehouden, ontstaan er kwetsbaarheden die aanvallers kunnen uitbuiten.

Een NIST 800-53 Copilot kan helpen door de werkelijke staat van je netwerk te vergelijken met de gewenste staat. Continue scanning toont afwijkingen van je goedgekeurde activa-lijst, waardoor het makkelijker wordt om problemen zoals niet-toegestane apparaten of verouderde software zonder kritieke beveiligingspatches te spotten. Dit continue proces versterkt niet alleen het risicobeheer, maar biedt ook waardevolle inzichten in de beveiliging van je netwerk.

"De focus van de SWAM-capaciteit ligt op het beheren van risico's die worden gecreëerd door niet-beheerde of niet-toegestane software op een netwerk. Niet-beheerde of niet-toegestane software is een doelwit dat aanvallers kunnen gebruiken als platform om componenten op het netwerk aan te vallen." – NIST IR 8011 Vol. 3

Naast scannen bieden CDM-dashboards realtime zichtbaarheid in je activa-inventaris, waardoor verouderde, statische audits worden vervangen door continue monitoring. AI-systemen kunnen ook automatisch een gedetailleerde Software Bill of Materials (SBOM) voor elke softwarebuild maken, waarbij elke component en afhankelijkheid wordt gecatalogiseerd – of deze nu direct of indirect is. Deze functionaliteit wordt steeds belangrijker, aangezien bijna 220.000 Amerikaanse organisaties moeten voldoen aan CMMC-normen, waarvan 80.000 onderworpen zijn aan Level 2-controles die aansluiten bij NIST SP 800-171.

Om je activa-inventaris te verbeteren, overweeg het gebruik van Software Identification (SWID)-tags om de ontdekking van software in je netwerk te automatiseren. Je kunt ook geautomatiseerde whitelisting implementeren om ervoor te zorgen dat alleen goedgekeurde software mag worden uitgevoerd. Voor AI-systemen is het essentieel om niet alleen hardware, maar ook de derdepartijintegraties waarop ze vertrouwen, in inventaris op te nemen, aangezien deze externe componenten extra risico's kunnen introduceren.

2. Ondefinieerde risicotolerantieniveaus

Veel organisaties herkennen de risico's die gepaard gaan met AI, maar slagen er vaak niet in duidelijke grenzen te stellen voor wat acceptabel is. Zonder deze gedefinieerde kaders vinden teams het lastig om te bepalen wanneer ze een project moeten voortzetten of moeten pauzeren. Hier komen AI-tools van pas. Met behulp van natuurlijke taalverwerking kunnen cross-framework ISMS-assistenten beleidsdocumenten, risicobeheerstrategieën en governance-frameworks controleren om te bevestigen of specifieke criteria – zoals kwantitatieve limieten of kwalitatieve grenzen – zijn vastgesteld voor verschillende AI-toepassingen. Systemen die bijvoorbeeld gevoelige data verwerken, zoals persoonsgegevens (PII), vereisen strengere drempels om veiligheid en naleving te waarborgen. Wanneer deze beveiligingen ontbreken, is onmiddellijke corrigerende actie noodzakelijk, zoals benadrukt door NIST.

"Voor zover uitdagingen voor het specificeren van AI-risicotoleranties nog niet zijn opgelost, kunnen er contexten zijn waarin een risicobeheersingskader niet direct toepasbaar is voor het mitigeren van negatieve AI-risico's." – NIST AI RMF 1.0

NIST definieert risicotolerantie als "de bereidheid van de organisatie of de AI-actor om het risico te dragen om haar doelen te bereiken". AI-tools spelen een cruciale rol door governance-documenten te scannen om te controleren op duidelijk gedocumenteerde criteria voor risicoacceptatie, of het nu gaat om numerieke limieten of bredere kwalitatieve kaders. Het NIST AI Risk Management Framework, geïntroduceerd op 26 januari 2023, schrijft echter geen specifieke tolerantieniveaus voor. In plaats daarvan benadrukt het het belang van het identificeren van gaten – zoals ontbrekende documentatie over resterende risico's of vage risicobeheerstrategieën – die organisaties kunnen blootstellen.

NIST geeft in dergelijke scenario's een duidelijke richtlijn:

"In gevallen waarin een AI-systeem onacceptabele negatieve risiconiveaus vertoont... moet de ontwikkeling en implementatie veilig worden stopgezet totdat de risico's voldoende kunnen worden beheerd." – NIST AI RMF 1.0

3. Onbeheerde schadelijke vooringenomenheid

Vooringenomenheid in AI-systemen ontstaat door de interactie van code, trainingsdata en de bredere sociale context. Zonder de juiste nalevingsbeleid kunnen deze systemen bestaande ongelijkheden verergeren of zelfs nieuwe patronen van discriminatie creëren. Dit heeft echte gevolgen in sectoren zoals gezondheidszorg, werving en financiën. Het probleem wordt verergerd door de complexiteit van AI-systemen, die vaak talloze beslispunten omvatten, waardoor het bijna onmogelijk is om vooringenomenheid handmatig te identificeren en aan te pakken. Organisaties wenden zich vaak tot een AI-nalevingsassistent om deze complexe, meerstapsworkflows te beheren.

"Zonder de juiste controles kunnen AI-systemen ongelijke of ongewenste uitkomsten voor individuen en gemeenschappen versterken, bestendigen of verergeren." – NIST AI RMF 1.0

AI-tools pakken schadelijke vooringenomenheid aan via processen zoals Testen, Evaluatie, Verificatie en Validatie (TEVV), zoals uiteengezet in de MEASURE-functie van het NIST AI RMF. Deze processen beoordelen of trainingsdatasets aansluiten bij hun beoogde doel en de huidige maatschappelijke omstandigheden weerspiegelen. Geautomatiseerde monitoring speelt hier een sleutelrol, waarbij "datadrift" wordt geïdentificeerd, wat verwijst naar veranderingen in invoergegevens die de systeemprestaties kunnen beïnvloeden en nieuwe vooringenomenheid kunnen introduceren die niet aanwezig was tijdens de initiële testfase.

Dit detectieproces gaat verder dan alleen het verwerken van cijfers. AI-tools evalueren hoe systemen presteren over verschillende subgroepen, waarbij ze erkennen dat zelfs mensen die het systeem niet direct gebruiken, kunnen worden beïnvloed. Deze aanpak, vaak socio-technische evaluatie genoemd, houdt niet alleen rekening met het technische ontwerp, maar ook met hoe het interageert met maatschappelijke normen en menselijk gedrag om ongelijkheden te produceren. Om objectiviteit te waarborgen, pleit NIST voor een duidelijke verdeling van verantwoordelijkheden – teams die AI-modellen bouwen, moeten gescheiden zijn van diegenen die ze verifiëren en valideren. Deze opzet maakt meer onpartijdige beoordelingen en continue monitoring op vooringenomenheid over alle gebruikersgroepen mogelijk.

Een andere sleutelstrategie voor het beheren van vooringenomenheid is verbeterde datatracking. Organisaties die AI-native zichtbaarheidstools gebruiken, meldden bijvoorbeeld een verbazingwekkende toename van 1.660% in hun vermogen om dataverwerkingsactiviteiten binnen slechts drie weken na implementatie te monitoren. Deze tools in kaart brengen "datapaden", waarbij ze volgen hoe data van de bron door AI-modellen stroomt. Door dit te doen, kunnen ze potentiële schendingen in realtime voorspellen en voorkomen. Dit is cruciaal, aangezien AI data verwerkt met snelheden die ver buiten het bereik van handmatige teams liggen. Het volgen van deze datastromen is essentieel om veranderingen te detecteren die kunnen leiden tot nieuwe of verergerende vooringenomenheid voordat ze schade veroorzaken.

4. Ontoereikende privacycontroles

De snelle snelheid en schaal van AI-systemen maken privacygaten een aanzienlijke zorg, vooral omdat handmatige toezicht niet kan bijhouden. Zonder de juiste privacybeveiligingen lopen organisaties het risico persoonsgegevens bloot te stellen door lekken in trainingsdata, ongeautoriseerde toegang of onbedoelde openbaarmakingen in modeloutputs. Het gebruik van API's voor datainname en inferentie vergroot het aanvalsvlak verder, waardoor robuuste privacycontroles een noodzaak zijn.

Om deze uitdagingen aan te gaan, automatiseren AI-tools, waaronder gespecialiseerde nalevingsassistenten, nu privacycontrolebeoordelingen met behulp van machineleesbare formaten zoals OSCAL. Deze tools evalueren continu controles uit kaders zoals NIST SP 800-53, waarbij formaten zoals JSON, XML en YAML worden gebruikt. Opvallend is dat NIST op 27 augustus 2025 versie 5.2.0 van SP 800-53 heeft uitgebracht, die privacycontroles volledig heeft geïntegreerd in de bredere beveiligingscontrolecatalogus, weg van de eerdere standalone-benadering.

"Het aanpakken van functionaliteit en zekerheid helpt ervoor te zorgen dat informatietechnologieproducten en de systemen die afhankelijk zijn van die producten voldoende betrouwbaar zijn." – Gezamenlijke Task Force, NIST SP 800-53 Rev. 5

Geautomatiseerde tools richten zich op de PII Processing and Transparency (PT)-controlefamilie om ongeautoriseerd PII-gebruik, openbaarmakingen of risico's op de-anonimisering te identificeren. Ze onthullen ook schaduw-API's en schaduw-AI die handmatige audits vaak over het hoofd zien. Door "Policy-as-Code" te implementeren, kunnen organisaties de complexe vereisten van NIST SP 800-53 omzetten in realtime operationele regels. Dit proces wordt gestroomlijnd wanneer organisaties hun AI-nalevingsassistenten trainen op hoognauwkeurige modellen die zijn ontworpen voor GRC. Deze regels wissen automatisch gevoelige data uit AI-prompts en outputs voordat ze door het model worden verwerkt.

Daarnaast ondersteunt NIST's Dioptra-software red-team-oefeningen, waardoor organisaties privacy- en beveiligingscontroles onder adversariale omstandigheden kunnen testen. Deze simulaties kunnen prestatieverlies meten en specifieke kwetsbaarheden identificeren. Dit is vooral belangrijk, aangezien het NIST AI RMF Generative AI Profile 12 unieke of verhoogde risico's beschrijft die gepaard gaan met AI, waaronder privacyzorgen zoals lekken en ongeautoriseerde de-anonimisering. Op 14 april 2025 benadrukte NIST deze kwesties verder door het concept Privacy Framework 1.1 uit te brengen, dat specifiek AI-gerelateerde privacyrisico's zoals inferentieaanvallen en versterking van vooringenomenheid aanpakt.

5. Geen risico-overzichtsorgaan voor AI

Een groot uitdaging in AI-risicobeheer is het ontbreken van een toegewijd overzichtsorgaan. Zonder zo'n comité vallen governance en verantwoordelijkheid vaak door de mazen van de wet, wat leidt tot gefragmenteerde en lager geprioriteerde inspanningen. Tegenwoordig kunnen geavanceerde tools die gebruikmaken van Natural Language Processing (NLP) dit gat helpen dichten door organisatorische beleidsdocumenten, statuten en notulen te analyseren. Deze tools kunnen bevestigen of een formeel risico-overzichtsorgaan voor AI bestaat en ervoor zorgen dat het aansluit bij de "Govern"-functie van het NIST AI RMF – met name Govern 1.2, die het belang benadrukt van duidelijke governance- en verantwoordelijkheidsstructuren.

AI-gestuurde systemen onderzoeken ook organisatorische schema's en identiteitsbeheersystemen om formele overzichtsrollen binnen AI-risicobeheer te identificeren. Governance-platforms voegen een extra beschermingslaag toe door projecten te markeren die formele goedkeuringsprocessen omzeilen. Dit zorgt voor continue toezicht, een kritische component voor het naleven van het NIST RMF. De "Govern"-functie fungeert als fundament en beïnvloedt alle andere RMF-functies zoals Map, Measure en Manage. Deze onderling verbonden aanpak versterkt het gehele kader.

"Zonder gedefinieerde verantwoordelijkheid kunnen inspanningen op het gebied van AI-risicobeheer gefragmenteerd of ondergewaardeerd raken, waardoor de organisatie blootstaat." – Kezia Farnham, Senior Manager, Diligent

De urgentie voor de juiste overzicht is onderstreept door de snelle groei in AI-investeringen en regelgeving. In 2024 overschreed de particuliere sector in de VS de $100 miljard aan AI-investeringen, terwijl vermeldingen van AI in mondiale wetgeving met 21,3% stegen over 75 landen sinds 2023 – een verbazingwekkende negenvoudige stijging sinds 2016. Zonder formele overzichtsmechanismen lopen organisaties het risico niet te voldoen aan opkomende regelgeving, zoals de EU AI Act en de Amerikaanse Executive Order 14110, die het belang van menselijk toezicht en controleerbaar risicobeheer benadrukken.

Om dit gat te dichten, moeten organisaties een cross-functioneel AI-risicocomité vormen dat sleutelfiguren zoals de juridisch adviseur, Chief Information Security Officer (CISO), Chief Risk Officer en AI/ML-leads omvat. Het toewijzen van verantwoordelijkheid voor het AI RMF aan een enkele executive – vaak de Head of Risk of Legal – kan de verantwoordelijkheid verder centraliseren. Daarnaast kan het adopteren van een speciaal gebouwd AI-nalevingsassistent dit proces stroomlijnen, waarbij de mapping van rollen en verantwoordelijkheden wordt geautomatiseerd en verouderde handmatige spreadsheets worden vervangen door continue monitorsystemen.

6. Slechte documentatiepraktijken

Gebouwd op eerdere problemen met activa-inventarisatie en overzicht, ondermijnt slechte documentatie nalevingsinspanningen verder. Documentatiegaten zijn zowel wijdverspreid als kostbaar als het gaat om NIST-naleving. Een opvallende 86% van de organisaties heeft geen zicht op hun AI-datastromen, wat leidt tot significante documentatie- en auditgaten die problemen kunnen veroorzaken tijdens regelgevende controles. Wanneer auditors bijvoorbeeld logs van AI-interacties met persoonsgegevens opvragen, kunnen veel organisaties deze niet overleggen. Deze mislukking schendt belangrijke regelgeving zoals GDPR Artikel 30, CCPA Sectie 1798.130 en HIPAA § 164.312.

AI-gestuurde nalevingsplatforms bieden een praktische oplossing door verouderde handmatige spreadsheets te vervangen door realtime dashboards. Deze dashboards markeren automatisch ontbrekend bewijs en documentatieproblemen. Ze gebruiken ook continue controlemonitoring om "drift" te detecteren – gevallen waarin de huidige documentatie of beleidsdocumenten niet meer overeenkomen met de werkelijke staat van systemen of infrastructuur. Geautomatiseerde tools vangen realtime configuraties en logs op, waardoor uitgebreide audittrails worden gecreëerd.

"Elke verandering, implementatie en incident als een documentatiegebeurtenis behandelen zorgt voor een gestage opbouw van bewijs dat veel betrouwbaarder is dan een haastige naschriftinspanning." – Abnormal AI

Het principe van "documenteren terwijl je gaat" versterkt de naleving door bewijs in realtime vast te leggen. Door te integreren met tools zoals versiebeheerde wiki's en ticketingsystemen, zorgt AI ervoor dat goedkeuringen en schermafbeeldingen aan pull requests worden gekoppeld. Dit is vooral cruciaal, aangezien slechts 17% van de organisaties geautomatiseerde AI-beveiligingscontroles heeft geïmplementeerd die de logs kunnen leveren die vereist zijn voor regelgevende audits.

Organisaties die geautomatiseerde nalevingsplatforms gebruiken, zien grote voordelen, waaronder het verkorten van beoordelingscycli van weken tot slechts uren en het aanzienlijk verlagen van de nalevingswerkbelasting. Deze tools in kaart brengen ook het "huidige profiel" van een organisatie tegen een NIST "doelprofiel", waarbij gaten in beveiligingen en documentatie worden aangewezen. Door het "Identificeer–Beoordeel–Categoriseer"-proces te automatiseren, helpen ze ervoor te zorgen dat activa-inventarissen en risicoclassificaties up-to-date blijven. Deze continue benadering van documentatie speelt een sleutelrol in het behouden van NIST-naleving.

sbb-itb-4566332

7. Zwakke monitoring van datadrift

Datadrift treedt op wanneer de data waarop een AI-systeem is getraind in de loop van de tijd verandert, wat leidt tot een daling in prestaties en betrouwbaarheid. Met meer dan 75% van de organisaties die nu AI in ten minste één bedrijfsfunctie gebruiken, creëert het niet monitoren van deze verschuivingen een serieus nalevingsrisico – één dat AI-gestuurde tools goed kunnen aanpakken. Het aanpakken van dit probleem vereist geavanceerdere monitoringoplossingen, zoals hieronder uiteengezet.

In de praktijk functioneert AI vaak als een "black box", waardoor het moeilijker wordt om te detecteren wanneer er iets misgaat. 45% van de organisaties noemt zorgen over de nauwkeurigheid van data of vooringenomenheid als een grote belemmering voor het adopteren van AI. Toch ontbreekt het velen nog steeds aan de tools voor continue monitoring, waardoor ze kwetsbaar blijven voor datadrift. In tegenstelling tot handmatige controles stelt continue monitoring realtime analyse in staat, waardoor problemen worden opgespoord voordat ze escaleren.

"AI-systemen... kunnen zijn getraind op data die in de loop van de tijd kunnen veranderen, soms aanzienlijk en onverwacht, wat de functionaliteit en betrouwbaarheid van het systeem op manieren die moeilijk te begrijpen zijn beïnvloedt."

Om datadrift aan te pakken, kunnen geavanceerde AI-SPM-tools automatisch ingezette AI-modellen detecteren, "schaduw-AI" identificeren en zowel trainings- als inferentiedatasets in kaart brengen, inclusief documentenopslag en vectordatabases. Deze tools markeren ook misconfiguraties, zoals openbaar toegankelijke trainingsdata, die beveiligingsrisico's kunnen vormen.

Bijvoorbeeld, Net Solutions werkte recentelijk met een Noord-Amerikaans bedrijf in de schoonmaaksector om AI-governance toe te passen voor een verkoopchatassistent. Door realtime monitoringtools zoals AWS CloudWatch en DataDog te gebruiken, samen met geautomatiseerde pijplijnen geïntegreerd met Zoho Desk-waarschuwingen, slaagde het bedrijf erin om binnen zes weken over te gaan van een proof-of-concept naar een conforme, schaalbare AI-oplossing.

Technoloog Akash Lomas van Net Solutions benadrukt het belang van monitoring:

"Meting wordt vooral cruciaal in omgevingen waar AI direct de klantervaring vormgeeft... zonder continue toezicht kunnen deze systemen afdrijven – door irrelevante, vooringenomen of misleidende inhoud te serveren."

Het negeren van datadrift kan leiden tot grote gevolgen: verminderde systeemprestaties, regelgevende boetes en verlies van vertrouwen. Bovendien kosten cyberaanvallen bedrijven jaarlijks gemiddeld $4,45 miljoen.

8. Blootgestelde gevoelige trainingsdata

Het risico van het blootstellen van gevoelige trainingsdata is een serieuze zorg, met name als het gaat om nalevingsschendingen. Volgens NIST introduceert Generatieve AI 12 verschillende risico's, waarbij privacykwesties – zoals lekken en ongeautoriseerde openbaarmaking van persoonsgegevens – een belangrijk aandachtspunt vormen. Veel organisaties hebben moeite om bij te houden waar hun AI-trainingsdata zich bevinden en ervoor te zorgen dat deze veilig is.

Om dit aan te pakken, zijn AI-Security Posture Management (AI-SPM)-tools essentieel geworden. Deze tools kunnen automatisch ingezette AI-modellen identificeren en de datasets lokaliseren die worden gebruikt voor training over cloudplatforms, inclusief documentopslag en vectordatabases. Ze markeren ook kwetsbaarheden, zoals openbaar toegankelijke trainingsdata of open applicatie-eindpunten. Mahesh Nawale, Product Marketing Manager bij Zscaler, benadrukt het belang van deze tools:

"Zscaler AI-SPM lokaliseert automatisch datasets die worden gebruikt in AI-training en inferentie in je cloudomgeving – inclusief data, documentopslag en vectordatabases. Het markeert misconfiguraties zoals openbaar toegankelijke trainingsdata, waardoor je beveiligingsteams de inzichten krijgen die nodig zijn om te onderzoeken, te herstellen en naleving te bewijzen."

AI-tools gaan verder dan alleen het identificeren van misconfiguraties. Ze monitoren ook het gedrag van modellen om potentiële bedreigingen op te sporen. Ze kunnen bijvoorbeeld problemen detecteren zoals datageheugen, modelinversie of verdachte activiteiten zoals grote datadownloads of ongeautoriseerde wijzigingen, die kunnen wijzen op datalekken. Geautomatiseerde scanmogelijkheden versterken de beveiliging verder door gevoelige informatie – zoals biometrische, gezondheids- of locatiegegevens – te identificeren die niet op de juiste manier zijn geanonimiseerd.

NIST heeft ook "Dioptra" ontwikkeld, een softwareoplossing die organisaties helpt om AI-modellen te testen tegen cyberaanvallen. Het meet hoe aanvallen de modelprestaties beïnvloeden en identificeert scenario's waarin trainingsdata risico kunnen lopen.

Katerina Megas, Program Manager bij NIST, benadrukt de groeiende uitdaging:

"AI creëert nieuwe heridentificatierisico's, niet alleen vanwege zijn analytische kracht over uiteenlopende datasets, maar ook vanwege het potentiële risico op datalekken uit modeltraining."

Met de enorme datasets die worden gebruikt bij het trainen van Large Language Models is continue geautomatiseerde testing geen optie meer – het is een noodzaak om gevoelige informatie te beschermen.

9. Ontbrekende technieken voor vooringenomenheidsmitigatie

Wanneer AI-systemen geen juiste methoden hebben om vooringenomenheid aan te pakken, lopen ze het risico oneerlijke uitkomsten te versterken en significante nalevingsproblemen te creëren. Volgens NIST is het beheren van schadelijke vooringenomenheid een van de zeven kritische eigenschappen van een betrouwbaar AI-systeem. Traditionele risicobeheerraamwerken schieten tekort in het omgaan met AI-vooringenomenheid, waardoor gespecialiseerde mitigeringsstrategieën essentieel zijn. Hoewel eerdere secties het detecteren van vooringenomenheid hebben behandeld, vereist het effectief aanpakken ervan duidelijke controles en doorlopende hertrainingsinspanningen. Het simpelweg identificeren van vooringenomenheid is niet genoeg – er zijn langetermijnstrategieën nodig om het tegen te gaan.

AI-tools spelen een sleutelrol bij het opsporen van gaten in vooringenomenheidscontroles. Ze markeren problemen zoals ontbrekende eerlijkheidsmetrieken (bijv. dispariteit in impactverhoudingen of verschillen in vals-positiefpercentages), systemen zonder adversariale testing of AI-red teaming, en modellen zonder geplande hertraining, waardoor ze kwetsbaar blijven voor datadrift.

"Zonder de juiste controles kunnen AI-systemen ongelijke of ongewenste uitkomsten voor individuen en gemeenschappen versterken, bestendigen of verergeren." – NIST AI RMF 1.0

Om deze uitdagingen aan te gaan, voeren AI-governanceplatforms geautomatiseerde scans uit om nalevingsgaten te ontdekken op basis van de richtlijnen van het NIST AI RMF. Ze zorgen ervoor dat organisaties de nodige beveiligingen hebben geïmplementeerd, zoals inhoudsfilters, protocollen voor vooringenomenheidscorrectie en andere beveiligingen die worden voorgeschreven door normen zoals NIST AI 600-1. Deze platforms traceren ook datalijnen om te bevestigen dat trainingsdatasets vrij zijn van problemen die kunnen leiden tot vooringenomen resultaten. Daarnaast identificeren AI-Security Posture Management (AI-SPM)-tools alle ingezette AI-modellen, inclusief "schaduw-AI"-systemen die mogelijk helemaal geen eerlijkheidstesten hebben ondergaan.

Met AI-systemen die miljarden beslissingen nemen, kunnen onopgemerkte vooringenomenheden het publieke vertrouwen aantasten, burgerrechten schenden en regelgevende boetes opleggen. Opvallend is dat er sinds 2023 een wereldwijde stijging van 21,3% is in vermeldingen van AI-wetgeving. Deze risico's benadrukken de dringende behoefte aan continue, geautomatiseerde toezicht om eerlijkheid en verantwoordelijkheid te waarborgen.

10. Ontoereikende classificatie van leveranciers-AI

Wanneer organisaties derdepartij-AI-systemen niet op de juiste manier categoriseren, lopen ze compliance-risico's die ze misschien niet eens zien aankomen. Het probleem? Leveranciersrisicometrieken sluiten vaak niet aan op het interne risicokader van een bedrijf. Als leveranciers verkeerd worden geclassificeerd, is het onmogelijk om de juiste controles toe te passen of te bepalen of hun "laagrisico"-label daadwerkelijk past bij de risicotolerantie van je organisatie. Deze mismatch benadrukt de behoefte aan geautomatiseerde tools die leveranciersclassificaties in realtime kunnen verifiëren.

AI-gestuurde tools komen hier tussenbeide door het proces van het identificeren van classificatiegaten te automatiseren. Door leverancierscontracten en technische specificaties te scannen, markeren deze tools verkeerd geclassificeerde systemen en signaleren ze niet-beoordeelde derdepartij-AI-componenten, zoals uiteengezet in de Govern 6.1- en Map 4.1-functies van het NIST AI RMF. Ze vangen ook systemen die geen transparantie bieden over kritieke elementen zoals voorgeleerde modellen

Gerelateerde artikelen

Hoe AI Multi-Framework Compliance Verbetert

AI verenigt control mapping, automatiseert bewijsverzameling en biedt realtime monitoring om voorbereidingstijd voor audits te verkorten en compliancefouten te verminderen.

Hoe realtime-alerts ISO 27001-nalevingsrisico's verminderen

Realtime-alerts detecteren bedreigingen snel, verminderen inbreukkosten en auditfalen, en houden ISO 27001-logs bestand tegen manipulatie voor continue naleving.

AI-nauwkeurigheid in Beveiliging: Gespecialiseerd vs. Generiek

Gespecialiseerde AI overtreft generieke modellen voor beveiligingscompliance—hogere nauwkeurigheid, minder hallucinaties en auditklaar documentatie voor ISO 27001 en GRC.