Reglamento de IA de la UE: Requisitos de pruebas de robustez explicados

Explica los requisitos del Artículo 15 para pruebas de robustez de IA de alto riesgo: pruebas, documentación, supervisión y plazos de cumplimiento.

Reglamento de IA de la UE: Requisitos de pruebas de robustez explicados

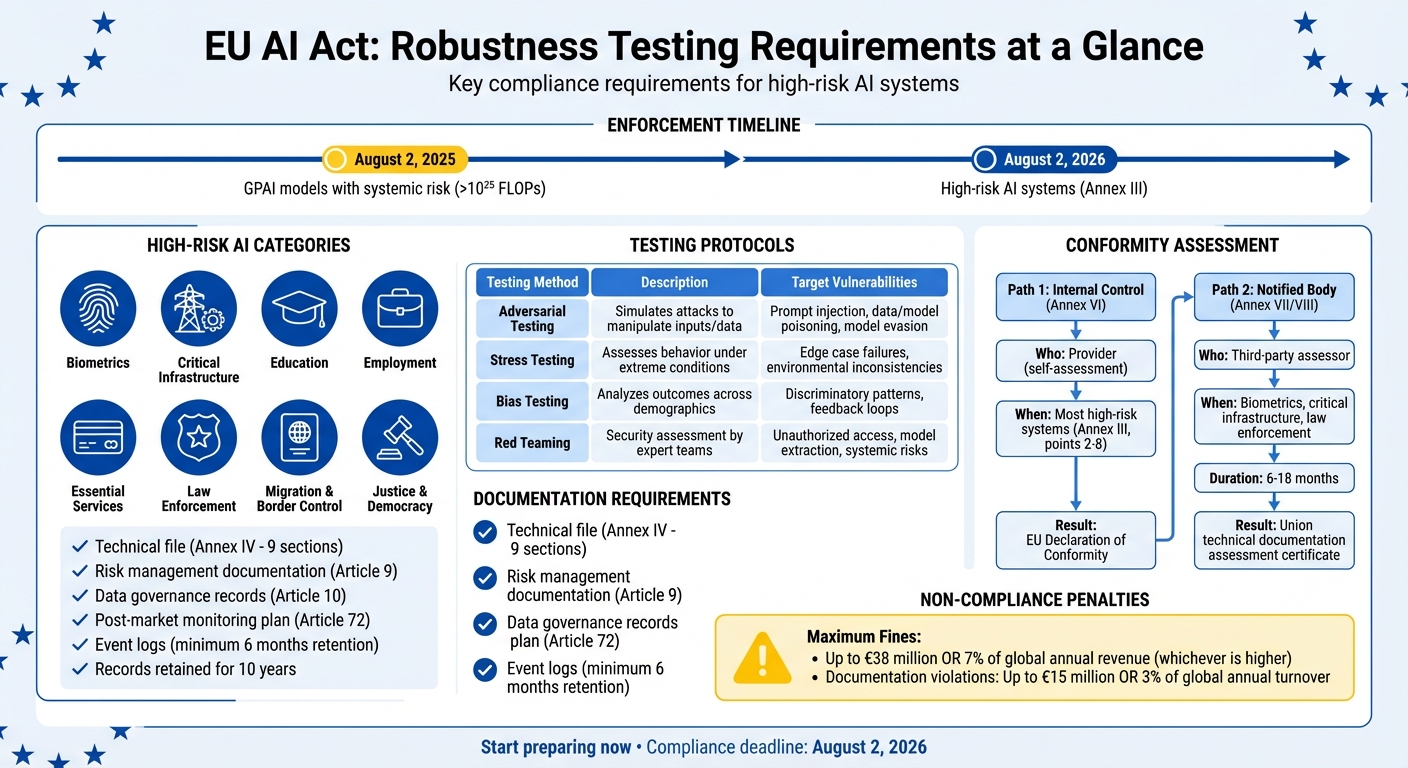

El Reglamento de IA de la UE exige que los sistemas de IA de alto riesgo pasen pruebas rigurosas de robustez para garantizar un rendimiento confiable ante errores, fallos o condiciones inesperadas. Este requisito, detallado en el Artículo 15, se aplica a sistemas en sectores críticos como la salud, el transporte y la aplicación de la ley. Esto es lo que necesitas saber:

- Definición de robustez: Capacidad de los sistemas de IA para mantener un rendimiento consistente a pesar de interrupciones, según se describe en ISO/IEC 25059:2023.

- Sistemas de IA de alto riesgo: Incluye IA en biometría, infraestructuras críticas, educación, empleo y más, como se enumera en el Anexo III. La aplicación comienza el 2 de agosto de 2026.

- Protocolos de prueba: Incluye pruebas adversariales, pruebas de estrés y red teaming para identificar vulnerabilidades.

- Documentación: Los proveedores deben preparar archivos técnicos detallados, realizar evaluaciones de conformidad y conservar registros durante 10 años.

- Supervisión posterior al despliegue: Se requiere un seguimiento continuo del rendimiento y salvaguardas contra bucles de retroalimentación dañinos.

No cumplir con la lista de verificación de cumplimiento del Reglamento de IA de la UE puede resultar en multas de hasta 38 millones de euros o el 7% de los ingresos anuales globales. Comienza a prepararte ahora para cumplir con estos requisitos antes de la fecha límite de aplicación.

::: @figure  {Requisitos de pruebas de robustez y plazos de cumplimiento del Reglamento de IA de la UE}

:::

{Requisitos de pruebas de robustez y plazos de cumplimiento del Reglamento de IA de la UE}

:::

Sistemas de IA de alto riesgo y aplicabilidad

¿Qué califica como un sistema de IA de alto riesgo?

El Reglamento de IA de la UE define sistemas de IA de alto riesgo a través de dos enfoques principales. En primer lugar, incluye sistemas de IA que actúan como componentes de seguridad en productos regulados por leyes de armonización de la UE (listados en el Anexo I). Algunos ejemplos son maquinaria, dispositivos médicos y sistemas automotrices donde un fallo podría representar riesgos para la salud o la seguridad [7]. En segundo lugar, cubre sistemas descritos en el Anexo III, que abarcan ocho áreas que podrían afectar derechos fundamentales [7][8].

Estas ocho categorías del Anexo III son:

- Biometría: Sistemas como la identificación remota y el reconocimiento de emociones.

- Infraestructuras críticas: Herramientas para gestionar el tráfico vial o servicios públicos (por ejemplo, agua, gas, electricidad).

- Educación: IA utilizada en decisiones de admisión o supervisión de exámenes.

- Empleo: Aplicaciones como la selección de currículos, decisiones de promoción y monitoreo de empleados.

- Servicios esenciales: Sistemas para la evaluación crediticia o fijación de precios de seguros.

- Aplicación de la ley: Herramientas como polígrafos o modelos de predicción de reincidencia.

- Migración y control fronterizo: IA utilizada en el procesamiento de visas.

- Justicia y democracia: Sistemas desarrollados para asistir a autoridades judiciales [7][8].

Sin embargo, no todos los sistemas en estas categorías califican automáticamente como de alto riesgo. El Artículo 6 permite exenciones si un sistema realiza tareas definidas de manera estrecha o apoya actividades lideradas por humanos sin influir significativamente en las decisiones, siempre que no se involucre perfilamiento. Para reclamar esta exención, las organizaciones deben documentar su evaluación utilizando un asistente de políticas y registrar el sistema en la base de datos de la UE antes de su entrada en el mercado [8]. Por otro lado, si un sistema de IA realiza perfilamiento de individuos dentro de un dominio del Anexo III, sigue clasificado como de alto riesgo [8].

Para todos los sistemas de alto riesgo, el Artículo 15 exige pruebas de robustez para garantizar un rendimiento confiable a lo largo de su ciclo de vida [4]. La aplicación de estos requisitos para los sistemas del Anexo III comienza el 2 de agosto de 2026 [8].

Este marco de clasificación sustenta los estándares estrictos de robustez requeridos por el Reglamento de IA de la UE.

IA de propósito general y riesgo sistémico

El Reglamento también aborda los modelos de IA de propósito general (GPAI), que no son inherentemente de alto riesgo. Sin embargo, cuando estos modelos se integran en sistemas de alto riesgo, como el uso de un modelo de lenguaje grande en reclutamiento o infraestructura crítica, deben cumplir con los estándares de alto riesgo [9][8]. Además, los modelos de GPAI identificados como de "riesgo sistémico" están sujetos a requisitos específicos de robustez, que incluyen pruebas adversariales [9].

Para calificar como riesgo sistémico, la potencia computacional acumulada de entrenamiento del modelo debe superar los 10^25 FLOPs [9]. Al igual que otros sistemas de alto riesgo, estos modelos deben someterse a evaluaciones detalladas y pruebas adversariales para detectar vulnerabilidades [6]. Las normas para los modelos de GPAI entrarán en vigor el 2 de agosto de 2025, un año antes que los requisitos más amplios para sistemas de alto riesgo [9].

Medidas técnicas y organizativas para la robustez

Construyendo resiliencia técnica

El Artículo 15 del Reglamento de IA de la UE enfatiza la importancia de la resiliencia en los sistemas de IA de alto riesgo, asegurando que puedan resistir interrupciones operativas. Estos sistemas deben manejar errores, fallos o inconsistencias dentro de su entorno, incluso cuando enfrentan fallos de hardware, entradas corruptas o comportamientos inesperados de los usuarios [1].

Un enfoque clave para lograr resiliencia es la redundancia técnica. Por ejemplo, la contenerización puede aislar las operaciones del sistema, manteniendo la confiabilidad incluso cuando surgen problemas de infraestructura [2]. En entornos críticos, diseñar para una degradación elegante, donde el sistema pasa a operaciones manuales o sistemas de respaldo en lugar de apagarse por completo, añade otra capa de confiabilidad.

Las vulnerabilidades específicas de la IA también requieren atención. Amenazas como el envenenamiento de datos (alteración de los datos de entrenamiento), el envenenamiento de modelos (incrustación de código malicioso durante el entrenamiento) y ejemplos adversariales (entradas diseñadas para engañar a la IA) requieren defensas sólidas [2]. El marco MITRE ATLAS proporciona herramientas para probar y mitigar estos riesgos [2]. Además, los sistemas de monitoreo y alerta automatizados pueden identificar problemas de rendimiento o disponibilidad en tiempo real. Herramientas especializadas como ISMS Copilot One pueden ayudar a automatizar estos complejos flujos de trabajo de cumplimiento.

Para los sistemas de IA que continúan aprendiendo después del despliegue, los bucles de retroalimentación plantean desafíos únicos. Si salidas sesgadas se integran en datos de entrenamiento posteriores, esos sesgos pueden acumularse. Para abordar esto, medidas como la curación selectiva de datos y limitar la integración de retroalimentación del mundo real son esenciales [1]. El registro de eventos, como lo exige el Artículo 12, ayuda a rastrear cambios de rendimiento y detectar posibles problemas [8].

Estas salvaguardas técnicas funcionan en conjunto con medidas organizativas para garantizar que los sistemas permanezcan justos e imparciales.

Abordando el sesgo y la equidad

Mitigar el sesgo no es solo una responsabilidad ética, sino también una obligación legal según el Reglamento. Los sistemas de IA de alto riesgo deben operar de manera justa en todos los grupos demográficos, especialmente en áreas sensibles como el empleo, la educación o el acceso a servicios esenciales [8].

Las auditorías periódicas de equidad son cruciales. Por ejemplo, si una herramienta de selección de currículos no tiene en cuenta diversas trayectorias profesionales o antecedentes educativos, podría poner en desventaja a ciertos grupos de manera injusta. Tales violaciones podrían resultar en multas de hasta 35 millones de euros o el 7% de la facturación anual global [10].

La supervisión humana, como lo exige el Artículo 14, es otro componente crítico. Los humanos deben comprender las limitaciones del sistema, evitar confiar ciegamente en sus salidas (sesgo de automatización) e intervenir cuando sea necesario [8]. Un enfoque efectivo es un diseño de solo asesoría, donde las salidas de la IA son revisadas por humanos antes de tomar cualquier acción.

Para abordar el sesgo de manera sistemática, establece un Sistema de Gestión de Calidad (QMS) según el Artículo 17. Esto debe incluir políticas escritas para identificar y corregir sesgos, junto con una gestión de riesgos continua a lo largo del ciclo de vida del sistema de IA. El monitoreo posterior al lanzamiento es esencial para evaluar el rendimiento en el mundo real, mientras que los registros automatizados, conservados durante al menos seis meses, crean una pista de auditoría para investigaciones de incidentes [8].

Pruebas y validación para la robustez

Protocolos de pruebas de robustez

Para garantizar que los sistemas de IA estén preparados para el despliegue, el Reglamento de IA de la UE exige pruebas rigurosas previas al despliegue, especialmente para sistemas de alto riesgo. Estas pruebas están diseñadas para confirmar la resiliencia ante errores, fallos y posibles ataques [1].

Las pruebas adversariales son un requisito clave para los sistemas de IA de propósito general con riesgos sistémicos, así como para los sistemas de alto riesgo. Este enfoque implica simular ataques como inyección de prompts, envenenamiento de datos y evasión de modelos para evaluar qué tan bien el sistema puede resistir tales amenazas [10][11]. Otro método crítico es el red teaming, donde expertos internos o externos intentan activamente vulnerar el sistema, proporcionando una evaluación integral de seguridad [10].

Las pruebas de estrés evalúan cómo los sistemas manejan escenarios extremos o inusuales, como casos límite o inyecciones intencionales de fallos, asegurando que los fallos ocurran de manera controlada y predecible [10][11].

| Método de prueba | Descripción | Vulnerabilidades objetivo |

|---|---|---|

| Pruebas adversariales | Simula ataques para manipular entradas o datos de entrenamiento | Inyección de prompts, envenenamiento de datos/modelos, evasión de modelos [10][3] |

| Pruebas de estrés | Evalúa el comportamiento bajo condiciones extremas o inusuales | Fallos en casos límite, inconsistencias ambientales [11][8] |

| Pruebas de sesgo | Analiza resultados en grupos demográficos | Patrones discriminatorios, bucles de retroalimentación [11] |

| Red teaming | Evaluación de seguridad por equipos internos o externos | Acceso no autorizado, extracción de modelos, riesgos sistémicos [10] |

Para minimizar el sesgo en las salidas, los conjuntos de datos de prueba deben curarse cuidadosamente para que sean relevantes, representativos y libres de errores en la medida de lo posible [1][11]. Además, los proveedores deben declarar métricas específicas de precisión y resiliencia en sus instrucciones de usuario, alineándose con los estándares de la Comisión Europea [1][3].

"El aseguramiento de la calidad ya no es opcional: es la base del cumplimiento normativo. Las organizaciones deben demostrar que sus sistemas de IA son seguros, justos y confiables antes de poder entrar en el mercado de la UE."

Una vez completados estos protocolos previos al despliegue, el monitoreo continuo garantiza que los sistemas sigan siendo robustos después de su implementación.

Monitoreo continuo después del despliegue

Las pruebas no terminan cuando un sistema de IA se despliega. Según el Artículo 72, los proveedores deben implementar sistemas de monitoreo posterior al mercado que recojan, documenten y analicen datos de rendimiento de manera continua a lo largo del ciclo de vida del sistema [4][12]. Esto garantiza que el sistema se adapte a condiciones del mundo real en evolución mientras mantiene su integridad.

Los sistemas de IA de alto riesgo están obligados a registrar eventos durante al menos seis meses. Estos registros ayudan a rastrear el rendimiento, identificar riesgos potenciales y documentar cambios significativos [6][8][12]. Herramientas como la detección de anomalías pueden señalar cambios inesperados en los datos o ruido que podrían socavar la robustez del sistema [2][5].

Para los sistemas que aprenden de manera continua, deben implementarse salvaguardas para evitar bucles de retroalimentación, donde salidas sesgadas podrían influir en los datos de entrenamiento futuros [4][2][1]. Las herramientas de monitoreo rastrean el deterioro del rendimiento con el tiempo, mientras que la contenerización garantiza entornos estables y reproducibles para la ejecución del sistema [2].

Tanto los proveedores como los implementadores están obligados a reportar incidentes [6][12]. Además, los mecanismos de supervisión humana, como procedimientos de "botón de parada", permiten una intervención inmediata si surgen problemas [8].

"El Reglamento de IA de la UE requiere monitoreo continuo después del despliegue, no solo pruebas de una sola vez. Los sistemas de IA de alto riesgo necesitan registros automatizados y respuesta a incidentes integrados desde el principio."

- Oleg Sivograkov, VP de Operaciones de TI, TestFort [11]

La fecha de aplicación de estos requisitos está establecida para el 2 de agosto de 2026 [8]. No cumplir con esto podría resultar en multas severas, incluyendo hasta 38 millones de euros o el 7% de los ingresos anuales globales [10].

Parte 2: Navegando el Reglamento de IA de la UE: Aspectos esenciales de cumplimiento para sistemas de IA de alto riesgo

::: @iframe https://www.youtube.com/embed/wsr6d6WG5Uo :::

Documentación y presentación de informes de cumplimiento

Después de pruebas rigurosas y monitoreo continuo, la documentación adecuada es esencial para garantizar que el cumplimiento se mantenga.

Estándares de documentación técnica

Antes de introducir un producto en el mercado, debes preparar un archivo técnico que cumpla con los estándares del Anexo IV. Este archivo debe demostrar claramente el cumplimiento de los requisitos de robustez del Artículo 15 [13]. El archivo debe incluir nueve secciones, con la Sección 4 enfocada específicamente en métricas de rendimiento. Debe detallar los resultados de las pruebas de robustez, los métodos de validación y la justificación detrás de las métricas elegidas [13].

La creación de esta documentación puede tomar entre 40 y 80 horas, siempre que los datos de cumplimiento ya estén integrados en el proceso de desarrollo utilizando un asistente de implementación de IA [13]. Herramientas como MLflow pueden agilizar este proceso al capturar registros, pistas de auditoría y decisiones de diseño directamente dentro de tu flujo de trabajo.

Tu archivo técnico también debe incluir lo siguiente:

- Documentación de gestión de riesgos (Artículo 9)

- Registros de gobernanza de datos (Artículo 10) que expliquen cómo se utilizaron los conjuntos de datos para evaluar sesgos

- Un plan de monitoreo posterior al mercado (Artículo 72)

- Instrucciones que describan los niveles de robustez y limitaciones [1]

Toda la documentación técnica debe conservarse durante 10 años después de que el producto ingrese al mercado. El incumplimiento puede resultar en multas de hasta 15 millones de euros o el 3% de los ingresos anuales globales [13].

Evaluaciones de conformidad y marcado CE

Una vez completado el archivo técnico, el siguiente paso es demostrar el cumplimiento a través de una evaluación de conformidad. La mayoría de los sistemas de IA de alto riesgo pueden ser autoevaluados bajo el proceso de Control Interno descrito en el Anexo VI [15]. Sin embargo, los sistemas utilizados en áreas sensibles como la biometría, las infraestructuras críticas o la aplicación de la ley requieren una evaluación externa por parte de un organismo notificado. Estos evaluadores de terceros están autorizados para revisar tu documentación y garantizar el cumplimiento [14].

Los organismos notificados pueden solicitar evidencia adicional o realizar pruebas independientes si consideran que tus pruebas de robustez son insuficientes [14]. Verificarán que se hayan documentado e implementado medidas como redundancia, planes de respaldo y sistemas de seguridad [1]. Para los sistemas de IA que continúan aprendiendo después del despliegue, también verificarán las salvaguardas contra bucles de retroalimentación que podrían introducir sesgos en los datos de entrenamiento futuros [1].

| Tipo de evaluación | Quién la realiza | Cuándo se requiere | Certificado emitido |

|---|---|---|---|

| Control Interno (Anexo VI) | Proveedor (autoevaluación) | La mayoría de los sistemas de alto riesgo (Anexo III, puntos 2-8) | Declaración de Conformidad de la UE |

| Organismo Notificado (Anexo VII/VIII) | Evaluador de terceros | Biometría, infraestructuras críticas, aplicación de la ley | Certificado de evaluación de documentación técnica de la Unión |

Dado que las evaluaciones por parte de organismos notificados pueden tomar entre 6 y 18 meses, los proveedores de sistemas críticos para la seguridad o biométricos deben iniciar el proceso con suficiente antelación antes de la fecha límite del 2 de agosto de 2026 [16]. Prepárate para proporcionar acceso a conjuntos de datos de entrenamiento, validación y pruebas a través de API u otros medios técnicos si es solicitado [14].

Después de completar con éxito la evaluación, debes emitir una Declaración de Conformidad de la UE y aplicar el marcado CE a tu sistema o su documentación [15]. Este marcado sirve como prueba legal de que tu sistema cumple con los estándares de robustez. Si se realizan cambios significativos, como modificaciones que afectan el cumplimiento o el propósito previsto del sistema, deberás actualizar la documentación y posiblemente someterte a una nueva evaluación de conformidad [13].

"La documentación técnica se elaborará de manera que demuestre que el sistema de IA de alto riesgo cumple con los requisitos [...] y que proporcione a las autoridades nacionales competentes y a los organismos notificados la información necesaria de manera clara y completa para evaluar el cumplimiento."

- Artículo 11, Reglamento (UE) 2024/1689 [13]

Las evaluaciones de conformidad, junto con el monitoreo continuo, forman un marco de cumplimiento completo, asegurando que los sistemas de IA de alto riesgo cumplan con los estándares de robustez a lo largo de su ciclo de vida.

Robustez vs. Ciberseguridad: Diferencias clave

Aclaremos cómo el Reglamento de IA de la UE diferencia la robustez de la ciberseguridad — dos conceptos que pueden parecer similares pero sirven propósitos muy distintos.

La distinción radica en la intención. La robustez, como se describe en el Artículo 15[1], se ocupa de interrupciones no intencionales. Estas podrían incluir errores naturales, fallos o inconsistencias que surgen durante la operación normal del sistema. Por otro lado, la ciberseguridad, cubierta en el Artículo 15[3], se centra en ataques intencionales y maliciosos. Esto incluye escenarios en los que terceros no autorizados intentan activamente manipular o comprometer el rendimiento del sistema. Mientras que las secciones anteriores cubrieron cómo probar la robustez, esta parte destaca la división entre resiliencia interna y amenazas externas.

En términos técnicos, la robustez en el aprendizaje automático se refiere a la resiliencia no adversarial. Esto implica probar la capacidad de un sistema de IA para manejar desafíos como cambios en la distribución, alteraciones ambientales o bucles de retroalimentación, donde las salidas del modelo influyen en los datos de entrenamiento futuros. La ciberseguridad, en cambio, se centra en la resiliencia adversarial, protegiendo contra amenazas como el envenenamiento de datos, ataques de evasión o incluso brechas que comprometan la confidencialidad del modelo, como el robo.

Henrik Nolte de la Universidad de Tubinga explica esta división claramente:

"El AIA divide artificialmente el concepto de ciberseguridad del CSA al designar las causas no intencionales como un tema de robustez y restringir la ciberseguridad a acciones intencionales."

Para el cumplimiento, tanto la robustez como la ciberseguridad requieren estrategias diferentes. Las organizaciones pueden capacitar asistentes de cumplimiento de IA para gestionar estas complejidades. La robustez depende de medidas como la redundancia técnica y el monitoreo continuo para garantizar que los sistemas puedan manejar interrupciones no intencionales. La ciberseguridad, por su parte, exige defensas activas como la detección de amenazas, el cifrado y el entrenamiento adversarial para contrarrestar ataques deliberados. Mantener ambas a lo largo del ciclo de vida de un sistema de IA implica evaluar cada componente individualmente para garantizar una protección integral.

Conclusión y puntos clave

Resumamos los pasos esenciales para garantizar que tus sistemas de IA sean confiables y cumplan con las regulaciones futuras.

Las pruebas de robustez son un pilar fundamental para garantizar que los sistemas de IA de alto riesgo funcionen de manera consistente bajo condiciones prácticas. Con la aplicación de los requisitos del Anexo III establecida para el 2 de agosto de 2026 [8], las organizaciones deben actuar ahora para establecer métricas de rendimiento, integrar mecanismos de redundancia y implementar un monitoreo continuo a lo largo del ciclo de vida de la IA.

El concepto de robustez depende en gran medida del contexto. Deberás definir métricas de rendimiento que se alineen con el propósito específico de tu sistema y anticipar interrupciones como deriva de datos, cambios ambientales o bucles de retroalimentación. Los protocolos de prueba deben adaptarse al caso de uso único, las propiedades de los datos y el entorno de despliegue de cada sistema de IA.

Comienza estableciendo líneas base claras de rendimiento en condiciones normales. Luego, prueba sistemáticamente cómo responde tu sistema a diversos desafíos o interrupciones. Incorpora medidas de redundancia —como sistemas de respaldo y sistemas de seguridad— y asegúrate de que existan mecanismos de supervisión humana para intervenir cuando ocurran anomalías. Además, tus sistemas de registro deben apoyar el cumplimiento al proporcionar pistas de auditoría inalterables y de solo anexo.

Según el Artículo 11, los proveedores son principalmente responsables de realizar evaluaciones de conformidad y preparar la documentación técnica, mientras que los implementadores deben gestionar la supervisión humana y mantener prácticas sólidas de retención de registros. Ambos roles comparten la responsabilidad de mantener la robustez del sistema a lo largo del ciclo de vida del sistema de IA.

Simplificando el cumplimiento con ISMS Copilot

Herramientas avanzadas de cumplimiento como ISMS Copilot pueden simplificar estos pasos críticos.

ISMS Copilot está diseñado para ayudar con el cumplimiento del Reglamento de IA de la UE al analizar tu documentación técnica y evaluaciones de impacto existentes para identificar brechas en los requisitos de robustez. La plataforma ayuda a redactar la documentación técnica detallada del Artículo 11 que los reguladores revisarán, cubriendo todo, desde descripciones del sistema hasta protocolos de monitoreo.

Para tareas regulatorias relacionadas con el Reglamento de IA de la UE, la plataforma utiliza modelos de Mistral, que están específicamente capacitados en regulaciones europeas. Estos modelos proporcionan información detallada sobre los requisitos del Reglamento. Puedes crear espacios de trabajo individuales para cada sistema de IA, asegurando pistas de auditoría claras y esfuerzos de cumplimiento organizados. Al usar la plataforma, incluye detalles como el caso de uso de tu sistema, los tipos de datos y la clasificación de riesgos para recibir orientación personalizada que se alinee con tus necesidades de cumplimiento.

Una característica destacada de ISMS Copilot es su herramienta de análisis de brechas, que es especialmente útil para las pruebas de robustez. Al cargar tus evaluaciones de riesgos y protocolos de prueba actuales, la plataforma identifica componentes faltantes y ofrece un plan de remediación priorizado. Esto te ayuda a asignar recursos de manera eficiente y abordar brechas críticas de cumplimiento antes de la fecha límite de agosto de 2026.

Preguntas frecuentes

::: faq

¿Cómo sé si mi sistema de IA es "de alto riesgo" según el Reglamento de IA de la UE?

Según el Reglamento de IA de la UE, tu sistema de IA se considera "de alto riesgo" si cumple uno de los siguientes criterios:

- Funciona como un componente de seguridad de un producto regulado por leyes de la UE listadas en el Anexo I.

- Se aplica en escenarios de alto riesgo identificados en el Anexo III, como evaluaciones crediticias, procesos de reclutamiento o identificación biométrica.

Estas clasificaciones juegan un papel clave en la definición de las obligaciones de cumplimiento para tu sistema. :::

::: faq

Artículos relacionados

IA Genérica vs. IA Específica por Dominio para Cumplimiento Normativo

Comparación entre IA genérica e IA específica por dominio para cumplimiento normativo: precisión, residencia de datos, preparación para auditorías y reducción de riesgos en auditorías.

Cómo la IA rastrea cambios regulatorios

Explica cómo la IA utiliza PNL, aprendizaje automático y alertas en tiempo real para monitorear actualizaciones regulatorias, mapear impactos en controles y reducir la carga de cumplimiento.

Evaluación de riesgos ISO 27001 con IA: Lista de verificación para startups

Utiliza IA para agilizar las evaluaciones de riesgos ISO 27001 en startups: alcance, inventario de activos, puntuación, asignación de controles y monitoreo continuo.