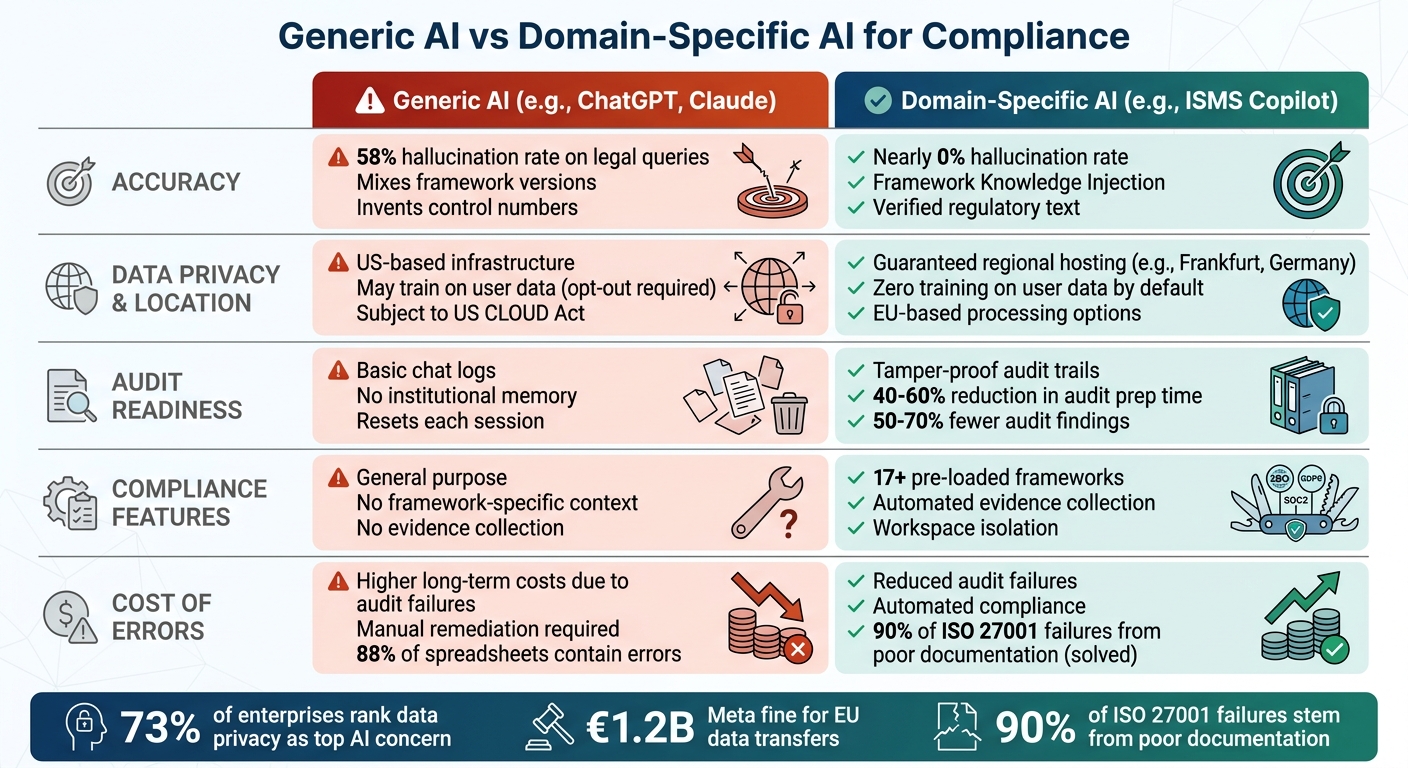

IA Genérica vs. IA Específica por Dominio para Cumplimiento Normativo

Comparación entre IA genérica e IA específica por dominio para cumplimiento normativo: precisión, residencia de datos, preparación para auditorías y reducción de riesgos en auditorías.

IA Genérica vs. IA Específica por Dominio para Cumplimiento Normativo

Cuando se trata de tareas de cumplimiento normativo, elegir la herramienta de IA adecuada puede marcar la diferencia entre el éxito y el fracaso. ¿Deberías utilizar una herramienta de IA genérica como ChatGPT, o optar por una plataforma de IA específica por dominio? Aquí tienes el resumen clave:

- Herramientas de IA genéricas son versátiles, pero a menudo carecen de la precisión requerida para el cumplimiento normativo. Dependen de conjuntos de datos amplios, lo que genera inexactitudes (por ejemplo, una tasa de alucinaciones del 58% en consultas legales). Además, plantean riesgos como filtraciones de privacidad de datos debido al procesamiento basado en EE.UU.

- Herramientas de IA específicas por dominio, como ISMS Copilot, están diseñadas para el trabajo de cumplimiento normativo. Utilizan datos regulatorios verificados, garantizan la residencia de datos (por ejemplo, servidores en la UE) y ofrecen funciones como registros de auditoría y precisión específica del marco normativo.

Diferencias clave:

- Precisión: La IA específica por dominio minimiza errores al basar las respuestas en estándares verificados, a diferencia de la IA genérica, que puede generar información falsa o desactualizada.

- Privacidad de datos: Las plataformas específicas por dominio priorizan el almacenamiento y la soberanía de datos regionales. La IA genérica suele procesar datos en EE.UU., creando riesgos de cumplimiento con el RGPD y normativas transfronterizas.

- Preparación para auditorías: Las herramientas específicas por dominio proporcionan documentación estructurada, a prueba de manipulaciones y recolección continua de evidencias, algo que la IA genérica no ofrece.

Conclusión rápida: Si el cumplimiento normativo es crítico para tu organización, la IA específica por dominio es la opción más segura y confiable.

::: @figure  {Diferencias clave entre IA genérica e IA específica por dominio para cumplimiento normativo}

:::

{Diferencias clave entre IA genérica e IA específica por dominio para cumplimiento normativo}

:::

Seguridad y Riesgo en IA: Comparación lado a lado de los marcos de cumplimiento y riesgo en IA

::: @iframe https://www.youtube.com/embed/wkEEK8Wp2WM :::

Por qué la IA genérica se queda corta en cumplimiento de seguridad

Las herramientas de IA genéricas, aunque excelentes para productividad general, tienen dificultades cuando se trata de la precisión y confiabilidad necesarias para el trabajo de cumplimiento regulado. Estos modelos generan texto prediciendo la siguiente palabra más probable en lugar de extraer información de hechos verificados [8]. Esto puede dar lugar a respuestas que suenan convincentes pero son incorrectas, un riesgo importante en el cumplimiento normativo, donde la exactitud es no negociable. Analicemos los problemas clave.

Salidas inexactas y alucinaciones

Los estudios revelan que hasta un 46% del texto generado por IA contiene alucinaciones. Al probar con preguntas legales específicas, se descubrió que GPT-4 alucinaba al menos el 58% de las veces [4][9]. Para los profesionales del cumplimiento normativo, este nivel de inexactitud es inaceptable. Las consecuencias pueden ser graves:

- Un abogado en EE.UU. fue sancionado tras presentar citas de casos ficticios generadas por ChatGPT.

- Air Canada tuvo que honrar una política de "tarifa por duelo" inventada por su chatbot de IA [4].

La IA genérica también tiene dificultades para distinguir entre estándares regulatorios desactualizados y actuales, creando peligrosos vacíos de cumplimiento. Por ejemplo, podría confundir los requisitos de ISO 27001:2013 y ISO 27001:2022, inventar números de controles que no existen o afirmar incorrectamente que ISO 27001 exige una auditoría de SOC 2 Tipo II.

J.P. Roe, escritor profesional, lo resumió bien:

"La IA no entiende el contexto... en absoluto. Personalmente, no la usaría para nada legalmente vinculante a menos que un experto en cumplimiento revise y corrija los errores" [10].

Las investigaciones muestran que el 90% de los fallos en ISO 27001 se deben a una mala gestión de la documentación y la incapacidad de demostrar que los controles existen [4]. La IA genérica carece de la capacidad para generar las evidencias verificables necesarias para cumplir con estos estándares. Y más allá de la precisión, los problemas relacionados con la privacidad de datos exponen aún más sus limitaciones.

Problemas de privacidad de datos y ubicación

Las herramientas de IA genéricas también plantean riesgos significativos para la privacidad de datos y las transferencias de datos transfronterizas. Incluso cuando los proveedores afirman almacenar datos dentro de la UE o Reino Unido, el paso de inferencia (donde las GPU procesan la entrada) suele realizarse en Estados Unidos [6]. Esto crea desafíos de cumplimiento para organizaciones sujetas al Capítulo V del RGPD y la sentencia Schrems II.

Geoff Davies, de PivotalEdge, explicó:

"La residencia es más sólida para los datos almacenados. Si necesitas un procesamiento estrictamente limitado al Reino Unido para todo, verifica cómo OpenAI maneja la inferencia... porque no todos los flujos de trabajo pueden garantizar un procesamiento exclusivo en el Reino Unido" [6].

Esto es especialmente preocupante porque los proveedores de IA con sede en EE.UU. están sujetos a leyes de vigilancia estadounidenses, que pueden entrar en conflicto con los estándares europeos de protección de datos. Los riesgos son reales: en abril de 2023, ingenieros de Samsung filtraron accidentalmente código fuente propietario y notas internas de reuniones en ChatGPT mientras lo usaban para resumir y depurar —tres incidentes separados en solo 20 días—. Como respuesta, Samsung implementó una prohibición a nivel corporativo del uso de IA generativa para uso interno [4].

Falta de conocimiento especializado en cumplimiento

Las herramientas de IA genéricas también se quedan cortas cuando se trata de entender marcos de cumplimiento específicos o el entorno único de controles de una organización, su historial de auditorías o su perfil de riesgo. Mientras estas herramientas pueden redactar políticas, no pueden producir la documentación objetiva, con marca de tiempo y a prueba de manipulaciones que los auditores exigen. Como señaló Humadroid:

"Los auditores no evalúan si tus controles suenan bien. Evalúan si tus controles operaron de manera demostrable durante todo el período de auditoría" [4].

Otro problema común: la IA genérica a menudo confunde requisitos legales con mejores prácticas. Por ejemplo, podría afirmar incorrectamente que el cifrado AES-256 es un mandato legal cuando las regulaciones simplemente exigen "medidas de seguridad adecuadas" basadas en una evaluación de riesgos. Esta sobreprescripción puede generar costos y esfuerzos innecesarios.

Estas deficiencias destacan la necesidad de la mejor asistente de IA para ISO 27001 que proporcione contexto persistente y específico del marco normativo, y pueda adaptarse a las particularidades del trabajo de cumplimiento —algo que la IA genérica no está diseñada para manejar—.

Cómo la IA específica por dominio aborda las necesidades de cumplimiento

La IA específica por dominio se basa en datos regulatorios verificados en lugar de patrones impredecibles de internet. Este enfoque garantiza que las respuestas se fundamenten en conocimiento estructurado y curado, esencial cuando la precisión es no negociable. Así es como aborda los principales desafíos de cumplimiento.

Marcos regulatorios pre-cargados

A diferencia de la IA de propósito general, las herramientas específicas por dominio vienen equipadas con marcos regulatorios pre-cargados para garantizar la precisión. Por ejemplo, ISMS Copilot utiliza un sistema llamado "Inyección Dinámica de Conocimiento del Marco", que elimina las conjeturas. Menciona un estándar como ISO 27001 o SOC 2, y el sistema lo identifica inmediatamente mediante coincidencia de patrones. Luego carga los controles, cláusulas y requisitos relevantes en su contexto antes de generar una respuesta. Este proceso, que tarda solo entre 5 y 15 segundos, reduce drásticamente los errores en consultas específicas del marco [11][12][14].

La información se obtiene de bases de datos curadas y verificadas por ingenieros de Gobernanza, Riesgo y Cumplimiento (GRC) frente a los estándares oficiales [12][13]. Actualmente, ISMS Copilot soporta 17 marcos, incluyendo ISO 27001:2022, ISO 42001:2023, SOC 2, HIPAA, RGPD, NIS 2, DORA y el Reglamento de IA de la UE. Cada respuesta incluye citas específicas a estos marcos, haciendo que las salidas estén listas para auditorías desde el inicio [11][12][13].

Registros de auditoría completos y seguimiento de decisiones

La IA genérica reinicia cada conversación, pero las plataformas específicas por dominio mantienen memoria institucional a lo largo del tiempo, algo que los auditores valoran. Esto es especialmente importante dado que el 90% de los fallos en ISO 27001 se deben a una mala gestión de la documentación más que a controles técnicos ausentes [4].

ISMS Copilot ofrece funciones como seguimiento de cambios, espacios de trabajo separados para diferentes proyectos o clientes, y Modo de Reducción de PII, que redacta automáticamente información personal como nombres, correos electrónicos y números de teléfono antes del procesamiento. Los usuarios también pueden configurar períodos de retención de datos, desde tan solo 1 día hasta 7 años, para alinearse con políticas regulatorias o internas [13].

Control de ubicación de datos y flexibilidad de implementación

Para organizaciones sujetas a normas estrictas de soberanía de datos, la IA específica por dominio garantiza el cumplimiento mediante garantías de alojamiento regional. Por ejemplo, ISMS Copilot almacena todos los datos en Fráncfort, Alemania, y ofrece un Modo de Protección Avanzada de Datos que enruta consultas exclusivamente a través de proveedores de IA con sede en la UE como Mistral AI [13][14]. Esto asegura el cumplimiento con el RGPD y otras leyes de protección de datos.

Todos los proveedores backend operan bajo acuerdos de Retención Cero de Datos (ZDR), lo que significa que las indicaciones y salidas del usuario nunca se almacenan a largo plazo ni se utilizan para el entrenamiento de modelos [13][14]. Para organizaciones con requisitos aún más estrictos, algunas plataformas permiten la implementación en las instalaciones, en nubes privadas o en infraestructura edge, asegurando que los datos permanezcan completamente bajo el control de la organización [15]. Este nivel de gestión de datos ayuda a las organizaciones a cumplir incluso con los estándares de cumplimiento más rigurosos.

Privacidad de datos y localización: La principal diferencia

Cuando se trata de cumplimiento normativo, dónde se almacenan los datos y quién puede acceder a ellos son preocupaciones críticas. Las herramientas de IA genéricas como ChatGPT suelen procesar datos a través de infraestructura con sede en EE.UU., lo que puede crear problemas para empresas sujetas a regulaciones europeas, chinas o específicas de la industria. La IA específica por dominio, por otro lado, está diseñada con la localización de datos como prioridad.

La distinción entre privacidad de datos y localización es un factor clave que separa a la IA específica por dominio de las soluciones genéricas. De hecho, el 73% de las empresas clasifican la privacidad y seguridad de datos como su principal preocupación en IA, y el 77% ahora considera el país de origen del proveedor antes de tomar decisiones de compra [17]. Estas preocupaciones no son solo teóricas: los reguladores han tomado medidas. Por ejemplo:

- Meta fue multada con 1.200 millones de euros en 2023 por transferir datos de usuarios de la UE a Estados Unidos.

- TikTok enfrentó una sanción de 530 millones de euros en 2025 por enviar datos de ciudadanos de la UE a servidores en China.

- Uber pagó 290 millones de euros en 2024 por mover registros de conductores a través de fronteras [17][19].

Estos casos subrayan la importancia de cómo la IA específica por dominio redefine el almacenamiento de datos, los controles de procesamiento y la gestión de riesgos transfronterizos.

Cumplimiento de las leyes de almacenamiento de datos regionales

Las plataformas de IA específicas por dominio abordan cuidadosamente tanto la residencia de datos (dónde están físicamente los servidores) como la soberanía de datos (el marco legal que rige esos datos). Simplemente seleccionar una "región de la UE" en un proveedor de nube con sede en EE.UU. no garantiza necesariamente el cumplimiento. Como explica Jaipal Singh:

"La jurisdicción legal sigue a la empresa, no al centro de datos" [17].

Tomemos como ejemplo el Asistente de IA para el Reglamento de IA de la UE. Almacena datos en Fráncfort, Alemania, e incluye un modo de Protección Avanzada de Datos que enruta consultas exclusivamente a través de proveedores con sede en la UE. Todos los proveedores backend operan bajo acuerdos de Retención Cero de Datos (ZDR), lo que significa que las indicaciones y salidas no se guardan ni se utilizan para el entrenamiento de modelos [1]. Esta configuración se alinea con los requisitos del RGPD y ayuda a las organizaciones a navegar incertidumbres, especialmente tras la caída del Marco de Privacidad de Datos UE-EE.UU. (a menudo llamado "Schrems III") a finales de 2025 [18].

Las apuestas son altas. Según el Reglamento de IA de la UE, las sanciones pueden alcanzar el 7% de la facturación anual global o 35 millones de euros, y las violaciones combinadas del RGPD y el Reglamento de IA podrían, en teoría, llegar al 11% de la facturación global [18]. Para 2026, al menos 34 países habían introducido o fortalecido leyes de localización de datos que afectan al procesamiento de IA [18].

Reducción de riesgos de datos transfronterizos

Incluso cuando los datos se almacenan regionalmente, los flujos de datos transfronterizos pueden introducir riesgos adicionales de cumplimiento. Las API de IA genéricas a menudo crean flujos de datos ocultos a través de vías secundarias, como moderación de contenido, verificaciones de seguridad o registros. Estos puntos de contacto pueden estar sujetos a diferentes jurisdicciones legales. Además, muchos proveedores genéricos reservan el derecho de utilizar las entradas de la API para el entrenamiento de modelos a menos que los usuarios opten explícitamente por no participar [18].

La IA específica por dominio minimiza estos riesgos con un diseño intencional. Por ejemplo, algunas plataformas utilizan un enfoque de "Información, no datos", donde los datos se preprocesan localmente para eliminar o pseudonimizar identificadores personales. Solo se envían al modelo basado en la nube información anonimizada [18]. Otras ofrecen aislamiento de espacios de trabajo, asegurando que los datos de diferentes clientes o proyectos permanezcan separados [1].

Este enfoque reflexivo también ahorra tiempo y dinero. Implementar residencia de datos con IA puede tomar solo de 2 a 3 semanas, en comparación con 4 a 6 meses con métodos manuales. Los costos también se reducen significativamente, de un estimado de 150.000–250.000 dólares a 40.000–80.000 dólares. La validación automatizada garantiza una precisión del 100%, mientras que las revisiones manuales tienen una tasa de error del 15–20% [16].

Controles claros de procesamiento y almacenamiento de datos

Las plataformas de IA específicas por dominio proporcionan transparencia y control sobre cada paso del procesamiento de datos. Mientras que la IA genérica a menudo opera como una "caja negra", las soluciones específicas por dominio revelan toda la cadena de procesamiento. Por ejemplo, ISMS Copilot permite a las organizaciones configurar ajustes de retención de datos para cumplir tanto con políticas regulatorias como internas. También incluye funciones para redactar automáticamente información personal sensible durante el procesamiento. Algunas plataformas incluso ofrecen opciones de implementación como en las instalaciones, nube privada o configuraciones edge para mantener los datos completamente bajo el control de la organización.

| Factor | IA específica por dominio (ej. ISMS Copilot) | IA genérica (ej. ChatGPT) |

|---|---|---|

| Ubicación de datos | Garantizada regional (ej. Fráncfort, Alemania) [1] | Normalmente infraestructura con sede en EE.UU. [1] |

| Entrenamiento del modelo | Cero entrenamiento con datos de usuario por defecto [1] | Puede entrenar con entradas (requiere exclusión) [1] |

| Jurisdicción | Normalmente no estadounidense o basada en nube soberana [17] | Sujeta a la Ley CLOUD de EE.UU. [17] |

| Aislamiento de datos | Espacios de trabajo aislados para uso multi-cliente [1] | Hilos de conversación simples; riesgo de cruce de datos [1] |

Como señala Prem AI de manera elocuente:

"La era de 'muévete rápido y resuelve el cumplimiento después' ha terminado para la IA" [19].

Las organizaciones que priorizan la ubicación de datos y el cumplimiento desde el principio —no como una idea tardía— están mejor equipadas para aprobar auditorías y evitar sanciones. Esta base sólida para el control de datos impacta directamente en el rendimiento, que la siguiente sección explora a través de métricas de precisión y preparación para auditorías.

Comparación de rendimiento: IA genérica vs. IA específica por dominio

Cuando se trata de tareas de cumplimiento normativo, las brechas de rendimiento entre la IA genérica y las soluciones específicas por dominio son difíciles de ignorar. Mientras que los modelos de IA genéricos como ChatGPT, Claude y Gemini son excelentes para tareas generales, a menudo se quedan cortos en áreas que requieren precisión, registros de auditoría detallados y documentación robusta. Por otro lado, las plataformas específicas por dominio, como ISMS Copilot, están diseñadas específicamente para abordar estos desafíos de frente.

Precisión en la detección de brechas de cumplimiento

Los modelos de IA genéricos basan sus predicciones en conjuntos de datos amplios, lo que a menudo lleva a problemas de precisión en el trabajo de cumplimiento. Un estudio de Stanford de 2024 reveló que GPT-4 "alucinaba" —o generaba información incorrecta— el 58% de las veces al responder preguntas legales verificables [4]. Estos errores incluyen:

- Inventar números de controles.

- Confundir versiones de marcos normativos.

- Proporcionar mandatos excesivamente rígidos o inexactos.

La IA específica por dominio aborda estos problemas mediante un método llamado Inyección Dinámica de Conocimiento del Marco, que garantiza que las respuestas se basen en texto regulatorio verificado. Por ejemplo, ISMS Copilot v2.5 utiliza este enfoque para virtualmente eliminar requisitos fabricados en más de 50 marcos regulatorios [1][2].

| Factor de precisión | IA específica por dominio (ej. ISMS Copilot) | IA genérica (ej. ChatGPT, Claude) |

|---|---|---|

| Tasa de alucinaciones | Casi eliminada para consultas de marcos [1][2] | 58–88% en consultas específicas por dominio [4] |

| Versión del marco | Distinciones claras (ej. ISO 27001:2013 vs. 2022) [1] | Frecuentemente mezcla versiones [4] |

| Precisión de controles | Basada en texto regulatorio verificado [1][2] | Propensa a inventar o citar mal los controles [4] |

| Memoria institucional | Retiene entornos de control organizacional a lo largo del tiempo [4] | Se reinicia con cada sesión, careciendo de persistencia [4] |

Estas discrepancias destacan la importancia de la precisión y la documentación adecuada, esenciales para el cumplimiento y la preparación para auditorías.

Registros de auditoría y documentación de decisiones

La preparación para auditorías es otra área donde la IA específica por dominio brilla. Como señala Humadroid:

"Los auditores no evalúan si tus controles suenan bien. Evalúan si tus controles operaron de manera demostrable durante todo el período de auditoría" [4]

La IA genérica típicamente genera registros básicos de chat, que ofrecen poco valor como evidencia de auditoría. En contraste, las plataformas específicas por dominio proporcionan registros de auditoría a prueba de manipulaciones y recolección automatizada de evidencias a través de integraciones con herramientas como AWS y GitHub. Esto no solo fortalece la preparación para auditorías, sino que también reduce drásticamente el tiempo de preparación y disminuye los hallazgos de auditoría [3][4].

Aquí está el impacto en cifras:

- Las empresas que utilizan plataformas automatizadas de cumplimiento reportan una reducción del 40–60% en el tiempo de preparación para auditorías.

- También ven un 50–70% menos hallazgos de auditoría en su primera auditoría externa [4].

Además, la gestión manual del cumplimiento a menudo lleva a errores costosos, con el 88% de las hojas de cálculo conteniendo errores y el 90% de los fallos en ISO 27001 derivados de una mala documentación más que de controles técnicos ausentes [4].

Aplicaciones específicas por industria

Las ventajas de la IA específica por dominio se extienden más allá de la precisión y los registros de auditoría, especialmente en industrias reguladas. Por ejemplo:

- ISO 27001: Las plataformas especializadas automatizan el mapeo para el conjunto de controles de 2022, mientras que la IA genérica a menudo referencia controles obsoletos de 2013 o incluso inexistentes [4].

- RGPD: Las herramientas específicas por dominio ofrecen análisis detallados de brechas y residencia de datos en la UE, mientras que la IA genérica depende de infraestructura con sede en EE.UU. y proporciona solo consejos superficiales [1][4].

- SOC 2: Plataformas como ISMS Copilot permiten la recolección continua de evidencias mediante integraciones con API, demostrando la operación de controles a lo largo del tiempo —algo que la IA genérica no puede lograr— [4].

En el sector de la salud, las apuestas son aún más altas. Los modelos de IA genéricos, especialmente las versiones gratuitas o de gama baja, plantean un riesgo significativo de filtrar Información de Salud Protegida (PHI) a los conjuntos de datos de entrenamiento [4]. Las herramientas específicas por dominio mitigan esto al incorporar conocimiento específico del sector sanitario y garantizar cero entrenamiento con datos de usuario por defecto [1][4]. Como advierte ISACA:

"Los equipos de GRC deben tener cuidado al compartir datos corporativos propietarios con modelos de IA" [4]

Consideraciones de costos

A primera vista, la IA genérica podría parecer la opción económica. Por ejemplo, ChatGPT Plus cuesta 20 dólares al mes. Sin embargo, la falta de precisión específica del marco normativo y registros de auditoría confiables a menudo genera costos más altos a largo plazo debido a fallos en auditorías, esfuerzos de remediación e incremento en la documentación manual. En comparación, ISMS Copilot ofrece planes desde 24 dólares al mes, con niveles Pro y Business a 100 y 250 dólares al mes, respectivamente [1]. Para las organizaciones que priorizan el

Artículos relacionados

Cómo la IA rastrea cambios regulatorios

Explica cómo la IA utiliza PNL, aprendizaje automático y alertas en tiempo real para monitorear actualizaciones regulatorias, mapear impactos en controles y reducir la carga de cumplimiento.

Reglamento de IA de la UE: Requisitos de pruebas de robustez explicados

Explica los requisitos del Artículo 15 para pruebas de robustez de IA de alto riesgo: pruebas, documentación, supervisión y plazos de cumplimiento.

Evaluación de riesgos ISO 27001 con IA: Lista de verificación para startups

Utiliza IA para agilizar las evaluaciones de riesgos ISO 27001 en startups: alcance, inventario de activos, puntuación, asignación de controles y monitoreo continuo.