IA Générique vs IA Spécialisée par Domaine pour la Conformité

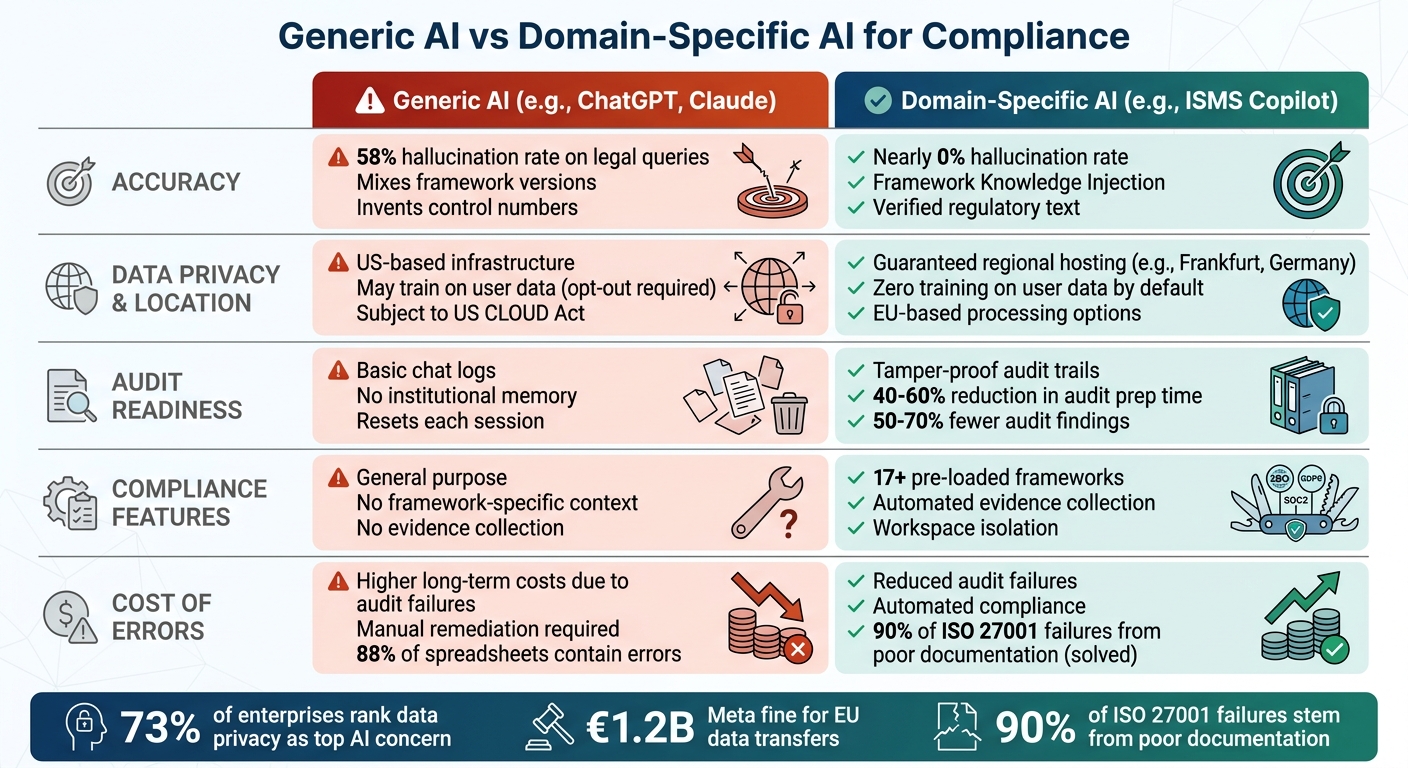

Comparaison entre IA générique et IA spécialisée par domaine pour la conformité : précision, résidence des données, préparation aux audits et réduction des risques d'audit.

IA Générique vs IA Spécialisée par Domaine pour la Conformité

Lorsqu'il s'agit de tâches de conformité, le choix de l'outil d'IA adapté peut faire la différence entre le succès et l'échec de vos efforts. Faut-il opter pour un outil d'IA générique comme ChatGPT, ou privilégier une plateforme d'IA spécialisée par domaine ? Voici l'essentiel à retenir :

- Les outils d'IA génériques sont polyvalents, mais souvent manquent de la précision requise pour la conformité. Ils s'appuient sur des ensembles de données larges, ce qui entraîne des inexactitudes (par exemple, un taux de 58 % d'hallucinations pour les requêtes juridiques). Ils posent également des risques en matière de confidentialité des données en raison d'un traitement basé aux États-Unis.

- Les outils d'IA spécialisés par domaine, comme ISMS Copilot, sont conçus pour le travail de conformité. Ils utilisent des données réglementaires vérifiées, garantissent la résidence des données (par exemple, des serveurs basés dans l'UE) et intègrent des fonctionnalités comme des pistes d'audit et une précision spécifique aux cadres réglementaires.

Principales différences :

- Précision : L'IA spécialisée par domaine minimise les erreurs en ancrant ses réponses dans des normes vérifiées, contrairement à l'IA générique qui peut générer des informations fabriquées ou obsolètes.

- Confidentialité des données : Les plateformes spécialisées privilégient le stockage et la souveraineté des données régionales. L'IA générique traite souvent les données aux États-Unis, créant des risques de conformité avec le RGPD et transfrontaliers.

- Préparation aux audits : Les outils spécialisés fournissent une documentation structurée, infalsifiable et une collecte continue de preuves – ce que l'IA générique ne propose pas.

Conclusion rapide : Si la conformité est cruciale pour votre organisation, l'IA spécialisée par domaine est le choix le plus sûr et fiable.

::: @figure  {IA Générique vs IA Spécialisée par Domaine pour la Conformité : Principales différences}

:::

{IA Générique vs IA Spécialisée par Domaine pour la Conformité : Principales différences}

:::

Sécurité et Risques de l'IA : Comparaison côte à côte des cadres de conformité et de risque

::: @iframe https://www.youtube.com/embed/wkEEK8Wp2WM :::

Pourquoi l'IA Générique est Inadaptée pour la Conformité en Sécurité

Les outils d'IA génériques, bien qu'excellents pour la productivité générale, peinent à répondre à la précision et à la fiabilité nécessaires pour les travaux de conformité réglementée. Ces modèles génèrent du texte en prédisant le mot le plus probable suivant plutôt qu'en s'appuyant sur des faits vérifiés [8]. Cela peut conduire à des résultats qui semblent convaincants mais sont factuellement incorrects – un risque majeur en conformité, où la précision est non négociable. Analysons les principaux problèmes.

Résultats inexacts et hallucinations

Des études révèlent qu'environ 46 % des textes générés par l'IA contiennent des hallucinations. Lorsqu'ils sont testés avec des questions juridiques spécifiques, GPT-4 a été trouvé hallucinant au moins 58 % du temps [4][9]. Pour les professionnels de la conformité, ce niveau d'inexactitude est inacceptable. Les conséquences peuvent être graves :

- Un avocat américain a été sanctionné après avoir soumis des citations juridiques fictives produites par ChatGPT.

- Air Canada a dû honorer une politique de "tarif de deuil" fabriquée par son chatbot IA [4].

L'IA générique a également du mal à distinguer les normes réglementaires obsolètes des normes actuelles, créant des lacunes dangereuses en matière de conformité. Par exemple, elle pourrait confondre les exigences de ISO 27001 :2013 et ISO 27001 :2022, inventer des numéros de contrôles inexistants, ou affirmer à tort que ISO 27001 exige un audit de type SOC 2 Type II.

J.P. Roe, un rédacteur professionnel, a résumé cela ainsi :

"L'IA ne comprend pas le contexte – pas du tout... Personnellement, je ne l'utiliserais pas pour quoi que ce soit juridiquement contraignant à moins qu'un expert en conformité ne vérifie et ne corrige les erreurs par la suite." [10]

Des recherches montrent que 90 % des échecs de certification ISO 27001 proviennent d'une mauvaise gestion de la documentation et de l'incapacité à prouver l'existence des contrôles [4]. L'IA générique manque de la capacité à générer les preuves vérifiables nécessaires pour répondre à ces normes. Et au-delà de la précision, les problèmes liés à la confidentialité des données exposent davantage ses limites.

Problèmes de confidentialité et de localisation des données

Les outils d'IA génériques posent également des risques significatifs pour la confidentialité des données et les transferts transfrontaliers. Même lorsque les fournisseurs affirment stocker les données au sein de l'UE ou du Royaume-Uni, l'étape d'inférence (où les GPU traitent les entrées) se déroule souvent aux États-Unis [6]. Cela crée des défis de conformité pour les organisations soumises au chapitre V du RGPD et à l'arrêt Schrems II.

Geoff Davies de PivotalEdge a expliqué :

"La résidence est la plus forte pour les données stockées. Si vous avez besoin d'un traitement strictement limité au Royaume-Uni pour tout, vérifiez comment OpenAI gère l'inférence... car tous les flux de travail ne peuvent pas garantir un traitement strictement limité au Royaume-Uni." [6]

Cela est particulièrement préoccupant car les fournisseurs d'IA basés aux États-Unis sont soumis aux lois américaines de surveillance, qui peuvent entrer en conflit avec les normes européennes de protection des données. Les risques sont réels : en avril 2023, des ingénieurs de Samsung ont accidentellement divulgué du code source propriétaire et des notes de réunion internes dans ChatGPT en l'utilisant pour la synthèse et le débogage – trois incidents distincts en seulement 20 jours. En réponse, Samsung a instauré une interdiction générale de l'IA générative pour un usage interne [4].

Manque de connaissances spécialisées en conformité

Les outils d'IA génériques échouent également à comprendre les cadres de conformité spécifiques ou l'environnement de contrôle unique d'une organisation, son historique d'audit ou son profil de risque. Bien que ces outils puissent rédiger des politiques, ils ne peuvent pas produire la documentation objective, horodatée et infalsifiable que les auditeurs exigent. Comme l'a souligné Humadroid :

"Les auditeurs n'évaluent pas si vos contrôles semblent bons. Ils évaluent si vos contrôles ont fonctionné de manière démontrable sur toute la période d'audit." [4]

Un autre problème courant : l'IA générique confond souvent les exigences légales avec les bonnes pratiques. Par exemple, elle pourrait affirmer à tort que le chiffrement AES-256 est une obligation légale alors que les réglementations exigent simplement des "mesures de sécurité appropriées" basées sur une évaluation des risques. Cette sur-prescription peut entraîner des coûts et des efforts inutiles.

Ces lacunes soulignent la nécessité d'un meilleur assistant IA pour ISO 27001 qui fournit un contexte spécifique au cadre et peut s'adapter aux nuances du travail de conformité – quelque chose que l'IA générique n'est tout simplement pas conçue pour gérer.

Comment l'IA Spécialisée par Domaine Répond aux Besoins de Conformité

L'IA spécialisée par domaine s'appuie sur des données réglementaires vérifiées plutôt que sur des schémas internet imprévisibles. Cette approche garantit que les réponses sont ancrées dans des connaissances structurées et curatées – essentielle lorsque la précision est non négociable. Voici comment elle aborde les principaux défis de conformité.

Cadres réglementaires préchargés

Contrairement à l'IA généraliste, les outils spécialisés sont livrés avec des cadres réglementaires préchargés pour garantir la précision. Par exemple, ISMS Copilot utilise un système appelé "Dynamic Framework Knowledge Injection" (Injection dynamique de connaissances des cadres), qui élimine les conjectures. Mentionnez une norme comme ISO 27001 ou SOC 2, et le système l'identifie immédiatement par correspondance de motifs. Il charge ensuite les contrôles, clauses et exigences pertinents dans son contexte avant de générer une réponse. Ce processus, qui ne prend que 5 à 15 secondes, réduit considérablement les erreurs dans les requêtes spécifiques aux cadres [11][12][14].

Les informations proviennent de bases de données curatées vérifiées par des ingénieurs en Gouvernance, Risques et Conformité (GRC) par rapport aux normes officielles [12][13]. Actuellement, ISMS Copilot prend en charge 17 cadres, dont ISO 27001:2022, ISO 42001:2023, SOC 2, HIPAA, RGPD, NIS 2, DORA et le Règlement IA de l'UE. Chaque réponse inclut des citations spécifiques à ces cadres, rendant les résultats prêts pour les audits dès le départ [11][12][13].

Traces d'audit complètes et suivi des décisions

L'IA générique réinitialise chaque conversation, mais les plateformes spécialisées conservent une mémoire institutionnelle au fil du temps – un élément que les auditeurs apprécient. Cela est particulièrement important étant donné que 90 % des échecs de certification ISO 27001 résultent d'une mauvaise gestion de la documentation plutôt que de contrôles techniques manquants [4].

ISMS Copilot propose des fonctionnalités comme le suivi des modifications, des espaces de travail séparés pour différents projets ou clients, et le mode Réduction des données PII, qui masque automatiquement les informations personnelles sensibles comme les noms, adresses e-mail et numéros de téléphone avant le traitement. Les utilisateurs peuvent également configurer des périodes de conservation des données, allant d'aussi peu qu'1 jour à aussi longtemps que 7 ans, pour se conformer aux politiques réglementaires ou internes [13].

Contrôle de la localisation des données et flexibilité de déploiement

Pour les organisations soumises à des règles strictes de souveraineté des données, l'IA spécialisée garantit la conformité grâce à des garanties d'hébergement régional. Par exemple, ISMS Copilot stocke toutes les données à Francfort, en Allemagne, et propose un mode Protection avancée des données qui achemine les requêtes exclusivement via des fournisseurs d'IA basés dans l'UE comme Mistral AI [13][14]. Cela garantit le respect du RGPD et d'autres lois sur la protection des données.

Tous les fournisseurs backend fonctionnent selon des accords de Rétention zéro des données (ZDR), ce qui signifie que les requêtes et réponses des utilisateurs ne sont jamais stockées à long terme ni utilisées pour l'entraînement des modèles [13][14]. Pour les organisations ayant des exigences encore plus strictes, certaines plateformes permettent un déploiement sur site, dans des clouds privés ou sur des infrastructures edge, garantissant que les données restent entièrement sous le contrôle de l'organisation [15]. Ce niveau de gestion des données aide les organisations à répondre aux normes de conformité les plus rigoureuses.

Confidentialité et Localisation des Données : La Différence Principale

Lorsqu'il s'agit de conformité, l'endroit où les données sont stockées et qui peut y accéder sont des préoccupations majeures. Les outils d'IA génériques comme ChatGPT traitent souvent les données via une infrastructure basée aux États-Unis, ce qui peut poser problème pour les entreprises soumises aux réglementations européennes, chinoises ou spécifiques à un secteur. L'IA spécialisée par domaine, en revanche, est conçue avec la localisation des données comme priorité.

La distinction entre confidentialité et localisation des données est un facteur majeur séparant l'IA spécialisée par domaine des solutions génériques. En fait, 73 % des entreprises classent la confidentialité et la sécurité des données comme leur principale préoccupation concernant l'IA, et 77 % considèrent désormais l'origine du fournisseur comme un critère avant de prendre des décisions d'achat [17]. Ces préoccupations ne sont pas théoriques – les régulateurs sont passés à l'action. Par exemple :

- Meta a été condamné à une amende de 1,2 milliard d'euros en 2023 pour avoir transféré les données des utilisateurs de l'UE vers les États-Unis.

- TikTok a écopé d'une amende de 530 millions d'euros en 2025 pour avoir envoyé les données des citoyens de l'UE vers des serveurs en Chine.

- Uber a payé 290 millions d'euros en 2024 pour avoir déplacé des registres de chauffeurs à travers les frontières [17][19].

Ces cas soulignent l'importance de la manière dont l'IA spécialisée par domaine redéfinit le stockage des données, les contrôles de traitement et la gestion des risques transfrontaliers.

Respect des lois régionales sur le stockage des données

Les plateformes d'IA spécialisées répondent soigneusement à la fois à la résidence des données (où se trouvent physiquement les serveurs) et à la souveraineté des données (le cadre juridique régissant ces données). Simplement sélectionner une "région UE" auprès d'un fournisseur cloud américain ne garantit pas nécessairement la conformité. Comme l'explique Jaipal Singh :

"La juridiction légale suit l'entreprise, et non le centre de données." [17]

Prenons l'exemple du EU AI Act Copilot. Il stocke les données à Francfort, en Allemagne, et inclut un mode Protection avancée des données qui achemine les requêtes exclusivement via des fournisseurs basés dans l'UE. Tous les fournisseurs backend fonctionnent selon des accords de Rétention zéro des données (ZDR), ce qui signifie que les requêtes et réponses ne sont ni sauvegardées ni utilisées pour l'entraînement des modèles [1]. Cette configuration est conforme aux exigences du RGPD et aide les organisations à naviguer dans les incertitudes, en particulier après l'effondrement du cadre de protection des données UE-États-Unis (souvent appelé "Schrems III") fin 2025 [18].

Les enjeux sont élevés. Selon le Règlement IA de l'UE, les pénalités peuvent atteindre 7 % du chiffre d'affaires mondial ou 35 millions d'euros, et les violations combinées du RGPD et du Règlement IA pourraient théoriquement atteindre 11 % du chiffre d'affaires mondial [18]. D'ici 2026, au moins 34 pays avaient introduit ou renforcé des lois de localisation des données affectant le traitement de l'IA [18].

Réduction des risques transfrontaliers liés aux données

Même lorsque les données sont stockées régionalement, les flux transfrontaliers peuvent introduire des risques de conformité supplémentaires. Les API d'IA génériques créent souvent des flux de données cachés via des voies secondaires, telles que la modération de contenu, les vérifications de sécurité ou la journalisation. Ces points de contact peuvent relever de juridictions légales différentes. De plus, de nombreux fournisseurs génériques se réservent le droit d'utiliser les entrées de l'API pour l'entraînement des modèles, sauf si les utilisateurs optent explicitement pour le refus [18].

L'IA spécialisée par domaine minimise ces risques grâce à une conception intentionnelle. Par exemple, certaines plateformes utilisent une approche "Insights Not Data" (Informations, pas données), où les données sont pré-traitées localement pour supprimer ou pseudonymiser les identifiants personnels. Seules les informations anonymisées sont envoyées aux modèles basés dans le cloud [18]. D'autres offrent une isolation des espaces de travail, garantissant que les données de différents clients ou projets restent séparées [1].

Cette approche réfléchie permet également d'économiser du temps et de l'argent. La mise en œuvre de la résidence des données assistée par IA peut prendre seulement 2 à 3 semaines, contre 4 à 6 mois avec des méthodes manuelles. Les coûts diminuent également de manière significative, passant d'une estimation de 150 000 à 250 000 dollars à 40 000 à 80 000 dollars. La validation automatisée garantit une précision de 100 %, tandis que les revues manuelles comportent un taux d'erreur de 15 à 20 % [16].

Contrôles clairs de traitement et de stockage des données

Les plateformes d'IA spécialisées offrent transparence et contrôle sur chaque étape du traitement des données. Alors que l'IA générique fonctionne souvent comme une "boîte noire", les solutions spécialisées révèlent l'ensemble de la chaîne de traitement. Par exemple, ISMS Copilot permet aux organisations de configurer les paramètres de conservation des données pour répondre aux politiques réglementaires et internes. Il inclut également des fonctionnalités pour masquer automatiquement les informations personnelles sensibles pendant le traitement. Certaines plateformes proposent même des options de déploiement comme sur site, cloud privé ou configurations edge pour garder les données entièrement sous le contrôle de l'organisation.

| Critère | IA Spécialisée par Domaine (ex. ISMS Copilot) | IA Générique (ex. ChatGPT) |

|---|---|---|

| Emplacement des données | Garantie régionale (ex. Francfort, Allemagne) [1] | Infrastructure typiquement basée aux États-Unis [1] |

| Entraînement des modèles | Rétention zéro des données par défaut [1] | Peut entraîner les modèles sur les entrées (opt-out requis) [1] |

| Juridiction | Souvent non américaine ou basée sur cloud souverain [17] | Soumise au CLOUD Act américain [17] |

| Isolation des données | Espaces de travail isolés pour une utilisation multi-clients [1] | Fils de conversation simples ; risque de chevauchement des données [1] |

Comme le souligne Prem AI :

"L'ère du 'bouge vite et règle la conformité plus tard' est révolue pour l'IA." [19]

Les organisations qui priorisent la localisation et la conformité des données dès le départ – et non comme une réflexion tardive – sont mieux équipées pour réussir les audits et éviter les pénalités. Cette base solide pour le contrôle des données a un impact direct sur les performances, que la section suivante explore à travers les métriques de précision et la préparation aux audits.

Comparaison des Performances : IA Générique vs IA Spécialisée par Domaine

Lorsqu'il s'agit de tâches de conformité, les écarts de performance entre l'IA générique et les solutions spécialisées sont difficiles à ignorer. Bien que les modèles d'IA génériques comme ChatGPT, Claude et Gemini excellent pour les tâches générales, ils peinent souvent dans des domaines exigeant de la précision, des pistes d'audit détaillées et une documentation robuste. À l'inverse, les plateformes spécialisées, comme ISMS Copilot, sont conçues pour relever ces défis de front.

Précision de détection des écarts de conformité

Les modèles d'IA génériques basent leurs prédictions sur des ensembles de données larges, ce qui conduit souvent à des problèmes de précision dans le travail de conformité. Une étude de Stanford de 2024 a révélé que GPT-4 "hallucinait" – ou générait des informations incorrectes – 58 % du temps lorsqu'il répondait à des questions juridiques vérifiables [4]. Ces erreurs incluent :

- L'invention de numéros de contrôles.

- La confusion entre les versions des cadres.

- La fourniture de mandats trop rigides ou inexacts.

L'IA spécialisée par domaine aborde ces problèmes grâce à une méthode appelée Injection dynamique de connaissances des cadres, qui garantit que les réponses sont ancrées dans des textes réglementaires vérifiés. Par exemple, ISMS Copilot v2.5 utilise cette approche pour éliminer virtuellement les exigences fabriquées à travers plus de 50 cadres réglementaires [1][2].

| Facteur de précision | IA Spécialisée par Domaine (ex. ISMS Copilot) | IA Générique (ex. ChatGPT, Claude) |

|---|---|---|

| Taux d'hallucination | Quasi-éliminé pour les requêtes de cadre [1][2] | 58–88 % sur les requêtes spécifiques à un domaine [4] |

| Version du cadre | Distinctions claires (ex. ISO 27001:2013 vs. 2022) [1] | Confusion fréquente entre les versions [4] |

| Précision des contrôles | Basée sur des textes réglementaires vérifiés [1][2] | Sujette à l'invention ou à la mauvaise citation des contrôles [4] |

| Mémoire institutionnelle | Conserve les environnements de contrôle organisationnels au fil du temps [4] | Réinitialisé à chaque session, sans persistance [4] |

Ces disparités soulignent l'importance de la précision et de la documentation appropriée, essentielles pour la conformité et la préparation aux audits.

Enregistrements d'audit et documentation des décisions

La préparation aux audits est un autre domaine où l'IA spécialisée par domaine brille. Comme le souligne Humadroid :

"Les auditeurs n'évaluent pas si vos contrôles semblent bons. Ils évaluent si vos contrôles ont fonctionné de manière démontrable sur toute la période d'audit." [4]

L'IA générique génère généralement des journaux de conversation basiques, qui offrent peu de valeur en tant que preuves d'audit. En revanche, les plateformes spécialisées fournissent des journaux d'audit infalsifiables et une collecte automatisée de preuves via des intégrations avec des outils comme AWS et GitHub. Cela renforce non seulement la préparation aux audits, mais réduit également considérablement le temps de préparation et le nombre de constats d'audit [3][4].

Voici l'impact en chiffres :

- Les entreprises utilisant des plateformes de conformité automatisées rapportent une réduction de 40 à 60 % du temps de préparation aux audits.

- Elles constatent également 50 à 70 % de constats d'audit en moins lors de leur premier audit externe [4].

De plus, la gestion manuelle de la conformité conduit souvent à des erreurs coûteuses, avec 88 % des feuilles de calcul contenant des erreurs et 90 % des échecs de certification ISO 27001 provenant d'une mauvaise documentation plutôt que de contrôles techniques manquants [4].

Applications spécifiques à un secteur

Les avantages de l'IA spécialisée par domaine s'étendent au-delà de la précision et des pistes d'audit, en particulier dans les secteurs réglementés. Par exemple :

- ISO 27001 : Les plateformes spécialisées automatisent la cartographie pour l'ensemble des contrôles 2022, tandis que l'IA générique fait souvent référence aux contrôles obsolètes de 2013 ou à des contrôles inexistants [4].

- RGPD : Les outils spécialisés offrent des analyses détaillées des écarts et la résidence des données dans l'UE, tandis que l'IA générique s'appuie sur une infrastructure basée aux États-Unis et ne fournit que des conseils superficiels [1][4].

- SOC 2 : Des plateformes comme ISMS Copilot permettent une collecte continue de preuves via des intégrations API, prouvant le fonctionnement des contrôles au fil du temps – quelque chose que l'IA générique ne peut pas accomplir [4].

Dans le secteur de la santé, les enjeux sont encore plus élevés. Les modèles d'IA génériques, en particulier les versions gratuites ou d'entrée de gamme, présentent un risque significatif de fuite d'informations de santé protégées (PHI) vers les ensembles de données d'entraînement [4]. Les outils spécialisés atténuent ce risque en intégrant des connaissances spécifiques au secteur de la santé et en garantissant une rétention zéro des données par défaut [1][4]. Comme le met en garde [ISACA](https://www.isaca

Articles connexes

Comment l'IA suit les évolutions réglementaires

Explique comment l'IA utilise le traitement automatique du langage (NLP), le machine learning et les alertes en temps réel pour surveiller les mises à jour réglementaires, cartographier les impacts sur les contrôles et réduire la charge de conformité.

Règlement UE sur l'IA : Exigences en matière de tests de robustesse expliquées

Explication des exigences de l'Article 15 concernant les tests de robustesse pour les systèmes d'IA à haut risque : tests, documentation, surveillance et échéances de conformité.

Évaluation des risques ISO 27001 avec l'IA : Checklist pour les startups

Utilisez l'IA pour accélérer les évaluations des risques ISO 27001 pour les startups — périmètre, inventaire des actifs, notation, cartographie des contrôles et surveillance continue.