EU AI Act: Requisiti di Test di Robustezza Spiegati

Spiega i requisiti dell'Articolo 15 per il test di robustezza dell'IA ad alto rischio: test, documentazione, monitoraggio e tempistiche di conformità.

EU AI Act: Requisiti di Test di Robustezza Spiegati

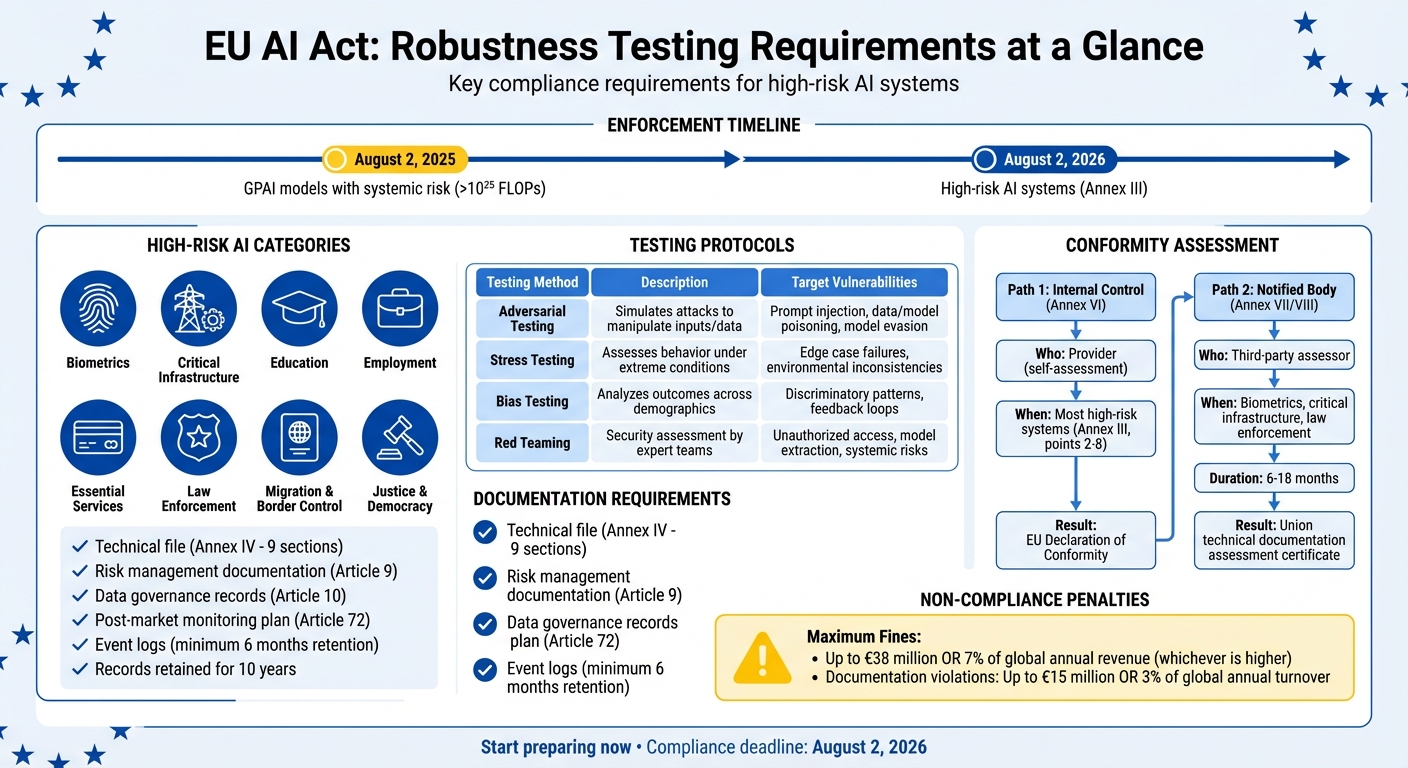

L'EU AI Act impone che i sistemi di IA ad alto rischio subiscano test rigorosi di robustezza per garantire prestazioni affidabili in caso di errori, guasti o condizioni inaspettate. Questo requisito, dettagliato nell'Articolo 15, si applica a sistemi in settori critici come sanità, trasporti e applicazione della legge. Ecco cosa devi sapere:

- Robustezza Definita: La capacità dei sistemi di IA di mantenere prestazioni coerenti nonostante le interruzioni, come descritto in ISO/IEC 25059:2023.

- Sistemi di IA ad Alto Rischio: Include l'IA in biometria, infrastrutture critiche, educazione, occupazione e altro, come elencato nell'Allegato III. L'applicazione inizia il 2 agosto 2026.

- Protocolli di Test: Include test avversariali, stress testing e red teaming per identificare le vulnerabilità.

- Documentazione: I fornitori devono preparare file tecnici dettagliati, condurre valutazioni di conformità e conservare i record per 10 anni.

- Monitoraggio Post-Distribuzione: È richiesto il tracciamento continuo delle prestazioni e i salvaguardi contro i cicli di feedback dannosi.

Non seguire la lista di controllo per la conformità all'EU AI Act può comportare multe fino a $38 milioni o il 7% del fatturato annuale globale. Inizia a prepararti ora per rispettare questi requisiti prima della scadenza di applicazione.

::: @figure  {Requisiti di Test di Robustezza dell'EU AI Act e Timeline di Conformità}

:::

{Requisiti di Test di Robustezza dell'EU AI Act e Timeline di Conformità}

:::

Sistemi di IA ad Alto Rischio e Applicabilità

Quali Sistemi si Qualificano come Sistemi di IA ad Alto Rischio?

L'EU AI Act definisce i sistemi di IA ad alto rischio attraverso due approcci principali. In primo luogo, include sistemi di IA che agiscono come componenti di sicurezza in prodotti regolati dalle leggi di armonizzazione dell'UE (elencati nell'Allegato I). Gli esempi includono macchinari, dispositivi medici e sistemi automobilistici in cui un guasto potrebbe rappresentare rischi per la salute o la sicurezza [7]. In secondo luogo, copre i sistemi delineati nell'Allegato III, che si estendono su otto aree che potrebbero influenzare i diritti fondamentali [7][8].

Queste otto categorie dell'Allegato III sono:

- Biometria: Sistemi come identificazione remota e riconoscimento delle emozioni.

- Infrastrutture Critiche: Strumenti per la gestione del traffico stradale o dei servizi (ad es., acqua, gas, elettricità).

- Educazione: IA utilizzata nelle decisioni di ammissione o nel monitoraggio degli esami.

- Occupazione: Applicazioni come lo screening dei curriculum, le decisioni di promozione e il monitoraggio dei dipendenti.

- Servizi Essenziali: Sistemi per la valutazione del credito o il pricing dell'assicurazione.

- Applicazione della Legge: Strumenti come macchine della verità o modelli di predizione della recidiva.

- Migrazione e Controllo delle Frontiere: IA utilizzata nell'elaborazione dei visti.

- Giustizia e Democrazia: Sistemi sviluppati per assistere le autorità giudiziarie [7][8].

Tuttavia, non tutti i sistemi in queste categorie si qualificano automaticamente come ad alto rischio. L'Articolo 6 consente esenzioni se un sistema esegue compiti strettamente definiti o supporta attività guidate dall'uomo senza influenzare significativamente le decisioni - a condizione che non sia coinvolto il profiling. Per richiedere questa esenzione, le organizzazioni devono documentare la loro valutazione usando un assistente per le politiche e registrare il sistema nel database dell'UE prima dell'immissione in commercio [8]. D'altra parte, se un sistema di IA profila gli individui all'interno di un dominio dell'Allegato III, rimane classificato come ad alto rischio [8].

Per tutti i sistemi ad alto rischio, l'Articolo 15 obbliga il test di robustezza per garantire prestazioni affidabili durante l'intero ciclo di vita [4]. L'applicazione di questi requisiti per i sistemi dell'Allegato III inizia il 2 agosto 2026 [8].

Questo quadro di classificazione sostiene gli standard rigorosi di robustezza richiesti dall'EU AI Act.

IA per Scopi Generali e Rischio Sistemico

L'Atto affronta anche i modelli di IA per scopi generali (GPAI), che non sono intrinsecamente ad alto rischio. Tuttavia, quando questi modelli vengono integrati in sistemi ad alto rischio - come l'uso di un large language model nel reclutamento o nelle infrastrutture critiche - devono rispettare gli standard ad alto rischio [9][8]. Inoltre, i modelli GPAI identificati come che pongono "rischio sistemico" sono soggetti a specifici requisiti di robustezza, incluso il test avversariale [9].

Per qualificarsi come rischio sistemico, la potenza computazionale di addestramento cumulativa del modello deve superare 10^25 FLOPs [9]. Come altri sistemi ad alto rischio, questi modelli devono subire valutazioni dettagliate e test avversariali per rilevare le vulnerabilità [6]. Le regole per i modelli GPAI entrano in vigore il 2 agosto 2025, un anno prima rispetto ai requisiti più ampi per i sistemi ad alto rischio [9].

Misure Tecniche e Organizzative per la Robustezza

Costruire Resilienza Tecnica

L'Articolo 15 dell'EU AI Act enfatizza l'importanza della resilienza nei sistemi di IA ad alto rischio, assicurando che possono resistere alle interruzioni operative. Questi sistemi devono gestire errori, guasti o incongruenze all'interno del loro ambiente, anche quando affrontano guasti hardware, input corrotti o comportamenti utente inaspettati [1].

Un approccio chiave per raggiungere la resilienza è la ridondanza tecnica. Ad esempio, la containerizzazione può isolare le operazioni di sistema, mantenendo l'affidabilità anche quando sorgono problemi di infrastruttura [2]. In contesti critici, progettare il degrado graduale - in cui il sistema passa alle operazioni manuali o ai sistemi di backup invece di spegnersi completamente - aggiunge un ulteriore livello di affidabilità.

Le vulnerabilità specifiche dell'IA richiedono attenzione. Le minacce come l'avvelenamento dei dati (manomissione dei dati di addestramento), l'avvelenamento del modello (incorporamento di codice maligno durante l'addestramento) e gli esempi avversariali (input progettati per indurre in errore l'IA) richiedono forti difese [2]. Il framework MITRE ATLAS fornisce strumenti per testare e mitigare questi rischi [2]. Inoltre, i sistemi di monitoraggio e allerta automatizzati possono identificare problemi di prestazioni o disponibilità in tempo reale. Strumenti specializzati come ISMS Copilot One possono aiutare ad automatizzare questi complessi flussi di lavoro di conformità.

Per i sistemi di IA che continuano ad apprendere post-distribuzione, i cicli di feedback pongono sfide uniche. Se gli output distorti si integrano nei dati di addestramento successivi, quei bias possono accumularsi. Per affrontare questo, misure come la cura selettiva dei dati e la limitazione dell'integrazione del feedback dal mondo reale sono essenziali [1]. La registrazione degli eventi, come richiesto dall'Articolo 12, aiuta a tracciare i cambiamenti di prestazioni e a rilevare potenziali problemi [8].

Questi salvaguardi tecnici funzionano insieme alle misure organizzative per garantire che i sistemi rimangano equi e imparziali.

Affrontare il Bias e l'Equità

Mitigare il bias non è solo una responsabilità etica ma anche un obbligo legale secondo l'Atto. I sistemi di IA ad alto rischio devono operare equamente tra tutti i gruppi demografici, in particolare nelle aree sensibili come occupazione, educazione o accesso ai servizi essenziali [8].

Gli audit regolari di equità sono cruciali. Ad esempio, se uno strumento di screening dei curriculum non tiene conto dei diversi percorsi professionali o background educativi, potrebbe sfavorire ingiustamente alcuni gruppi. Tali violazioni potrebbero portare a sanzioni fino a $35 milioni o il 7% del fatturato annuale globale [10].

La supervisione umana, come richiesto dall'Articolo 14, è un altro componente critico. Gli umani devono comprendere i limiti del sistema, evitare di fidarsi ciecamente dei suoi output (bias di automazione) e intervenire quando necessario [8]. Un approccio efficace è un design di tipo consultivo, in cui gli output dell'IA vengono revisionati dagli umani prima di intraprendere qualsiasi azione.

Per affrontare il bias sistematicamente, stabilisci un Sistema di Gestione della Qualità (QMS) secondo l'Articolo 17. Questo dovrebbe includere politiche scritte per identificare e correggere il bias, insieme alla gestione continua dei rischi durante l'intero ciclo di vita del sistema di IA. Il monitoraggio post-mercato è essenziale per valutare le prestazioni nel mondo reale, mentre i log automatizzati - conservati per almeno sei mesi - creano un percorso dati per gli audit e le inchieste su incidenti [8].

Test e Validazione per la Robustezza

Protocolli di Test di Robustezza

Per garantire che i sistemi di IA siano pronti per la distribuzione, l'EU AI Act obbliga i test rigorous pre-distribuzione, soprattutto per i sistemi ad alto rischio. Questi test sono progettati per confermare la resilienza contro errori, guasti e potenziali attacchi [1].

Il test avversariale è un requisito chiave per i sistemi di IA per scopi generali con rischi sistemici, nonché per i sistemi ad alto rischio. Questo approccio prevede la simulazione di attacchi come iniezione di prompt, avvelenamento dei dati e evasione del modello per valutare quanto bene il sistema può resistere a tali minacce [10][11]. Un altro metodo critico è il red teaming, in cui esperti interni o esterni tentano attivamente di violare il sistema, fornendo una valutazione di sicurezza completa [10].

Lo stress testing valuta come i sistemi gestiscono scenari estremi o insoliti, come casi limite o iniezioni di guasto intenzionali, assicurando che i guasti si verifichino in modo controllato e prevedibile [10][11].

| Metodo di Test | Descrizione | Vulnerabilità Obiettivo |

|---|---|---|

| Test Avversariale | Simula attacchi per manipolare input o dati di addestramento | Iniezione di prompt, avvelenamento dei dati/modello, evasione del modello [10][3] |

| Stress Testing | Valuta il comportamento in condizioni estreme o insolite | Guasti di casi limite, incongruenze ambientali [11][8] |

| Test di Bias | Analizza i risultati tra i gruppi demografici | Modelli discriminatori, cicli di feedback [11] |

| Red Teaming | Valutazione della sicurezza da parte di team interni o esterni | Accesso non autorizzato, estrazione del modello, rischi sistemici [10] |

Per minimizzare il bias negli output, i dataset di test devono essere accuratamente curati per essere rilevanti, rappresentativi e il più possibile privi di errori [1][11]. Inoltre, i fornitori sono tenuti a dichiarare specifici benchmark di accuratezza e resilienza nelle loro istruzioni per l'utente, allineandosi agli standard della Commissione Europea [1][3].

"L'assicurazione della qualità non è più facoltativa - è la base della conformità normativa. Le organizzazioni devono provare che i loro sistemi di IA sono sicuri, equi e affidabili prima di poter entrare nel mercato dell'UE."

Una volta completati questi protocolli pre-distribuzione, il monitoraggio continuo garantisce che i sistemi rimangono robusti dopo la distribuzione.

Monitoraggio Continuo Dopo la Distribuzione

Il test non termina quando un sistema di IA viene distribuito. Secondo l'Articolo 72, i fornitori devono implementare sistemi di monitoraggio post-mercato che raccolgono, documentano e analizzano continuamente i dati di prestazione durante l'intero ciclo di vita del sistema [4][12]. Questo garantisce che il sistema si adatti alle condizioni mutevoli del mondo reale mantenendo la sua integrità.

I sistemi di IA ad alto rischio sono tenuti a registrare gli eventi per almeno sei mesi. Questi log aiutano a tracciare le prestazioni, identificare i potenziali rischi e documentare i cambiamenti significativi [6][8][12]. Strumenti come il rilevamento di anomalie possono segnalare i cambiamenti di dati inaspettati o il rumore che potrebbe compromettere la robustezza del sistema [2][5].

Per i sistemi che apprendono continuamente, i salvaguardi devono essere in atto per prevenire i cicli di feedback, in cui gli output distorti potrebbero influenzare i dati di addestramento futuri [4][2][1]. Gli strumenti di monitoraggio tracciano il deterioramento delle prestazioni nel tempo, mentre la containerizzazione assicura ambienti stabili e riproducibili per l'esecuzione del sistema [2].

Sia i fornitori che i distributori sono obbligati a segnalare gli incidenti [6][12]. Inoltre, i meccanismi di supervisione umana, come le procedure del "pulsante di arresto", consentono l'intervento immediato in caso di problemi [8].

"L'EU AI Act richiede il monitoraggio continuo dopo la distribuzione, non solo i test una tantum. I sistemi di IA ad alto rischio necessitano di logging automatico e risposta agli incidenti incorporati da l'inizio."

- Oleg Sivograkov, VP of IT Operations, TestFort [11]

La data di applicazione di questi requisiti è fissata al 2 agosto 2026 [8]. Il mancato rispetto potrebbe comportare sanzioni gravi, incluse multe fino a $38 milioni o il 7% del fatturato annuale globale [10].

Parte 2: Navigare l'EU AI Act: Essenziali di Conformità per Sistemi di IA ad Alto Rischio

::: @iframe https://www.youtube.com/embed/wsr6d6WG5Uo :::

Documentazione e Reportistica di Conformità

Dopo i rigorous test e il monitoraggio continuo, la documentazione appropriata è essenziale per garantire che la conformità sia mantenuta.

Standard di Documentazione Tecnica

Prima di introdurre un prodotto sul mercato, devi preparare un file tecnico che soddisfi gli standard dell'Allegato IV. Questo file dovrebbe dimostrare chiaramente l'adesione ai requisiti di robustezza dell'Articolo 15 [13]. Il file deve includere nove sezioni, con la Sezione 4 che si concentra specificamente sulle metriche di prestazione. Dovrebbe dettagliare i risultati dei test di robustezza, i metodi di validazione e il ragionamento dietro le metriche scelte [13].

La creazione di questa documentazione può richiedere tra 40-80 ore, a condizione che i dati di conformità siano già integrati nel processo di sviluppo usando un assistente per l'implementazione dell'IA [13]. Strumenti come MLflow possono semplificare questo processo acquisendo log, audit trail e decisioni di progettazione direttamente nel tuo flusso di lavoro.

Il tuo file tecnico dovrebbe includere anche quanto segue:

- Documentazione della gestione dei rischi (Articolo 9)

- Record di governance dei dati (Articolo 10) che spiegano come i dataset sono stati utilizzati per valutare il bias

- Un piano di monitoraggio post-mercato (Articolo 72)

- Istruzioni che delineano i livelli di robustezza e i limiti [1]

Tutta la documentazione tecnica deve essere conservata per 10 anni dopo che il prodotto entra sul mercato. Il mancato rispetto può comportare sanzioni fino a €15 milioni o il 3% del fatturato annuale globale [13].

Valutazioni di Conformità e Marcatura CE

Una volta completato il file tecnico, il passo successivo è provare la conformità attraverso una valutazione di conformità. La maggior parte dei sistemi di IA ad alto rischio possono essere auto-valutati secondo il processo di Controllo Interno delineato nell'Allegato VI [15]. Tuttavia, i sistemi utilizzati in aree sensibili come biometria, infrastrutture critiche o applicazione della legge richiedono una valutazione esterna da parte di un organismo notificato. Questi valutatori di terze parti sono autorizzati a rivedere la tua documentazione e assicurare la conformità [14].

Gli organismi notificati possono richiedere ulteriori prove o condurre test indipendenti se ritengono che i tuoi test di robustezza siano insufficienti [14]. Verificheranno che le misure come ridondanza, piani di backup e meccanismi di failsafe siano documentati e implementati [1]. Per i sistemi di IA che continuano ad apprendere post-distribuzione, verificheranno anche i salvaguardi contro i cicli di feedback che potrebbero introdurre bias nei dati di addestramento futuri [1].

| Tipo di Valutazione | Chi la Conduce | Quando Richiesto | Certificato Emesso |

|---|---|---|---|

| Controllo Interno (Allegato VI) | Fornitore (auto-valutazione) | La maggior parte dei sistemi ad alto rischio (Allegato III, punti 2-8) | Dichiarazione UE di Conformità |

| Organismo Notificato (Allegato VII/VIII) | Valutatore di terze parti | Biometria, infrastrutture critiche, applicazione della legge | Certificato di valutazione della documentazione tecnica unionale |

Dato che le valutazioni da parte di organismi notificati possono richiedere 6-18 mesi, i fornitori di sistemi critici per la sicurezza o biometrici dovrebbero avviare il processo ben prima della scadenza di agosto 2026 [16]. Sii pronto a fornire l'accesso ai dataset di addestramento, validazione e test tramite API o altri mezzi tecnici se richiesto [14].

Dopo aver completato con successo la valutazione, devi emettere una Dichiarazione UE di Conformità e applicare la marcatura CE al tuo sistema o alla sua documentazione [15]. Questa marcatura serve come prova legale che il tuo sistema soddisfa gli standard di robustezza. Se vengono apportate modifiche significative - come modifiche che influenzano la conformità o lo scopo previsto del sistema - dovrai aggiornare la documentazione e possibilmente sottoporsi a una nuova valutazione di conformità [13].

"La documentazione tecnica deve essere elaborata in modo da dimostrare che il sistema di IA ad alto rischio sia conforme ai requisiti [...] e fornire alle autorità competenti nazionali e agli organismi notificati le informazioni necessarie in forma chiara e completa per valutare la conformità."

- Articolo 11, Regolamento (UE) 2024/1689 [13]

Le valutazioni di conformità, abbinate al monitoraggio continuo, formano un quadro di conformità completo, garantendo che i sistemi di IA ad alto rischio soddisfino gli standard di robustezza durante l'intero loro ciclo di vita.

Robustezza vs. Cybersecurity: Differenze Chiave

Analizziamo come l'EU AI Act differenzia la robustezza dalla cybersecurity - due concetti che potrebbero sembrare simili ma servono scopi molto diversi.

La distinzione risiede nell'intento. La robustezza, come delineata nell'Articolo 15[1], si occupa di interruzioni non intenzionali. Questi potrebbero includere errori naturali, guasti o incongruenze che si verificano durante il funzionamento regolare del sistema. D'altra parte, la cybersecurity, coperta nell'Articolo 15[3], si concentra su attacchi intenzionali e maligni. Questo include scenari in cui terze parti non autorizzate tentano attivamente di manipolare o compromettere le prestazioni del sistema. Mentre le sezioni precedenti hanno coperto come testare la robustezza, questa parte evidenzia la divisione tra la resilienza interna e le minacce esterne.

In termini tecnici, la robustezza nell'apprendimento automatico si riferisce alla resilienza non avversariale. Ciò comporta il testing della capacità di un sistema di IA di gestire sfide come spostamenti di distribuzione, cambiamenti ambientali o cicli di feedback - in cui gli output del modello influenzano i dati di addestramento futuri. La cybersecurity, tuttavia, si concentra sulla resilienza avversariale, proteggendo contro minacce come avvelenamento dei dati, attacchi di evasione o anche violazioni che compromettono la confidenzialità del modello, come il furto.

Henrik Nolte dell'Università di Tubinga spiega questa divisione chiaramente:

"L'AIA divide artificialmente il concetto di cybersecurity della CSA designando le cause non intenzionali come una questione di robustezza e limitando la cybersecurity alle azioni intenzionali."

Per la conformità, sia la robustezza che la cybersecurity richiedono strategie diverse. Le organizzazioni possono addestrare assistenti di conformità dell'IA per gestire queste complessità. La robustezza si affida a misure come la ridondanza tecnica e il monitoraggio continuo per garantire che i sistemi possano gestire interruzioni non intenzionali. La cybersecurity, nel frattempo, richiede difese attive come il rilevamento delle minacce, la crittografia e l'addestramento avversariale per contrastare gli attacchi deliberati. Mantenere entrambi durante il ciclo di vita di un sistema di IA comporta la valutazione di ogni componente individualmente per garantire una protezione completa.

Conclusione e Punti Chiave

Concludiamo evidenziando i passaggi essenziali per garantire che i tuoi sistemi di IA siano affidabili e conformi alle normative imminenti.

Il test di robustezza è una pietra angolare per garantire che i sistemi di IA ad alto rischio funzionino in modo coerente in condizioni pratiche. Con l'applicazione dei requisiti dell'Allegato III fissata al 2 agosto 2026 [8], le organizzazioni devono agire ora per stabilire i benchmark di prestazione, integrare i meccanismi di ridondanza e implementare il monitoraggio continuo durante l'intero ciclo di vita dell'IA.

Il concetto di robustezza è altamente dipendente dal contesto. Dovrai definire le metriche di prestazione che si allineano con lo scopo specifico del tuo sistema e anticipare le interruzioni come la deriva dei dati, i cambiamenti ambientali o i cicli di feedback. I protocolli di test dovrebbero essere personalizzati per il caso d'uso unico, le proprietà dei dati e l'ambiente di distribuzione di ogni sistema di IA.

Inizia stabilendo chiari baseline di prestazione in condizioni normali. Quindi, testa metodicamente come il tuo sistema risponde a varie sfide o interruzioni. Incorpora misure di ridondanza - come sistemi di backup e meccanismi di failsafe - e assicurati che i meccanismi di supervisione umana siano in atto per intervenire quando si verificano anomalie. Inoltre, i tuoi sistemi di logging dovrebbero supportare la conformità fornendo audit trail a prova di manomissione e solo-append.

Secondo l'Articolo 11, i fornitori sono principalmente responsabili della conduzione delle valutazioni di conformità e della preparazione della documentazione tecnica, mentre i distributori devono gestire la supervisione umana e mantenere le pratiche robuste di conservazione dei log. Entrambi i ruoli condividono la responsabilità di mantenere la robustezza del sistema durante l'intero ciclo di vita del sistema di IA.

Semplificare la Conformità con ISMS Copilot

Strumenti avanzati di conformità come ISMS Copilot possono semplificare questi passaggi critici.

ISMS Copilot è progettato per assistere con la conformità all'EU AI Act analizzando la tua documentazione tecnica e valutazioni di impatto esistenti per identificare i gap nei requisiti di robustezza. La piattaforma aiuta a redigere la documentazione tecnica dettagliata dell'Articolo 11 che i regolatori esamineranno, coprendo tutto dalle descrizioni del sistema ai protocolli di monitoraggio.

Per le attività normative relative all'EU AI Act, la piattaforma sfrutta i modelli Mistral, che sono specificamente addestrati sui regolamenti europei. Questi modelli forniscono approfondimenti dettagliati sui requisiti dell'Atto. Puoi creare spazi di lavoro individuali per ogni sistema di IA, assicurando chiari audit trail e sforzi di conformità organizzati. Quando utilizzi la piattaforma, includi dettagli come il caso d'uso del tuo sistema, i tipi di dati e la classificazione del rischio per ricevere una guida personalizzata che si allinea alle tue esigenze di conformità.

Una funzionalità in primo piano di ISMS Copilot è il suo strumento di analisi dei gap, che è particolarmente utile per il test di robustezza. Caricando le tue attuali valutazioni del rischio e i protocolli di test, la piattaforma identifica i componenti mancanti e offre un piano di rimedio prioritizzato. Questo aiuta ad allocare le risorse in modo efficiente e affrontare i gap di conformità critica prima della scadenza di agosto 2026.

Domande Frequenti

::: faq

Come faccio a sapere se il mio sistema di IA è "ad alto rischio" secondo l'EU AI Act?

Secondo l'EU AI Act, il tuo sistema di IA è considerato "ad alto rischio" se soddisfa uno dei due criteri:

- Funziona come componente di sicurezza di un prodotto regolato dalle leggi dell'UE elencate nell'Allegato I.

- Viene applicato in scenari ad alto rischio identificati nell'Allegato III, come valutazioni del credito, processi di reclutamento o identificazione biometrica.

Queste classificazioni svolgono un ruolo chiave nel definire gli obblighi di conformità per il tuo sistema. :::

::: faq

Quali test di robustezza dovrei eseguire prima di immettere un sistema di IA ad alto rischio sul mercato dell'UE?

Prima di lanciare un sistema di IA ad alto rischio nell'UE, è essenziale eseguire test di robustezza per allinearsi all'EU AI Act. Questi test si concentrano su tre aree chiave: accuratezza, cybersecurity e mitigazione del bias. L'obiettivo è garantire che il sistema possa gestire efficacemente le sfide di prestazione. Queste valutazioni non riguardano solo la conformità - sono cruciali per costruire un sistema che funzioni in modo affidabile in varie condizioni. :::

::: faq

Quali prove si aspettano i regolatori nel file tecnico dell'Articolo 11 per la robustezza?

I regolatori impongono che il file tecnico dell'Articolo 11 includa la documentazione tecnica approfondita che si allinea agli standard dell'Allegato IV. Questa documentazione deve affrontare nove sezioni obbligatorie che dettagliano il design, lo sviluppo e il ciclo di vita del sistema di IA. È cruciale che questo file sia completato prima che il sistema arrivi sul mercato e rimanga aggiornato durante l'intero suo ciclo di vita. :::

Articoli correlati

Mappatura Incrociata di Framework: NIST, ISO 27001, SOC2

Utilizza NIST CSF per costruire controlli unificati che mappano ISO 27001 e SOC 2, riducendo lo sforzo di audit e i costi di conformità.

NIS2 e ISO 27001: Guida alla Visualizzazione delle Sovrapposizioni

Mostra come ISO 27001 copre il 70–80% di NIS2 e evidenzia i gap come la segnalazione rigorosa degli incidenti e la responsabilità del management.

EU AI Act: Requisiti di Trasparenza Spiegati

Panoramica della trasparenza dell'EU AI Act: regole di divulgazione per chatbot e contenuti AI, standard di documentazione, tempistiche e sanzioni.