AI Generico vs AI Domain-Specific per la Conformità

Confronta AI generico vs domain-specific per la conformità: accuratezza, residenza dei dati, prontezza agli audit e riduzione del rischio di audit.

AI Generico vs AI Domain-Specific per la Conformità

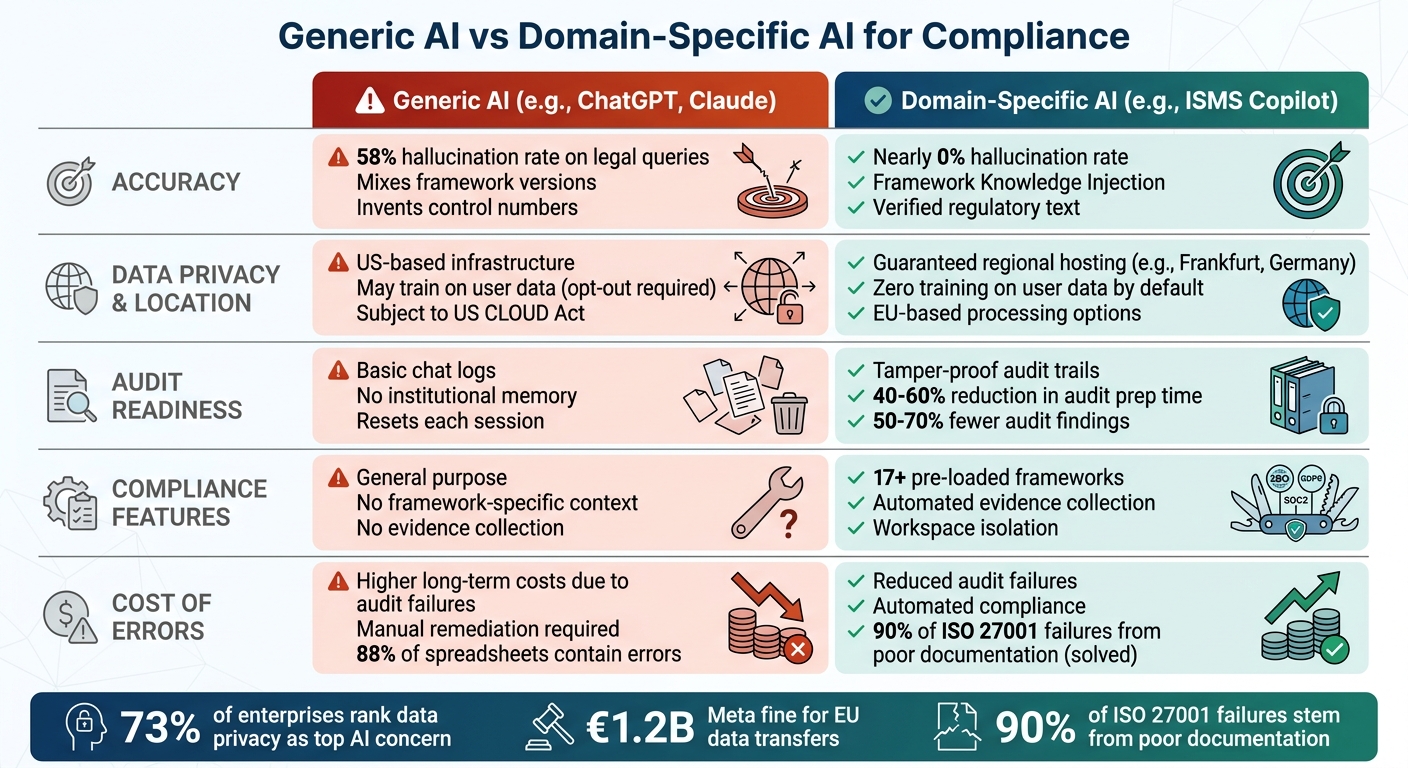

Quando si tratta di compiti di conformità, la scelta dello strumento AI giusto può determinare il successo o il fallimento dei tuoi sforzi. Dovresti usare uno strumento AI generico come ChatGPT, oppure optare per una piattaforma AI domain-specific? Ecco il nocciolo della questione:

- Gli strumenti AI generici sono versatili ma spesso mancano della precisione richiesta per la conformità. Si basano su dataset ampi, portando a imprecisioni (ad es., un tasso di allucinazione del 58% per query legali). Inoltre, presentano rischi come violazioni della privacy dei dati a causa dell'elaborazione basata negli USA.

- Gli strumenti AI domain-specific, come ISMS Copilot, sono personalizzati per il lavoro di conformità. Utilizzano dati normativi verificati, garantiscono la residenza dei dati (ad es., server basati nell'UE) e includono funzionalità come audit trail e accuratezza specifica del framework.

Differenze Chiave:

- Accuratezza: L'AI domain-specific minimizza gli errori radicando le risposte in standard verificati, a differenza dell'AI generico, che può generare informazioni fabbricate o obsolete.

- Privacy dei Dati: Le piattaforme domain-specific danno priorità all'archiviazione regionale e alla sovranità dei dati. L'AI generico elabora spesso i dati negli USA, creando rischi di conformità GDPR e transfrontalieri.

- Prontezza agli Audit: Gli strumenti domain-specific forniscono documentazione strutturata, a prova di manomissione e raccolta continua di prove – qualcosa che l'AI generico non possiede.

Conclusione Rapida: Se la conformità è critica per la tua organizzazione, l'AI domain-specific è la scelta più sicura e affidabile.

::: @figure  {AI Generico vs AI Domain-Specific per la Conformità: Differenze Chiave}

:::

{AI Generico vs AI Domain-Specific per la Conformità: Differenze Chiave}

:::

Sicurezza dell'AI e Rischio: Confronto Fianco a Fianco dei Framework di Conformità e Rischio dell'AI

::: @iframe https://www.youtube.com/embed/wkEEK8Wp2WM :::

Perché l'AI Generico Non è all'Altezza per la Conformità alla Sicurezza

Gli strumenti AI generici, sebbene eccellenti per la produttività generale, faticano quando si tratta della precisione e dell'affidabilità necessarie per il lavoro di conformità regolamentata. Questi modelli generano testo prevedendo la parola successiva più probabile piuttosto che attingendo da fatti verificati [8]. Ciò può portare a risultati che suonano convincenti ma sono fattualmente scorretti – un rischio importante nella conformità, dove l'accuratezza è non negoziabile. Analizziamo i problemi chiave.

Output Inesatti e Allucinazioni

Gli studi rivelano che fino al 46% del testo generato da AI contiene allucinazioni. Se testato con domande legali specifiche, GPT-4 è risultato allucinare almeno il 58% delle volte [4][9]. Per i professionisti della conformità, questo livello di imprecisione è inaccettabile. Le conseguenze possono essere gravi:

- Un avvocato degli USA è stato sanzionato dopo aver presentato citazioni di casi fittizie prodotte da ChatGPT.

- Air Canada ha dovuto onorare una politica di "biglietto per lutto" fittizia creata dal suo chatbot AI [4].

L'AI generico inoltre fatica a distinguere tra standard normativi obsoleti e attuali, creando pericolosi divari di conformità. Ad esempio, potrebbe confondere i requisiti di ISO 27001:2013 e ISO 27001:2022, inventare numeri di controllo che non esistono, oppure affermare erroneamente che ISO 27001 richieda un audit SOC 2 Type II.

J.P. Roe, uno scrittore professionista, lo ha sintetizzato bene:

"L'AI non comprende il contesto – tipo, per niente... Personalmente non lo userei per nulla che abbia un carico legale a meno che non avessi un esperto di conformità che venga dopo per correggere gli errori" [10].

La ricerca mostra che il 90% dei fallimenti di ISO 27001 derivano da una scarsa gestione della documentazione e dall'incapacità di provare l'esistenza dei controlli [4]. L'AI generico non ha la capacità di generare le prove verificabili necessarie per soddisfare questi standard. E oltre all'accuratezza, i problemi relativi alla privacy dei dati espongono ulteriormente le sue limitazioni.

Problemi di Privacy dei Dati e Localizzazione

Gli strumenti AI generici presentano anche rischi significativi per la privacy dei dati e i trasferimenti di dati transfrontalieri. Anche quando i provider affermano di archiviare i dati all'interno dell'UE o del Regno Unito, il passaggio di inferenza (dove le GPU elaborano l'input) spesso avviene negli Stati Uniti [6]. Ciò crea sfide di conformità per le organizzazioni vincolate dal Capitolo V del GDPR e dalla decisione Schrems II.

Geoff Davies di PivotalEdge ha spiegato:

"La residenza è più forte per i dati memorizzati. Se hai bisogno di un'elaborazione esclusivamente nel Regno Unito per tutto, verifica come OpenAI gestisce l'inferenza... perché non tutti i flussi di lavoro possono garantire un'elaborazione esclusivamente nel Regno Unito" [6].

Questo è particolarmente preoccupante perché i provider AI basati negli USA sono soggetti alle leggi sulla sorveglianza americana, che possono entrare in conflitto con gli standard europei di protezione dei dati. I rischi sono reali: nell'aprile 2023, gli ingegneri di Samsung hanno accidentalmente perso codice sorgente proprietario e note di riunioni interne in ChatGPT mentre lo utilizzavano per sintesi e debug – tre incidenti separati in soli 20 giorni. In risposta, Samsung ha implementato un divieto a livello aziendale su AI generativa per uso interno [4].

Mancanza di Conoscenze Specializzate di Conformità

Gli strumenti AI generici sono carenti anche quando si tratta di comprendere framework di conformità specifici o l'ambiente di controllo unico dell'organizzazione, la storia dell'audit o il profilo di rischio. Mentre questi strumenti possono redigere policy, non possono produrre la documentazione oggettiva, con timestamp e a prova di manomissione che i revisori richiedono. Come ha affermato Humadroid:

"I revisori non valutano se i tuoi controlli suonano bene. Valutano se i tuoi controlli hanno operato dimostrabilmente durante un intero periodo di audit" [4].

Un altro problema comune: l'AI generico spesso confonde i requisiti legali con le best practice. Ad esempio, potrebbe affermare erroneamente che la crittografia AES-256 è un obbligo legale quando le normative richiedono semplicemente "misure di sicurezza appropriate" basate su una valutazione del rischio. Questa prescrizione eccessiva può portare a costi e sforzi non necessari.

Questi divari evidenziano la necessità del miglior assistente AI per ISO 27001 che fornisca contesto persistente e specifico del framework e possa adattarsi alle sfumature del lavoro di conformità – qualcosa che l'AI generico semplicemente non è costruito per gestire.

Come l'AI Domain-Specific Affronta le Esigenze di Conformità

L'AI domain-specific si basa su dati normativi verificati piuttosto che su schemi internet imprevedibili. Questo approccio garantisce che le risposte siano radicate in conoscenze strutturate e curate – essenziale quando la precisione è non negoziabile. Ecco come affronta le sfide chiave di conformità.

Framework Normativi Pre-Caricati

A differenza dell'AI per scopi generali, gli strumenti domain-specific sono dotati di framework normativi pre-caricati per garantire l'accuratezza. Ad esempio, ISMS Copilot utilizza un sistema chiamato "Dynamic Framework Knowledge Injection", che elimina le supposizioni. Menziona uno standard come ISO 27001 o SOC 2 e il sistema lo identifica immediatamente utilizzando pattern matching. Quindi carica i controlli, le clausole e i requisiti pertinenti nel suo contesto prima di generare una risposta. Questo processo, che richiede solo 5–15 secondi, riduce drasticamente gli errori nelle query specifiche del framework [11][12][14].

Le informazioni provengono da database curati verificati da ingegneri di Governance, Risk and Compliance (GRC) rispetto agli standard ufficiali [12][13]. Attualmente, ISMS Copilot supporta 17 framework, inclusi ISO 27001:2022, ISO 42001:2023, SOC 2, HIPAA, GDPR, NIS 2, DORA e il Regolamento dell'UE sull'IA. Ogni risposta include citazioni specifiche di questi framework, rendendo gli output pronti per gli audit da subito [11][12][13].

Audit Trail Completi e Tracciamento delle Decisioni

L'AI generico si ripristina con ogni conversazione, ma le piattaforme domain-specific mantengono la memoria istituzionale nel tempo – qualcosa che i revisori apprezzano. Questo è particolarmente importante dato che il 90% dei fallimenti di ISO 27001 risulta da una scarsa documentazione piuttosto che da controlli tecnici mancanti [4].

ISMS Copilot offre funzionalità come tracciamento delle modifiche, workspace separati per diversi progetti o client e PII Reduction Mode, che redatta automaticamente le informazioni personali come nomi, email e numeri di telefono prima dell'elaborazione. Gli utenti possono anche configurare periodi di conservazione dei dati, da appena 1 giorno fino a 7 anni, per allinearsi alle policy normative o interne [13].

Controllo della Localizzazione dei Dati e Flessibilità della Distribuzione

Per le organizzazioni vincolate da strict regole di sovranità dei dati, l'AI domain-specific garantisce la conformità attraverso garanzie di hosting regionale. Ad esempio, ISMS Copilot memorizza tutti i dati a Francoforte, in Germania, e offre una modalità Advanced Data Protection che instrada le query esclusivamente attraverso provider AI basati nell'UE come Mistral AI [13][14]. Questo garantisce l'aderenza al GDPR e ad altre leggi sulla protezione dei dati.

Tutti i provider backend operano secondo accordi di Zero Data Retention (ZDR), il che significa che i prompt e gli output degli utenti non vengono mai memorizzati a lungo termine o utilizzati per l'addestramento del modello [13][14]. Per le organizzazioni con requisiti ancora più ristretti, alcune piattaforme consentono la distribuzione on-premises, in cloud privati o su infrastruttura edge, garantendo che i dati rimangono interamente sotto il controllo dell'organizzazione [15]. Questo livello di gestione dei dati aiuta le organizzazioni a soddisfare anche gli standard di conformità più rigorosi.

Privacy dei Dati e Localizzazione: La Differenza Principale

Quando si tratta di conformità, dove vengono archiviati i dati e chi può accedervi sono preoccupazioni critiche. Gli strumenti AI generici come ChatGPT spesso elaborano i dati attraverso infrastrutture basate negli USA, il che può creare problemi per le aziende soggette a normative europee, cinesi o specifiche del settore. L'AI domain-specific, d'altra parte, è progettata con la localizzazione dei dati come priorità.

La distinzione tra privacy dei dati e localizzazione è un fattore importante che separa l'AI domain-specific dalle soluzioni generiche. Infatti, il 73% delle aziende classifica la privacy e la sicurezza dei dati come loro principale preoccupazione nell'AI, e il 77% ora considera il paese di origine di un fornitore prima di prendere decisioni di acquisto [17]. Queste preoccupazioni non sono solo teoriche – i regolatori hanno agito. Ad esempio:

- Meta è stata multata di 1,2 miliardi di € nel 2023 per il trasferimento di dati degli utenti dell'UE negli Stati Uniti.

- TikTok ha affrontato una multa di 530 milioni di € nel 2025 per l'invio di dati di cittadini dell'UE a server in Cina.

- Uber ha pagato 290 milioni di € nel 2024 per lo spostamento dei record dei conducenti oltre i confini [17][19].

Questi casi sottolineano l'importanza di come l'AI domain-specific ridefinisce l'archiviazione dei dati, i controlli di elaborazione e la gestione del rischio transfrontaliero.

Conformità alle Leggi di Archiviazione Regionale dei Dati

Le piattaforme AI domain-specific affrontano con attenzione sia la residenza dei dati (dove si trovano fisicamente i server) che la sovranità dei dati (il quadro giuridico che governa tali dati). Selezionare semplicemente una "regione UE" da un provider di cloud basato negli USA non garantisce necessariamente la conformità. Come spiega Jaipal Singh:

"La giurisdizione legale segue l'azienda, non il data center" [17].

Prendi il EU AI Act Copilot come esempio. Archivia i dati a Francoforte, Germania e include una modalità Advanced Data Protection che instrada le query esclusivamente attraverso provider basati nell'UE. Tutti i provider backend operano secondo accordi Zero Data Retention (ZDR), il che significa che i prompt e gli output non vengono salvati o utilizzati per l'addestramento del modello [1]. Questo setup si allinea con i requisiti GDPR e aiuta le organizzazioni a navigare le incertezze, specialmente dopo il crollo del Quadro sulla Privacy dei Dati USA-UE (spesso chiamato "Schrems III") alla fine del 2025 [18].

Le puntate sono alte. Secondo il Regolamento dell'UE sull'IA, le sanzioni possono raggiungere il 7% del fatturato annuale globale o 35 milioni di €, e le violazioni combinate del GDPR e del Regolamento sull'IA potrebbero teoricamente arrivare all'11% del fatturato globale [18]. Nel 2026, almeno 34 paesi avevano introdotto o rafforzato leggi di localizzazione dei dati che incidono sull'elaborazione dell'AI [18].

Riduzione dei Rischi di Trasferimento Dati Transfrontaliero

Anche quando i dati vengono archiviati regionalmente, i flussi di dati transfrontalieri possono introdurre rischi di conformità aggiuntivi. Le API di AI generiche spesso creano flussi di dati nascosti attraverso percorsi secondari, come moderazione del contenuto, controlli di sicurezza o logging. Questi punti di contatto possono rientrare sotto diverse giurisdizioni legali. Inoltre, molti provider generici si riservano il diritto di utilizzare gli input dell'API per l'addestramento del modello a meno che gli utenti non rinuncino esplicitamente [18].

L'AI domain-specific riduce al minimo questi rischi con una progettazione intenzionale. Ad esempio, alcune piattaforme utilizzano un approccio "Insights Not Data", dove i dati vengono pre-elaborati localmente per rimuovere o pseudonimizzare gli identificatori personali. Solo gli insight anonimizzati vengono inviati ai modelli basati su cloud [18]. Altre offrono isolamento dei workspace, garantendo che i dati da diversi client o progetti rimangano separati [1].

Questo approccio attento offre anche risparmi di tempo e denaro. L'implementazione di residenza dei dati alimentata da AI può richiedere solo 2–3 settimane, rispetto ai 4–6 mesi con metodi manuali. I costi diminuiscono significativamente anche, da un costo stimato di $150.000–$250.000 a $40.000–$80.000. La validazione automatizzata garantisce un'accuratezza del 100%, mentre le revisioni manuali hanno un tasso di errore del 15–20% [16].

Controlli Trasparenti dell'Elaborazione e dell'Archiviazione dei Dati

Le piattaforme AI domain-specific forniscono trasparenza e controllo su ogni fase dell'elaborazione dei dati. Mentre l'AI generico spesso opera come una "scatola nera", le soluzioni domain-specific rivelano l'intera catena di elaborazione. Ad esempio, ISMS Copilot consente alle organizzazioni di configurare le impostazioni di conservazione dei dati per soddisfare sia le policy normative che interne. Include anche funzionalità per redare automaticamente le informazioni personali sensibili durante l'elaborazione. Alcune piattaforme offrono persino opzioni di distribuzione come on-premises, cloud privato o setup edge per mantenere i dati completamente sotto il controllo dell'organizzazione.

| Fattore | AI Domain-Specific (ad es., ISMS Copilot) | AI Generico (ad es., ChatGPT) |

|---|---|---|

| Localizzazione dei Dati | Garantita regionale (ad es., Francoforte, Germania) [1] | In genere infrastruttura basata negli USA [1] |

| Addestramento del Modello | Zero addestramento su dati utente per impostazione predefinita [1] | Potrebbe addestrare su input (è richiesta la rinuncia) [1] |

| Giurisdizione | Spesso non-USA o basata su sovereign cloud [17] | Soggetta al CLOUD Act USA [17] |

| Isolamento dei Dati | Workspace isolati per uso multi-client [1] | Thread di conversazione semplici; rischio di crossover dei dati [1] |

Come ha affermato Prem AI:

"L'era del "muoversi velocemente e figure out compliance dopo" è finita per l'AI" [19].

Le organizzazioni che danno priorità alla localizzazione dei dati e alla conformità da subito – non come ripensamento – sono meglio attrezzate per superare gli audit ed evitare sanzioni. Questa solida base per il controllo dei dati impatta direttamente le prestazioni, che la sezione successiva esplora attraverso le metriche di accuratezza e la prontezza agli audit.

Confronto delle Prestazioni: AI Generico vs AI Domain-Specific

Quando si tratta di compiti di conformità, i divari di prestazioni tra AI generico e soluzioni domain-specific sono difficili da ignorare. Mentre i modelli di AI generico come ChatGPT, Claude e Gemini sono ottimi per compiti generali, spesso non sono all'altezza in aree che richiedono precisione, audit trail dettagliati e documentazione solida. D'altra parte, le piattaforme domain-specific, come ISMS Copilot, sono specificamente progettate per affrontare direttamente queste sfide.

Accuratezza del Rilevamento dei Gap di Conformità

I modelli di AI generico basano le loro previsioni su dataset ampi, il che spesso porta a problemi di accuratezza nel lavoro di conformità. Uno studio Stanford del 2024 ha rivelato che GPT-4 "allucinava" – o generava informazioni scorrette – il 58% delle volte quando rispondeva a domande legali verificabili [4]. Questi errori includono:

- Invenzione di numeri di controllo.

- Confusione tra versioni di framework.

- Fornitura di mandati eccessivamente rigidi o inesatti.

L'AI domain-specific affronta questi problemi attraverso un metodo chiamato Framework Knowledge Injection, che garantisce che le risposte siano radicate nel testo normativo verificato. Ad esempio, ISMS Copilot v2.5 utilizza questo approccio per eliminare praticamente i requisiti fabbricati su più di 50 framework normativi [1][2].

| Fattore di Accuratezza | AI Domain-Specific (ad es., ISMS Copilot) | AI Generico (ad es., ChatGPT, Claude) |

|---|---|---|

| Tasso di Allucinazione | Praticamente eliminato per query di framework [1][2] | 58–88% su query domain-specific [4] |

| Versione del Framework | Distinzioni chiare (ad es., ISO 27001:2013 vs. 2022) [1] | Frequentemente mescola versioni [4] |

| Accuratezza del Controllo | Basata su testo normativo verificato [1][2] | Soggetta a inventare o parafrasare male i controlli [4] |

| Memoria Istituzionale | Mantiene gli ambienti di controllo organizzativo nel tempo [4] | Si ripristina con ogni sessione, manca di persistenza [4] |

Queste discrepanze evidenziano l'importanza dell'accuratezza e della documentazione corretta, che sono essenziali per la conformità e la prontezza agli audit.

Record di Audit e Documentazione delle Decisioni

La preparazione all'audit è un'altra area in cui l'AI domain-specific brilla. Come ha affermato Humadroid:

"I revisori non valutano se i tuoi controlli suonano bene. Valutano se i tuoi controlli hanno operato dimostrabilmente durante un intero periodo di audit." [4]

L'AI generico in genere genera semplici log di chat, che offrono scarso valore come prova di audit. Al contrario, le piattaforme domain-specific forniscono log di audit resistenti alla manomissione e raccolta automatica di prove attraverso integrazioni con strumenti come AWS e GitHub. Questo non solo rafforza la prontezza agli audit, ma riduce drasticamente il tempo di preparazione e riduce i risultati dell'audit [3][4].

Ecco l'impatto in numeri:

- Le aziende che utilizzano piattaforme di conformità automatizzate riportano una riduzione del 40–60% nel tempo di preparazione all'audit.

- Vedono anche 50–70% meno risultati di audit nel loro primo audit esterno [4].

Inoltre, la gestione della conformità manuale spesso porta a errori costosi, con l'88% dei fogli di calcolo che contiene errori e il 90% dei fallimenti di ISO 27001 che derivano da una scarsa documentazione piuttosto che da controlli tecnici mancanti [4].

Applicazioni Specifiche del Settore

I vantaggi dell'AI domain-specific vanno oltre l'accuratezza e gli audit trail, specialmente nei settori regolamentati. Ad esempio:

- ISO 27001: Le piattaforme specializzate automatizzano il mapping per il set di controlli 2022, mentre l'AI generico spesso fa riferimento a controlli obsoleti del 2013 o persino inesistenti [4].

- GDPR: Gli strumenti domain-specific offrono analisi dettagliate dei gap e residenza dei dati nell'UE, mentre l'AI generico si basa su infrastrutture basate negli USA e fornisce solo consigli superficiali [1][4].

- SOC 2: Piattaforme come ISMS Copilot consentono la raccolta continua di prove tramite integrazioni API, provando il funzionamento del controllo nel tempo – qualcosa che l'AI generico non può realizzare [4].

Nel settore sanitario, le puntate sono ancora più alte. I modelli di AI generici, in particolare le versioni gratuite o di livello inferiore, comportano un rischio significativo di perdita di informazioni sanitarie protette (PHI) ai dataset di addestramento [4]. Gli strumenti domain-specific riducono al minimo questo rischio incorporando conoscenze specifiche del settore sanitario e garantendo zero addestramento su dati utente per impostazione predefinita [1][4]. Come avverte ISACA:

"I team GRC devono fare attenzione a condividere dati proprietari dell'azienda con modelli AI." [4]

Considerazioni sui Costi

A prima vista, l'AI generico potrebbe sembrare l'opzione più economica. Ad esempio, ChatGPT Plus costa $20 al mese. Tuttavia, la mancanza di accuratezza specifica del framework e di audit trail affidabili spesso porta a costi più elevati nel lungo termine a causa di fallimenti degli audit, sforzi di correzione e aumento della documentazione manuale. Comparativamente, ISMS Copilot offre piani a partire da $24/mese, con tier Pro e Business a $100/mese e $250/mese, rispettivamente [1]. Per le organizzazioni che danno priorità alla conformità, il costo aggiunto dell'AI domain-specific può risparmiare tempo, sforzi e risorse significativi.

Conclusione: Selezione dell'AI Giusta per la Conformità alla Sicurezza

Punti Principali

Quando si decide tra AI generico e AI domain-specific per compiti di conformità, le considerazioni chiave sono accuratezza, controllo dei dati e prontezza agli audit. Mentre strumenti come ChatGPT e Claude si comportano bene per compiti generali, non sono all'altezza in applicazioni specifiche della conformità. I loro elevati tassi di allucinazione possono rappresentare rischi significativi di conformità e non fornire gli audit trail solidi necessari per i requisiti normativi [4].

Al contrario, strumenti domain-specific come ISMS Copilot sfruttano Framework Knowledge Injection per fornire risposte verificate e focalizzate sulla normativa [1][2]. Questi strumenti garantiscono rigorose garanzie di residenza dei dati (ad es., Francoforte, Germania per la conformità GDPR), predefinito zero addestramento su dati utente, isolamento dei workspace per scenari multi-client e audit trail a prova di manomissione con raccolta automatica di prove. Queste funzionalità sono critiche per la preparazione all'audit, inclusi i [passaggi essenziali per la certificazione ISO 27001], con gli utenti che riportano una riduzione del 40–60% nel tempo di preparazione all'audit e 50–70% meno risultati di audit [4].

Queste differenze sottolineano l'importanza di selezionare uno strumento personalizzato per soddisfare le esigenze di conformità rigorose.

Come Scegliere la Soluzione Giusta

Per prendere una decisione consapevole, considera i seguenti passaggi:

-

Valuta i Requisiti di Sovranità dei Dati: Se la tua organizzazione elabora dati di cittadini dell'UE o opera in settori altamente regolamentati come sanità o finanza, conferma che lo strumento AI rispetti i requisiti giurisdizionali per l'elaborazione e l'archiviazione dei dati [1][7]. I sistemi di AI generico spesso elaborano i dati negli Stati Uniti, anche se l'archiviazione avviene altrove [5].

-

Valuta l'Accuratezza del Framework: Assicurati che lo strumento possa differenziare tra versioni di standard (ad es., ISO 27001:2013 vs. ISO 27001:2022) ed evitare errori come numeri di controllo fabbricati [4][7]. Le piattaforme che utilizzano Retrieval-Augmented Generation con citazioni appropriate sono più affidabili [20].

-

Dai Priorità alle Capacità di Prova di Audit: Come enfatizza Humadroid:

"I revisori non valutano se i tuoi controlli suonano bene. Valutano se i tuoi controlli hanno operato dimostrabilmente durante un intero periodo di audit" [4].

Ricerca strumenti che si integrano perfettamente con il tuo stack tecnico (ad es., AWS, GitHub, HRIS) per consentire il monitoraggio continuo e la documentazione strutturata invece di generare semplicemente testo conversazionale.

Per le organizzazioni focalizzate sulla conformità, spendere 80 $ aggiuntivi al mese per uno strumento specializzato può portare a risparmi significativi nei costi di correzione dell'audit e nei costi del personale [1][4].

FAQ

::: faq

Quando l'AI generico è "abbastanza buono" per il lavoro di conformità?

L'AI generico tende a funzionare adeguatamente per compiti di conformità che sono a basso rischio, routine e non richiedono competenze specializzate o rigorose protocollazioni di privacy dei dati. Tuttavia, quando si tratta di compiti che richiedono precisione specifica del dominio, spesso non è all'altezza. Problemi come imprecisioni o "allucinazioni" possono emergere, rendendo inaffidabile per scenari di conformità ad alto rischio in cui l'accuratezza e la fiducia sono non negoziabili. :::

::: faq

Come posso verificare che le risposte di un AI sulla conformità non allucinino?

Quando utilizzi l'AI per compiti legati alla conformità, è cruciale verificare le sue risposte rispetto agli standard ufficiali. Questo aiuta a garantire che le informazioni fornite siano affidabili e si allineino con le linee guida stabilite.

Ecco alcune strategie per migliorare l'accuratezza:

- Richiedi Citazioni: Chiedi sempre all'AI di fornire fonti per le sue risposte. Questo ti consente di tracciare le informazioni indietro a riferimenti affidabili.

- Incoraggia la Trasparenza: Chiedi all'AI di riconoscere l'incertezza se non è sicura di una risposta. Questo può aiutare a prevenire una fiducia eccessiva in risposte potenzialmente inesatte.

- Semplifica Query Complesse: Suddividi le tue domande in parti più piccole e gestibili. Questo riduce il rischio di malinteso o errori nella risposta.

Inoltre, strumenti come ISMS Copilot possono essere preziosi. Questo strumento integra conoscenze verificate per ridurre le imprecisioni, spesso chiamate allucinazioni, e migliora l'affidabilità degli output correlati alla conformità. :::

::: faq

Quali domande dovrei porre ai fornitori su residenza dei dati e localizzazione dell'elaborazione?

Quando stai considerando fornitori di strumenti AI come ISMS Copilot, è importante chiedere circa dove vengono archiviati ed elaborati i tuoi dati. Assicurati che le loro pratiche si allineino alle normative della tua regione e agli standard di privacy della tua organizzazione. Se sei in un settore altamente regolamentato, verifica se il fornitore offre opzioni di localizzazione dei dati o sovranità dei dati. Inoltre, conferma la loro conformità a framework come GDPR o altre leggi locali rilevanti. In questo modo, puoi garantire che i tuoi dati rimangono sicuri e soddisfano tutti i requisiti legali necessari. :::

Articoli correlati

Mappatura Incrociata di Framework: NIST, ISO 27001, SOC2

Utilizza NIST CSF per costruire controlli unificati che mappano ISO 27001 e SOC 2, riducendo lo sforzo di audit e i costi di conformità.

NIS2 e ISO 27001: Guida alla Visualizzazione delle Sovrapposizioni

Mostra come ISO 27001 copre il 70–80% di NIS2 e evidenzia i gap come la segnalazione rigorosa degli incidenti e la responsabilità del management.

EU AI Act: Requisiti di Trasparenza Spiegati

Panoramica della trasparenza dell'EU AI Act: regole di divulgazione per chatbot e contenuti AI, standard di documentazione, tempistiche e sanzioni.