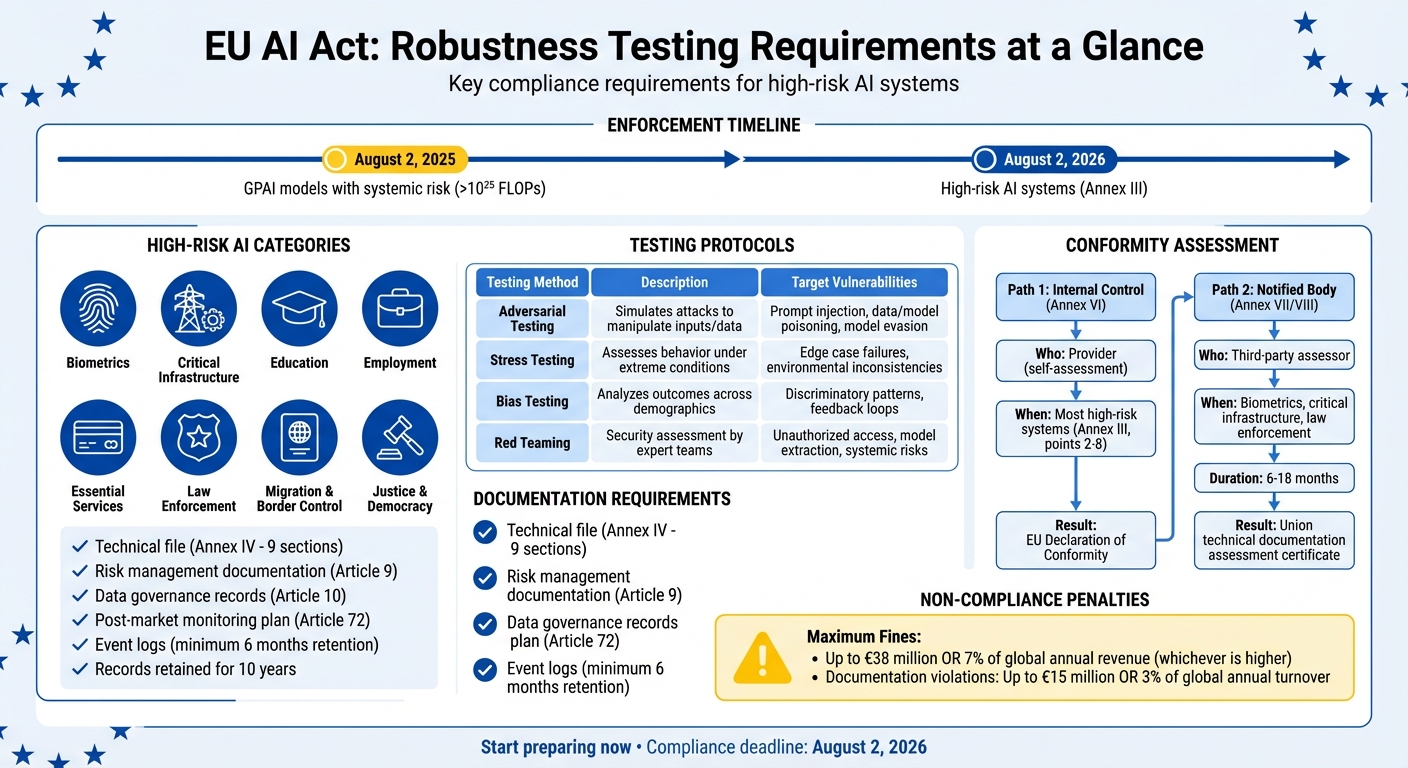

EU KI-Gesetz: Anforderungen an Robustheitstests erklärt

Erklärt die Anforderungen von Artikel 15 an Robustheitstests für Hochrisiko-KI: Tests, Dokumentation, Überwachung und Compliance-Zeitpläne.

EU KI-Gesetz: Anforderungen an Robustheitstests erklärt

Das EU KI-Gesetz schreibt vor, dass Hochrisiko-KI-Systeme strenge Robustheitstests durchlaufen müssen, um eine zuverlässige Leistung unter Fehlern, Störungen oder unerwarteten Bedingungen zu gewährleisten. Diese Anforderung, detailliert in Artikel 15, gilt für Systeme in kritischen Sektoren wie Gesundheitswesen, Verkehrswesen und Strafverfolgung. Hier ist, was Sie wissen müssen:

- Definition von Robustheit: Die Fähigkeit von KI-Systemen, eine konsistente Leistung trotz Störungen aufrechtzuerhalten, wie in ISO/IEC 25059:2023 beschrieben.

- Hochrisiko-KI-Systeme: Umfasst KI in Biometrie, kritischer Infrastruktur, Bildung, Beschäftigung und mehr, wie in Anhang III aufgeführt. Die Durchsetzung beginnt am 2. August 2026.

- Testprotokolle: Beinhaltet adversarische Tests, Stresstests und Red-Teaming, um Schwachstellen zu identifizieren.

- Dokumentation: Anbieter müssen detaillierte technische Unterlagen erstellen, Konformitätsbewertungen durchführen und Aufzeichnungen 10 Jahre lang aufbewahren.

- Überwachung nach der Bereitstellung: Kontinuierliche Leistungsüberwachung und Schutz vor schädlichen Feedback-Schleifen sind erforderlich.

Die Nichteinhaltung der EU-KI-Gesetz-Compliance-Checkliste kann zu Strafen von bis zu 38 Millionen Euro oder 7 % des weltweiten Jahresumsatzes führen. Beginnen Sie jetzt mit der Vorbereitung, um diese Anforderungen vor dem Durchsetzungstermin zu erfüllen.

::: @figure  {EU KI-Gesetz: Anforderungen an Robustheitstests und Compliance-Zeitplan}

:::

{EU KI-Gesetz: Anforderungen an Robustheitstests und Compliance-Zeitplan}

:::

Hochrisiko-KI-Systeme und Anwendbarkeit

Was gilt als Hochrisiko-KI-System?

Das EU KI-Gesetz definiert Hochrisiko-KI-Systeme über zwei Hauptansätze. Zum einen umfasst es KI-Systeme, die als Sicherheitskomponenten in Produkten gelten, die von EU-Harmonisierungsgesetzen geregelt werden (in Anhang I aufgeführt). Beispiele hierfür sind Maschinen, Medizinprodukte und Automobil-Systeme, bei deren Ausfall Gesundheits- oder Sicherheitsrisiken entstehen könnten [7]. Zum anderen deckt es Systeme ab, die in Anhang III aufgeführt sind und acht Bereiche umfassen, die grundlegende Rechte beeinträchtigen könnten [7][8].

Diese acht Kategorien in Anhang III sind:

- Biometrie: Systeme wie Fernidentifikation und Emotionserkennung.

- Kritische Infrastruktur: Tools zur Verwaltung des Straßenverkehrs oder Versorgungsunternehmen (z. B. Wasser, Gas, Strom).

- Bildung: KI, die bei Zulassungsentscheidungen oder Prüfungsüberwachung eingesetzt wird.

- Beschäftigung: Anwendungen wie Lebenslaufscreening, Beförderungsentscheidungen und Mitarbeiterüberwachung.

- Essenzielle Dienstleistungen: Systeme für Bonitätsbewertungen oder Versicherungstarifierung.

- Strafverfolgung: Tools wie Polygraphen oder Modelle zur Rückfallprognose.

- Migration und Grenzkontrolle: KI, die bei der Visumverarbeitung eingesetzt wird.

- Justiz und Demokratie: Systeme, die zur Unterstützung von Justizbehörden entwickelt wurden [7][8].

Nicht alle Systeme in diesen Kategorien gelten automatisch als Hochrisiko. Artikel 6 sieht Ausnahmen vor, wenn ein System eng definierte Aufgaben erfüllt oder menschlich geleitete Aktivitäten unterstützt, ohne Entscheidungen maßgeblich zu beeinflussen – sofern kein Profiling beteiligt ist. Um diese Ausnahme geltend zu machen, müssen Organisationen ihre Bewertung mit einem Policy-Assistenten dokumentieren und das System vor der Markteinführung in der EU-Datenbank registrieren [8]. Wenn ein KI-System jedoch innerhalb eines Anhang-III-Bereichs Profiling durchführt, bleibt es als Hochrisiko klassifiziert [8].

Für alle Hochrisiko-Systeme schreibt Artikel 15 Robustheitstests vor, um eine zuverlässige Leistung während ihres gesamten Lebenszyklus zu gewährleisten [4]. Die Durchsetzung dieser Anforderungen für Anhang-III-Systeme beginnt am 2. August 2026 [8].

Dieser Klassifizierungsrahmen untermauert die strengen Robustheitsstandards, die das EU KI-Gesetz vorschreibt.

Allgemeine KI-Modelle und systemisches Risiko

Das Gesetz behandelt auch allgemeine KI-Modelle (General-Purpose AI, GPAI), die nicht von Natur aus Hochrisiko sind. Wenn diese Modelle jedoch in Hochrisiko-Systeme integriert werden – etwa die Verwendung eines großen Sprachmodells im Recruiting oder in der kritischen Infrastruktur – müssen sie den Hochrisiko-Standards entsprechen [9][8]. Zusätzlich unterliegen GPAI-Modelle, die als „systemisches Risiko“ eingestuft werden, spezifischen Robustheitsanforderungen, einschließlich adversarischer Tests [9].

Um als systemisches Risiko zu gelten, muss die kumulative Rechenleistung des Modells während des Trainings 10^25 FLOPs überschreiten [9]. Wie andere Hochrisiko-Systeme müssen auch diese Modelle detaillierte Bewertungen und adversarische Tests durchlaufen, um Schwachstellen zu erkennen [6]. Die Regeln für GPAI-Modelle treten am 2. August 2025 in Kraft, ein Jahr früher als die breiteren Anforderungen für Hochrisiko-Systeme [9].

Technische und organisatorische Maßnahmen für Robustheit

Aufbau technischer Resilienz

Artikel 15 des EU KI-Gesetzes betont die Bedeutung von Resilienz in Hochrisiko-KI-Systemen, um sicherzustellen, dass sie Betriebsstörungen standhalten können. Diese Systeme müssen Fehler, Störungen oder Inkonsistenzen in ihrer Umgebung bewältigen können, selbst bei Hardwareausfällen, korrumpierten Eingaben oder unerwartetem Nutzerverhalten [1].

Ein zentraler Ansatz zur Erreichung von Resilienz ist die technische Redundanz. Beispielsweise kann die Containerisierung Systemoperationen isolieren und die Zuverlässigkeit auch bei Infrastrukturproblemen aufrechterhalten [2]. In kritischen Umgebungen bietet das Design für graceful Degradation – bei dem das System auf manuelle Operationen oder Backups umschaltet, anstatt vollständig herunterzufahren – eine zusätzliche Zuverlässigkeitsebene.

KI-spezifische Schwachstellen erfordern ebenfalls Aufmerksamkeit. Bedrohungen wie Data Poisoning (Manipulation von Trainingsdaten), Model Poisoning (Einbettung von schädlichem Code während des Trainings) und adversarische Beispiele (Eingaben, die darauf abzielen, die KI zu täuschen) erfordern starke Abwehrmechanismen [2]. Das MITRE ATLAS-Framework bietet Tools zur Prüfung und Minderung dieser Risiken [2]. Darüber hinaus können automatisierte Überwachungs- und Alarmsysteme Leistungsprobleme oder Verfügbarkeitsprobleme in Echtzeit erkennen. Spezialisierte Tools wie ISMS Copilot One können helfen, diese komplexen Compliance-Workflows zu automatisieren.

Für KI-Systeme, die nach der Bereitstellung weiterlernen, stellen Feedback-Schleifen einzigartige Herausforderungen dar. Wenn verzerrte Ausgaben in nachfolgende Trainingsdaten einfließen, können sich diese Verzerrungen verstärken. Um dies zu verhindern, sind Maßnahmen wie selektive Datenkuratierung und die Begrenzung der Integration von Echtzeit-Feedback entscheidend [1]. Die Ereignisprotokollierung, wie in Artikel 12 gefordert, hilft dabei, Leistungsänderungen zu verfolgen und potenzielle Probleme zu erkennen [8].

Diese technischen Schutzmaßnahmen arbeiten mit organisatorischen Maßnahmen zusammen, um sicherzustellen, dass Systeme fair und unverzerrt bleiben.

Verzerrungen und Fairness begegnen

Die Minderung von Verzerrungen ist nicht nur eine ethische Verantwortung, sondern auch eine rechtliche Verpflichtung gemäß dem Gesetz. Hochrisiko-KI-Systeme müssen in allen demografischen Gruppen fair arbeiten, insbesondere in sensiblen Bereichen wie Beschäftigung, Bildung oder Zugang zu essenziellen Dienstleistungen [8].

Regelmäßige Fairness-Audits sind entscheidend. Wenn beispielsweise ein Lebenslauf-Screening-Tool vielfältige Karrierewege oder Bildungswege nicht berücksichtigt, könnte dies bestimmte Gruppen benachteiligen. Solche Verstöße könnten zu Strafen von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes führen [10].

Die menschliche Aufsicht, wie in Artikel 14 vorgeschrieben, ist ein weiterer kritischer Bestandteil. Menschen müssen die Grenzen des Systems verstehen, Blindes Vertrauen in dessen Ausgaben vermeiden (Automationsverzerrung) und bei Bedarf eingreifen [8]. Ein effektiver Ansatz ist ein nur beratendes Design, bei dem KI-Ausgaben von Menschen überprüft werden, bevor Maßnahmen ergriffen werden.

Um Verzerrungen systematisch zu bekämpfen, sollte ein Qualitätsmanagementsystem (QMS) gemäß Artikel 17 eingerichtet werden. Dies sollte schriftliche Richtlinien zur Identifizierung und Korrektur von Verzerrungen sowie ein kontinuierliches Risikomanagement während des gesamten Lebenszyklus des KI-Systems umfassen. Die Überwachung nach der Markteinführung ist entscheidend, um die reale Leistung zu bewerten, während automatisierte Protokolle – die mindestens sechs Monate lang aufbewahrt werden – eine Datenspur für Audits und Vorfallsuntersuchungen schaffen [8].

Tests und Validierung für Robustheit

Robustheitstest-Protokolle

Um sicherzustellen, dass KI-Systeme bereit für die Bereitstellung sind, schreibt das EU KI-Gesetz strenge Tests vor der Bereitstellung vor, insbesondere für Hochrisiko-Systeme. Diese Tests sollen die Resilienz gegen Fehler, Störungen und potenzielle Angriffe bestätigen [1].

Adversarische Tests sind eine zentrale Anforderung für allgemeine KI-Systeme mit systemischem Risiko sowie für Hochrisiko-Systeme. Dieser Ansatz umfasst die Simulation von Angriffen wie Prompt-Injection, Data Poisoning und Model Evasion, um zu bewerten, wie gut das System solchen Bedrohungen standhalten kann [10][11]. Eine weitere kritische Methode ist Red Teaming, bei dem interne oder externe Experten aktiv versuchen, das System zu brechen, um eine umfassende Sicherheitsevaluierung zu ermöglichen [10].

Stresstests bewerten, wie Systeme mit extremen oder ungewöhnlichen Szenarien umgehen, wie Randfällen oder absichtlichen Fehlerinjektionen, um sicherzustellen, dass Ausfälle kontrolliert und vorhersehbar erfolgen [10][11].

| Testmethode | Beschreibung | Zielvulnerabilitäten |

|---|---|---|

| Adversarische Tests | Simuliert Angriffe, um Eingaben oder Trainingsdaten zu manipulieren | Prompt-Injection, Data/Model Poisoning, Model Evasion [10][3] |

| Stresstests | Bewertet das Verhalten unter extremen oder ungewöhnlichen Bedingungen | Randfall-Ausfälle, Umweltinkonsistenzen [11][8] |

| Verzerrungstests | Analysiert Ergebnisse über demografische Gruppen hinweg | Diskriminierende Muster, Feedback-Schleifen [11] |

| Red Teaming | Sicherheitsbewertung durch interne oder externe Teams | Unbefugter Zugriff, Model-Extraktion, systemische Risiken [10] |

Um Verzerrungen in den Ausgaben zu minimieren, müssen Testdatensätze sorgfältig kuratiert werden, um relevant, repräsentativ und möglichst fehlerfrei zu sein [1][11]. Darüber hinaus müssen Anbieter in ihren Benutzeranweisungen spezifische Genauigkeits- und Resilienzbenchmarks angeben, die mit den EU-Kommissionsstandards übereinstimmen [1][3].

"Qualitätssicherung ist kein optionaler Schritt – sie ist die Grundlage für regulatorische Compliance. Organisationen müssen nachweisen, dass ihre KI-Systeme sicher, fair und zuverlässig sind, bevor sie auf den EU-Markt gelangen können."

Sobald diese Protokolle vor der Bereitstellung abgeschlossen sind, stellt die kontinuierliche Überwachung sicher, dass die Systeme auch nach der Bereitstellung robust bleiben.

Kontinuierliche Überwachung nach der Bereitstellung

Tests enden nicht, wenn ein KI-System bereitgestellt wird. Gemäß Artikel 72 müssen Anbieter Post-Market-Überwachungssysteme implementieren, die kontinuierlich Leistungsdaten während des gesamten Lebenszyklus des Systems sammeln, dokumentieren und analysieren [4][12]. Dies stellt sicher, dass das System sich an sich entwickelnde reale Bedingungen anpasst und gleichzeitig seine Integrität bewahrt.

Hochrisiko-KI-Systeme müssen Ereignisse mindestens sechs Monate lang protokollieren. Diese Protokolle helfen dabei, die Leistung zu verfolgen, potenzielle Risiken zu identifizieren und bedeutende Änderungen zu dokumentieren [6][8][12]. Tools wie Anomalieerkennung können unerwartete Dataverschiebungen oder Störungen erkennen, die die Robustheit des Systems untergraben könnten [2][5].

Für Systeme, die kontinuierlich lernen, müssen Schutzmechanismen vorhanden sein, um Feedback-Schleifen zu verhindern, bei denen verzerrte Ausgaben zukünftige Trainingsdaten beeinflussen könnten [4][2][1]. Überwachungstools verfolgen die Verschlechterung der Leistung im Laufe der Zeit, während die Containerisierung stabile und reproduzierbare Umgebungen für die Systemausführung gewährleistet [2].

Sowohl Anbieter als auch Nutzer sind verpflichtet, Vorfälle zu melden [6][12]. Zusätzlich ermöglichen Mechanismen der menschlichen Aufsicht, wie z. B. „Stop-Button“-Verfahren, sofortiges Eingreifen, falls Probleme auftreten [8].

"Das EU KI-Gesetz verlangt kontinuierliche Überwachung nach der Bereitstellung, nicht nur einmalige Tests. Hochrisiko-KI-Systeme benötigen automatisierte Protokollierung und Incident-Response, die von Anfang an eingebaut sind."

- Oleg Sivograkov, VP of IT Operations, TestFort [11]

Der Durchsetzungstermin für diese Anforderungen ist der 2. August 2026 [8]. Die Nichteinhaltung kann zu schweren Strafen führen, einschließlich Geldstrafen von bis zu 38 Millionen Euro oder 7 % des weltweiten Jahresumsatzes [10].

Teil 2: Das EU KI-Gesetz meistern: Wesentliche Compliance-Schritte für Hochrisiko-KI-Systeme

::: @iframe https://www.youtube.com/embed/wsr6d6WG5Uo :::

Dokumentation und Compliance-Berichterstattung

Nach strengen Tests und kontinuierlicher Überwachung ist eine ordnungsgemäße Dokumentation entscheidend, um die Einhaltung der Vorschriften sicherzustellen.

Standards für technische Dokumentation

Bevor ein Produkt auf den Markt gebracht wird, muss eine technische Datei erstellt werden, die den Anforderungen von Anhang IV entspricht. Diese Datei sollte klar die Einhaltung der Robustheitsanforderungen von Artikel 15 demonstrieren [13]. Die Datei muss neun Abschnitte umfassen, wobei Abschnitt 4 sich speziell auf Leistungsmetriken konzentriert. Hier sollten Robustheitstestergebnisse, Validierungsmethoden und die Begründung für die gewählten Metriken detailliert beschrieben werden [13].

Die Erstellung dieser Dokumentation kann zwischen 40 und 80 Stunden in Anspruch nehmen, sofern Compliance-Daten bereits in den Entwicklungsprozess integriert wurden, z. B. mit einem KI-Implementierungsassistenten [13]. Tools wie MLflow können diesen Prozess vereinfachen, indem sie Protokolle, Audit-Trails und Designentscheidungen direkt in Ihren Workflow erfassen.

Ihre technische Datei sollte zudem Folgendes enthalten:

- Risikomanagement-Dokumentation (Artikel 9)

- Aufzeichnungen zur Datenverwaltung (Artikel 10), die erklären, wie Datensätze zur Bewertung von Verzerrungen verwendet wurden

- Einen Plan zur Überwachung nach der Markteinführung (Artikel 72)

- Anweisungen, die Robustheitsniveaus und -grenzen beschreiben [1]

Alle technischen Unterlagen müssen 10 Jahre nach Markteinführung des Produkts aufbewahrt werden. Die Nichteinhaltung kann zu Strafen von bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes führen [13].

Konformitätsbewertungen und CE-Kennzeichnung

Sobald die technische Datei vollständig ist, folgt der nächste Schritt: der Nachweis der Compliance durch eine Konformitätsbewertung. Die meisten Hochrisiko-KI-Systeme können im Rahmen des in Anhang VI beschriebenen internen Kontrollverfahrens selbst bewertet werden [15]. Systeme, die jedoch in sensiblen Bereichen wie Biometrie, kritischer Infrastruktur oder Strafverfolgung eingesetzt werden, erfordern eine externe Bewertung durch eine benannte Stelle. Diese Drittanbieter prüfen Ihre Dokumentation und stellen die Compliance sicher [14].

Benannte Stellen können zusätzliche Nachweise anfordern oder unabhängige Tests durchführen, wenn sie die Robustheitstests für unzureichend halten [14]. Sie überprüfen, ob Maßnahmen wie Redundanz, Backup-Pläne und Fail-Safes dokumentiert und umgesetzt wurden [1]. Bei KI-Systemen, die nach der Bereitstellung weiterlernen, prüfen sie auch Schutzmechanismen gegen Feedback-Schleifen, die Verzerrungen in zukünftige Trainingsdaten einführen könnten [1].

| Bewertungstyp | Wer führt sie durch | Wann erforderlich | Zertifikat ausgestellt |

|---|---|---|---|

| Interne Kontrolle (Anhang VI) | Anbieter (Selbstbewertung) | Die meisten Hochrisiko-Systeme (Anhang III, Punkte 2–8) | EU-Konformitätserklärung |

| Benannte Stelle (Anhang VII/VIII) | Drittanbieter-Bewerter | Biometrie, kritische Infrastruktur, Strafverfolgung | Zertifikat zur technischen Dokumentationsbewertung der Union |

Da Bewertungen durch benannte Stellen 6–18 Monate dauern können, sollten Anbieter von sicherheitskritischen oder biometrischen Systemen den Prozess lange vor dem Stichtag am 2. August 2026 einleiten [16]. Seien Sie darauf vorbereitet, Zugriff auf Trainings-, Validierungs- und Testdatensätze über API oder andere technische Mittel bereitzustellen, falls angefordert [14].

Nach erfolgreicher Bewertung müssen Sie eine EU-Konformitätserklärung ausstellen und die CE-Kennzeichnung an Ihrem System oder dessen Dokumentation anbringen [15]. Diese Kennzeichnung dient als rechtlicher Nachweis, dass Ihr System den Robustheitsstandards entspricht. Falls wesentliche Änderungen vorgenommen werden – wie Modifikationen, die die Compliance oder den vorgesehenen Zweck des Systems beeinflussen – müssen Sie die Dokumentation aktualisieren und möglicherweise eine neue Konformitätsbewertung durchführen [13].

"Die technische Dokumentation muss so erstellt werden, dass sie nachweist, dass das Hochrisiko-KI-System die Anforderungen [...] erfüllt und den nationalen zuständigen Behörden und benannten Stellen die notwendigen Informationen in klarer und umfassender Form zur Bewertung der Compliance zur Verfügung stellt."

- Artikel 11, Verordnung (EU) 2024/1689 [13]

Konformitätsbewertungen in Kombination mit kontinuierlicher Überwachung bilden einen vollständigen Compliance-Rahmen, der sicherstellt, dass Hochrisiko-KI-Systeme während ihres gesamten Lebenszyklus den Robustheitsstandards entsprechen.

Robustheit vs. Cybersicherheit: Wesentliche Unterschiede

Lassen Sie uns aufschlüsseln, wie das EU KI-Gesetz Robustheit von Cybersicherheit unterscheidet – zwei Konzepte, die zwar ähnlich erscheinen, aber sehr unterschiedliche Zwecke erfüllen.

Der Unterschied liegt im Ziel. Robustheit, wie in Artikel 15 beschrieben [1], befasst sich mit unbeabsichtigten Störungen. Dazu gehören natürliche Fehler, Störungen oder Inkonsistenzen, die während des normalen Systembetriebs auftreten. Cybersicherheit hingegen, wie in Artikel 15 behandelt [3], konzentriert sich auf vorsätzliche, böswillige Angriffe. Dazu gehören Szenarien, in denen unbefugte Dritte aktiv versuchen, die Systemleistung zu manipulieren oder zu kompromittieren. Während frühere Abschnitte die Tests zur Robustheit abdeckten, hebt dieser Teil die Trennung zwischen interner Resilienz und externen Bedrohungen hervor.

Technisch gesehen bezieht sich Robustheit im maschinellen Lernen auf nicht-adversarische Resilienz. Dabei wird die Fähigkeit eines KI-Systems getestet, Herausforderungen wie Verteilungsverschiebungen, Umweltveränderungen oder Feedback-Schleifen zu bewältigen – bei denen Modellausgaben zukünftige Trainingsdaten beeinflussen. Cybersicherheit hingegen konzentriert sich auf adversarische Resilienz, den Schutz vor Bedrohungen wie Data Poisoning, Evasion-Angriffen oder sogar Verletzungen der Modellvertraulichkeit, wie etwa Diebstahl.

Henrik Nolte von der Universität Tübingen erklärt diese Trennung klar:

"Das KI-Gesetz teilt das Konzept der Cybersicherheit durch Design künstlich auf, indem es unbeabsichtigte Ursachen als Frage der Robustheit bezeichnet und Cybersicherheit auf vorsätzliche Handlungen beschränkt."

Für die Compliance erfordern sowohl Robustheit als auch Cybersicherheit unterschiedliche Strategien. Organisationen können KI-Compliance-Assistenten schulen, um diese Komplexitäten zu bewältigen. Robustheit basiert auf Maßnahmen wie technischer Redundanz und kontinuierlicher Überwachung, um sicherzustellen, dass Systeme unbeabsichtigte Störungen bewältigen können. Cybersicherheit hingegen erfordert aktive Abwehrmechanismen wie Bedrohungserkennung, Verschlüsselung und adversarisches Training, um gezielte Angriffe abzuwehren. Die Aufrechterhaltung beider Aspekte während des gesamten Lebenszyklus eines KI-Systems erfordert die Bewertung jeder einzelnen Komponente, um einen umfassenden Schutz zu gewährleisten.

Fazit und wichtige Erkenntnisse

Lassen Sie uns die wesentlichen Schritte zusammenfassen, um sicherzustellen, dass Ihre KI-Systeme zuverlässig und konform mit den kommenden Vorschriften sind.

Robustheitstests sind ein Grundpfeiler, um sicherzustellen, dass Hochrisiko-KI-Systeme unter praktischen Bedingungen konsistent funktionieren. Mit der Durchsetzung der Anforderungen von Anhang III ab dem 2. August 2026 [8] müssen Organisationen jetzt handeln, um Leistungsbenchmarks festzulegen, Redundanzmechanismen zu integrieren und während des gesamten KI-Lebenszyklus eine kontinuierliche Überwachung zu implementieren.

Das Konzept der Robustheit ist stark kontextabhängig. Sie müssen Leistungsmetriken definieren, die auf den spezifischen Zweck Ihres Systems abgestimmt sind, und Störungen wie Datenverschiebungen, Umweltveränderungen oder Feedback-Schleifen antizipieren. Testprotokolle sollten auf den einzigartigen Anwendungsfall, die Dateneigenschaften und die Bereitstellungsumgebung jedes KI-Systems zugeschnitten sein.

Beginnen Sie damit, klare Leistungsbaselines unter normalen Bedingungen festzulegen. Testen Sie dann systematisch, wie Ihr System auf verschiedene Herausforderungen oder Störungen reagiert. Integrieren Sie Redundanzmaßnahmen – wie Backupsysteme und Fail-Safes – und stellen Sie sicher, dass Mechanismen der menschlichen Aufsicht vorhanden sind, um bei Anomalien einzugreifen. Darüber hinaus sollten Ihre Protokollierungssysteme die Compliance unterstützen, indem sie manipulationssichere, nur anhängbare Audit-Trails bereitstellen.

Gemäß Artikel 11 sind Anbieter in erster Linie für die Durchführung von Konformitätsbewertungen und die Erstellung technischer Dokumentation verantwortlich, während Nutzer die menschliche Aufsicht verwalten und robuste Protokollaufbewahrungspraktiken einhalten müssen. Beide Rollen teilen sich die Verantwortung für die Aufrechterhaltung der Systemrobustheit während des gesamten Lebenszyklus des KI-Systems.

Compliance mit ISMS Copilot vereinfachen

Fortgeschrittene Compliance-Tools wie ISMS Copilot können diese kritischen Schritte vereinfachen.

ISMS Copilot unterstützt bei der Einhaltung des EU KI-Gesetzes, indem es Ihre bestehende technische Dokumentation und Risikobewertungen analysiert, um Lücken in den Robustheitsanforderungen zu identifizieren. Die Plattform hilft bei der Erstellung der detaillierten technischen Dokumentation nach Artikel 11, die von Regulierungsbehörden geprüft wird, und deckt alles von Systembeschreibungen bis zu Überwachungsprotokollen ab.

Für regulatorische Aufgaben im Zusammenhang mit dem EU KI-Gesetz nutzt die Plattform Mistral-Modelle, die speziell auf europäische Vorschriften trainiert wurden. Diese Modelle bieten detaillierte Einblicke in die Anforderungen des Gesetzes. Sie können individuelle Arbeitsbereiche für jedes KI-System erstellen, um klare Audit-Trails und organisierte Compliance-Bemühungen zu gewährleisten. Wenn Sie die Plattform nutzen, geben Sie Details wie den Anwendungsfall Ihres Systems, Datentypen und Risikoklassifizierung ein, um maßgeschneiderte Anleitungen zu erhalten, die auf Ihre Compliance-Bedürfnisse abgestimmt sind.

Ein herausragendes Merkmal von ISMS Copilot ist das **

Verwandte Beiträge

Generische KI vs. domänenspezifische KI für Compliance

Vergleich von generischer vs. domänenspezifischer KI für Compliance: Genauigkeit, Datenresidenz, Auditbereitschaft und reduziertes Auditrisiko.

Wie KI regulatorische Änderungen verfolgt

Erklärt, wie KI NLP, ML und Echtzeit-Benachrichtigungen nutzt, um regulatorische Aktualisierungen zu überwachen, Auswirkungen auf Kontrollen abzubilden und den Compliance-Aufwand zu reduzieren.

ISO 27001 Risikobewertung mit KI: Checkliste für Startups

Nutze KI, um ISO 27001-Risikobewertungen für Startups zu beschleunigen – Scope, Asset-Inventar, Bewertung, Kontrollzuordnung und kontinuierliches Monitoring.