Generische KI vs. domänenspezifische KI für Compliance

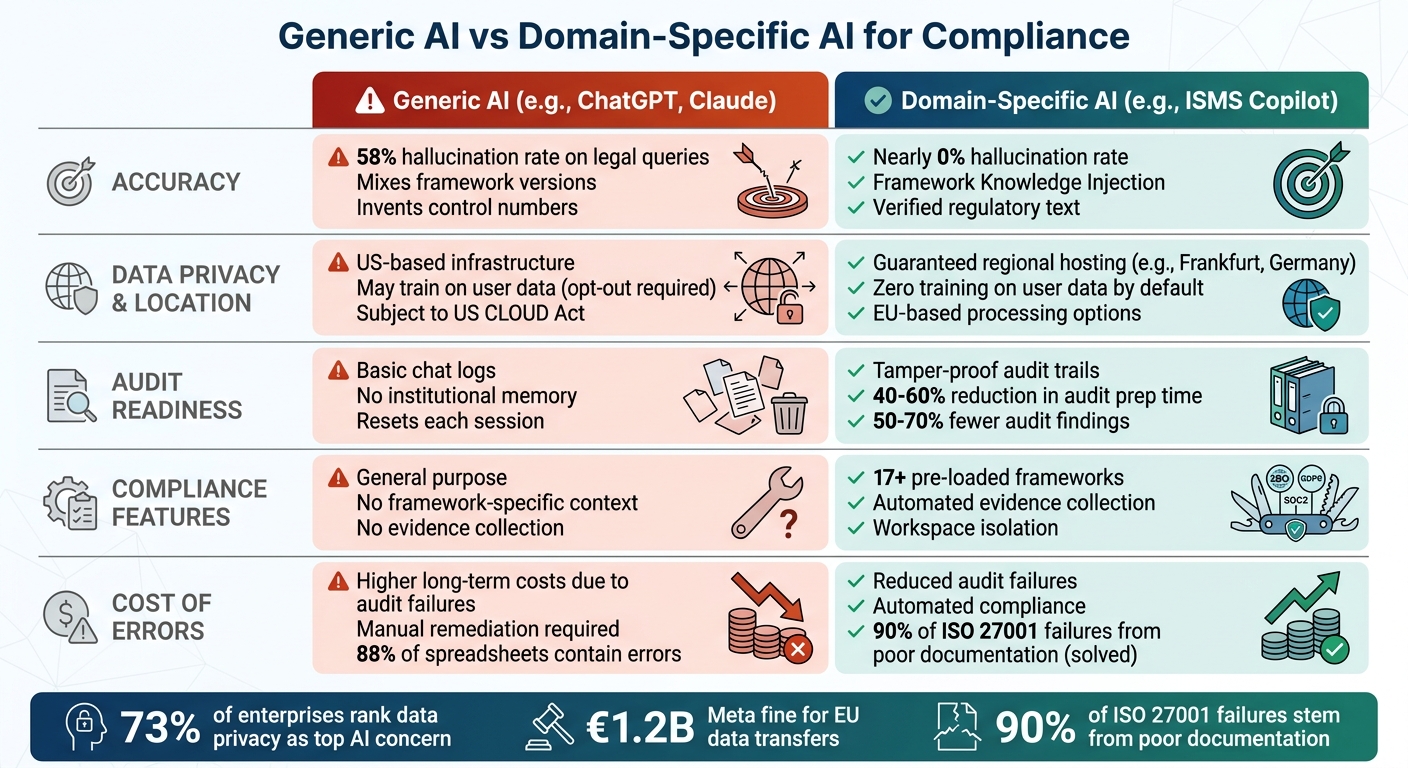

Vergleich von generischer vs. domänenspezifischer KI für Compliance: Genauigkeit, Datenresidenz, Auditbereitschaft und reduziertes Auditrisiko.

Generische KI vs. domänenspezifische KI für Compliance

Bei Compliance-Aufgaben kann die Wahl des richtigen KI-Tools über Erfolg oder Misserfolg entscheiden. Sollten Sie ein generisches KI-Tool wie ChatGPT verwenden oder eine domänenspezifische KI-Plattform bevorzugen? Hier die wichtigsten Punkte:

- Generische KI-Tools sind vielseitig, aber oft nicht präzise genug für Compliance-Anforderungen. Sie basieren auf breiten Datensätzen, was zu Ungenauigkeiten führen kann (z. B. eine Halluzinationsrate von 58 % bei rechtlichen Anfragen). Zudem bergen sie Risiken wie Datenschutzverletzungen durch die Verarbeitung in den USA.

- Domänenspezifische KI-Tools, wie ISMS Copilot, sind speziell für Compliance-Arbeit konzipiert. Sie nutzen verifizierte regulatorische Daten, stellen die Datenresidenz sicher (z. B. durch EU-basierte Server) und bieten Funktionen wie Prüfpfade und frameworkspezifische Genauigkeit.

Wesentliche Unterschiede:

- Genauigkeit: Domänenspezifische KI minimiert Fehler, indem sie Antworten auf verifizierten Standards basiert, während generische KI möglicherweise fabrizierte oder veraltete Informationen generiert.

- Datenschutz: Domänenspezifische Plattformen priorisieren regionale Datenspeicherung und -hoheit. Generische KI verarbeitet Daten häufig in den USA, was GDPR- und grenzüberschreitende Compliance-Risiken birgt.

- Auditbereitschaft: Domänenspezifische Tools liefern strukturierte, manipulationssichere Dokumentation und kontinuierliche Beweissammlung – etwas, das generische KI nicht bietet.

Schnelle Zusammenfassung: Wenn Compliance für Ihre Organisation kritisch ist, ist domänenspezifische KI die sicherere und zuverlässigere Wahl.

::: @figure  {Generische KI vs. domänenspezifische KI für Compliance: Wesentliche Unterschiede}

:::

{Generische KI vs. domänenspezifische KI für Compliance: Wesentliche Unterschiede}

:::

KI-Sicherheit und Risiko: Gegenüberstellung von KI-Compliance- und Risikorahmenwerken

::: @iframe https://www.youtube.com/embed/wkEEK8Wp2WM :::

Warum generische KI bei Compliance für Sicherheit versagt

Generische KI-Tools sind zwar hervorragend für allgemeine Produktivitätsaufgaben geeignet, stoßen jedoch an ihre Grenzen, wenn es um die für regulierte Compliance-Arbeit erforderliche Präzision und Zuverlässigkeit geht. Diese Modelle generieren Text, indem sie das nächste wahrscheinlichste Wort vorhersagen, anstatt auf verifizierte Fakten zurückzugreifen [8]. Dies kann zu Ausgaben führen, die überzeugend klingen, aber faktisch falsch sind – ein großes Risiko in der Compliance, wo Genauigkeit unverhandelbar ist. Lassen Sie uns die wichtigsten Probleme aufschlüsseln.

Ungenaue Ausgaben und Halluzinationen

Studien zeigen, dass bis zu 46 % der von KI generierten Texte Halluzinationen enthalten. Bei Tests mit spezifischen Rechtsfragen wurde festgestellt, dass GPT-4 in mindestens 58 % der Fälle Halluzinationen produzierte [4][9]. Für Compliance-Experten ist dieses Maß an Ungenauigkeit inakzeptabel. Die Folgen können schwerwiegend sein:

- Ein US-Anwalt wurde sanktioniert, nachdem er fiktive Fallzitate eingereicht hatte, die von ChatGPT generiert wurden.

- Air Canada musste eine erfundene „Trauerfall-Tarifrichtlinie“ einhalten, die von seinem KI-Chatbot erstellt wurde [4].

Generische KI hat auch Schwierigkeiten, zwischen veralteten und aktuellen regulatorischen Standards zu unterscheiden, was gefährliche Compliance-Lücken schafft. Sie könnte beispielsweise die Anforderungen von ISO 27001:2013 und ISO 27001:2022 vermischen, nicht existierende Kontrollnummern erfinden oder fälschlicherweise behaupten, dass ISO 27001 ein SOC 2-Typ-II-Audit vorschreibt.

J.P. Roe, professioneller Autor, fasste es gut zusammen:

„Die KI versteht den Kontext nicht – überhaupt nicht… Ich würde sie persönlich für nichts rechtlich Belastendes verwenden, es sei denn, ein Compliance-Experte prüft die Fehler im Nachhinein.“ [10]

Forschungen zeigen, dass 90 % der ISO-27001-Ausfälle auf schlechtes Dokumentationsmanagement und die Unfähigkeit zurückzuführen sind, nachzuweisen, dass Kontrollen existieren [4]. Generische KI kann die verifizierbaren Nachweise, die für die Einhaltung dieser Standards erforderlich sind, nicht generieren. Und neben der Genauigkeit bergen Probleme im Zusammenhang mit dem Datenschutz weitere Einschränkungen.

Datenschutz- und Standortprobleme

Generische KI-Tools bergen auch erhebliche Risiken für den Datenschutz und grenzüberschreitende Datentransfers. Selbst wenn Anbieter behaupten, Daten innerhalb der EU oder des Vereinigten Königreichs zu speichern, erfolgt der Inferenzschritt (bei dem GPUs Eingaben verarbeiten) oft in den Vereinigten Staaten [6]. Dies schafft Compliance-Herausforderungen für Organisationen, die an GDPR Kapitel V und das Schrems-II-Urteil gebunden sind.

Geoff Davies von PivotalEdge erklärte:

„Die Residenz ist für gespeicherte Daten am stärksten. Wenn Sie eine strikte Verarbeitung nur im Vereinigten Königreich benötigen, prüfen Sie, wie OpenAI die Inferenz handhabt… denn nicht alle Workflows können eine Verarbeitung nur im Vereinigten Königreich garantieren.“ [6]

Dies ist besonders besorgniserregend, da US-basierte KI-Anbieter den amerikanischen Überwachungsgesetzen unterliegen, die im Konflikt mit europäischen Datenschutzstandards stehen können. Die Risiken sind real: Im April 2023 haben Samsung-Ingenieure versehentlich proprietären Quellcode und interne Meeting-Notizen in ChatGPT geleakt, während sie es zur Zusammenfassung und Fehlerbehebung nutzten – drei separate Vorfälle innerhalb von nur 20 Tagen. Als Reaktion verhängte Samsung ein unternehmensweites Verbot für generative KI für die interne Nutzung [4].

Fehlendes domänenspezifisches Compliance-Wissen

Generische KI-Tools scheitern auch daran, spezifische Compliance-Rahmenwerke oder die einzigartige Kontrollumgebung, Audit-Historie oder Risikobewertung einer Organisation zu verstehen. Während diese Tools Richtlinien entwerfen können, können sie keine objektive, zeitgestempelte, manipulationssichere Dokumentation liefern, die Prüfer verlangen. Wie Humadroid es ausdrückte:

„Prüfer bewerten nicht, ob Ihre Kontrollen gut klingen. Sie bewerten, ob Ihre Kontrollen über einen gesamten Prüfungszeitraum nachweislich funktioniert haben.“ [4]

Ein weiteres häufiges Problem: Generische KI verwechselt oft rechtliche Anforderungen mit Best Practices. Sie könnte beispielsweise fälschlicherweise behaupten, dass AES-256-Verschlüsselung eine gesetzliche Vorgabe ist, obwohl Vorschriften lediglich „angemessene Sicherheitsmaßnahmen“ basierend auf einer Risikobewertung verlangen. Diese Übervorgabe kann zu unnötigen Kosten und Aufwand führen.

Diese Lücken unterstreichen die Notwendigkeit für den besten KI-Assistenten für ISO 27001, der persistenten, frameworkspezifischen Kontext bietet und sich an die Nuancen der Compliance-Arbeit anpassen kann – etwas, wofür generische KI einfach nicht konzipiert ist.

Wie domänenspezifische KI Compliance-Anforderungen erfüllt

Domänenspezifische KI verlässt sich auf verifizierte regulatorische Daten statt auf unvorhersehbare Internetmuster. Dieser Ansatz stellt sicher, dass Antworten auf strukturiertem, kuratiertem Wissen basieren – essenziell, wenn Genauigkeit unverhandelbar ist. Hier ist, wie sie zentrale Compliance-Herausforderungen angeht.

Vorab geladene regulatorische Rahmenwerke

Im Gegensatz zu Allzweck-KI sind domänenspezifische Tools mit vorab geladenen regulatorischen Rahmenwerken ausgestattet, um die Genauigkeit zu gewährleisten. ISMS Copilot nutzt beispielsweise ein System namens „Dynamische Framework-Wissensinjektion“, das Spekulationen ausschließt. Erwähnen Sie einen Standard wie ISO 27001 oder SOC 2, und das System identifiziert ihn sofort mithilfe von Mustervergleichen. Anschließend lädt es die relevanten Kontrollen, Klauseln und Anforderungen in seinen Kontext, bevor eine Antwort generiert wird. Dieser Prozess, der nur 5–15 Sekunden dauert, reduziert Fehler bei frameworkspezifischen Abfragen drastisch [11][12][14].

Die Informationen stammen aus kuratierten Datenbanken, die von Governance-, Risiko- und Compliance-Ingenieuren (GRC) gegen offizielle Standards verifiziert wurden [12][13]. Derzeit unterstützt ISMS Copilot 17 Rahmenwerke, darunter ISO 27001:2022, ISO 42001:2023, SOC 2, HIPAA, GDPR, NIS 2, DORA und den EU AI Act. Jede Antwort enthält spezifische Zitate zu diesen Rahmenwerken, sodass die Ausgaben von Anfang an auditbereit sind [11][12][13].

Vollständige Prüfpfade und Entscheidungsverfolgung

Generische KI setzt mit jeder Konversation neu an, aber domänenspezifische Plattformen behalten institutionelles Gedächtnis über die Zeit – etwas, das Prüfer schätzen. Dies ist besonders wichtig, da 90 % der ISO-27001-Ausfälle auf mangelhaftes Dokumentationsmanagement und nicht auf fehlende technische Kontrollen zurückzuführen sind [4].

ISMS Copilot bietet Funktionen wie Änderungverfolgung, separate Arbeitsbereiche für verschiedene Projekte oder Kunden und PII-Reduktionsmodus, der personenbezogene Informationen wie Namen, E-Mails und Telefonnummern vor der Verarbeitung automatisch schwärzt. Benutzer können auch Datenaufbewahrungsfristen konfigurieren, von nur 1 Tag bis zu 7 Jahren, um regulatorische oder interne Richtlinien einzuhalten [13].

Datenstandortkontrolle und Bereitstellungsflexibilität

Für Organisationen, die strengen Datensouveränitätsregeln unterliegen, stellt domänenspezifische KI die Compliance durch garantierte regionale Hosting-Optionen sicher. ISMS Copilot speichert beispielsweise alle Daten in Frankfurt, Deutschland, und bietet einen erweiterten Datenschutzmodus, der Abfragen ausschließlich über EU-basierte KI-Anbieter wie Mistral AI leitet [13][14]. Dies stellt die Einhaltung von GDPR und anderen Datenschutzgesetzen sicher.

Alle Backend-Anbieter arbeiten unter Zero-Data-Retention-(ZDR)-Vereinbarungen, was bedeutet, dass Benutzerabfragen und -ausgaben niemals langfristig gespeichert oder für das Modelltraining verwendet werden [13][14]. Für Organisationen mit noch strengeren Anforderungen ermöglichen einige Plattformen die Bereitstellung vor Ort, in privaten Clouds oder auf Edge-Infrastrukturen, sodass die Daten vollständig unter der Kontrolle der Organisation bleiben [15]. Dieses Maß an Datenmanagement hilft Organisationen, selbst die strengsten Compliance-Standards zu erfüllen.

Datenschutz und Lokalisierung: Der Hauptunterschied

Bei Compliance sind der Speicherort der Daten und wer darauf zugreifen kann, entscheidende Faktoren. Generische KI-Tools wie ChatGPT verarbeiten Daten häufig über US-basierte Infrastruktur, was für Unternehmen, die europäischen, chinesischen oder branchenspezifischen Vorschriften unterliegen, problematisch sein kann. Domänenspezifische KI hingegen ist von vornherein auf Datenlokalisierung ausgelegt.

Der Unterschied zwischen Datenschutz und Lokalisierung ist ein zentraler Faktor, der domänenspezifische KI von generischen Lösungen unterscheidet. Tatsächlich bewerten 73 % der Unternehmen Datenschutz und Sicherheit als ihre größte Sorge im Zusammenhang mit KI, und 77 % berücksichtigen den Herkunftsort eines Anbieters vor Kaufentscheidungen [17]. Diese Bedenken sind nicht nur theoretisch – Regulierungsbehörden haben bereits gehandelt. Beispiele:

- Meta wurde 2023 mit einer Strafe von 1,2 Mrd. € belegt, weil es Nutzerdaten aus der EU in die Vereinigten Staaten transferiert hatte.

- TikTok musste 2025 eine Strafe von 530 Mio. € zahlen, weil es Daten von EU-Bürgern auf Servern in China speicherte.

- Uber zahlte 2024 290 Mio. €, weil es Fahrerdaten über Grenzen hinweg transferierte [17][19].

Diese Fälle unterstreichen die Bedeutung, wie domänenspezifische KI die Datenspeicherung, Verarbeitungssteuerung und das Management grenzüberschreitender Risiken neu definiert.

Einhaltung regionaler Datenspeichergesetze

Domänenspezifische KI-Plattformen gehen sowohl auf Datenresidenz (wo sich die Server physisch befinden) als auch auf Datensouveränität (den rechtlichen Rahmen, der diese Daten regelt) sorgfältig ein. Die einfache Auswahl einer „EU-Region“ bei einem US-basierten Cloud-Anbieter stellt nicht unbedingt die Compliance sicher. Wie Jaipal Singh erklärt:

„Die Rechtshoheit folgt dem Unternehmen, nicht dem Rechenzentrum.“ [17]

Nehmen wir den EU AI Act Copilot als Beispiel. Er speichert Daten in Frankfurt, Deutschland, und umfasst einen erweiterten Datenschutzmodus, der Abfragen ausschließlich über EU-basierte Anbieter leitet. Alle Backend-Anbieter arbeiten unter Zero-Data-Retention-(ZDR)-Vereinbarungen, was bedeutet, dass Abfragen und Ausgaben nicht gespeichert oder für das Modelltraining verwendet werden [1]. Diese Einrichtung entspricht den GDPR-Anforderungen und hilft Organisationen, Unsicherheiten zu navigieren, insbesondere nach dem Zusammenbruch des EU-US-Datenschutzrahmens (oft „Schrems III“ genannt) Ende 2025 [18].

Die Einsätze sind hoch. Nach dem EU AI Act können Strafen bis zu 7 % des weltweiten Jahresumsatzes oder 35 Mio. € betragen, und kombinierte Verstöße gegen GDPR und den AI Act könnten theoretisch 11 % des weltweiten Umsatzes erreichen [18]. Bis 2026 hatten mindestens 34 Länder Gesetze zur Datenlokalisierung eingeführt oder verschärft, die die KI-Verarbeitung betreffen [18].

Reduzierung grenzüberschreitender Datentransferrisiken

Selbst wenn Daten regional gespeichert werden, können grenzüberschreitende Datenflüsse zusätzliche Compliance-Risiken bergen. Generische KI-APIs schaffen oft versteckte Datenflüsse über sekundäre Pfade, wie z. B. Inhaltsmoderation, Sicherheitsprüfungen oder Protokollierung. Diese Berührungspunkte können unterschiedlichen Rechtshoheiten unterliegen. Darüber hinaus behalten viele generische Anbieter sich das Recht vor, API-Eingaben für das Modelltraining zu verwenden, es sei denn, Benutzer entscheiden sich ausdrücklich für den Opt-out [18].

Domänenspezifische KI minimiert diese Risiken durch gezieltes Design. Einige Plattformen nutzen beispielsweise einen „Insights Not Data“-Ansatz, bei dem Daten lokal vorverarbeitet werden, um personenbezogene Identifikatoren zu entfernen oder zu pseudonymisieren. Nur anonymisierte Erkenntnisse werden an cloudbasierte Modelle gesendet [18]. Andere bieten Arbeitsbereichsisolierung, sodass Daten verschiedener Kunden oder Projekte getrennt bleiben [1].

Dieser durchdachte Ansatz spart auch Zeit und Geld. Die Implementierung KI-gestützter Datenresidenz kann nur 2–3 Wochen dauern, verglichen mit 4–6 Monaten bei manuellen Methoden. Die Kosten sinken ebenfalls deutlich, von geschätzten 150.000–250.000 $ auf 40.000–80.000 $. Automatisierte Validierung stellt eine 100-prozentige Genauigkeit sicher, während manuelle Überprüfungen eine Fehlerquote von 15–20 % aufweisen [16].

Klare Datenverarbeitungs- und Speichersteuerung

Domänenspezifische KI-Plattformen bieten Transparenz und Kontrolle über jeden Schritt der Datenverarbeitung. Während generische KI oft als „Blackbox“ fungiert, zeigen domänenspezifische Lösungen die gesamte Verarbeitungskette auf. ISMS Copilot ermöglicht es Organisationen beispielsweise, Datenaufbewahrungseinstellungen zu konfigurieren, um sowohl regulatorische als auch interne Richtlinien zu erfüllen. Es umfasst auch Funktionen, um sensible personenbezogene Informationen während der Verarbeitung automatisch zu schwärzen. Einige Plattformen bieten sogar Bereitstellungsoptionen wie vor Ort, private Cloud oder Edge-Setups, um die Daten vollständig unter der Kontrolle der Organisation zu halten.

| Faktor | Domänenspezifische KI (z. B. ISMS Copilot) | Generische KI (z. B. ChatGPT) |

|---|---|---|

| Datenstandort | Garantiert regional (z. B. Frankfurt, Deutschland) [1] | Typischerweise US-basierte Infrastruktur [1] |

| Modelltraining | Standardmäßig keine Schulung mit Benutzerdaten [1] | Kann Eingaben für das Training verwenden (Opt-out erforderlich) [1] |

| Rechtshoheit | Oft nicht-US-basiert oder souveräne Cloud [17] | Unterliegt US CLOUD Act [17] |

| Datenisolierung | Isolierte Arbeitsbereiche für die Nutzung durch mehrere Kunden [1] | Einfache Konversations-Threads; Risiko von Datendurchmischung [1] |

Wie Prem AI treffend formuliert:

„Das Zeitalter von ‚Move fast and figure out compliance later‘ ist für KI vorbei.“ [19]

Organisationen, die Datenspeicherort und Compliance von Anfang an priorisieren – nicht als Nachgedanken – sind besser darauf vorbereitet, Audits zu bestehen und Strafen zu vermeiden. Diese solide Grundlage für die Datenkontrolle wirkt sich direkt auf die Leistung aus, die im nächsten Abschnitt anhand von Genauigkeitsmetriken und Auditbereitschaft untersucht wird.

Leistungsvergleich: Generische KI vs. domänenspezifische KI

Bei Compliance-Aufgaben sind die Leistungsunterschiede zwischen generischer KI und domänenspezifischen Lösungen schwer zu ignorieren. Während generische KI-Modelle wie ChatGPT, Claude und Gemini für allgemeine Aufgaben gut geeignet sind, scheitern sie oft in Bereichen, die Präzision, detaillierte Prüfpfade und robuste Dokumentation erfordern. Domänenspezifische Plattformen wie ISMS Copilot sind dagegen speziell dafür konzipiert, diese Herausforderungen zu meistern.

Genauigkeit bei der Compliance-Lückenerkennung

Generische KI-Modelle basieren ihre Vorhersagen auf breiten Datensätzen, was häufig zu Genauigkeitsproblemen bei Compliance-Arbeit führt. Eine Studie der Stanford University aus dem Jahr 2024 ergab, dass GPT-4 in 58 % der Fälle „halluzinierte“ – oder falsche Informationen generierte – wenn es auf überprüfbare Rechtsfragen antwortete [4]. Zu diesen Fehlern gehören:

- Erfinden von Kontrollnummern.

- Vermischen von Framework-Versionen.

- Bereitstellen übermäßig starrer oder ungenauer Vorgaben.

Domänenspezifische KI begegnet diesen Problemen durch eine Methode namens Framework-Wissensinjektion, die sicherstellt, dass Antworten auf verifizierten regulatorischen Texten basieren. ISMS Copilot v2.5 nutzt diesen Ansatz beispielsweise, um erfundene Anforderungen über mehr als 50 regulatorische Rahmenwerke hinweg nahezu vollständig zu eliminieren [1][2].

| Genauigkeitsfaktor | Domänenspezifische KI (z. B. ISMS Copilot) | Generische KI (z. B. ChatGPT, Claude) |

|---|---|---|

| Halluzinationsrate | Bei Framework-Abfragen nahezu eliminiert [1][2] | 58–88 % bei domänenspezifischen Abfragen [4] |

| Framework-Version | Klare Unterscheidungen (z. B. ISO 27001:2013 vs. 2022) [1] | Vermischt häufig Versionen [4] |

| Kontrollgenauigkeit | Basierend auf verifizierten regulatorischen Texten [1][2] | Neigt dazu, Kontrollen zu erfinden oder falsch zu zitieren [4] |

| Institutionelles Gedächtnis | Behält organisatorische Kontrollumgebungen über die Zeit bei [4] | Setzt mit jeder Sitzung neu an, ohne Persistenz [4] |

Diese Diskrepanzen unterstreichen die Bedeutung von Genauigkeit und ordnungsgemäßer Dokumentation, die für Compliance und Auditbereitschaft essenziell sind.

Prüfungsprotokolle und Entscheidungsdokumentation

Die Vorbereitung auf Audits ist ein weiterer Bereich, in dem domänenspezifische KI glänzt. Wie Humadroid es ausdrückt:

„Prüfer bewerten nicht, ob Ihre Kontrollen gut klingen. Sie bewerten, ob Ihre Kontrollen über einen gesamten Prüfungszeitraum nachweislich funktioniert haben.“ [4]

Generische KI generiert typischerweise einfache Chat-Protokolle, die wenig Wert als Prüfungsnachweise bieten. Im Gegensatz dazu liefern domänenspezifische Plattformen manipulationssichere Prüfprotokolle und automatisierte Beweissammlung durch Integrationen mit Tools wie AWS und GitHub. Dies stärkt nicht nur die Auditbereitschaft, sondern reduziert auch die Vorbereitungszeit und die Anzahl der Audit-Feststellungen drastisch [3][4].

Hier die Auswirkungen in Zahlen:

- Unternehmen, die automatisierte Compliance-Plattformen nutzen, berichten von einer 40–60-prozentigen Reduzierung der Audit-Vorbereitungszeit.

- Sie verzeichnen auch 50–70 % weniger Audit-Feststellungen bei ihrem ersten externen Audit [4].

Darüber hinaus führt manuelles Compliance-Management häufig zu kostspieligen Fehlern, wobei 88 % der Tabellenkalkulationen Fehler enthalten und 90 % der ISO-27001-Ausfälle auf mangelhaftes Dokumentationsmanagement und nicht auf fehlende technische Kontrollen zurückzuführen sind [4].

Branchenspezifische Anwendungen

Die Vorteile domänenspezifischer KI gehen über Genauigkeit und Prüfpfade hinaus, insbesondere in regulierten Branchen. Beispiele:

- ISO 27001: Spezialisierte Plattformen automatisieren die Zuordnung zum Kontrollsatz 2022, während generische KI häufig veraltete 2013-Kontrollen oder sogar nicht existierende referenziert [4].

- GDPR: Domänenspezifische Tools bieten detaillierte Lückenanalysen und EU-Datenresidenz, während generische KI auf US-basierte Infrastruktur setzt und nur oberflächliche Ratschläge liefert [1][4].

- SOC 2: Plattformen wie ISMS Copilot ermöglichen die kontinuierliche Beweissammlung über API-Integrationen und belegen so den Betrieb von Kontrollen über die Zeit – etwas, das generische KI nicht leisten kann [4].

Im Gesundheitswesen sind die Einsätze noch höher. Generische KI-Modelle, insbesondere kostenlose oder niedrigere Versionen, bergen ein erhebliches Risiko, geschützte Gesundheitsinformationen (PHI) in Trainingsdatensätze zu leaken [4]. Domänenspezifische Tools mildern dies, indem sie medizinisches Fachwissen einbetten und standardmäßig keine Schulung mit Benutzerdaten durchführen [1][4]. Wie ISACA warnt:

„GRC-Teams müssen vorsichtig sein, wenn sie proprietäre Unternehmensdaten mit KI-Modellen teilen.“ [4]

Kostenüberlegungen

Auf den

Verwandte Beiträge

Wie KI regulatorische Änderungen verfolgt

Erklärt, wie KI NLP, ML und Echtzeit-Benachrichtigungen nutzt, um regulatorische Aktualisierungen zu überwachen, Auswirkungen auf Kontrollen abzubilden und den Compliance-Aufwand zu reduzieren.

EU KI-Gesetz: Anforderungen an Robustheitstests erklärt

Erklärt die Anforderungen von Artikel 15 an Robustheitstests für Hochrisiko-KI: Tests, Dokumentation, Überwachung und Compliance-Zeitpläne.

ISO 27001 Risikobewertung mit KI: Checkliste für Startups

Nutze KI, um ISO 27001-Risikobewertungen für Startups zu beschleunigen – Scope, Asset-Inventar, Bewertung, Kontrollzuordnung und kontinuierliches Monitoring.