Ustawa o AI UE: Wymagania dotyczące testów odporności wyjaśnione

Wyjaśnia wymagania Artykułu 15 dotyczące testów odporności wysokiego ryzyka AI: testy, dokumentacja, monitorowanie i harmonogramy zgodności.

Ustawa o AI UE: Wymagania dotyczące testów odporności wyjaśnione

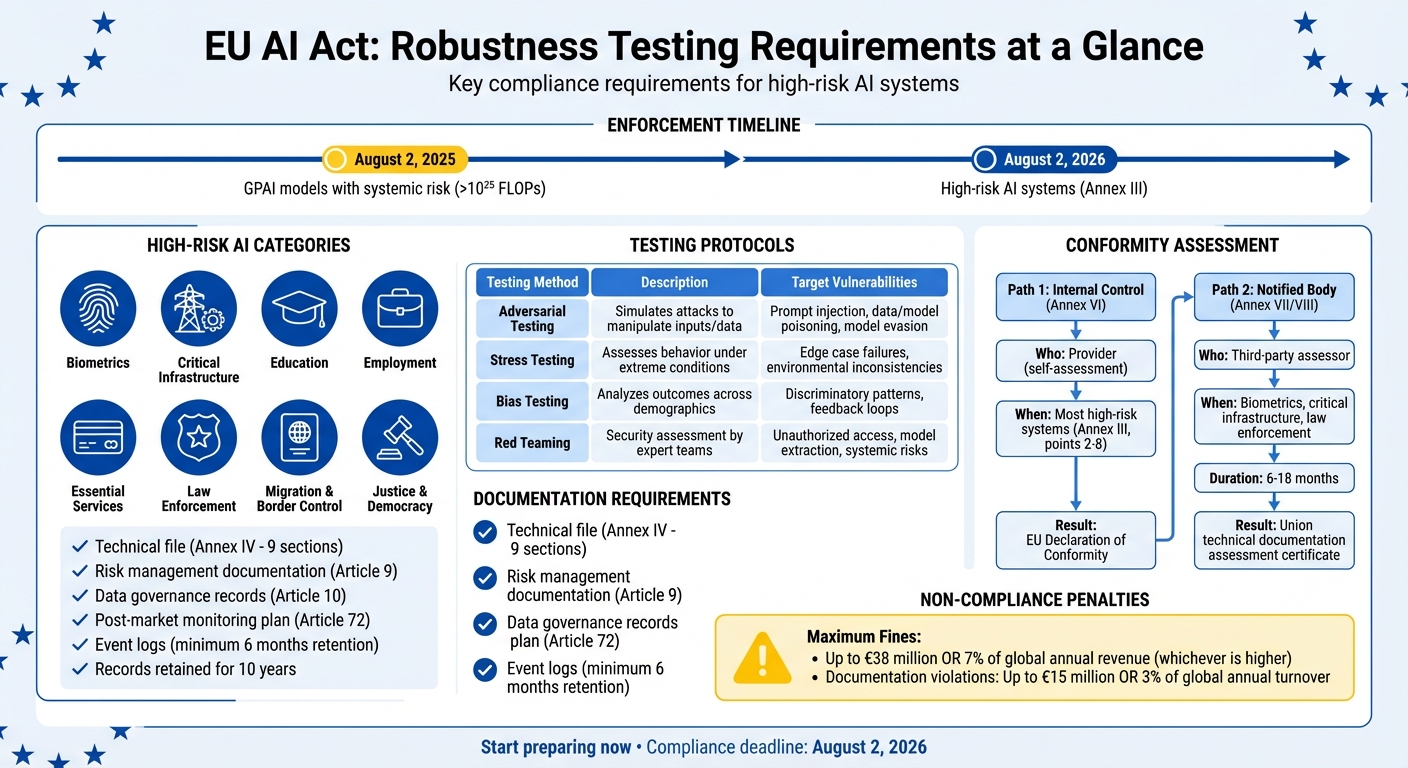

Ustawa o AI UE nakazuje systemom AI wysokiego ryzyka poddawanie się rygorystycznym testom odporności w celu zapewnienia niezawodnego działania w przypadku błędów, awarii lub nieoczekiwanych warunków. To wymaganie, opisane szczegółowo w Artykule 15, dotyczy systemów w sektorach krytycznych, takich jak opieka zdrowotna, transport i egzekwowanie prawa. Oto co musisz wiedzieć:

- Odporność zdefiniowana: Zdolność systemów AI do utrzymania spójnego działania pomimo zakłóceń, jak określono w ISO/IEC 25059:2023.

- Systemy AI wysokiego ryzyka: Obejmuje AI w biometrii, infrastrukturze krytycznej, edukacji, zatrudnieniu i innych, wymienione w Załączniku III. Egzekwowanie zaczyna się 2 sierpnia 2026 r.

- Protokoły testowania: Obejmuje testy adwersacyjne, testy obciążeniowe i red teaming w celu zidentyfikowania luk w zabezpieczeniach.

- Dokumentacja: Dostawcy muszą przygotować szczegółowe pliki techniczne, przeprowadzić oceny zgodności i przechowywać dokumenty przez 10 lat.

- Monitorowanie po wdrożeniu: Ciągłe śledzenie wydajności i zabezpieczenia przed szkodliwymi pętlami zwrotnym są wymagane.

Niezastosowanie się do listy kontrolnej zgodności z ustawą o AI UE może skutkować karami do 38 milionów dolarów lub 7% światowego przychodu rocznego. Zacznij przygotowania już teraz, aby spełnić te wymagania przed datą egzekwowania.

::: @figure  {Wymagania dotyczące testów odporności ustawy o AI UE i harmonogram zgodności}

:::

{Wymagania dotyczące testów odporności ustawy o AI UE i harmonogram zgodności}

:::

Systemy AI wysokiego ryzyka i możliwość zastosowania

Co kwalifikuje się jako system AI wysokiego ryzyka?

Ustawa o AI UE definiuje systemy AI wysokiego ryzyka za pomocą dwóch głównych podejść. Po pierwsze, obejmuje systemy AI, które działają jako komponenty bezpieczeństwa w produktach regulowanych przez europejskie prawo harmonizacyjne (wymienione w Załączniku I). Przykłady obejmują maszyny, urządzenia medyczne i systemy motoryzacyjne, w których awaria mogłaby stanowić zagrożenie dla zdrowia lub bezpieczeństwa [7]. Po drugie, obejmuje systemy opisane w Załączniku III, obejmujące osiem obszarów, które mogą wpłynąć na prawa podstawowe [7][8].

Te osiem kategorii Załącznika III to:

- Biometria: Systemy takie jak zdalna identyfikacja i rozpoznawanie emocji.

- Infrastruktura krytyczna: Narzędzia do zarządzania ruchem drogowym lub urządzeniami użyteczności publicznej (np. woda, gaz, elektryczność).

- Edukacja: AI używane w decyzjach dotyczących przyjęć lub monitorowaniu egzaminów.

- Zatrudnienie: Aplikacje takie jak selekcja CV, decyzje dotyczące awansu i monitorowanie pracowników.

- Usługi niezbędne: Systemy do oceny zdolności kredytowej lub wyceny ubezpieczenia.

- Egzekwowanie prawa: Narzędzia takie jak testy poligrafu lub modele przewidywania wznowienia przestępczości.

- Migracja i kontrola granic: AI używane w przetwarzaniu wiz.

- Wymiar sprawiedliwości i demokracja: Systemy opracowane w celu wspierania organów sądowych [7][8].

Jednak nie wszystkie systemy w tych kategoriach automatycznie kwalifikują się jako wysokiego ryzyka. Artykuł 6 pozwala na zwolnienia, jeśli system wykonuje wąsko zdefiniowane zadania lub wspiera działania kierowane przez ludzi bez znaczącego wpływu na decyzje - pod warunkiem, że profilowanie nie jest zaangażowane. Aby skorzystać z tego zwolnienia, organizacje muszą udokumentować swoją ocenę za pomocą asystenta polityki i zarejestrować system w bazie danych UE przed wejściem na rynek [8]. Z drugiej strony, jeśli system AI profiluje osoby w obrębie domeny Załącznika III, pozostaje on klasyfikowany jako wysokiego ryzyka [8].

Dla wszystkich systemów wysokiego ryzyka, Artykuł 15 nakazuje testy odporności, aby zapewnić niezawodne działanie przez cały cykl życia [4]. Egzekwowanie tych wymagań dla systemów Załącznika III rozpoczyna się 2 sierpnia 2026 r. [8].

Ta rama klasyfikacji stanowi podstawę rygorystycznych standardów odporności wymaganych przez ustawę o AI UE.

Ogólne modele AI i ryzyko systemowe

Ustawa dotyczy również ogólnoprzeznaczeniowych modeli AI (GPAI), które nie są z natury wysokiego ryzyka. Jednak gdy te modele są zintegrowane w systemach wysokiego ryzyka - takie jak użycie dużego modelu językowego w rekrutacji lub infrastrukturze krytycznej - muszą one być zgodne ze standardami wysokiego ryzyka [9][8]. Ponadto modele GPAI zidentyfikowane jako stwarzające "ryzyko systemowe" podlegają określonym wymaganiom dotyczącym odporności, w tym testom adwersacyjnym [9].

Aby kwalifikować się jako ryzyko systemowe, skumulowana moc obliczeniowa treningu modelu musi przekroczyć 10^25 FLOPs [9]. Podobnie jak inne systemy wysokiego ryzyka, modele te muszą przejść szczegółowe oceny i testy adwersacyjne w celu wykrycia luk w zabezpieczeniach [6]. Zasady dotyczące modeli GPAI wchodzą w życie 2 sierpnia 2025 r., rok wcześniej niż szersze wymagania dotyczące systemów wysokiego ryzyka [9].

Techniczne i organizacyjne środki na rzecz odporności

Budowanie odporności technicznej

Artykuł 15 ustawy o AI UE podkreśla znaczenie odporności w systemach AI wysokiego ryzyka, zapewniając, że mogą one wytrzymać zakłócenia operacyjne. Systemy te muszą radzić sobie z błędami, awariami lub niespójnościami w swoim środowisku, nawet w przypadku awarii sprzętu, uszkodzonych danych wejściowych lub nieoczekiwanego zachowania użytkownika [1].

Jednym z kluczowych podejść do osiągnięcia odporności jest redundancja techniczna. Na przykład, konteneryzacja może izolować operacje systemowe, utrzymując niezawodność nawet w przypadku problemów z infrastrukturą [2]. W krytycznych ustawieniach projektowanie dla degradacji stopniowej - gdzie system przechodzi do operacji ręcznych lub systemów zapasowych zamiast całkowicie się wyłączać - dodaje kolejną warstwę niezawodności.

Podatności specyficzne dla AI również wymagają uwagi. Zagrożenia takie jak zatrucie danych (manipulacja danymi treningowymi), zatrucie modelu (wbudowanie złośliwego kodu podczas treningu) i przykłady adwersacyjne (dane wejściowe zaprojektowane w celu wprowadzenia w błąd AI) wymagają mocnych obrony [2]. Framework MITRE ATLAS dostarcza narzędzia do testowania i łagodzenia tych ryzyk [2]. Ponadto zautomatyzowane systemy monitorowania i alertów mogą identyfikować problemy z wydajnością lub dostępnością w czasie rzeczywistym. Specjalistyczne narzędzia takie jak ISMS Copilot One mogą pomóc w automatyzacji tych złożonych przepływów pracy zgodności.

W przypadku systemów AI, które kontynuują uczenie się po wdrożeniu, pętle sprzężenia zwrotnego stanowią wyjątkowe wyzwania. Jeśli tendencyjne wyniki trafiają do kolejnych danych treningowych, te uprzedzenia mogą się kumulować. Aby się z tym zmierzyć, środki takie jak selektywna kuracja danych i ograniczenie integracji rzeczywistych informacji zwrotnych są niezbędne [1]. Rejestrowanie zdarzeń, wymagane na podstawie Artykułu 12, pomaga śledzić zmiany wydajności i wykrywać potencjalne problemy [8].

Te techniczne zabezpieczenia działają w tandemie ze środkami organizacyjnymi w celu zapewnienia, że systemy pozostają sprawiedliwe i bezstronne.

Zajmowanie się tendencyjnością i uczciwością

Łagodzenie tendencyjności to nie tylko obowiązek etyczny, ale także zobowiązanie prawne zgodnie z ustawą. Systemy AI wysokiego ryzyka muszą działać sprawiedliwie we wszystkich grupach demograficznych, szczególnie w czułych obszarach, takich jak zatrudnienie, edukacja lub dostęp do usług niezbędnych [8].

Regularne audyty uczciwości są kluczowe. Na przykład, jeśli narzędzie do selekcji CV nie uwzględnia różnorodnych ścieżek kariery lub środowiska edukacyjnego, może to niesprawiedliwie dyskryminować niektóre grupy. Takie naruszenia mogą skutkować karami do 35 milionów dolarów lub 7% światowego obrotu rocznego [10].

Nadzór człowieka, wymagany na podstawie Artykułu 14, jest innym krytycznym składnikiem. Ludzie muszą rozumieć ograniczenia systemu, unikać ślepego zaufania do jego wyników (automatyczne uprzedzenie) i interweniować w razie potrzeby [8]. Jednym skutecznym podejściem jest projekt pełniący wyłącznie funkcję doradczą, w którym wyniki AI są przejrzane przez ludzi przed podjęciem jakichkolwiek działań.

Aby systematycznie zajmować się tendencyjnością, należy ustanowić Systemem Zarządzania Jakością (QMS) na mocy Artykułu 17. Powinno to obejmować pisemne zasady identyfikacji i korygowania tendencyjności, wraz z ciągłym zarządzaniem ryzykiem przez cały cykl życia systemu AI. Monitorowanie po wprowadzeniu na rynek jest niezbędne do oceny wydajności w rzeczywistym świecie, podczas gdy zautomatyzowane dzienniki - przechowywane przez co najmniej sześć miesięcy - tworzą ścieżkę danych dla audytów i dochodzeń dotyczących incydentów [8].

Testowanie i walidacja odporności

Protokoły testowania odporności

Aby zapewnić, że systemy AI są przygotowane do wdrożenia, ustawa o AI UE nakazuje rygorystyczne testy przed wdrożeniem, szczególnie w systemach wysokiego ryzyka. Testy te mają na celu potwierdzenie odporności na błędy, awarie i potencjalne ataki [1].

Testowanie adwersacyjne jest kluczowym wymaganiem dla ogólnoprzeznaczeniowych systemów AI z ryzykami systemowymi, a także systemów wysokiego ryzyka. Podejście to obejmuje symulację ataków takich jak wstrzykiwanie promptów, zatrucie danych i unik modelu w celu oceny, jak dobrze system może wytrzymać takie zagrożenia [10][11]. Inną krytyczną metodą jest red teaming, w którym wewnętrzni lub zewnętrzni eksperci aktywnie próbują naruszyć system, zapewniając kompleksową ocenę bezpieczeństwa [10].

Testowanie obciążeniowe ocenia, jak systemy radzą sobie w ekstremalnych lub niezwykłych scenariuszach, takich jak przypadki graniczne lub umyślne wstrzyknięcia błędów, zapewniając, że awarie następują w kontrolowany i przewidywalny sposób [10][11].

| Metoda testowania | Opis | Podatności docelowe |

|---|---|---|

| Testowanie adwersacyjne | Symuluje ataki w celu manipulacji wejściem lub danymi treningowymi | Wstrzykiwanie promptów, zatrucie danych/modelu, unik modelu [10][3] |

| Testowanie obciążeniowe | Ocenia zachowanie w ekstremalnych lub niezwykłych warunkach | Awarie przypadków granicznych, niespójności środowiskowe [11][8] |

| Testowanie tendencyjności | Analizuje wyniki w grupach demograficznych | Dyskryminacyjne wzorce, pętle sprzężenia zwrotnego [11] |

| Red Teaming | Ocena bezpieczeństwa przez zespoły wewnętrzne lub zewnętrzne | Nieautoryzowany dostęp, ekstrakcja modelu, ryzyka systemowe [10] |

Aby zminimalizować tendencyjność wyników, zestawy danych testowych muszą być starannie wyselekcjonowane, aby były istotne, reprezentatywne i tak bezpieczne, jak to możliwe [1][11]. Ponadto dostawcy są zobowiązani do deklarowania określonych benchmarków dokładności i odporności w instrukcjach użytkownika, dostosowując się do standardów Komisji UE [1][3].

"Zapewnienie jakości nie jest już opcjonalne - jest fundamentem zgodności regulacyjnej. Organizacje muszą udowodnić, że ich systemy AI są bezpieczne, uczciwe i niezawodne, zanim będą mogły wejść na rynek UE."

Po ukończeniu tych protokołów sprzed wdrożenia, ciągłe monitorowanie zapewnia, że systemy pozostają odporne po wdrożeniu.

Ciągłe monitorowanie po wdrożeniu

Testowanie nie kończy się, gdy system AI jest wdrażany. Zgodnie z Artykułem 72, dostawcy muszą wdrożyć systemy monitorowania po wprowadzeniu na rynek, które ciągle gromadzą, dokumentują i analizują dane wydajności przez cały cykl życia systemu [4][12]. Zapewnia to, że system dostosuje się do ewoluujących warunków rzeczywistych, utrzymując swoją integralność.

Systemy AI wysokiego ryzyka są zobowiązane do rejestrowania zdarzeń przez co najmniej sześć miesięcy. Dzienniki te pomagają śledzić wydajność, identyfikować potencjalne ryzyka i dokumentować znaczące zmiany [6][8][12]. Narzędzia takie jak wykrywanie anomalii mogą flagować nieoczekiwane przesunięcia danych lub szum, który może podważić odporność systemu [2][5].

W przypadku systemów, które się stale uczą, zabezpieczenia muszą być na miejscu, aby zapobiec pętlom sprzężenia zwrotnego, w których tendencyjne wyniki mogłyby wpłynąć na przyszłe dane treningowe [4][2][1]. Narzędzia monitorowania śledzą degradację wydajności w czasie, podczas gdy konteneryzacja zapewnia stabilne i powtarzalne środowiska do wykonywania systemu [2].

Zarówno dostawcy, jak i wdrażający są zobowiązani do zgłaszania incydentów [6][12]. Ponadto mechanizmy nadzoru człowieka, takie jak procedury "przycisku zatrzymania", pozwalają na natychmiastową interwencję w przypadku problemów [8].

"Ustawa o AI UE wymaga ciągłego monitorowania po wdrożeniu, a nie tylko testowania jednorazowego. Systemy AI wysokiego ryzyka muszą mieć wbudowane zautomatyzowane rejestrowanie i reagowanie na incydenty od samego początku."

- Oleg Sivograkov, VP of IT Operations, TestFort [11]

Data egzekwowania tych wymagań jest ustalona na 2 sierpnia 2026 r. [8]. Niezastosowanie się do wymogów może skutkować surowymi karami, w tym grzywny do 38 milionów dolarów lub 7% światowego przychodu rocznego [10].

Część 2: Poruszanie się po ustawie o AI UE: Niezbędne elementy zgodności dla systemów AI wysokiego ryzyka

::: @iframe https://www.youtube.com/embed/wsr6d6WG5Uo :::

Dokumentacja i raportowanie zgodności

Po rygorystycznych testach i ciągłym monitorowaniu, właściwa dokumentacja jest niezbędna do zachowania zgodności.

Standardy dokumentacji technicznej

Zanim wprowadzisz produkt na rynek, musisz przygotować plik techniczny spełniający standardy Załącznika IV. Plik ten powinien wyraźnie wykazywać zgodność z wymaganiami odporności Artykułu 15 [13]. Plik musi zawierać dziewięć sekcji, a Sekcja 4 skupia się szczególnie na metrykach wydajności. Powinien zawierać szczegóły wyników testów odporności, metody walidacji i uzasadnienie wybranych metryk [13].

Utworzenie tej dokumentacji może zająć od 40 do 80 godzin, pod warunkiem że dane dotyczące zgodności są już zintegrowane w proces rozwoju przy użyciu asystenta wdrażania AI [13]. Narzędzia takie jak MLflow mogą usprawnić ten proces, przechwytując dzienniki, ślady audytu i decyzje projektowe bezpośrednio w przepływie pracy.

Twój plik techniczny powinien również zawierać:

- Dokumentacja zarządzania ryzykiem (Artykuł 9)

- Dokumenty ładu danych (Artykuł 10) wyjaśniające, w jaki sposób zestawy danych zostały wykorzystane do oceny tendencyjności

- Plan monitorowania po wprowadzeniu na rynek (Artykuł 72)

- Instrukcje opisujące poziomy odporności i ograniczenia [1]

Cała dokumentacja techniczna musi być przechowywana przez 10 lat po wprowadzeniu produktu na rynek. Niezastosowanie się do wymogów może skutkować karami do 15 milionów euro lub 3% światowego obrotu rocznego [13].

Oceny zgodności i znakowanie CE

Po ukończeniu pliku technicznego, następnym krokiem jest udowodnienie zgodności poprzez ocenę zgodności. Większość systemów AI wysokiego ryzyka można samodzielnie ocenić w ramach procesu Kontroli Wewnętrznej opisanego w Załączniku VI [15]. Jednak systemy używane w czułych obszarach, takie jak biometria, infrastruktura krytyczna lub egzekwowanie prawa, wymagają zewnętrznej oceny przez organ notyfikowany. Ci autoryzowani audytorzy trzecich stron są uprawnieni do przeglądu Twojej dokumentacji i zapewnienia zgodności [14].

Organy notyfikowane mogą żądać dodatkowych dowodów lub przeprowadzić niezależne testy, jeśli stwierdzą, że Twoje testy odporności są niewystarczające [14]. Weryfikują, że środki takie jak redundancja, plany awaryjne i bezpieczniki są udokumentowane i wdrożone [1]. W przypadku systemów AI, które kontynuują uczenie się po wdrożeniu, sprawdzą również zabezpieczenia przed pętlami sprzężenia zwrotnego, które mogłyby wprowadzić tendencyjność do przyszłych danych treningowych [1].

| Typ oceny | Kto to prowadzi | Kiedy jest wymagane | Wydany certyfikat |

|---|---|---|---|

| Kontrola wewnętrzna (Załącznik VI) | Dostawca (samodzielna ocena) | Większość systemów wysokiego ryzyka (Załącznik III, punkty 2-8) | Deklaracja UE zgodności |

| Organ notyfikowany (Załącznik VII/VIII) | Audytor trzeciej strony | Biometria, infrastruktura krytyczna, egzekwowanie prawa | Certyfikat oceny dokumentacji technicznej Unii |

Biorąc pod uwagę, że oceny przez organy notyfikowane mogą trwać od 6 do 18 miesięcy, dostawcy systemów krytycznych dla bezpieczeństwa lub biometrycznych powinni rozpocząć proces znacznie wcześniej niż termin 2 sierpnia 2026 r. [16]. Bądź gotów, aby zapewnić dostęp do zbiorów danych treningowych, walidacyjnych i testowych za pośrednictwem API lub innych środków technicznych, jeśli będzie to wymagane [14].

Po pomyślnym ukończeniu oceny musisz wydać Deklarację UE zgodności i zastosować znakowanie CE do systemu lub jego dokumentacji [15]. Znakowanie to stanowi dowód prawny, że Twój system spełnia standardy odporności. Jeśli dokonasz jakichkolwiek znaczących zmian - takich jak modyfikacje wpływające na zgodność lub przeznaczenie systemu - będziesz musiał zaktualizować dokumentację i ewentualnie przejść nową ocenę zgodności [13].

"Dokumentacja techniczna powinna być sporządzana w taki sposób, aby wykazywać, że system AI wysokiego ryzyka jest zgodny z wymaganiami [...] i dostarczać krajowym organom właściwym oraz organom notyfikowanym niezbędne informacje w jasnej i zrozumiałej formie w celu oceny zgodności."

- Artykuł 11, Rozporządzenie (UE) 2024/1689 [13]

Oceny zgodności, w połączeniu z ciągłym monitorowaniem, tworzą kompleksową ramę zgodności, zapewniając, że systemy AI wysokiego ryzyka spełniają standardy odporności przez cały cykl życia.

Odporność vs. Cyberbezpieczeństwo: Kluczowe różnice

Podsumujmy, w jaki sposób ustawa o AI UE różnicuje odporność od cyberbezpieczeństwa - dwa pojęcia, które mogą się wydawać podobne, ale służą bardzo różnym celom.

Rozróżnienie leży w intencji. Odporność, jak określono w Artykule 15[1], dotyczy niezamierzonego zakłócenia. Mogą to być naturalne błędy, awarie lub niespójności, które pojawiają się podczas regularnego działania systemu. Z drugiej strony cyberbezpieczeństwo, omówione w Artykule 15[3], skupia się na zamierzonych, złośliwych atakach. Obejmuje to scenariusze, w których nieautoryzowane trzecie strony aktywnie próbują manipulować lub podważać wydajność systemu. Chociaż wcześniejsze sekcje omawiały, jak testować odporność, ta część podkreśla podział między wewnętrzną odpornością a zewnętrznymi zagrożeniami.

Technicznie, odporność w uczeniu maszynowym odnosi się do adaptacyjności niezawodności niezawodnej. Obejmuje to testowanie zdolności systemu AI do radzenia sobie z wyzwaniami, takimi jak przesunięcia rozkładu, zmiany środowiska lub pętle sprzężenia zwrotnego - w których dane wyjściowe modelu wpływają na przyszłe dane treningowe. Cyberbezpieczeństwo, jednak skupia się na adaptacyjności zagrożeń, chroniąc przed zagrożeniami takimi jak zatrucie danych, ataki unikowe lub nawet naruszenia, które zagrażają poufności modelu, takie jak kradzież.

Henrik Nolte z Uniwersytetu w Tybindze wyjaśnia to rozróżnienie wyraźnie:

"AIA sztucznie dzieli koncepcję cyberbezpieczeństwa CSA, wyznaczając przyczyny niezamierzone jako kwestię odporności i ograniczając cyberbezpieczeństwo do działań zamierzonych."

Dla zgodności, zarówno odporność, jak i cyberbezpieczeństwo wymagają różnych strategii. Organizacje mogą szkolić asystentów zgodności AI, aby zarządzać tymi złożonościami. Odporność opiera się na środkach takich jak redundancja techniczna i ciągłe monitorowanie, aby zapewnić, że systemy mogą radzić sobie z niezamierzonymi zakłóceniami. Cyberbezpieczeństwo, z drugiej strony, wymaga aktywnych obrony, takich jak wykrywanie zagrożeń, szyfrowanie i szkolenie adwersacyjne, aby przeciwdziałać przemyślanym atakom. Utrzymanie zarówno przez cykl życia systemu AI obejmuje ocenę każdego komponentu indywidualnie, aby zapewnić kompleksową ochronę.

Podsumowanie i kluczowe wnioski

Podsumujmy, podkreślając niezbędne kroki do zapewnienia, że Twoje systemy AI są niezawodne i zgodne z nadchodzącymi regulacjami.

Testowanie odporności jest kamieniem węgielnym zapewniającym, że systemy AI wysokiego ryzyka działają spójnie w praktycznych warunkach. Przy egzekwowaniu wymagań Załącznika III zaplanowanym na 2 sierpnia 2026 r. [8], organizacje muszą działać teraz, aby ustalić benchmarki wydajności, zintegrować mechanizmy redundancji i wdrożyć ciągłe monitorowanie przez cały cykl życia AI.

Pojęcie odporności jest wysoce zależne od kontekstu. Będziesz musiał zdefiniować metryki wydajności, które są dostosowane do konkretnego celu Twojego systemu i przewidzieć zakłócenia, takie jak dryfaż danych, zmiany środowiska lub pętle sprzężenia zwrotnego. Protokoły testowania powinny być dostosowane do unikalnego wariantu użytku, właściwości danych i środowiska wdrażania każdego systemu AI.

Zacznij od ustalenia wyraźnych linii bazowych wydajności w normalnych warunkach. Następnie metodycznie testuj, jak Twój system reaguje na różne wyzwania lub zakłócenia. Włącz środki redundancji - takie jak systemy zapasowe i bezpieczniki - i upewnij się, że mechanizmy nadzoru człowieka są na miejscu, aby interweniować, gdy pojawią się anomalie. Ponadto Twoje systemy rejestrowania powinny wspierać zgodność poprzez dostarczanie niezmiennych, tylko dodatków, śladów audytu.

Zgodnie z Artykułem 11, dostawcy są przede wszystkim odpowiedzialni za przeprowadzanie ocen zgodności i przygotowywanie dokumentacji technicznej, podczas gdy wdrażający muszą zarządzać nadzorem człowieka i utrzymywać praktyki przechowywania niezawodnych dzienników. Obie role dzielą odpowiedzialność za utrzymanie odporności systemu przez cały cykl życia systemu AI.

Uproszczenie zgodności za pomocą ISMS Copilot

Zaawansowane narzędzia zgodności, takie jak ISMS Copilot, mogą uprościć te krytyczne kroki.

ISMS Copilot jest zaprojektowany, aby wspierać zgodność z ustawą o AI UE poprzez analizę istniejącej dokumentacji technicznej i ocen wpływu w celu zidentyfikowania luk w wymaganiach dotyczących odporności. Platforma pomaga opracować szczegółową dokumentację techniczną Artykułu 11, którą będą przeglądać organy regulacyjne, obejmującą wszystko od opisów systemu do protokołów monitorowania.

Dla zadań regulacyjnych związanych z ustawą o AI UE platforma wykorzystuje modele Mistral, które są specjalnie szkolone na europejskich przepisach. Modele te dostarczają szczegółowych informacji na temat wymagań ustawy. Możesz utworzyć poszczególne obszary robocze dla każdego systemu AI, zapewniając czyste ślady audytu i zorganizowane wysiłki w zakresie zgodności. Korzystając z platformy, podaj szczegóły, takie jak przypadek użytku systemu, typy danych i klasyfikacja ryzyka, aby otrzymać dostosowane wskazówki, które są zgodne z wymogami zgodności.

Wyróżniającą się funkcją ISMS Copilot jest narzędzie analiza luk, które jest szczególnie przydatne w testowaniu odporności. Poprzez przesłanie bieżących ocen ryzyka i protokołów testowania, platforma identyfikuje brakujące komponenty i oferuje priorytetyzowany plan naprawy. Pomaga to przydzielić zasoby efektywnie i zaradzić krytycznym lukom w zgodności przed terminem sierpnia 2026 r.

FAQs

::: faq

Skąd mam wiedzieć, czy mój system AI jest "wysokiego ryzyka" zgodnie z ustawą o AI UE?

Zgodnie z ustawą o AI UE, Twój system AI uważa się za "wysokiego ryzyka", jeśli spełnia jedno z dwóch kryteriów:

- Funkcjonuje jako komponent bezpieczeństwa produktu regulowanego przez przepisy UE wymienione w Załączniku I.

- Jest stosowany w scenariuszach wysokiego ryzyka zidentyfikowanych w Załączniku III, takich jak oceny kredytowe, procesy rekrutacji czy identyfikacja biometryczna.

Te klasyfikacje odgrywają kluczową rolę w określeniu zobowiązań w zakresie zgodności dla Twojego systemu. :::

::: faq

Jakie testy odporności powinienem przeprowadzić przed wprowadzeniem systemu AI wysokiego ryzyka na rynek UE?

Przed wyniesieniem systemu AI wysokiego ryzyka na rynek UE, niezbędne jest przeprowadzenie testów odporności, aby zgodnie z ustawą o AI UE. Testy te skupiają się na trzech kluczowych obszarach: dokładności, cyberbezpieczeństwie i łagodzeniu tendencyjności. Celem jest zapewnienie, że system może skutecznie radzić sobie z wyzwaniami wydajności. Te oceny nie tylko dotyczą zgodności - są one kluczowe dla budowy systemu, który działa niezawodnie w różnych warunkach. :::

::: faq

Jakie dowody regulatorzy oczekują w pliku technicznym Artykułu 11 na temat odporności?

Regulatorzy nakazują, aby plik techniczny Artykułu 11 zawierał dokładną dokumentację techniczną, która jest zgodna ze standardami Załącznika IV. Dokumentacja ta musi rozwiązać dziewięć wymaganych sekcji szczegółowo opisujących projekt, rozwój i cykl życia systemu AI. Kluczowe jest, aby ten plik został ukończony, zanim system trafi na rynek i będzie aktualizowany przez cały cykl życia systemu. :::

Powiązane artykuły

Mapowanie krzyżowe frameworków: NIST, ISO 27001, SOC2

Wykorzystaj NIST CSF do budowania ujednoliconych kontroli, które mapują ISO 27001 i SOC 2, zmniejszając nakład pracy audytu i koszty zgodności.

NIS2 i ISO 27001: Przewodnik Wizualizacji Pokrywania się

Pokazuje, jak ISO 27001 pokrywa 70–80% NIS2 i podkreśla luki, takie jak ścisłe raportowanie incydentów i odpowiedzialność kierownictwa.

Ustawa AI UE: Wyjaśnienie Wymagań Przejrzystości

Przegląd przejrzystości Ustawy AI UE: zasady ujawniania chatbotów i treści AI, standardy dokumentacji, harmonogramy i kary.