Ustawa AI UE: Wyjaśnienie Wymagań Przejrzystości

Przegląd przejrzystości Ustawy AI UE: zasady ujawniania chatbotów i treści AI, standardy dokumentacji, harmonogramy i kary.

Ustawa AI UE: Wyjaśnienie Wymagań Przejrzystości

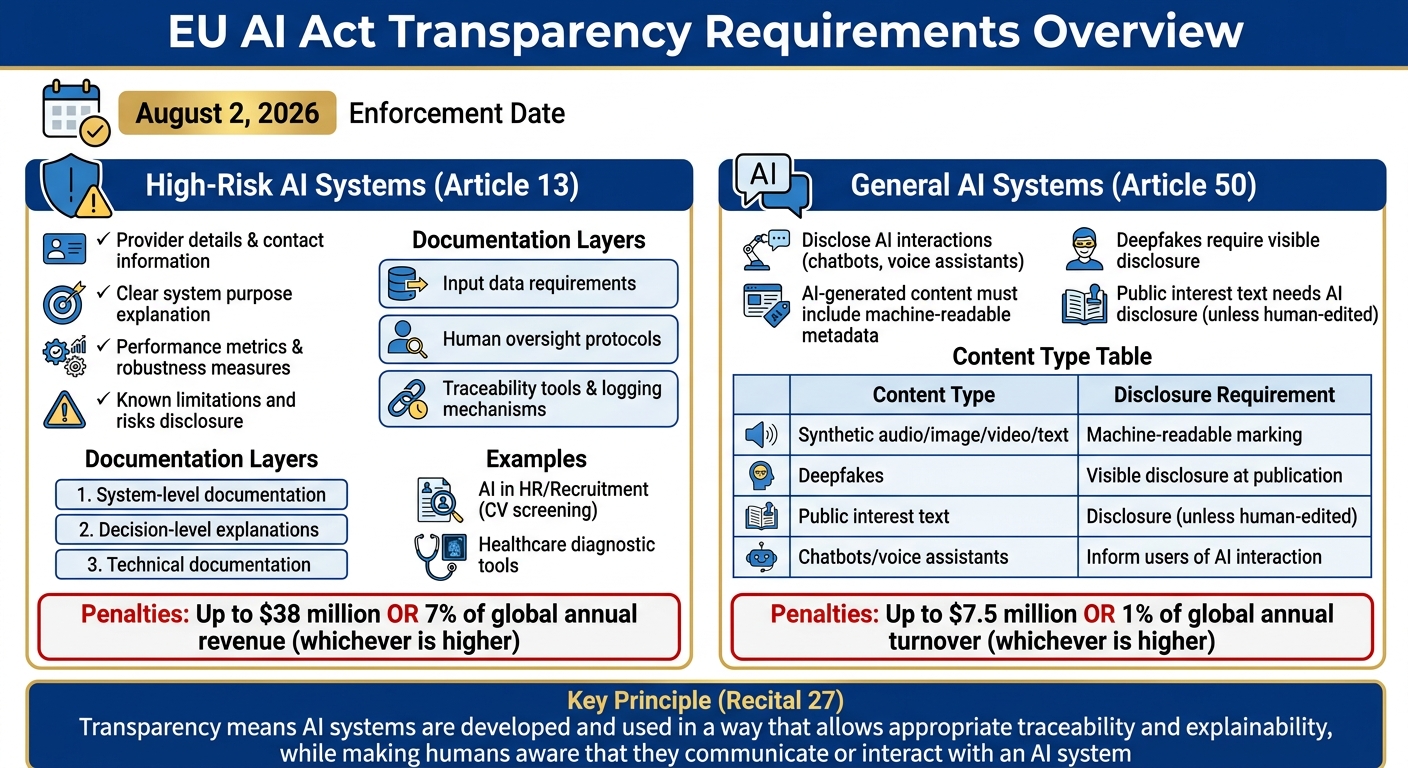

Ustawa AI UE to pierwszy na świecie ramy prawne do regulacji sztucznej inteligencji, z silnym naciskiem na przejrzystość. Wprowadza ścisłe wymagania dla systemów AI wysokiego ryzyka, podkreślając możliwość śledzenia, wyjaśnialność i świadomość użytkowników. Oto, co musisz wiedzieć:

-

Kluczowe Zasady Przejrzystości:

- Systemy AI wysokiego ryzyka muszą zapewnić przejrzystą dokumentację, w tym cel systemu, metryki wydajności, ograniczenia i szczegóły operacyjne.

- Użytkownicy muszą być poinformowani podczas interakcji z systemami AI (np. chatboty, asystenci głosowi).

- Treść generowana przez AI, taka jak deepfake'i, musi zawierać widoczne ujawnienie lub metadane.

-

Kary za Niezgodność:

- Grzywny do 38 milionów dolarów lub 7% globalnych rocznych przychodów za systemy wysokiego ryzyka.

- Dla ogólnych systemów AI grzywny mogą sięgać 7,5 miliona dolarów lub 1% globalnego obrotu.

-

Harmonogram:

- Większość postanowień wchodzi w życie 2 sierpnia 2026.

-

Standardy Dokumentacji:

- Dostawcy muszą utrzymywać warstwową dokumentację (np. informacje na poziomie systemu, wyjaśnienia decyzji) i szczegółowe pliki techniczne.

Ustawa ma na celu zmniejszenie ryzyka, takiego jak automatyczne uprzedzenia i nadużycia, przy jednoczesnym zapewnieniu odpowiedzialności dla programistów i wdrażających AI, często wymagając Asystenta AI UE do poruszania się po złożonych wymaganiach. Zgodność nie jest opcjonalna – jest konieczna, aby uniknąć kar i zbudować zaufanie do systemów AI.

::: @figure  {Wymagania Przejrzystości Ustawy AI UE: Przegląd Zgodności Systemów AI Wysokiego Ryzyka vs Ogólnych}

:::

{Wymagania Przejrzystości Ustawy AI UE: Przegląd Zgodności Systemów AI Wysokiego Ryzyka vs Ogólnych}

:::

Brando Benifei na Temat Balansowania Przejrzystości, Własności Intelektualnej i Egzekwowania w Ustawie AI UE | RegulatingAI Podcast

::: @iframe https://www.youtube.com/embed/f62JIPXT8Cs :::

Wymagania Przejrzystości dla Systemów AI Wysokiego Ryzyka (Artykuł 13)

Artykuł 13 Ustawy AI UE określa szczególne zobowiązania w zakresie przejrzystości dla dostawców systemów AI wysokiego ryzyka. Wymagania te mają na celu zapewnienie, że takie systemy są zaprojektowane z wystarczającą przejrzystością dla wdrażających, aby mogli interpretować ich wyniki i używać ich odpowiedzialnie. Chociaż dostawcy nie muszą ujawniać zastrzeżony kod, muszą udostępnić kluczowe szczegóły operacyjne i wyjaśnić ograniczenia systemu.

Wymagania Informacji dla Użytkowników

Systemy AI wysokiego ryzyka muszą być wyposażone w jasne, dostępne instrukcje, które są łatwe do zrozumienia i dostępne cyfrowo. Instrukcje te powinny zawierać:

- Szczegóły dostawcy: Tożsamość i informacje kontaktowe dostawcy.

- Cel: Jasne wyjaśnienie zamierzonego użytku systemu.

- Szczegóły wydajności: Informacje na temat metryk wydajności, środków niezawodności i testowanych standardów cyberbezpieczeństwa.

- Znane ograniczenia i ryzyka: Omówienie potencjalnych ryzyk, w tym związanych ze zdrowiem, bezpieczeństwem lub podstawowymi prawami, a także ryzyk z przewidywalnych nadużyć.

- Specyfika Operacyjna: Szczegóły dotyczące wymagań danych wejściowych, protokołów nadzoru przez człowieka, potrzeb obliczeniowych, czasu życia systemu i harmonogramów konserwacji.

- Narzędzia Śledzenia: Mechanizmy do rejestrowania, przechowywania i interpretacji danych systemowych w celu zapewnienia odpowiedzialności.

Oprócz instrukcji dla użytkowników, dostawcy muszą przestrzegać ścisłych praktyk dokumentacyjnych, aby spełnić standardy przejrzystości Ustawy AI UE.

Standardy Dokumentacji

Ustawa AI UE nie nakazuje jednego formatu dokumentacji, ale podkreśla podejście warstwowe, aby spełnić potrzeby różnych interesariuszy:

- Dokumentacja na poziomie systemu: Obejmuje ogólne zachowanie systemu, zamierzone przeznaczenie i znane tryby awarii.

- Wyjaśnienia na poziomie decyzji: Skupia się na czynnikach wpływających na poszczególne wyniki i związane z nimi poziomy pewności.

- Dokumentacja techniczna: Oferuje szczegółowe informacje o architekturze modelu i procesach walidacji.

Celem jest zapewnienie wyjaśnień dostosowanych do potrzeb różnych użytkowników. Na przykład, narzędzia takie jak SHAP lub LIME mogą oferować zlokalizowane wglądy dla złożonych modeli. Głębokość wyjaśnienia będzie się różnić w zależności od interesariusza – to, co musi wiedzieć profesjonalista medyczny o narzędziu diagnostycznym, może się znacznie różnić od tego, co konsument musi zrozumieć na temat wyniku kredytowego.

To wielowarstwowe podejście do dokumentacji jest krytyczne dla zapewnienia przejrzystości w aplikacjach AI wysokiego ryzyka.

Przykłady Przypadków Użycia AI Wysokiego Ryzyka

Oto, jak te wymagania przejrzystości znajdują odzwierciedlenie w rzeczywistych scenariuszach:

- AI w HR/Rekrutacji: Systemy używane do przeszukiwania CV lub oceny rozmów kwalifikacyjnych muszą zapewniać dokumentację wyjaśniającą, jak są określane rankingi kandydatów, jak system działa w różnych grupach kandydatów i jakie zabezpieczenia są na miejscu, aby zapobiec uprzedzeniom.

- Medyczne narzędzia diagnostyczne: Szpitale korzystające z AI do diagnostyki muszą uzyskać informacje na temat dokładności narzędzia w różnych demografii pacjentów, rodzajów obrazowania medycznego, na których został wytrenowany, sytuacji wymagających przeglądu przez człowieka i jak interpretować wyniki pewności.

Na przykład, szpital wdrażający narzędzie diagnostyczne AI powinien zrozumieć dokładność systemu w różnych grupach pacjentów i otrzymać wskazówki na temat tego, kiedy konieczna jest interwencja człowieka. Podobnie organizacja korzystająca z AI do podejmowania decyzji rekrutacyjnych musi być w stanie ocenić uczciwość i skuteczność systemu w różnych profilach kandydatów, przy jednoczesnym zapewnieniu zgodności ze standardami anty-dyskryminacyjnymi.

Ogólne Zasady Przejrzystości dla Systemów AI (Artykuł 50)

Artykuł 50 określa wymagania przejrzystości, które mają zastosowanie do szerokiego zakresu systemów AI, wykraczając poza same aplikacje wysokiego ryzyka. Zasady te obejmują systemy AI, które wchodzą w interakcje z ludźmi, generują treść lub przeprowadzają rozpoznawanie emocji. Począwszy od 2 sierpnia 2026 r., niezgodność może prowadzić do grzywn do 7,5 miliona dolarów lub 1% rocznego globalnego obrotu, w zależności od tego, która wartość jest wyższa [8].

Motyw 27 Ustawy AI UE definiuje przejrzystość w następujący sposób:

"Przejrzystość oznacza, że systemy AI są opracowywane i używane w sposób, który umożliwia odpowiednie śledzenie i wyjaśnialność, jednocześnie uświadamiając ludziom, że komunikują się lub wchodzą w interakcje z systemem AI, a także należycie informując wdrażających o możliwościach i ograniczeniach tego systemu AI oraz osoby objęte o ich prawach." [1]

Ujawnianie Interakcji AI

Ilekroć system AI wchodzi w bezpośrednią interakcję z użytkownikami – jak chatboty, asystenci głosowi lub narzędzia obsługi klienta – użytkownicy muszą być poinformowani, że wchodzą w interakcję z AI. To ujawnienie powinno nastąpić nie później niż przy pierwszej interakcji i musi być jasne i dostępne [4][10]. Istnieje wyjątek dla przypadków, gdy "wynika z okoliczności", że interakcja obejmuje AI, ale jest to wąskie wyjątek. Jak radzi Abhishek G Sharma, Założyciel i Prezes Move78 International Limited:

"Wyjątek [dla oczywistego AI] jest wąski... Moja rekomendacja: ujawnij mimo wszystko. Koszt małego powiadomienia wynosi zero. Koszt błędnego osądu 'oczywistości' wynosi do 7,5 miliona dolarów." [8]

Dla najlepszych praktyk użyj dwuwarstwowego podejścia: dołącz trwały wskaźnik wizualny (np. odznakę "Asystent AI") i udziel wyraźnego powiadomienia podczas pierwszej interakcji. Unikaj ukrywania tej informacji w Warunkach Świadczenia Usług – nie spełni to wymagania "jasne i wyraźne" [9]. Ponadto upewnij się, że zgodność z europejskimi standardami dostępności aby uczynić to ujawnienie powszechnie zrozumiałym.

Ujawnianie Treści Generowanej przez AI

Jeśli twój system AI generuje audio, obrazy, wideo lub tekst, musi zawierać metadane czytane maszynowo, używając standardów takich jak XMP, IPTC lub kryptograficzne systemy pochodzenia, takie jak C2PA [8]. W przypadku deepfake'ów wyraźne oznaczenie jako sztucznie generowane jest obowiązkowe w momencie publikacji [7].

Godnym uwagi przykładem, dlaczego jest to ważne, był luty 2026 r., gdy niemiecki nadawca publiczny ZDF "heute journal" wyemitował film generowany przez AI pokazujący funkcjonariuszy ICE zatrzymujących kobietę i dzieci. Film był używany do ilustracji raportu o imigracji w USA, podkreślając znaczenie jasnych standardów znakowania wizualnego [12].

W przypadku tekstu związanego z tematami będącymi przedmiotem zainteresowania publicznego, zaangażowanie AI musi być ujawnione, chyba że treść przeszła dokładną przegląd człowieka z udokumentowanymi procedurami nadzoru redakcyjnego. Prosty lub powierzchowny przegląd nie zakwalifikuje się do tego zwolnienia [12].

| Typ Treści AI | Kto Jest Odpowiedzialny | Co Jest Wymagane |

|---|---|---|

| Syntetyczne audio/obraz/wideo/tekst | Dostawca | Znakowanie do odczytu maszyn (metadane/znaki wodne) |

| Deepfake'i | Wdrażający | Widoczne ujawnienie przy publikacji |

| Tekst będący przedmiotem zainteresowania publicznego | Wdrażający | Ujawnienie generowania przez AI (chyba że edytowanie przez człowieka) |

| Chatboty/asystenci głosowi | Dostawca | System projektowy do informowania użytkowników o interakcji AI |

Istnieją pewne wyjątki. Na przykład AI pełniące funkcje pomocnicze, takie jak sprawdzanie pisowni, nie wymaga znakowania. Podobnie prace artystyczne lub satyryczne mogą mieć większą elastyczność, chociaż obecność treści generowanej przez AI powinna być nadal ujawniana w sposób, który nie zakłóca doświadczenia użytkownika [7].

Aby spełnić wymagania przejrzystości, przyjmij wielowarstwową strategię znakowania. Może to obejmować metadane podpisane cyfrowo, niewidoczne znaki wodne i szczegółowe dzienniki systemu [11][12]. Ponadto upewnij się, że twoje potoki treści zachowują metadane pochodzenia AI zamiast ich usuwać. Prowadzenie rejestru przejrzystości w celu dokumentowania sposobu i kiedy używane są mechanizmy ujawniania może służyć jako krytyczne zabezpieczenie, jeśli organy regulacyjne przeprowadzą dochodzenie, proces, który może zostać usprawniony przy użyciu asystenta polityki zgodności AI [8]. Łącznie te środki wspierają przejrzystość, zapewniając, że użytkownicy pozostają poinformowani o interakcjach i wynikach AI.

Jak Wdrożyć Zgodność z Wymaganiami Przejrzystości

Spełnienie wymagań zgodności Ustawy AI UE w zakresie przejrzystości wymaga więcej niż tylko zaznaczania pól. Organizacje muszą ocenić swoje systemy, stworzyć dokładną dokumentację i utrzymać dowody, które mogą wytrzymać badanie regulacyjne. Te kroki zapewniają odpowiedzialność przez cały cykl życia systemu AI. Wraz z wdrażaniem wymagań AI wysokiego ryzyka, które zaczynają się 2 sierpnia 2026 r., i karami sięgającymi do 35 milionów dolarów lub 7% globalnego rocznego obrotu za poważne naruszenia [5], zgodność nie jest opcjonalna – jest niezbędna.

Przeprowadzanie Ocen Przejrzystości

Zacznij od zidentyfikowania swoich interesariuszy – obejmuje to użytkowników końcowych, operatorów systemu, audytorów i programistów – i upewnij się, że twoje systemy AI zapewniają poziom przejrzystości wymagany przez każdą grupę [6]. Na przykład, podczas gdy lekarz korzystający z diagnostyki AI może potrzebować szczegółowych wyjaśnień technicznych, urzędnik bankowy przegląda wnioski o pożyczkę może wymagać mniej złożonych wglądów. W przypadku zaawansowanych modeli rozważ użycie narzędzi takich jak SHAP lub LIME, aby wyjaśnić, jak podejmowane są określone decyzje, zamiast tylko prezentować rezultaty [6].

Przed wdrożeniem systemów AI wysokiego ryzyka, ukończ Ocenę Wpływu na Podstawowe Prawa (FRIA) [3]. Ten proces identyfikuje potencjalne skutki dla podstawowych praw i dokumentuje kroki niezbędne do zmniejszenia ryzyk. Ponadto utrzymuj automatycznie generowane dzienniki przez co najmniej sześć miesięcy, aby zapewnić możliwość śledzenia [3].

Po potwierdzeniu przez oceny, że twój system spełnia standardy przejrzystości, przesuń swój fokus na tworzenie i utrzymywanie elastycznej dokumentacji.

Tworzenie i Aktualizacja Dokumentacji

Zgodnie z Artykułem 11 i Załącznikiem IV Ustawy AI UE, musisz utrzymywać Plik Techniczny, który potwierdza zgodność ze wszystkimi zobowiązaniami [13]. Nie jest to zadanie jednorazowe – twoja dokumentacja musi ewoluować wraz z twoim systemem. Przyjęcie stale aktualizowanego procesu dokumentacji zapewnia, że twoje zapiski pozostają aktualne, gdy twój system AI się zmienia.

Szablony takie jak Model Cards lub AI FactSheets mogą Ci pomóc w tworzeniu spójnej, wyczerpującej dokumentacji [6]. Powinny one zawierać szczegóły takie jak tożsamość dostawcy, charakterystyka systemu, znane ograniczenia, specyfikacje danych wejściowych, środki nadzoru przez człowieka i wymagania konserwacji [2].

Aby utrzymać dokumentację dostosowaną do aktualizacji systemowych, wdrażaj zautomatyzowany potok, który aktualizuje rekordy przy każdym przetreniowaniu modelu. W przypadku treści generowanej przez AI, użyj etykiet czytelnych dla maszyn zgodnie ze standardami takimi jak XMP, IPTC lub C2PA. Ponadto utrzymuj "Skarbiec Dowodów" do przechowywania niezmiennych szlaków audytu [13].

Korzystanie z ISMS Copilot do Zgodności

Aby uprościć wysiłki w zakresie zgodności, rozważ narzędzia takie jak ISMS Copilot. Platforma ta zapewnia wsparcie napędzane sztuczną inteligencją dostosowane do wymagań przejrzystości. Obejmuje Ustawę AI UE i ponad 50 innych ram, co czyni ją szczególnie przydatną dla organizacji żonglujących wieloma potrzebami zgodności.

Przesyłając dokumentację AI (pliki PDF, DOCX lub XLS do 5MB), ISMS Copilot może zidentyfikować luki i stworzyć priorytyzowane plany sanacji, aby rozwiązać brakujące elementy w twoich dokumentach przejrzystości [14]. Dla bardziej ukierunkowanych wyników, dołącz określone odnośniki w swoich monitach, takie jak "Artykuł 13 instrukcji dotyczących użytku" lub "Artykuł 50 zasad przejrzystości".

Podczas opracowywania tekstu ujawniającego dla treści generowanej przez AI lub interakcji, ISMS Copilot może wygenerować język, który dostosowuje się do Ustawy AI UE na podstawie Twojego przypadku użycia. Platforma umożliwia dostosowanie monitów poprzez dodanie szczegółów takich jak poziom ryzyka twojego systemu AI, model wdrażania i cel, zapewniając, że dokumentacja dostosowuje się do twoich konkretnych potrzeb.

Ponadto funkcja workspace ISMS Copilot pozwala zarządzać projektami Ustawy AI UE oddzielnie od innych struktur zgodności. Jest to szczególnie przydatne dla konsultantów pracujących z wieloma klientami. Plan Darmowy pozwala na 10 przesyłań dokumentów miesięcznie, podczas gdy plan Plus (24 USD/miesiąc) zwiększa ten limit [14].

Podsumowanie

Przejrzystość jest fundamentem zaufania i odpowiedzialności w technologiach AI. Jak wyjaśnia Motyw 27 Ustawy:

"Przejrzystość oznacza, że systemy AI są opracowywane i używane w sposób, który umożliwia odpowiednie śledzenie i wyjaśnialność, jednocześnie uświadamiając ludziom, że komunikują się lub wchodzą w interakcje z systemem AI" [1].

Ta kluczowa idea wpływa na wszystko – czy chodzi o dokumentowanie ograniczeń systemów wysokiego ryzyka, czy zapewnianie, że chatboty jasno ujawniają swoją tożsamość AI.

W całym tym artykule widzieliśmy, jak wymagania przejrzystości rozwiązują krytyczne wyzwania. Pomagają przeciwdziałać automatycznym uprzedzeniom, dają użytkownikom narzędzia do zrozumienia decyzji podejmowanych przez AI i zapewniają, że systemy te pozostają w swoim zamierzonym zakresie [3].

Dla organizacji przejrzystość nie jest tylko polem do zaznaczenia – musi być wpleciowana w każdą warstwę ich systemów AI. Jak mówią Sacha Wilson i Jacky Lai z Harbottle & Lewis:

"Trajektoria jest wyraźna: Ustawa pozycjonuje przejrzystość jako zasadę krytyczną, która będzie miała wpływ na wybory projektowe, interfejsy użytkownika i procesy ładu" [3].

Poprzez wplecianie przejrzystości w swoje procesy – poprzez jasną dokumentację, znaczące ujawnienia i silny nadzór człowieka – firmy mogą dostosować się do oczekiwań regulacyjnych, jednocześnie utrzymując swoją pozycję na rynku UE.

Ponadto dokładna dokumentacja nie tylko chroni organizacje przed karami; buduje również zaufanie. Jasper Claes z Unorma podkreśla:

"Udokumentowany wysiłek zgodności jest formalnym czynnikiem łagodzącym w ramach Ustawy" [13].

Najczęściej Zadawane Pytania

::: faq

Skąd mam wiedzieć, czy mój system AI jest "wysokiego ryzyka" zgodnie z Ustawą AI UE?

Aby ustalić, czy twój system AI kwalifikuje się jako "wysokiego ryzyka" zgodnie z Ustawą AI UE, zbadaj, czy funkcjonuje w sektorach takich jak infrastruktura krytyczna, biometryczna identyfikacja lub edukacja. Musisz również ocenić jego potencjał do spowodowania znacznych szkód. Systemy wysokiego ryzyka są wymienione w Załączniku III i Artykułach 9-15 Ustawy, z terminami zgodności ustalonym na 2 sierpnia 2026. :::

::: faq

Co liczy się jako zgodne ujawnienie AI dla chatbotów i asystentów głosowych?

Zgodne ujawnienie AI, wymagane przez Ustawę AI UE, zapewnia, że użytkownicy są wyraźnie poinformowani gdy wchodzą w interakcje z systemem AI. Obejmuje to zapewnianie jasnych szczegółów na temat tego, co system może i czego nie może robić, aby użytkownicy rozumieli jego możliwości i ograniczenia.

Przejrzystość jest również kluczowa. Ujawnienie powinno wyjaśniać, jak system AI podejmuje decyzje, oferując wględy w jego procesy. Ponadto jakakolwiek treść generowana przez AI musi być wyraźnie oznaczona w formacie czytelnym dla maszyn, ułatwiając identyfikację i zapewniając odpowiedzialność. :::

::: faq

Czy muszę oznaczyć tekst generowany przez AI, jeśli edytował go człowiek?

Nawet jeśli treść generowana przez AI jest później edytowana przez człowieka, musi być nadal oznaczona jako generowana przez AI zgodnie z Ustawą AI UE. Prawo nakazuje, że użytkownicy są informowani ilekroć treść pochodzi z lub jest modyfikowana przez AI. To wymaganie dotyczy niezależnie od zaangażowania człowieka w udoskonalanie lub zmianę treści. Celem jest utrzymanie przejrzystości, szczególnie w przypadku systemów AI wysokiego ryzyka. :::

Powiązane artykuły

Mapowanie krzyżowe frameworków: NIST, ISO 27001, SOC2

Wykorzystaj NIST CSF do budowania ujednoliconych kontroli, które mapują ISO 27001 i SOC 2, zmniejszając nakład pracy audytu i koszty zgodności.

NIS2 i ISO 27001: Przewodnik Wizualizacji Pokrywania się

Pokazuje, jak ISO 27001 pokrywa 70–80% NIS2 i podkreśla luki, takie jak ścisłe raportowanie incydentów i odpowiedzialność kierownictwa.

Zarządzanie polityką wieloramowe: Kluczowe praktyki

Scentralizuj polityki, mapuj nakładające się kontrole i używaj AI do automatyzacji zgodności z wieloma ramami, zmniejszając audyty i koszty.