Generyczne AI vs AI specjalizowane dla compliance

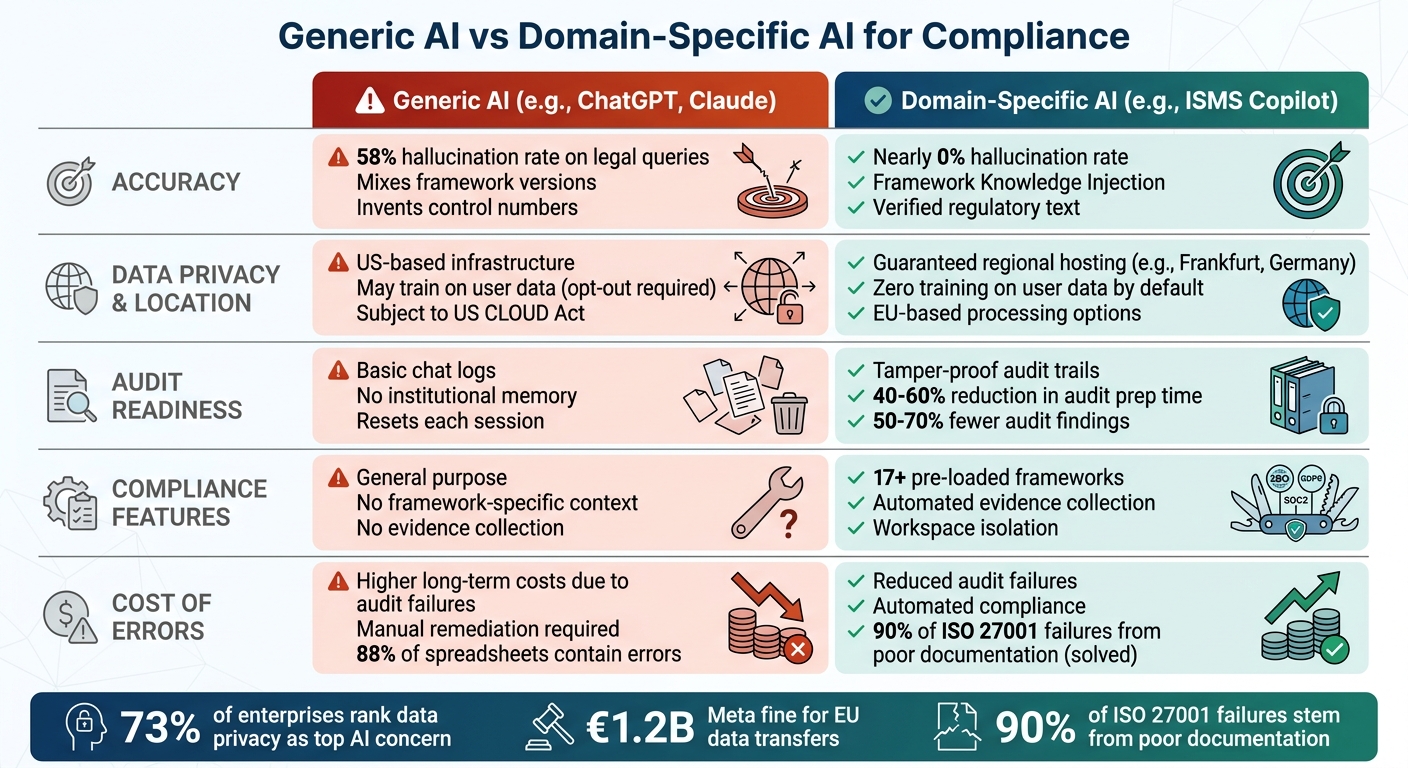

Porównanie generycznego i specjalizowanego AI do compliance: dokładność, rezydencja danych, gotowość do audytu i zmniejszone ryzyko audytu.

Generyczne AI vs AI specjalizowane dla compliance

Jeśli chodzi o zadania compliance, wybór właściwego narzędzia AI może być decydujący dla powodzenia Twoich działań. Czy powinieneś używać generycznego narzędzia AI takiego jak ChatGPT, czy wybrać specjalizowaną platformę AI? Oto konkluzja:

- Narzędzia generycznego AI są wszechstronne, ale często brakuje im precyzji wymaganej dla compliance. Opierają się na szerokich zbiorach danych, co prowadzi do niedokładności (np. wskaźnik halucynacji 58% dla zapytań prawnych). Stwarzają również zagrożenia, takie jak naruszenia prywatności danych ze względu na przetwarzanie w Stanach Zjednoczonych.

- Narzędzia specjalizowanego AI, takie jak ISMS Copilot, są dostosowane do pracy nad compliance. Wykorzystują weryfikowane dane regulacyjne, zapewniają rezydencję danych (np. serwery oparte w UE) i zawierają funkcje takie jak dzienniki audytu i dokładność specyficzną dla frameworku.

Kluczowe różnice:

- Dokładność: AI specjalizowane minimalizuje błędy, ukotwiczając odpowiedzi w zweryfikowanych standardach, w przeciwieństwie do generycznego AI, które może generować sfabrykowane lub przestarzałe informacje.

- Prywatność danych: Platformy specjalizowane priorytetyzują przechowywanie danych w danym regionie i suwerenność danych. Generyczne AI często przetwarza dane w Stanach Zjednoczonych, tworząc zagrożenia compliance związane z RODO i transferami transgranicznymi.

- Gotowość do audytu: Narzędzia specjalizowane zapewniają ustrukturyzowaną, odporną na manipulacje dokumentację i ciągłe zbieranie dowodów - coś czego brakuje generycznemu AI.

Szybkie podsumowanie: Jeśli compliance jest krytyczny dla Twojej organizacji, specjalizowane AI jest bezpieczniejszym i bardziej niezawodnym wyborem.

::: @figure  {Generyczne AI vs AI specjalizowane dla compliance: Kluczowe różnice}

:::

{Generyczne AI vs AI specjalizowane dla compliance: Kluczowe różnice}

:::

Bezpieczeństwo AI i ryzyko: porównanie obok siebie frameworków compliance i ryzyka AI

::: @iframe https://www.youtube.com/embed/wkEEK8Wp2WM :::

Dlaczego generyczne AI zawodzi w compliance bezpieczeństwa

Narzędzia generycznego AI, choć świetne dla ogólnej produktywności, mają trudności z precyzją i niezawodnością wymaganą dla regulowanej pracy compliance. Te modele generują tekst poprzez przewidywanie następnego słowa, zamiast czerpać z zweryfikowanych faktów [8]. To może prowadzić do wyników, które brzmią przekonywająco, ale są faktycznie nieprawidłowe - duże ryzyko w compliance, gdzie dokładność jest nie do negocjowania. Przeanalizujmy kluczowe problemy.

Niedokładne wyniki i halucynacje

Badania ujawniają, że aż 46% tekstu generowanego przez AI zawiera halucynacje. Podczas testowania z konkretnymi pytaniami prawnymi GPT-4 hallucynował co najmniej 58% czasu [4][9]. Dla specjalistów compliance ten poziom niedokładności jest niedopuszczalny. Konsekwencje mogą być poważne:

- Amerykańskiego prawnika ukarano za złożenie fikcyjnych cytowań orzedzeń wytworzonych przez ChatGPT.

- Air Canada musiała honować sfabrykowaną „politykę pogrzebową" stworzoną przez jego chatbota AI [4].

Generyczne AI ma również trudności z rozróżnianiem między przestarzałymi a aktualnymi standardami regulacyjnymi, tworząc niebezpieczne luki w compliance. Na przykład może mieszać wymagania ISO 27001:2013 i ISO 27001:2022, wymyślać numery kontroli, które nie istnieją, lub niepoprawnie twierdzić, że ISO 27001 nakazuje audit SOC 2 Type II.

J.P. Roe, profesjonalny pisarz, podsumował to dobrze:

"AI nie uchwytuje kontekstu - w ogóle nie... Osobiście nie użyłbym tego do niczego, co ma znaczenie prawne, chyba że miałbym specjalistę compliance, który by to poprawił" [10].

Badania pokazują, że 90% niepowodzeń ISO 27001 wynika ze słabego zarządzania dokumentacją i niemożności udowodnienia, że kontrole istnieją [4]. Generyczne AI nie posiada umiejętności generowania weryfikowalnych dowodów potrzebnych do spełnienia tych standardów. A poza dokładnością, kwestie związane z prywatnością danych jeszcze bardziej ujawniają jego ograniczenia.

Problemy z prywatnością danych i lokalizacją

Narzędzia generycznego AI stwarzają również znaczące zagrożenia dla prywatności danych i transgranicznych transferów danych. Nawet jeśli dostawcy twierdzą, że przechowują dane na terenie UE lub Wielkiej Brytanii, etap wnioskowania (gdzie procesory GPU przetwarzają dane wejściowe) często następuje w Stanach Zjednoczonych [6]. To stwarza wyzwania compliance dla organizacji związanych rozdziałem V RODO i orzeczeniem Schrems II.

Geoff Davies z PivotalEdge wyjaśnił:

"Rezydencja jest najsilniejsza dla przechowywanych danych. Jeśli potrzebujesz ścisłego przetwarzania tylko w UK dla wszystkiego, sprawdź jak OpenAI obsługuje wnioskowanie... ponieważ nie wszystkie przepływy pracy mogą zagwarantować przetwarzanie tylko w UK" [6].

To jest szczególnie niepokojące, ponieważ dostawcy AI w USA podlegają amerykańskim prawom dotyczącym inwigilacji, które mogą być sprzeczne z europejskimi standardami ochrony danych. Zagrożenia są realne: w kwietniu 2023 inżynierowie Samsung przypadkowo wyciekli zastrzeżony kod źródłowy i notatki z wewnętrznych spotkań do ChatGPT podczas używania go do podsumowania i debugowania - trzy oddzielne incydenty w zaledwie 20 dni. W odpowiedzi Samsung wdrożył całkowity zakaz generatywnego AI do użytku wewnętrznego [4].

Brakująca wyspecjalizowana wiedza compliance

Narzędzia generycznego AI również zawodzą jeśli chodzi o zrozumienie konkretnych frameworków compliance lub unikatowego środowiska kontroli, historii audytu lub profilu ryzyka organizacji. Chociaż te narzędzia mogą tworzyć polityki, nie mogą tworzyć obiektywnej, opatrzonej czasem, odpornej na manipulacje dokumentacji, którą wymagają audytorzy. Jak powiedział Humadroid:

"Audytorzy nie oceniają tego, czy Twoje kontrole brzmią dobrze. Oceniają to, czy Twoje kontrole demonstracyjnie działały w całym okresie audytu" [4].

Inny częsty problem: generyczne AI często myli wymagania prawne z best practices. Na przykład może niepoprawnie twierdzić, że szyfrowanie AES-256 jest wymagane prawnie, gdy regulacje po prostu wymagają „odpowiednich środków bezpieczeństwa" oparte na ocenie ryzyka. Ten nadmierny przepis może prowadzić do niepotrzebnych kosztów i wysiłków.

Te luki podkreślają potrzebę najlepszego asystenta AI dla ISO 27001, który zapewnia trwały, specyficzny dla frameworku kontekst i może dostosować się do niuansów pracy compliance - coś, do czego generyczne AI po prostu nie jest skonstruowane.

Jak AI specjalizowane rozwiązuje potrzeby compliance

AI specjalizowane opiera się na weryfikowanych danych regulacyjnych zamiast nieprzewidywalnych wzorów internetowych. Takie podejście zapewnia, że odpowiedzi opierają się na ustrukturyzowanej, wyselekcjonowanej wiedzy - niezbędnej, gdy precyzja jest nie do negocjowania. Oto jak radzi sobie z głównymi wyzwaniami compliance.

Pre-załadowane frameworki regulacyjne

W przeciwieństwie do generycznego AI, narzędzia specjalizowane wyposażone są w pre-załadowane frameworki regulacyjne w celu zapewnienia dokładności. Na przykład ISMS Copilot używa systemu zwanego "Dynamic Framework Knowledge Injection", który eliminuje zgadywanie. Kiedy wspominasz standard taki jak ISO 27001 lub SOC 2, system natychmiast go identyfikuje za pomocą pattern matchingu. Następnie ładuje odpowiednie kontrole, klauzule i wymagania do swojego kontekstu przed wygenerowaniem odpowiedzi. Ten proces, który zajmuje zaledwie 5–15 sekund, drastycznie zmniejsza błędy w zapytaniach specyficznych dla frameworku [11][12][14].

Informacje pochodzą z wyselekcjonowanych baz danych weryfikowanych przez inżynierów Governance, Risk, and Compliance (GRC) w stosunku do oficjalnych standardów [12][13]. Obecnie ISMS Copilot wspiera 17 frameworków, w tym ISO 27001:2022, ISO 42001:2023, SOC 2, HIPAA, RODO, NIS 2, DORA i Unijną ustawę o AI. Każda odpowiedź zawiera konkretne cytowania do tych frameworków, czyniąc wyniki gotowymi do audytów od początku [11][12][13].

Kompletne ścieżki audytu i śledzenie decyzji

Generyczne AI resetuje się z każdą rozmową, ale platformy specjalizowane utrzymują pamięć instytucjonalną w czasie - coś czego cenią audytorzy. Jest to szczególnie ważne biorąc pod uwagę, że 90% niepowodzeń ISO 27001 wynika ze słabej dokumentacji, a nie brakujących kontroli technicznych [4].

ISMS Copilot oferuje funkcje takie jak śledzenie zmian, osobne obszary robocze dla różnych projektów lub klientów i PII Reduction Mode, który automatycznie usuwa dane osobowe, takie jak imiona, e-maile i numery telefonów przed przetworzeniem. Użytkownicy mogą również skonfigurować okresy przechowywania danych, od zaledwie 1 dnia do aż 7 lat, aby wyrównać się z polityką regulacyjną lub wewnętrzną [13].

Kontrola lokalizacji danych i elastyczność wdrażania

Dla organizacji związanych ścisłymi regułami suwerenności danych, specjalizowane AI zapewnia zgodność poprzez gwarancje obsługi regionalnej. Na przykład ISMS Copilot przechowuje wszystkie dane we Frankfurcie w Niemczech i oferuje tryb Advanced Data Protection, który kieruje zapytania wyłącznie przez dostawców AI opartych na UE, takich jak Mistral AI [13][14]. To zapewnia zgodność z RODO i innymi prawami ochrony danych.

Wszyscy dostawcy backendu działają w ramach umów Zero Data Retention (ZDR), co oznacza, że dane wejściowe użytkownika i wyniki nigdy nie są przechowywane przez długi czas lub używane do trenowania modeli [13][14]. Dla organizacji o jeszcze bardziej rygorystycznych wymaganiach, niektóre platformy pozwalają na wdrażanie on-premises, w chmurach prywatnych lub na infrastrukturze brzegowej, zapewniając, że dane pozostają całkowicie pod kontrolą organizacji [15]. Ten poziom zarządzania danymi pomaga organizacjom spełnić nawet najsurowsze standardy compliance.

Prywatność danych i lokalizacja: główna różnica

Jeśli chodzi o compliance, gdzie dane są przechowywane i kto ma do nich dostęp są kwestiami krytycznymi. Generyczne narzędzia AI, takie jak ChatGPT, często przetwarzają dane poprzez infrastrukturę opartą w Stanach Zjednoczonych, co może powodować problemy dla firm podlegających europejskim, chińskim lub branżowym regulacjom. Z drugiej strony, specjalizowane AI jest zaprojektowane z lokalizacją danych jako priorytetem.

Rozróżnienie między prywatnością danych a lokalizacją jest głównym czynnikiem oddzielającym specjalizowane AI od rozwiązań generycznych. W rzeczywistości 73% przedsiębiorstw uważa prywatność danych i bezpieczeństwo za swój główny problem w AI, a 77% teraz bierze pod uwagę kraj pochodzenia dostawcy przed podjęciem decyzji zakupowej [17]. Te obawy nie są tylko teoretyczne - regulatorzy podjęli działania. Na przykład:

- Meta została ukarana na kwotę 1,2 miliarda EUR w 2023 roku za transfer danych użytkowników z UE do Stanów Zjednoczonych.

- TikTok stanęło w obliczu kary 530 milionów EUR w 2025 roku za wysłanie danych obywateli UE na serwery w Chinach.

- Uber zapłacił 290 milionów EUR w 2024 roku za przesunięcie rekordów kierowców pomiędzy granicami [17][19].

Te sprawy podkreślają znaczenie tego, jak specjalizowane AI redefiniuje przechowywanie danych, kontrole przetwarzania i zarządzanie ryzykiem transgranicznym.

Spełnianie regionalnych praw przechowywania danych

Platformy specjalizowanego AI starannie rozwiązują zarówno rezydencję danych (gdzie fizycznie znajdują się serwery) jak i suwerenność danych (ramy prawne regulujące te dane). Zwykły wybór „regionu UE" od dostawcy chmury opartego w Stanach Zjednoczonych niekoniecznie zapewnia zgodność. Jak wyjaśnia Jaipal Singh:

"Jurysdykcja prawna wynika z firmy, a nie z centrum danych" [17].

Weź EU AI Act Copilot jako przykład. Przechowuje dane we Frankfurcie w Niemczech i zawiera tryb Advanced Data Protection, który kieruje zapytania wyłącznie przez dostawców opartych na UE. Wszyscy dostawcy backendu działają w ramach umów Zero Data Retention (ZDR), co oznacza, że dane wejściowe i wyniki nie są zapisywane ani używane do trenowania modeli [1]. Ta konfiguracja wyrównuje się z wymaganiami RODO i pomaga organizacjom poruszać się w niepewności, szczególnie po upadku Ramach Ochrony Danych UE-USA (często zwanym "Schrems III") w końcu 2025 roku [18].

Stawki są wysokie. Zgodnie z Unijną ustawą o AI, kary mogą osiągnąć 7% globalnego rocznego przychodu lub 35 milionów EUR, a połączone naruszenia RODO i ustawy o AI mogą teoretycznie osiągnąć 11% globalnego przychodu [18]. Do 2026 roku co najmniej 34 kraje wprowadzily lub wzmocniły prawa lokalizacji danych wpływające na przetwarzanie AI [18].

Zmniejszanie ryzyka transgranicznych transferów danych

Nawet gdy dane są przechowywane w danym regionie, transgraniczne przepływy danych mogą wprowadzać dodatkowe zagrożenia compliance. Generyczne API AI często tworzą ukryte przepływy danych poprzez wtórne ścieżki, takie jak moderacja treści, kontrole bezpieczeństwa lub rejestrowanie. Te punkty dotykowe mogą podlegać różnym jurysdykcjom prawnym. Ponadto wielu generycznych dostawców zastrzega sobie prawo do używania danych wejściowych API do trenowania modeli, chyba że użytkownicy wyraźnie się wyrażą [18].

Specjalizowane AI minimalizuje te zagrożenia poprzez zamierzoną konstrukcję. Na przykład, niektóre platformy używają podejścia "Insights Not Data", gdzie dane są wstępnie przetwarzane lokalnie, aby usunąć lub pseudonimizować identyfikatory osobowe. Tylko anonimizowane spostrzeżenia są wysyłane do modeli opartych na chmurze [18]. Inne oferują izolację obszaru roboczego, zapewniając, że dane z różnych klientów lub projektów pozostają oddzielone [1].

To przemyślane podejście również oszczędza czas i pieniądze. Wdrożenie zasilanego AI zarządzania rezydencją danych może zająć zaledwie 2–3 tygodnie w porównaniu z 4–6 miesiącami z metodami ręcznymi. Koszty znacznie spadają, z szacunkowych 150 000–250 000 USD do 40 000–80 000 USD. Automatyczna walidacja zapewnia 100% dokładność, podczas gdy przeglądy ręczne niosą błąd 15–20% [16].

Jasne przetwarzanie i kontrole przechowywania danych

Platformy specjalizowanego AI zapewniają przejrzystość i kontrolę nad każdym etapem przetwarzania danych. Podczas gdy generyczne AI często działa jak „czarna skrzynka", rozwiązania specjalizowane ujawniają całe łańcuch przetwarzania. Na przykład ISMS Copilot pozwala organizacjom na konfigurowanie ustawień przechowywania danych w celu spełnienia zarówno regulacyjnych jak i wewnętrznych polityk. Zawiera również funkcje do automatycznego usuwania wrażliwych informacji osobowych podczas przetwarzania. Niektóre platformy nawet oferują opcje wdrażania takie jak on-premises, chmura prywatna lub ustawienia brzegowe, aby dane pozostały całkowicie pod kontrolą organizacji.

| Czynnik | AI specjalizowane (np. ISMS Copilot) | Generyczne AI (np. ChatGPT) |

|---|---|---|

| Lokalizacja danych | Gwarantowana regionalna (np. Frankfurt, Niemcy) [1] | Typowo infrastruktura oparta w USA [1] |

| Trening modelu | Zero treningu danych użytkownika domyślnie [1] | Może trenować na danych wejściowych (rezygnacja wymagana) [1] |

| Jurysdykcja | Często niepowiązana z USA lub oparta na chmurze niezależnej [17] | Podlegająca ustawie USA CLOUD Act [17] |

| Izolacja danych | Izolowane obszary robocze do użytku multi-klienta [1] | Proste wątki rozmowy; ryzyko zniekształcenia danych [1] |

Jak aptly powiedziała Prem AI:

"Era „ruszaj szybko i ustal compliance później" jest skończona dla AI" [19].

Organizacje, które priorytetyzują lokalizację danych i zgodność od początku - nie jako myśl dodatkowa - są lepiej przygotowane do przejścia audytów i uniknięcia kar. Ta silna podstawa dla kontroli danych bezpośrednio wpływa na wydajność, którą następna sekcja bada poprzez metryki dokładności i gotowość do audytu.

Porównanie wydajności: Generyczne AI vs AI specjalizowane

Jeśli chodzi o zadania compliance, luki w wydajności między generycznym AI a specjalizowanymi rozwiązaniami są trudne do zignorowania. Podczas gdy generyczne modele AI takie jak ChatGPT, Claude i Gemini są świetne dla ogólnych zadań, często zawodzą w obszarach wymagających precyzji, szczegółowych ścieżek audytu i niezawodnej dokumentacji. Z drugiej strony platformy specjalizowane, takie jak ISMS Copilot, są specjalnie zaprojektowane do radzenia sobie z tymi wyzwaniami.

Dokładność wykrywania luk w compliance

Generyczne modele AI opierają swoje prognozy na szerokich zbiorach danych, co często prowadzi do problemów z dokładnością w pracy compliance. Badanie Stanford z 2024 roku ujawniło, że GPT-4 "hallucynował" - lub generował nieprawidłowe informacje - 58% czasu w odpowiedzi na weryfikowalne pytania prawne [4]. Te błędy obejmują:

- Wymyślanie numerów kontroli.

- Mieszanie wersji frameworku.

- Zapewnianie nadmiernie sztywnych lub niedokładnych mandatów.

Specjalizowane AI rozwiązuje te problemy poprzez metodę zwaną Framework Knowledge Injection, która zapewnia, że odpowiedzi są zakotwiczone w zweryfikowanym tekście regulacyjnym. Na przykład ISMS Copilot v2.5 używa tego podejścia do praktycznie eliminacji sfabrykowanych wymagań w ponad 50 frameworkach regulacyjnych [1][2].

| Czynnik dokładności | AI specjalizowane (np. ISMS Copilot) | Generyczne AI (np. ChatGPT, Claude) |

|---|---|---|

| Wskaźnik halucynacji | Praktycznie wyeliminowany dla zapytań frameworku [1][2] | 58–88% dla zapytań specyficznych dla domeny [4] |

| Wersja frameworku | Jasne rozróżnienia (np. ISO 27001:2013 vs. 2022) [1] | Często miesza wersje [4] |

| Dokładność kontroli | Oparte na zweryfikowanym tekście regulacyjnym [1][2] | Podatne na wymyślanie lub błędne cytowanie kontroli [4] |

| Pamięć instytucjonalna | Zatrzymuje środowiska kontroli organizacyjnej w czasie [4] | Resetuje się z każdą sesją, brak trwałości [4] |

Te rozbieżności podkreślają znaczenie dokładności i właściwej dokumentacji, które są niezbędne dla compliance i gotowości do audytu.

Rekordy audytu i dokumentacja decyzji

Przygotowanie do audytu to kolejny obszar, w którym specjalizowane AI błyska. Jak powiedział Humadroid:

"Audytorzy nie oceniają tego, czy Twoje kontrole brzmią dobrze. Oceniają to, czy Twoje kontrole demonstracyjnie działały w całym okresie audytu." [4]

Generyczne AI typowo generuje podstawowe dzienniki czatu, które oferują małą wartość jako dowód audytu. W przeciwieństwie do tego, platformy specjalizowane zapewniają tamper-resistant dzienniki audytu i zautomatyzowane zbieranie dowodów poprzez integracje z narzędziami takimi jak AWS i GitHub. To nie tylko wzmacnia gotowość do audytu, ale również drastycznie zmniejsza czas przygotowania i zmniejsza stwierdzenia audytu [3][4].

Tutaj jest wpływ w liczbach:

- Firmy używające zautomatyzowanych platform compliance zgłaszają redukcję o 40–60% czasu przygotowania audytu.

- Widzą również 50–70% mniej stwierdzenia audytu w ich pierwszym audycie zewnętrznym [4].

Ponadto ręczne zarządzanie compliance prowadzi do kosztownych błędów, z 88% arkuszy kalkulacyjnych zawierających błędy i 90% niepowodzeń ISO 27001 wynikających ze słabej dokumentacji, a nie brakujących kontroli technicznych [4].

Aplikacje specyficzne dla branży

Zalety specjalizowanego AI wykraczają poza dokładność i ścieżki audytu, szczególnie w regulowanych branżach. Na przykład:

- ISO 27001: Specjalizowane platformy automatyzują mapowanie dla zestawu kontroli 2022, podczas gdy generyczne AI często odwołuje się do przestarzałych kontroli 2013 lub nawet nieistniejących [4].

- RODO: Narzędzia specjalizowane oferują szczegółowe analizy luk i rezydencję danych w UE, podczas gdy generyczne AI opiera się na infrastrukturze opartej w USA i zapewnia tylko poradę na powierzchni [1][4].

- SOC 2: Platformy takie jak ISMS Copilot umożliwiają ciągłe zbieranie dowodów poprzez integracje API, udowadniając operację kontroli w czasie - coś czego generyczne AI nie może osiągnąć [4].

W ochronie zdrowia stawki są jeszcze wyższe. Generyczne modele AI, szczególnie bezpłatne lub niższe wersje, stwarzają znaczące ryzyko wycieków Protected Health Information (PHI) do zbiorów danych treningowych [4]. Narzędzia specjalizowane łagodzą to poprzez wbudowaną wiedzę specyficzną dla opieki zdrowotnej i zapewniają zero treningu danych użytkownika domyślnie [1][4]. Jak ostrzega ISACA:

"Zespoły GRC muszą być ostrożne przy dzieleniu się zastrzeżonymi danymi firmy z modelami AI." [4]

Rozważania kosztowe

Na pierwszy rzut oka generyczne AI może wydawać się opcją przyjazną budżetowi. Na przykład ChatGPT Plus kosztuje 20 USD miesięcznie. Jednak brak dokładności specyficznej dla frameworku i niezawodnych ścieżek audytu często prowadzi do wyższych kosztów w długim okresie z powodu niepowodzeń audytu, wysiłków naprawczych i zwiększonej dokumentacji ręcznej. W porównaniu ISMS Copilot oferuje plany startujące od 24 USD/miesiąc, z planami Pro i Business po 100 USD/miesiąc i 250 USD/miesiąc odpowiednio [1]. Dla organizacji priorytetyzujących compliance, dodatkowy koszt specjalizowanego AI może zaoszczędzić znaczny czas, wysiłek i zasoby.

Zaključenie: Wybór właściwego AI dla compliance bezpieczeństwa

Główne punkty

Przy podejmowaniu decyzji między generycznym AI a specjalizowanym AI dla zadań compliance, kluczowe rozważania to dokładność, kontrola danych i gotowość do audytu. Chociaż narzędzia takie jak ChatGPT i Claude radzą sobie dobrze w ogólnych zadaniach, zawodzą w aplikacjach specyficznych dla compliance. Ich wysokie wskaźniki halucynacji mogą stanowić znaczące zagrożenie compliance i nie zapewniają solidnych ścieżek audytu niezbędnych do wymagań regulacyjnych [4].

W przeciwieństwie do tego, narzędzia specjalizowane takie jak ISMS Copilot wykorzystują Framework Knowledge Injection do dostarczania zweryfikowanych, skoncentrowanych na regulacjach odpowiedzi [1][2]. Te narzędzia zapewniają ścisłe gwarancje rezydencji danych (np. Frankfurt, Niemcy dla zgodności RODO), domyślnie zero treningów danych użytkownika, izolację obszarów roboczych dla scenariuszy multi-klienta i tamper-proof ścieżki audytu z zautomatyzowanym zbieraniem dowodów. Te funkcje są krytyczne dla przygotowania audytu, [Essential steps to ISO 27001 certification], z użytkownikami zgłaszającymi redukcję o 40–60% czasu przygotowania audytu i 50–70% mniej stwierdzenia audytu [4].

Takie różnice podkreślają znaczenie wyboru narzędzia dostosowanego do spełnienia rygorystycznych potrzeb compliance.

Jak wybrać właściwe rozwiązanie

Aby podjąć świadomą decyzję, rozważ następujące kroki:

-

Oceń wymagania suwerenności danych: Jeśli Twoja organizacja przetwarza dane obywateli UE lub działa w wysoce regulowanych sektorach, takich jak opieka zdrowotna lub finanse, potwierdź, że narzędzie AI spełnia wymagania jurysdykcji dotyczące przetwarzania i przechowywania danych [1][7]. Systemy generycznego AI często przetwarzają dane w Stanach Zjednoczonych, nawet jeśli przechowywanie następuje gdzie indziej [5].

-

Oceń dokładność frameworku: Upewnij się, że narzędzie potrafi rozróżnić między wersjami standardów (np. ISO 27001:2013 vs. ISO 27001:2022) i uniknąć błędów, takich jak sfabrykowane numery kontroli [4][7]. Platformy używające Retrieval-Augmented Generation z właściwymi cytowaniami są bardziej wiarygodne [20].

-

Priorytetizuj możliwości dowodu audytu: Jak podkreśla Humadroid:

"Audytorzy nie oceniają tego, czy Twoje kontrole brzmią dobrze. Oceniają to, czy Twoje kontrole demonstracyjnie działały w całym okresie audytu" [4].

Szukaj narzędzi, które bezproblemowo integrują się z Twoim technicznym stosem (np. AWS, GitHub, HRIS), aby umożliwić ciągłe monitorowanie i ustrukturyzowaną dokumentację zamiast tylko generowania tekstu konwersacyjnego.

Dla organizacji skoncentrowanych na compliance, wydanie dodatkowych 80 USD miesięcznie na narzędzie specjalizowane może prowadzić do znacznych oszczędności w kosztach naprawczych audytu i zatrudnienia [1][4].

FAQ

::: faq

Kiedy generyczne AI jest „wystarczająco dobre" dla pracy compliance?

Generyczne AI ma tendencję do radzenia sobie adekwatnie z zadaniami compliance, które są niskiego ryzyka, rutynowe i nie wymagają wyspecjalizowanej wiedzy lub ścisłych protokołów prywatności danych. Jednak jeśli chodzi o zadania wymagające precyzji specyficznej dla domeny, często zawodzi. Problemy takie jak niedokładności lub "halucynacje" mogą się pojawić, czyniąc to niezawodnym dla scenariuszy compliance o wysokim ryzyku, gdzie dokładność i zaufanie są nie do negocjowania. :::

::: faq

Jak mogę zweryfikować, że odpowiedzi AI w compliance nie będą hallucynować?

Podczas korzystania z AI dla zadań związanych z compliance, ważne jest weryfikacja jego odpowiedzi względem oficjalnych standardów. To może pomóc w zapewnieniu, że dostarczone informacje są godne zaufania i wyrównują się z ustanowionymi wytycznymi.

Oto kilka strategii do poprawy dokładności:

- Poproś o cytowania: Zawsze poproś AI, aby dostarczyło źródła swoich odpowiedzi. To pozwala na śledzenie informacji z powrotem do wiarygodnych odniesień.

- Zachęcaj przejrzystość: Poproś AI, aby przyznała niepewność, jeśli nie jest pewna odpowiedzi. To może pomóc w zapobieganiu nadmiernej pewności siebie w potencjalnie niedokładnych odpowiedziach.

- Uprość złożone zapytania: Podziel swoje pytania na mniejsze, bardziej łatwe do zarządzania części. To zmniejsza szansę błędnej interpretacji lub błędów w odpowiedzi.

Ponadto narzędzia takie jak ISMS Copilot mogą być cenne. To narzędzie integruje zweryfikowaną wiedzę, aby zmniejszyć niedokładności, często określane jako halucynacje, i poprawia niezawodność wyników związanych z compliance. :::

::: faq

Co powinienem zapytać dostawców o rezydencję danych i lokalizację przetwarzania?

Gdy rozważasz dostawców dla narzędzi AI, takich jak ISMS Copilot, ważne jest pytanie o gdzie Twoje dane są przechowywane i przetwarzane. Upewnij się, że ich praktyki wyrównują się z regulacjami Twojego regionu i standardami prywatności Twojej organizacji. Jeśli pracujesz w wysoce regulowanej branży, sprawdź, czy dostawca oferuje opcje lokalizacji danych lub suwerenności danych. Również potwierdź ich zgodność z frameworkami, takimi jak RODO lub innymi istotnymi lokalnymi przepisami. W ten sposób możesz zapewnić, że Twoje dane pozostają bezpieczne i spełniają wszystkie niezbędne wymagania prawne. :::

Powiązane artykuły

Mapowanie krzyżowe frameworków: NIST, ISO 27001, SOC2

Wykorzystaj NIST CSF do budowania ujednoliconych kontroli, które mapują ISO 27001 i SOC 2, zmniejszając nakład pracy audytu i koszty zgodności.

NIS2 i ISO 27001: Przewodnik Wizualizacji Pokrywania się

Pokazuje, jak ISO 27001 pokrywa 70–80% NIS2 i podkreśla luki, takie jak ścisłe raportowanie incydentów i odpowiedzialność kierownictwa.

Ustawa AI UE: Wyjaśnienie Wymagań Przejrzystości

Przegląd przejrzystości Ustawy AI UE: zasady ujawniania chatbotów i treści AI, standardy dokumentacji, harmonogramy i kary.